Recientemente, la popularidad de las aplicaciones de modelos de lenguaje grande (LLM) de IA ha impulsado una feroz competencia en el campo del hardware. AMD ha lanzado su última serie de APU Strix Point y sus procesadores Ryzen AI muestran ventajas significativas en el manejo de tareas LLM, con un rendimiento que supera con creces el de la serie Lunar Lake de Intel. El editor de Downcodes le brindará una comprensión profunda del rendimiento de la serie de APU Strix Point y la innovación tecnológica detrás de ella.

Recientemente, AMD lanzó su última serie de APU Strix Point, enfatizando el rendimiento sobresaliente de la serie en aplicaciones de modelo de lenguaje grande (LLM) de IA, superando con creces a los procesadores de la serie Lunar Lake de Intel. A medida que la demanda de cargas de trabajo de IA sigue creciendo, la competencia por el hardware se vuelve cada vez más feroz. En respuesta al mercado, AMD lanzó procesadores de IA diseñados para plataformas móviles, con el objetivo de lograr un mayor rendimiento y una menor latencia.

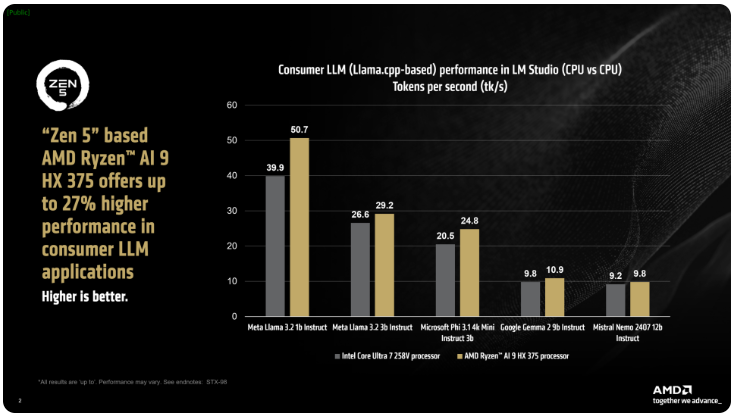

AMD dijo que el procesador Ryzen AI300 de la serie ix Point puede aumentar significativamente la cantidad de tokens procesados por segundo al procesar tareas AI LLM. En comparación con el Core Ultra258V de Intel, el rendimiento del Ryzen AI9375 ha mejorado en un 27%. Aunque Core Ultra7V no es el modelo más rápido de la serie L Lake, su número de núcleos y subprocesos se acerca al de los procesadores Lunar Lake de gama alta, lo que demuestra la competitividad de los productos AMD en esta área.

La herramienta LM Studio de AMD es una aplicación orientada al consumidor basada en el marco llama.cpp, diseñada para simplificar el uso de modelos de lenguaje grandes. El marco optimiza el rendimiento de las CPU x86. Aunque no se requiere una GPU para ejecutar LLM, el uso de una GPU puede acelerar aún más el procesamiento. Según la prueba, Ryzen AI9HX375 puede lograr una latencia 35 veces menor en el modelo Meta Llama3.21b Instruct, procesando 50,7 tokens por segundo. En comparación, Core Ultra7258V tiene solo 39,9 tokens.

No solo eso, la APU Strix Point también está equipada con una potente tarjeta gráfica integrada Radeon basada en la arquitectura RDNA3.5, que puede descargar tareas a la iGPU a través de la API ulkan para mejorar aún más el rendimiento de LLM. Utilizando la tecnología de memoria gráfica variable (VGM), el procesador Ryzen AI300 puede optimizar la asignación de memoria, mejorar la eficiencia energética y, en última instancia, lograr una mejora del rendimiento de hasta un 60 %.

En pruebas comparativas, AMD utilizó la misma configuración en la plataforma Intel AI Playground y descubrió que el Ryzen AI9HX375 era un 87% más rápido que el Core Ultra7258V en Microsoft Phi3.1 y un 13% más rápido en el modelo Mistral7b Instruct0.3. Aún así, los resultados son más interesantes en comparación con el Core Ultra9288V, el buque insignia de la serie Lunar Lake. Actualmente, AMD se está centrando en hacer más popular el uso de modelos de lenguajes grandes a través de LM Studio, con el objetivo de facilitar el inicio a más usuarios no técnicos.

El lanzamiento de la serie de APU AMD Strix Point marca una mayor intensificación de la competencia en el campo de los procesadores de IA y también indica que las futuras aplicaciones de IA tendrán un soporte de hardware más potente. Sus mejoras en rendimiento y eficiencia energética brindarán a los usuarios una experiencia de IA más fluida y potente. El editor de Downcodes seguirá prestando atención a los últimos desarrollos en este campo y brindará informes más interesantes a los lectores.