El equipo de Meta FAIR lanzó un nuevo modelo de Transformer, Dualformer, que simula sistemas cognitivos duales humanos (Sistema 1 y Sistema 2) y logra mejoras significativas en las capacidades de razonamiento y la eficiencia informática. A diferencia de los modelos Transformer tradicionales que solo simulan el Sistema 1 o el Sistema 2, Dualformer puede cambiar de manera flexible entre modos de razonamiento rápido y lento para adaptarse a la complejidad de diferentes tareas. Esta innovación surge de su método de entrenamiento único: utiliza trayectorias de razonamiento aleatorio para el entrenamiento y descarta aleatoriamente diferentes partes de las trayectorias para simular atajos en el proceso de pensamiento humano.

El equipo FAIR de Meta lanzó recientemente un nuevo modelo Transformer llamado Dualformer, que imita el sistema cognitivo dual humano y puede integrar sin problemas modos de razonamiento rápido y lento, logrando avances significativos en las capacidades de razonamiento y la eficiencia informática.

Generalmente se piensa que los procesos de pensamiento humano están controlados por dos sistemas: el Sistema 1, que es rápido e intuitivo, y el Sistema 2, que es más lento y lógico.

Los modelos tradicionales de Transformer generalmente solo simulan uno del Sistema 1 o el Sistema 2, lo que da como resultado un modelo que es rápido pero tiene capacidades de razonamiento deficientes o tiene capacidades de razonamiento sólidas pero es lento y tiene altos costos computacionales.

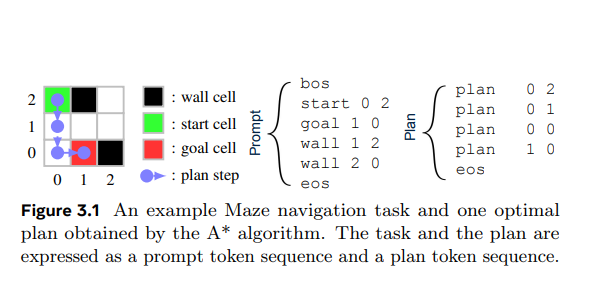

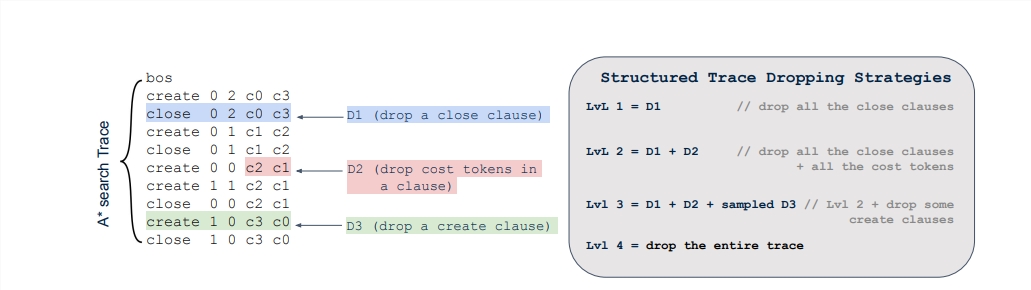

Lo innovador del Dualformer es la forma en que está entrenado. Los investigadores entrenaron el modelo utilizando trayectorias de inferencia aleatorias, descartando aleatoriamente diferentes partes de las trayectorias durante el entrenamiento, de manera similar a analizar los procesos de pensamiento humano y crear atajos. Esta estrategia de entrenamiento permite a Dualformer cambiar de manera flexible entre diferentes modos durante la inferencia:

Modo rápido: Dualformer solo genera la solución final, que es extremadamente rápida.

Modo lento: Dualformer generará una cadena de razonamiento completa y una solución final, con capacidades de razonamiento más sólidas.

Modo automático: Dualformer puede seleccionar automáticamente el modo apropiado según la complejidad de la tarea.

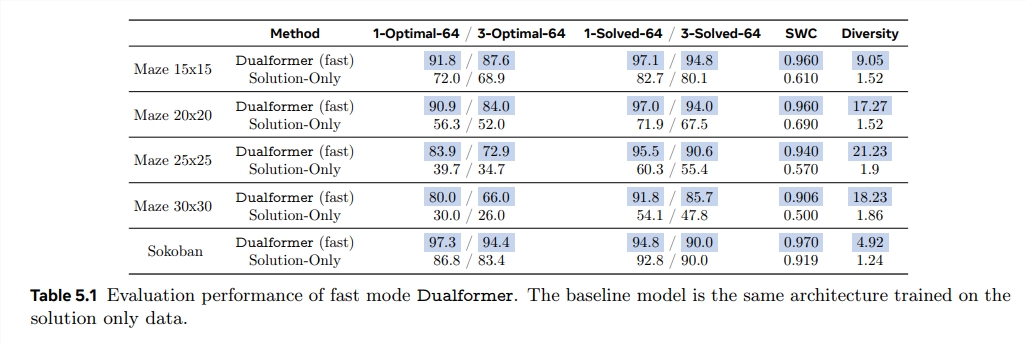

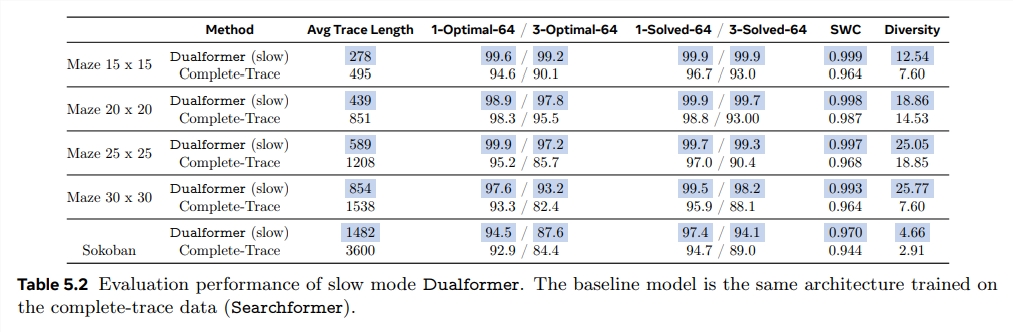

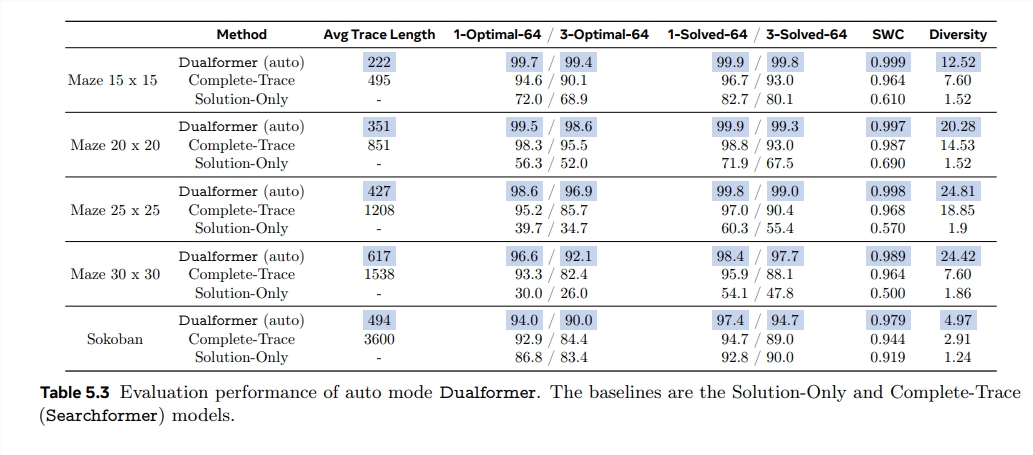

Los resultados experimentales muestran que Dualformer funciona bien en tareas como la navegación por laberintos y la resolución de problemas matemáticos. En modo lento, Dualformer puede resolver la tarea de navegación en laberintos de 30x30 con una tasa de éxito del 97,6 %, superando el modelo Searchformer entrenado utilizando solo trayectorias de inferencia completas, al tiempo que reduce los pasos de inferencia en un 45,5 %.

En el modo rápido, la tasa de éxito de Dualformer también llega al 80%, que es mucho más alta que el modelo de solo solución entrenado usando solo la solución final. En modo automático, Dualformer puede reducir significativamente los pasos de inferencia mientras mantiene una alta tasa de éxito.

El éxito de Dualformer muestra que la aplicación de la teoría cognitiva humana al diseño de modelos de inteligencia artificial puede mejorar eficazmente el rendimiento del modelo. Este modelo de integración del pensamiento rápido y lento proporciona nuevas ideas para construir sistemas de IA más potentes y eficientes.

Dirección del artículo: https://arxiv.org/pdf/2410.09918

El editor de Downcodes concluyó: La aparición de Dualformer marca un gran paso adelante en el diseño de modelos de inteligencia artificial más cercanos a los patrones de pensamiento humano. Sus avances en la eficiencia y precisión del razonamiento proporcionan nuevas direcciones y el desarrollo futuro de la tecnología de IA.