Con el rápido desarrollo de la tecnología AIGC, la manipulación de imágenes se ha vuelto cada vez más desenfrenada. El método tradicional de detección y localización de manipulación de imágenes (IFDL) enfrenta el desafío de la naturaleza de "caja negra" y la capacidad de generalización insuficiente. El editor de Downcodes se enteró de que un equipo de investigación de la Universidad de Pekín propuso un marco multimodal llamado FakeShield, cuyo objetivo es resolver estos problemas. FakeShield aprovecha inteligentemente las poderosas capacidades de los modelos de lenguajes grandes (LLM), especialmente los modelos de lenguajes grandes multimodales (M-LLM), al crear un conjunto de datos de descripción de manipulación multimodal (MMTD-Set) y ajustar el modelo para lograr una detección efectiva. y localiza varias técnicas de manipulación y proporciona resultados de análisis interpretables.

Con el rápido desarrollo de la tecnología AIGC, las herramientas de edición de imágenes se han vuelto cada vez más poderosas, lo que hace que la manipulación de imágenes sea más fácil y más difícil de detectar. Aunque los métodos existentes de detección y localización de manipulación de imágenes (IFDL) son generalmente efectivos, a menudo enfrentan dos desafíos importantes: primero, la naturaleza de "caja negra" y principios de detección poco claros, en segundo lugar, la capacidad de generalización limitada y la dificultad para lidiar con múltiples métodos de manipulación (tales como; como Photoshop, DeepFake, edición AIGC).

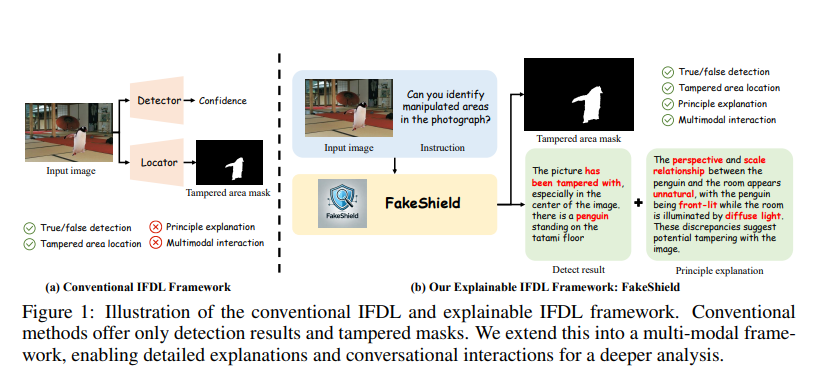

Para resolver estos problemas, el equipo de investigación de la Universidad de Pekín propuso la tarea IFDL interpretable y diseñó FakeShield, un marco multimodal capaz de evaluar la autenticidad de las imágenes, generar máscaras de áreas manipuladas y, basándose en pistas de manipulación a nivel de píxeles y de imágenes, proporciona una solución. base para el juicio.

El método IFDL tradicional solo puede proporcionar la probabilidad de autenticidad y el área de manipulación de la imagen, pero no puede explicar el principio de detección. Debido a la precisión limitada de los métodos IFDL existentes, aún se requiere un juicio posterior manual. Sin embargo, dado que la información proporcionada por el método IFDL es insuficiente para respaldar la evaluación manual, los usuarios aún deben volver a analizar las imágenes sospechosas por sí mismos.

Además, en escenarios de la vida real, existen varios tipos de manipulación, incluido Photoshop (copiar, mover, empalmar y eliminar), edición AIGC, DeepFake, etc. Los métodos IFDL existentes normalmente sólo pueden manejar una de las técnicas y carecen de capacidades de generalización integrales. Esto obliga a los usuarios a identificar diferentes tipos de manipulación con antelación y aplicar métodos de detección específicos en consecuencia, lo que reduce en gran medida la utilidad de estos modelos.

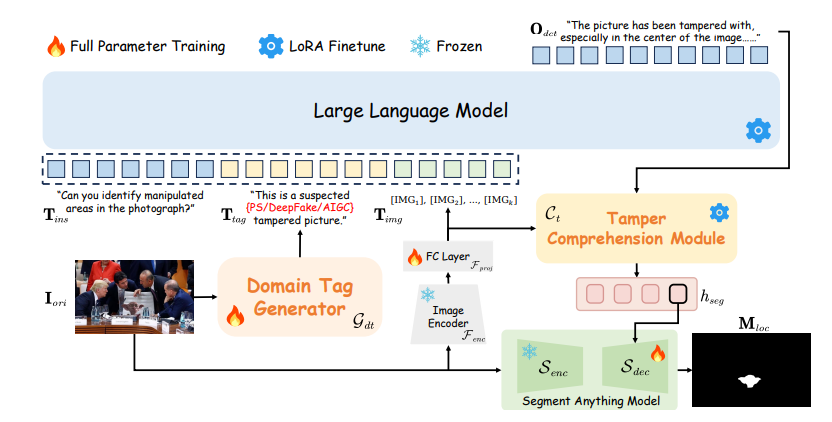

Para resolver estos dos problemas principales de los métodos IFDL existentes, el marco FakeShield aprovecha las poderosas capacidades de los modelos de lenguaje grandes (LLM), especialmente los modelos de lenguaje grande multimodales (M-LLM), que son capaces de alinear características visuales y textuales, potenciando así el LLM. Tiene capacidades de comprensión visual más fuertes. Debido a que los LLM están previamente capacitados en un corpus masivo y diverso de conocimiento mundial, tienen un gran potencial en muchos campos de aplicación, como la traducción automática, la finalización de código y la comprensión visual.

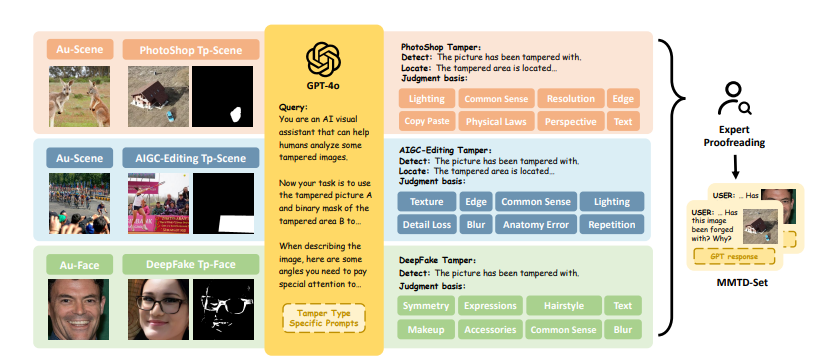

El núcleo del marco FakeShield es el conjunto de datos de descripción de manipulación multimodal (MMTD-Set). Este conjunto de datos utiliza GPT-4o para mejorar el conjunto de datos IFDL existente y contiene triples de imágenes manipuladas, máscaras de región modificadas y descripciones detalladas de regiones editadas. Al aprovechar MMTD-Set, el equipo de investigación ajustó los modelos M-LLM y de segmentación visual para que puedan proporcionar resultados de análisis completos, incluida la detección de manipulaciones y la generación de máscaras precisas de áreas manipuladas.

FakeShield también incluye el Módulo de detección de falsificaciones interpretables guiado por etiquetas de dominio (DTE-FDM) y el Módulo de localización de falsificaciones multimodal (MFLM), que se utilizan respectivamente para resolver varios tipos de interpretación de detección de manipulaciones e implementar la localización de falsificaciones guiada por descripciones de texto detalladas.

Amplios experimentos muestran que FakeShield puede detectar y localizar eficazmente diversas técnicas de manipulación, proporcionando una solución interpretable y superior en comparación con los métodos IFDL anteriores.

El resultado de esta investigación es el primer intento de aplicar M-LLM a IFDL interpretable, lo que marca un progreso significativo en este campo. FakeShield no solo es bueno en la detección de manipulaciones, sino que también proporciona explicaciones completas y localización precisa, y demuestra sólidas capacidades de generalización para varios tipos de manipulaciones. Estas características la convierten en una herramienta versátil para una variedad de aplicaciones del mundo real.

En el futuro, este trabajo desempeñará un papel vital en múltiples áreas, como ayudar a mejorar las leyes y regulaciones relacionadas con la manipulación de contenido digital, brindar orientación para el desarrollo de la inteligencia artificial generativa y promover un entorno en línea más claro y confiable. . Además, FakeShield puede ayudar con la recopilación de pruebas en procedimientos legales y ayudar a corregir información errónea en el discurso público, lo que en última instancia ayuda a mejorar la integridad y confiabilidad de los medios digitales.

Página de inicio del proyecto: https://zhipeixu.github.io/projects/FakeShield/

Dirección de GitHub: https://github.com/zhipeixu/FakeShield

Dirección del artículo: https://arxiv.org/pdf/2410.02761

La aparición de FakeShield ha traído nuevos avances en el campo de la detección de manipulación de imágenes. Su interpretabilidad y sus fuertes capacidades de generalización hacen que tenga un gran potencial en aplicaciones prácticas. Vale la pena esperar su uso futuro para mantener la seguridad de la red y mejorar la credibilidad de la tecnología digital. los medios de comunicación desempeñan un papel más importante. El editor de Downcodes cree que esta tecnología tendrá un impacto positivo en la autenticidad y confiabilidad de los contenidos digitales.