OpenAI ha estado haciendo movimientos frecuentes recientemente. Después del código abierto de Llama 3.1, ha lanzado otra gran noticia: desde ahora hasta el 23 de septiembre, los desarrolladores pueden obtener 2 millones de tokens de entrenamiento gratis todos los días para ajustar el modelo. Este movimiento no sólo demuestra la generosidad de OpenAI, sino que también marca una nueva etapa en el desarrollo de la tecnología de IA. El editor de Downcodes le brindará una comprensión profunda de las ventajas de GPT-4o mini y el significado detrás de este evento de ajuste gratuito.

Si bien la noticia de que Llama 3.1 es de código abierto todavía resuena en nuestros oídos, OpenAI está aquí para robar protagonismo nuevamente. A partir de ahora, se utilizarán 2 millones de tokens de entrenamiento para ajustar el modelo de forma gratuita todos los días hasta el 23 de septiembre. Esta no es solo una donación generosa para los desarrolladores, sino también un impulso audaz para el avance de la tecnología de inteligencia artificial.

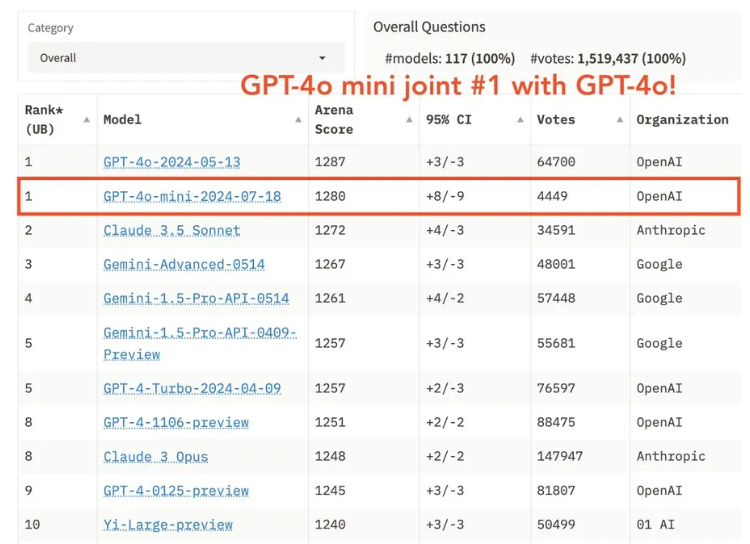

La llegada del GPT-4o mini ha entusiasmado a innumerables desarrolladores. Ocupa el primer lugar con GPT-4o en el ranking LMSYS del sector de modelos grandes. Tiene un rendimiento potente pero el precio es solo 1/20 del GPT-4o. Este movimiento de OpenAI es sin duda un gran beneficio para el campo de la IA.

Los desarrolladores que recibieron el correo electrónico se apresuraron a decirse con entusiasmo que un trozo de lana tan grande debía cosecharse lo antes posible. OpenAI anunció que del 23 de julio al 23 de septiembre, los desarrolladores podrán utilizar 2 millones de tokens de formación de forma gratuita. El exceso se cobrará en tokens de 3 millones de dólares.

Más asequible: la tarifa del token de entrada del GPT-4o mini es un 90% menor que la del GPT-3.5Turbo, y la tarifa del token de salida es un 80% menor. Incluso después de que finalice el período gratuito, el costo de capacitación de GPT-4o mini es la mitad que el de GPT-3.5Turbo.

Contexto más largo: la longitud del contexto de entrenamiento de GPT-4o mini es de 65k Tokens, que es 4 veces mayor que la de GPT-3.5Turbo, y la longitud del contexto de inferencia es de 128k Tokens, que es 8 veces mayor que la de GPT-3.5Turbo.

Más inteligente y más capaz: GPT-4o mini es más inteligente que GPT-3.5Turbo y admite funciones visuales (aunque el ajuste fino actualmente se limita al texto).

La mini función de ajuste fino de GPT-4o estará abierta a clientes empresariales, así como a desarrolladores Tier4 y Tier5, y el acceso se ampliará gradualmente a todos los niveles de usuarios en el futuro. OpenAI ha publicado una guía de ajuste para ayudar a los desarrolladores a comenzar rápidamente.

Algunos internautas no son optimistas al respecto y creen que OpenAI está recopilando datos, entrenando y mejorando modelos de IA. Otros internautas creen que la victoria del GPT-4o mini es una prueba sustancial de que la IA se ha vuelto lo suficientemente inteligente como para engañarnos.

El lanzamiento de GPT-4o mini y la política de ajuste gratuito sin duda promoverán un mayor desarrollo y popularización de la tecnología de IA. Para los desarrolladores, esta es una oportunidad de oro para crear aplicaciones más potentes a un costo menor. En cuanto a la tecnología de IA en sí, ¿significa esto un nuevo hito?

Documentación de ajuste: https://platform.openai.com/docs/guides/fine-tuning/fine-tuning-integrations

Las actividades de ajuste gratuitas de GPT-4o mini brindan a los desarrolladores excelentes oportunidades de aprendizaje y práctica. Sus características de bajo costo y alto rendimiento también indican la dirección futura del desarrollo de las aplicaciones de IA. !