Con el rápido desarrollo de la inteligencia artificial, la tecnología de comprensión de interfaces de usuario liviana y eficiente se ha convertido en la clave para las aplicaciones de IA. En un artículo de investigación publicado recientemente, Apple presentó una nueva arquitectura llamada UI-JEPA, cuyo objetivo es resolver el problema de la comprensión eficiente de la interfaz de usuario en dispositivos livianos. Esta tecnología no solo mantiene un alto rendimiento, sino que también reduce significativamente los requisitos informáticos, proporcionando nuevas posibilidades para ejecutar aplicaciones de IA en dispositivos con recursos limitados. Se espera que la aparición de UI-JEPA promueva la popularización generalizada de aplicaciones de IA más convenientes y privadas.

A medida que la tecnología de inteligencia artificial continúa avanzando, la comprensión de la interfaz de usuario (UI) se ha convertido en un desafío clave en la creación de aplicaciones de IA intuitivas y útiles. Recientemente, los investigadores de Apple presentaron UI-JEPA en un nuevo artículo, una arquitectura diseñada para lograr una comprensión de la interfaz de usuario liviana en el lado del dispositivo que no solo mantiene un alto rendimiento, sino que también reduce significativamente el costo de los requisitos de cálculo de la interfaz de usuario.

El desafío de la comprensión de la interfaz de usuario radica en la necesidad de procesar características multimodales, incluidas imágenes y lenguaje natural, para capturar relaciones temporales en secuencias de interfaz de usuario. Aunque los modelos multimodales de lenguaje grande (MLLM), como Anthropic Claude3.5Sonnet y OpenAI GPT-4Turbo, han logrado avances en la planificación personalizada, estos modelos requieren amplios recursos informáticos, tamaños de modelo enormes e introducen una alta latencia. No son adecuados para soluciones de dispositivos livianos que requieren baja latencia y privacidad mejorada.

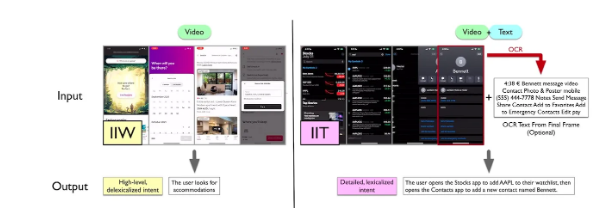

Fuente de imagen de ejemplo del conjunto de datos IIT y IIW de UI-JEPA: arXiv

Para seguir avanzando en la investigación sobre la comprensión de la interfaz de usuario, los investigadores introducen dos nuevos conjuntos de datos multimodales y puntos de referencia: "Intenciones en la naturaleza" (IIW) e "Intenciones en lo domesticado" (IIT). IIW captura secuencias de acción de UI abiertas con una intención vaga del usuario, mientras que IIT se centra en tareas comunes con una intención más clara.

La evaluación del rendimiento de UI-JEPA en nuevos puntos de referencia muestra que supera a otros modelos de codificadores de vídeo en la configuración de pocas tomas y logra un rendimiento comparable al de modelos cerrados más grandes. Los investigadores descubrieron que la combinación de texto extraído de la interfaz de usuario mediante el reconocimiento óptico de caracteres (OCR) mejoraba aún más el rendimiento de UI-JEPA.

Los usos potenciales del modelo UI-JEPA incluyen la creación de bucles de retroalimentación automatizados para los agentes de IA, permitiéndoles aprender continuamente de las interacciones sin intervención humana, y la integración de UI-JEPA en aplicaciones diseñadas para rastrear la intención del usuario en diferentes aplicaciones y modos en el marco de la agencia. .

El modelo UI-JEPA de Apple parece encajar bien con Apple Intelligence, un conjunto de herramientas ligeras de IA generativa diseñadas para hacer que los dispositivos Apple sean más inteligentes y eficientes. Dado el enfoque de Apple en la privacidad, el bajo costo y la eficiencia adicional del modelo UI-JEPA podrían darle a su asistente de inteligencia artificial una ventaja sobre otros asistentes que dependen de modelos en la nube.

La aparición de UI-JEPA ha brindado nuevas posibilidades a las aplicaciones ligeras de IA del lado del dispositivo. Sus ventajas en materia de protección de la privacidad y computación eficiente le brindan amplias perspectivas de aplicación en el futuro desarrollo de la IA y merecen una atención continua.