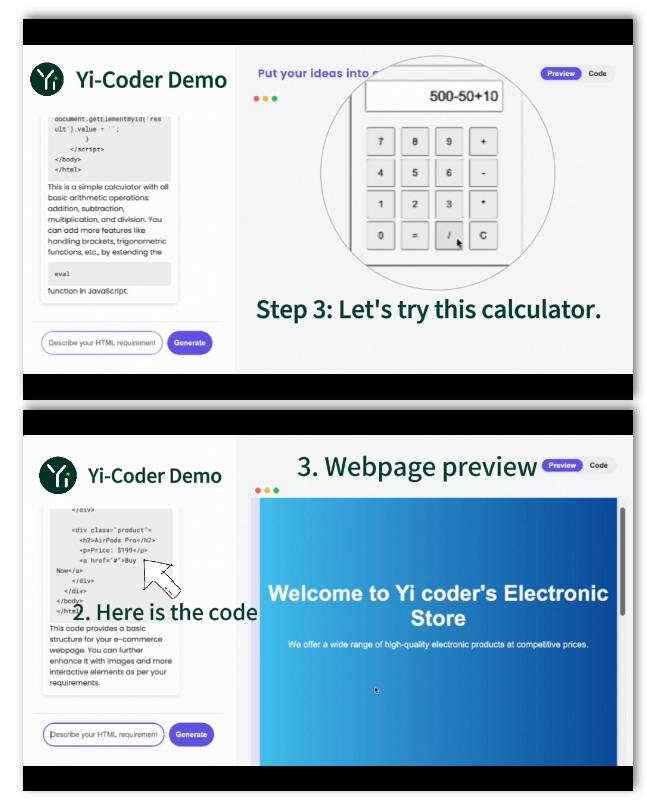

Beijing Zero-One Technology Co., Ltd. ha abierto su serie de modelos de programación Yi-Coder, lo que supone un hito importante. La serie Yi-Coder incluye modelos con dos tamaños de parámetros de 1.5B y 9B. De particular interés es Yi-Coder-9B, que ha demostrado un rendimiento líder en generación, comprensión, depuración y finalización de código. El modelo admite múltiples lenguajes de programación y es capaz de manejar contextos de hasta 128 000 tokens, lo que lo hace capaz de manejar código complejo a nivel de proyecto.

Los modelos de la serie Yi-Coder han logrado excelentes resultados en pruebas comparativas como LiveCodeBench y CodeEditorBench, superando a muchos modelos similares en términos de eficiencia de generación de código y capacidades de edición de código, e incluso tomando la delantera entre los modelos con cantidades de parámetros inferiores a 10B. Además, Yi-Coder también ha demostrado sólidas capacidades en modelado de secuencias largas y razonamiento matemático.

Además, Yi-Coder es igualmente sólido en capacidades de edición y finalización de código, y logró excelentes resultados en la evaluación de CodeEditorBench. En términos de modelado de secuencias largas y capacidades de razonamiento matemático, Yi-Coder también ha demostrado su potente rendimiento, con un rendimiento excelente tanto en la comprensión de textos largos como en la resolución de problemas matemáticos.

Dirección del proyecto: https://github.com/01-ai/Yi-Coder

El código abierto de los modelos de la serie Yi-Coder proporciona a los desarrolladores potentes herramientas y también promueve un mayor desarrollo de la inteligencia artificial en el campo de la programación. Su excelente rendimiento y amplias perspectivas de aplicación lo convierten en un excelente proyecto de código abierto digno de atención. Se espera que Yi-Coder pueda usarse en más escenarios en el futuro y continúe mejorándose y perfeccionándose.