Los deepfakes, como inteligencia artificial adversaria en rápido desarrollo, representan una amenaza cada vez más grave para la economía y la seguridad globales. Se espera que el daño económico causado por esto aumente significativamente, siendo la industria de servicios bancarios y financieros un objetivo importante. Este artículo analizará la tendencia de rápido desarrollo de la tecnología deepfake, los riesgos y desafíos que trae para las empresas y los individuos, y explorará los dilemas que enfrentan las empresas al enfrentar esta amenaza emergente.

Como una de las formas de inteligencia artificial adversaria de más rápido crecimiento, se espera que las pérdidas relacionadas con los deepfakes aumenten de 12.300 millones de dólares en 2023 a 40.000 millones de dólares en 2027, una tasa de crecimiento anual compuesta del 32%. Deloitte espera que proliferen los deepfakes en los próximos años, siendo los bancos y los servicios financieros los principales objetivos.

Los deepfakes están a la vanguardia de los ataques adversarios de IA y han crecido un 3000 % solo en el último año. Se espera que los deepfakes aumenten entre un 50% y un 60% para 2024, y se esperan entre 140.000 y 150.000 incidentes de este tipo a nivel mundial este año.

La última generación de aplicaciones, herramientas y plataformas de IA generativa brindan a los atacantes todo lo que necesitan para crear videos deepfake, voces suplantadas y documentos fraudulentos de manera rápida y rentable. El Informe de seguridad e inteligencia del habla de 2024 de Pindrops estima que el fraude deepfake dirigido a los centros de contacto cuesta aproximadamente 5 mil millones de dólares al año. Su informe destaca la grave amenaza que representan los deepfakes para los servicios bancarios y financieros

Bloomberg informó el año pasado que “ha surgido toda una industria artesanal en la web oscura que vende estafadores por precios que van desde $ 20 hasta miles de dólares. Más recientemente, una infografía basada en el Informe de fraude de identidad 2023 de Sumsub proporciona una perspectiva global sobre el rápido crecimiento del fraude de IA”. .

Un tercio de las empresas no tiene una estrategia para hacer frente al riesgo de ataques adversarios de IA, que probablemente comiencen con falsificaciones profundas de sus ejecutivos clave. Una nueva investigación de Ivanti encontró que el 30% de las empresas no tienen ningún plan para identificar y defenderse contra ataques adversarios de IA.

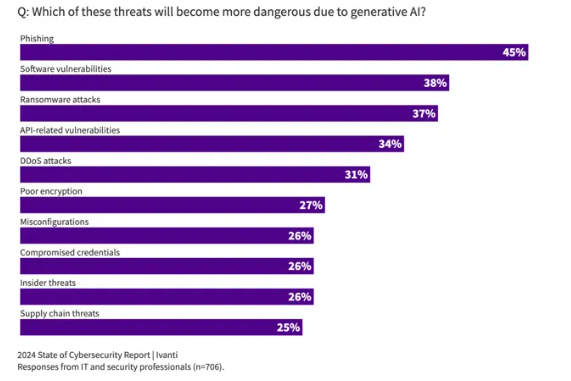

El Informe sobre el estado de la ciberseguridad de 2024 de Ivanti encontró que el 74% de las empresas encuestadas han visto evidencia de amenazas de IA. Una abrumadora mayoría (89%) cree que la amenaza de la IA apenas comienza. De la mayoría de los CISO, CIO y líderes de TI entrevistados por Ivanti, al 60 % le preocupaba que sus organizaciones no estuvieran preparadas para defenderse de las amenazas y ataques de la IA. El uso de deepfakes como parte de estrategias orquestadas que incluyen phishing, exploits de software, ransomware y vulnerabilidades relacionadas con API se está volviendo cada vez más común. Esto es consistente con las amenazas que los profesionales de la seguridad esperan que se vuelvan más peligrosas debido a la nueva generación de inteligencia artificial.

Ante el rápido desarrollo de la tecnología de falsificación profunda y los enormes riesgos que conlleva, las empresas deben tomar contramedidas activamente, fortalecer la protección de la seguridad y mejorar la conciencia de los riesgos de los empleados para reducir eficazmente las pérdidas y garantizar su propia seguridad. El avance de la tecnología también debe desarrollarse simultáneamente con la mejora de las medidas de seguridad para evitar que se abuse de la tecnología.