Meta publicó recientemente seis importantes resultados de investigación de IA, que cubren múltiples campos, como modelos multimodales, música generada por texto, tecnología de marcas de agua de audio y conjuntos de datos, lo que demuestra su innovación continua y su fortaleza técnica en el campo de la inteligencia artificial. Los resultados de esta investigación no solo brindan nuevas posibilidades para aplicaciones en el campo de la IA, sino que también brindan una referencia valiosa para futuras direcciones de desarrollo tecnológico. Estos impresionantes resultados de investigación se describen en detalle a continuación.

Recientemente, Meta publicó silenciosamente seis resultados de investigación, aportando nuevas aplicaciones y avances tecnológicos al campo de la IA. Estos incluyen modelos multimodales, modelos de música generados por texto, tecnología de marcas de agua de audio, conjuntos de datos y otros proyectos. Echemos un vistazo a los resultados específicos de estos estudios.

Meta Chameleon (modelo "Camaleón")

En primer lugar, el modelo multimodal lanzado "Chameleon" puede procesar texto e imágenes al mismo tiempo, admite texto de entrada y salida mixto y proporciona una nueva solución para procesar datos multimodales.

Si bien la mayoría de los modelos de fusión de última etapa actuales utilizan el aprendizaje basado en difusión, Meta Chameleon utiliza tokenización para texto e imágenes. Esto permite un enfoque más unificado y hace que los modelos sean más fáciles de diseñar, mantener y ampliar.

Ejemplos de vídeo: genere títulos creativos a partir de imágenes o utilice una combinación de indicaciones de texto e imágenes para crear una escena completamente nueva.

Meta ahora lanzará públicamente componentes clave de los modelos Chameleon7B y 34B bajo una licencia de investigación. Su modelo lanzado actualmente está optimizado para la seguridad, admite entrada en modo mixto y salida de texto sin formato, y puede usarse con fines de investigación. El funcionario enfatizó que el modelo de generación de imágenes Chameleon no será lanzado.

Entrada del producto: https://top.aibase.com/tool/meta-chameleon

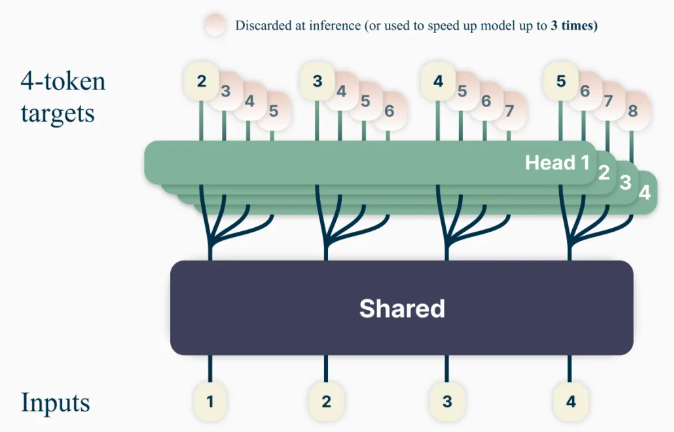

Predicción de múltiples tokens

El nuevo método de entrenamiento del modelo de lenguaje "Predicción de múltiples tokens" tiene como objetivo mejorar las capacidades del modelo y la eficiencia del entrenamiento. Entrena el modelo para predecir varias palabras a la vez, mejorando la precisión de la predicción del modelo.

Con este enfoque, se pueden entrenar modelos de lenguaje para predecir múltiples palabras futuras simultáneamente, en lugar del método anterior de predecir una palabra a la vez. Esto mejora las capacidades del modelo y la eficiencia del entrenamiento al tiempo que aumenta la velocidad. En el espíritu de la ciencia abierta responsable, se lanzarán modelos previamente entrenados para completar el código bajo una licencia no comercial/solo de investigación.

Entrada del producto: https://top.aibase.com/tool/multi-token-prediction

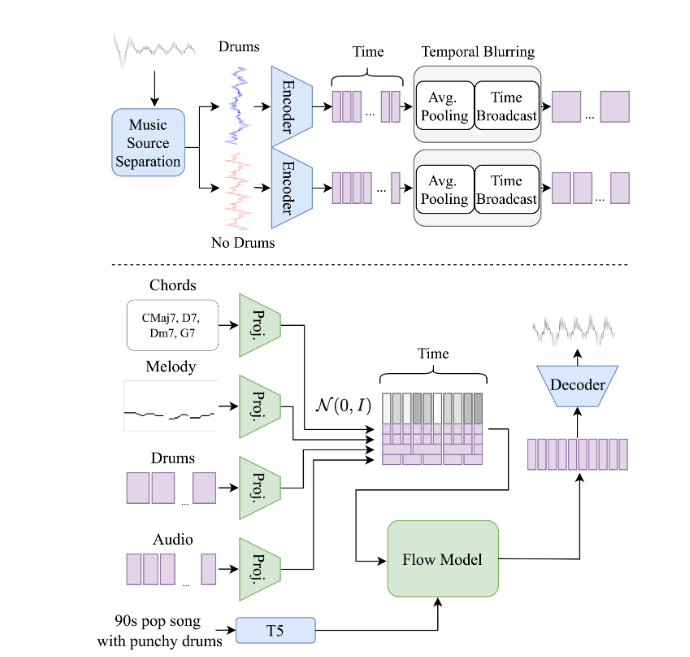

Modelo musical de generación de texto "JASCO"

Mientras que los modelos existentes de conversión de texto a música, como MusicGen, se basan principalmente en la entrada de texto para generar música, el nuevo modelo de Meta, Meta-Joint Audio and Symbol Conditioning for Temporally Controlled Text-to-Music Generation (JASCO), es capaz de aceptar una variedad de de condiciones Entradas, como acordes o tiempos específicos, para mejorar el control sobre la salida musical resultante. Específicamente, se puede utilizar una capa de cuello de botella de información junto con la falta de definición temporal para extraer información relevante para controles específicos. Esto permite combinar condiciones simbólicas y de audio simultáneamente en el mismo modelo generativo de texto a música.

JASCO es comparable a la línea base de evaluación en términos de calidad de generación y al mismo tiempo permite un control mejor y más flexible sobre la música generada. Los funcionarios publicarán artículos de investigación y páginas de ejemplo y, a finales de este mes, el código de inferencia se publicará como parte del repositorio de AudioCraft bajo la licencia del MIT, y el modelo previamente entrenado se publicará bajo CC-BY-NC.

Entrada del código: https://top.aibase.com/tool/audiocraft

Tecnología de marca de agua de audio "AudioSeal"

Esta es la primera tecnología de marca de agua de audio diseñada específicamente para la detección local de voz generada por IA, lo que permite una localización precisa de segmentos generados por IA dentro de clips de audio más largos. AudioSeal mejora las marcas de agua de audio tradicionales al centrarse en detectar contenido generado por IA en lugar de esteganografía.

A diferencia de los métodos tradicionales que se basan en complejos algoritmos de decodificación, el enfoque de detección local de AudioSeal permite una detección más rápida y eficiente. Este diseño mejora la velocidad de detección 485 veces en comparación con los métodos anteriores, lo que lo hace ideal para aplicaciones a gran escala y en tiempo real. Nuestro método logra un rendimiento de última generación en términos de robustez e imperceptibilidad de las marcas de agua de audio.

AudioSeal se lanza bajo una licencia comercial.

Entrada del producto: https://top.aibase.com/tool/audioseal

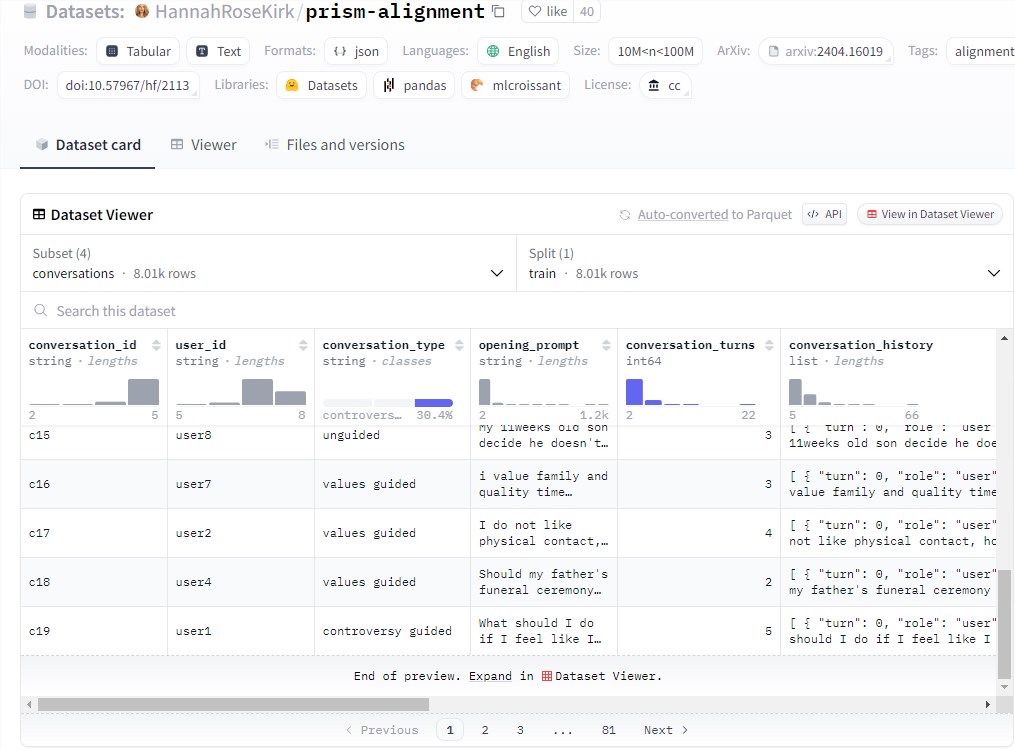

conjunto de datos PRISMA

Al mismo tiempo, Meta también publicó el conjunto de datos PRISM en cooperación con socios externos, que contiene los datos de diálogo y las preferencias de 1.500 participantes en todo el mundo y se utiliza para mejorar modelos lingüísticos a gran escala, mejorando así la diversidad y preferencia del diálogo. Diversidad y beneficios sociales del modelo.

Este conjunto de datos mapea las preferencias de cada persona y los comentarios detallados en 8.011 conversaciones en tiempo real con 21 LLM diferentes.

Entrada del conjunto de datos: https://huggingface.co/datasets/HannahRoseKirk/prism-alignment

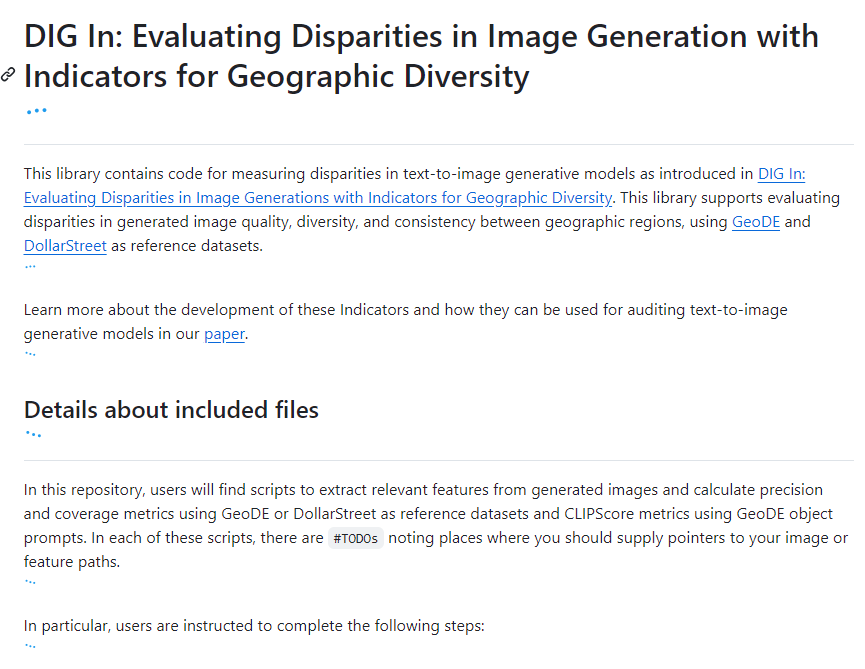

Indicador de “DIG In”

Se utiliza para evaluar diferencias geográficas en modelos de imágenes de generación de texto, proporcionando más datos de referencia para mejorar el modelo. Para comprender cómo las personas en diferentes regiones ven la representación geográfica de manera diferente, Meta llevó a cabo un estudio de anotaciones a gran escala. Recopilamos más de 65.000 anotaciones y más de 20 respuestas a encuestas para cada ejemplo, que cubren atractivo, similitud, coherencia y recomendaciones compartidas para mejorar la evaluación automática y humana de los modelos de texto a imagen.

Entrada del código: https://top.aibase.com/tool/dig-in

El lanzamiento de estos proyectos ha traído nuevos avances tecnológicos y perspectivas de aplicación al campo de la IA, y es de gran importancia para promover el desarrollo y la aplicación de la tecnología de IA.

En total, los seis resultados de la investigación de IA publicados por Meta esta vez demuestran su tecnología líder y su diseño con visión de futuro en multimodalidad, generación de texto, procesamiento de audio y construcción de conjuntos de datos. Los avances en estas tecnologías promoverán un mayor desarrollo en el campo de la IA y brindarán más posibilidades para aplicaciones futuras.