La inteligencia artificial ha logrado grandes avances en el procesamiento multimodal, pero los modelos de alto rendimiento a menudo requieren enormes recursos informáticos, lo que limita su aplicación en dispositivos periféricos. En respuesta a este desafío, OpenBMB lanzó MiniCPM-o2.6, un modelo multimodal eficiente, cuyo objetivo es cerrar la brecha entre la tecnología avanzada de IA y los dispositivos con recursos limitados. MiniCPM-o2.6 tiene 8 mil millones de parámetros, integra módulos de procesamiento de visión, voz y lenguaje, y está optimizado para funcionar sin problemas en dispositivos como teléfonos inteligentes y tabletas, brindando a los desarrolladores y empresas una forma más conveniente de implementación de soluciones de IA.

La tecnología de inteligencia artificial ha logrado avances significativos en los últimos años, pero persisten desafíos entre la eficiencia computacional y la versatilidad. Muchos modelos multimodales avanzados, como GPT-4, generalmente requieren grandes cantidades de recursos informáticos, lo que limita su uso en servidores de alta gama, lo que dificulta que las tecnologías inteligentes se utilicen de manera efectiva en dispositivos de vanguardia como teléfonos inteligentes y tabletas. Además, todavía existen barreras técnicas para procesar tareas como el análisis de vídeo o la conversión de voz a texto en tiempo real, lo que destaca la necesidad de modelos de IA eficientes y flexibles que puedan funcionar sin problemas en condiciones de hardware limitadas.

Para resolver estos problemas, OpenBMB lanzó recientemente MiniCPM-o2.6, un modelo con una arquitectura de 8 mil millones de parámetros diseñada para admitir el procesamiento de visión, voz y lenguaje, y que puede ejecutarse de manera eficiente en dispositivos periféricos como teléfonos inteligentes, tabletas y iPads. MiniCPM-o2.6 adopta un diseño modular e integra múltiples componentes potentes:

- SigLip-400M para comprensión visual.

- Whisper-300M implementa procesamiento de voz en varios idiomas.

- ChatTTS-200M proporciona capacidades conversacionales.

- Qwen2.5-7B para comprensión avanzada de textos.

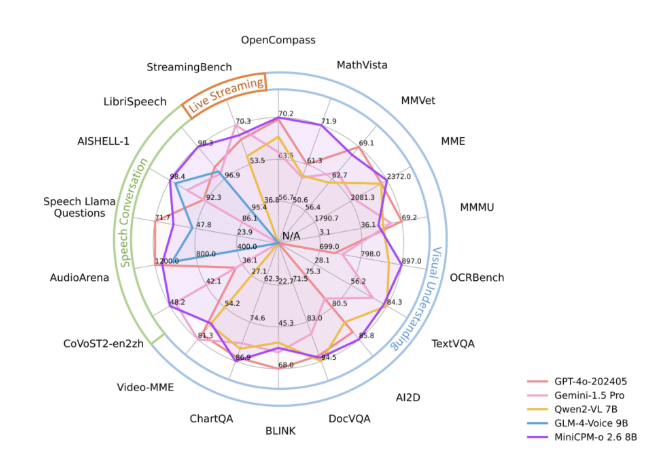

El modelo logró una puntuación media de 70,2 en el punto de referencia OpenCompass, superando al GPT-4V en tareas visuales. Su compatibilidad con varios idiomas y su funcionamiento eficiente en dispositivos de consumo lo hacen práctico en una variedad de escenarios de aplicaciones.

MiniCPM-o2.6 logra un rendimiento potente a través de los siguientes detalles técnicos:

- Optimización de parámetros: a pesar de su gran tamaño, se optimiza mediante frameworks como llama.cpp y vLLM para mantener la precisión y reducir los requisitos de recursos.

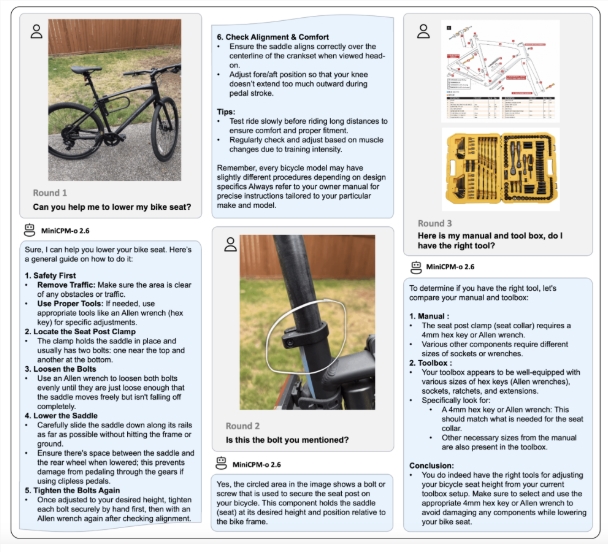

- Procesamiento multimodal: admite procesamiento de imágenes con una resolución de hasta 1344×1344 y tiene función OCR para un rendimiento excelente.

- Soporte de transmisión de medios: admite procesamiento continuo de video y audio, lo que lo hace aplicable a escenarios de monitoreo en tiempo real y transmisión en vivo.

- Funciones de voz: proporciona comprensión del habla bilingüe, clonación de voz y control de emociones para promover una interacción natural en tiempo real.

- Fácil de integrar: Compatible con plataformas como Gradio, simplificando el proceso de implementación y adecuado para aplicaciones comerciales con menos de un millón de usuarios activos diarios.

Estas características hacen de MiniCPM-o2.6 una oportunidad para que los desarrolladores y las empresas implementen soluciones complejas de IA sin depender de una enorme infraestructura.

MiniCPM-o2.6 funciona bien en varios campos. Supera al GPT-4V en tareas visuales, realiza diálogos en chino e inglés en tiempo real, control de emociones y clonación de voz en términos de procesamiento del habla, y tiene excelentes capacidades de interacción del lenguaje natural. Al mismo tiempo, el procesamiento continuo de vídeo y audio lo hace adecuado para la traducción en tiempo real y herramientas de aprendizaje interactivo, lo que garantiza una alta precisión en tareas de OCR como la digitalización de documentos.

El lanzamiento de MiniCPM-o2.6 representa un avance importante en la tecnología de inteligencia artificial, ya que resuelve con éxito el desafío de larga data entre los modelos que consumen muchos recursos y la compatibilidad de los dispositivos de borde. Al combinar capacidades multimodales avanzadas con operaciones eficientes de dispositivos perimetrales, OpenBMB crea un modelo potente y accesible. A medida que la inteligencia artificial se vuelve cada vez más importante en la vida diaria, MiniCPM-o2.6 demuestra cómo la innovación puede reducir la brecha entre rendimiento y practicidad, haciendo posible que los desarrolladores y usuarios de diversas industrias utilicen de manera efectiva tecnologías de vanguardia.

Modelo: https://huggingface.co/openbmb/MiniCPM-o-2_6

Destacar:

MiniCPM-o2.6 es un modelo multimodal con 8 mil millones de parámetros que puede ejecutarse de manera eficiente en dispositivos periféricos y admite el procesamiento de visión, voz y lenguaje.

El modelo tuvo un buen desempeño en el punto de referencia OpenCompass, superó al GPT-4V en tareas visuales y tiene capacidades de procesamiento en varios idiomas.

MiniCPM-o2.6 tiene funciones como procesamiento en tiempo real, clonación de voz y control de emociones, y es adecuado para aplicaciones innovadoras en la educación, la medicina y otras industrias.

En definitiva, la aparición de MiniCPM-o2.6 marca un gran avance en la aplicación de la tecnología de IA. Combina con éxito potentes capacidades multimodales con los requisitos de bajo consumo de recursos de los dispositivos de vanguardia, allanando el camino para la aplicación generalizada de la IA. Tiene un valor de aplicación y perspectivas de desarrollo extremadamente altos.