Anglais | 中文 | 日本語

Ensemble de données | Référence | ? Modèles | ? Papier

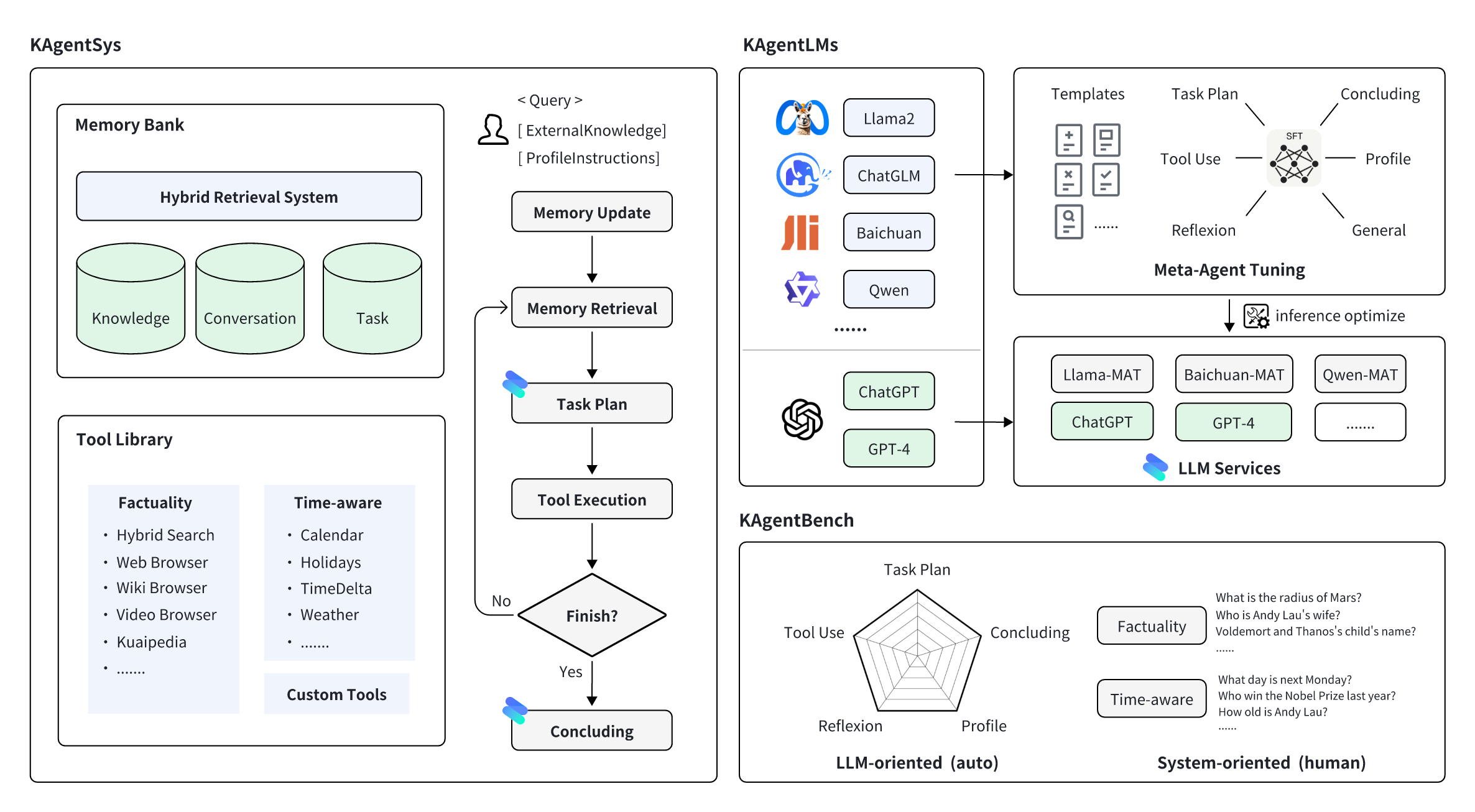

KwaiAgents est une série d'ouvrages open source liés aux agents par KwaiKEG de Kuaishou Technology. Le contenu open source comprend :

| Taper | Modèles | Données de formation | Données de référence |

| Qwen | Qwen-7B-MAT Qwen-14B-MAT Qwen-7B-MAT-cpp Qwen1.5-14B-MAT | KAgentInstruct | KAgentBench |

| Baichuan | Baichuan2-13B-MAT |

| Échelle | Planification | Utilisation des outils | Réflexion | Final | Profil | Note globale | |

|---|---|---|---|---|---|---|---|

| GPT-3.5-turbo | - | 18h55 | 26.26 | 8.06 | 37.26 | 35.42 | 25.63 |

| Lama2 | 13B | 0,15 | 0,44 | 0,14 | 16h60 | 17.73 | 17h30 |

| ChatGLM3 | 6B | 7,87 | 11.84 | 7.52 | 30.01 | 30.14 | 15.88 |

| Qwen | 7B | 13.34 | 18h00 | 7.91 | 36.24 | 34,99 | 21.17 |

| Baichuan2 | 13B | 6h70 | 16h10 | 6,76 | 24,97 | 19.08 | 14.89 |

| OutilLlama | 7B | 0,20 | 4,83 | 1.06 | 15.62 | 10.66 | 6.04 |

| AgentLM | 13B | 0,17 | 0,15 | 0,05 | 16h30 | 15.22 | 4,88 |

| Qwen-MAT | 7B | 31.64 | 43h30 | 33.34 | 44,85 | 44,78 | 39,85 |

| Baichuan2-MAT | 13B | 37.27 | 52,97 | 37h00 | 48.01 | 41,83 | 45.34 |

| Qwen-MAT | 14B | 43.17 | 63,78 | 32.14 | 45.47 | 45.22 | 49,94 |

| Qwen1.5-MAT | 14B | 42.42 | 64,62 | 30.58 | 46.51 | 45,95 | 50.18 |

| Échelle | Aucun agent | Réagir | GPT automatique | KAgentSys | |

|---|---|---|---|---|---|

| GPT-4 | - | 57,21% (3,42) | 68,66% (3,88) | 79,60% (4,27) | 83,58% (4,47) |

| GPT-3.5-turbo | - | 47,26% (3,08) | 54,23% (3,33) | 61,74% (3,53) | 64,18% (3,69) |

| Qwen | 7B | 52,74% (3,23) | 51,74% (3,20) | 50,25% (3,11) | 54,23% (3,27) |

| Baichuan2 | 13B | 54,23% (3,31) | 55,72% (3,36) | 57,21% (3,37) | 58,71% (3,54) |

| Qwen-MAT | 7B | - | 58,71% (3,53) | 65,67% (3,77) | 67,66% (3,87) |

| Baichuan2-MAT | 13B | - | 61,19% (3,60) | 66,67% (3,86) | 74,13% (4,11) |

Installez d'abord miniconda pour l'environnement de construction. Créez ensuite d'abord build env :

conda create -n kagent python=3.10

conda activate kagent

pip install -r requirements.txtNous vous recommandons d'utiliser vLLM et FastChat pour déployer le service d'inférence de modèle. Tout d'abord, vous devez installer les packages correspondants (pour une utilisation détaillée, veuillez vous référer à la documentation des deux projets) :

pip install vllm

pip install " fschat[model_worker,webui] "pip install " fschat[model_worker,webui] "

pip install vllm==0.2.0

pip install transformers==4.33.2Pour déployer des KAgentLM, vous devez d'abord démarrer le contrôleur dans un terminal.

python -m fastchat.serve.controllerDeuxièmement, vous devez utiliser la commande suivante dans un autre terminal pour le déploiement du service d'inférence sur un seul GPU :

python -m fastchat.serve.vllm_worker --model-path $model_path --trust-remote-code Où $model_path est le chemin local du modèle téléchargé. Si le GPU ne prend pas en charge Bfloat16, vous pouvez ajouter --dtype half à la ligne de commande.

Troisièmement, démarrez le serveur API REST dans le troisième terminal.

python -m fastchat.serve.openai_api_server --host localhost --port 8888Enfin, vous pouvez utiliser la commande curl pour appeler le modèle de la même manière que le format d'appel OpenAI. Voici un exemple :

curl http://localhost:8888/v1/chat/completions

-H " Content-Type: application/json "

-d ' {"model": "kagentlms_qwen_7b_mat", "messages": [{"role": "user", "content": "Who is Andy Lau"}]} ' Ici, remplacez kagentlms_qwen_7b_mat par le modèle que vous avez déployé.

llama-cpp-python propose un serveur Web qui vise à remplacer l'API OpenAI. Cela vous permet d'utiliser des modèles compatibles llama.cpp avec n'importe quel client compatible OpenAI (bibliothèques de langues, services, etc.). Le modèle converti peut être trouvé dans kwaikeg/kagentlms_qwen_7b_mat_gguf.

Pour installer le package serveur et commencer :

pip install " llama-cpp-python[server] "

python3 -m llama_cpp.server --model kagentlms_qwen_7b_mat_gguf/ggml-model-q4_0.gguf --chat_format chatml --port 8888Enfin, vous pouvez utiliser la commande curl pour appeler le modèle de la même manière que le format d'appel OpenAI. Voici un exemple :

curl http://localhost:8888/v1/chat/completions

-H " Content-Type: application/json "

-d ' {"messages": [{"role": "user", "content": "Who is Andy Lau"}]} 'Téléchargez et installez les KwaiAgents, recommandé Python>=3.10

git clone [email protected]:KwaiKEG/KwaiAgents.git

cd KwaiAgents

python setup.py develop export OPENAI_API_KEY=sk-xxxxx

export WEATHER_API_KEY=xxxxxx

Le WEATHER_API_KEY n'est pas obligatoire, mais vous devez le configurer lorsque vous posez des questions liées à la météo. Vous pouvez obtenir la clé API sur ce site Web (idem pour l'utilisation du modèle local).

kagentsys --query= " Who is Andy Lau's wife? " --llm_name= " gpt-3.5-turbo " --lang= " en "Pour utiliser un modèle local, vous devez déployer le service de modèle correspondant comme décrit dans le chapitre précédent

kagentsys --query= " Who is Andy Lau's wife? " --llm_name= " kagentlms_qwen_7b_mat "

--use_local_llm --local_llm_host= " localhost " --local_llm_port=8888 --lang= " en "Arguments de commande complets :

options:

-h, --help show this help message and exit

--id ID ID of this conversation

--query QUERY User query

--history HISTORY History of conversation

--llm_name LLM_NAME the name of llm

--use_local_llm Whether to use local llm

--local_llm_host LOCAL_LLM_HOST

The host of local llm service

--local_llm_port LOCAL_LLM_PORT

The port of local llm service

--tool_names TOOL_NAMES

the name of llm

--max_iter_num MAX_ITER_NUM

the number of iteration of agents

--agent_name AGENT_NAME

The agent name

--agent_bio AGENT_BIO

The agent bio, a short description

--agent_instructions AGENT_INSTRUCTIONS

The instructions of how agent thinking, acting, or talking

--external_knowledge EXTERNAL_KNOWLEDGE

The link of external knowledge

--lang {en,zh} The language of the overall system

--max_tokens_num Maximum length of model input

Note :

browse_website , vous devez configurer le pilote Chrome sur votre serveur.http_proxy . L'utilisation des outils personnalisés peut être trouvée dans examples/custom_tool_example.py

Nous n'avons besoin que de deux lignes pour évaluer les capacités de l'agent telles que :

cd benchmark

python infer_qwen.py qwen_benchmark_res.jsonl

python benchmark_eval.py ./benchmark_eval.jsonl ./qwen_benchmark_res.jsonlLa commande ci-dessus donnera les résultats comme

plan : 31.64, tooluse : 43.30, reflextion : 33.34, conclusion : 44.85, profile : 44.78, overall : 39.85

Veuillez vous référer à benchmark/ pour plus de détails.

@article{pan2023kwaiagents,

author = {Haojie Pan and

Zepeng Zhai and

Hao Yuan and

Yaojia Lv and

Ruiji Fu and

Ming Liu and

Zhongyuan Wang and

Bing Qin

},

title = {KwaiAgents: Generalized Information-seeking Agent System with Large Language Models},

journal = {CoRR},

volume = {abs/2312.04889},

year = {2023}

}