Code pour notre article : Stellar : Évaluation systématique des méthodes de conversion texte-image personnalisées centrées sur l'humain

Auteurs : Panos Achlioptas, Alexandros Benetatos, Iordanis Fostiropoulos, Dimitris Skourtis

La base de code est maintenue par Iordanis Fostiropoulos. Pour toute question, veuillez nous contacter.

Avant de télécharger ou d'utiliser une partie du code de ce référentiel, veuillez lire et accepter les termes et conditions énoncés dans les « Conditions de licence » et les « Conditions de licence tierces » incluses dans ce référentiel. Continuer à télécharger et à utiliser n'importe quelle partie du code dans ce référentiel confirme que vous acceptez ces termes et conditions.

Remarque : « Image d'entrée » et « Image supplémentaire » affichées se trouvent dans l'ensemble de données CELEBMaksHQ.

Remarque : « Image d'entrée » et « Image supplémentaire » affichées se trouvent dans l'ensemble de données CELEBMaksHQ.

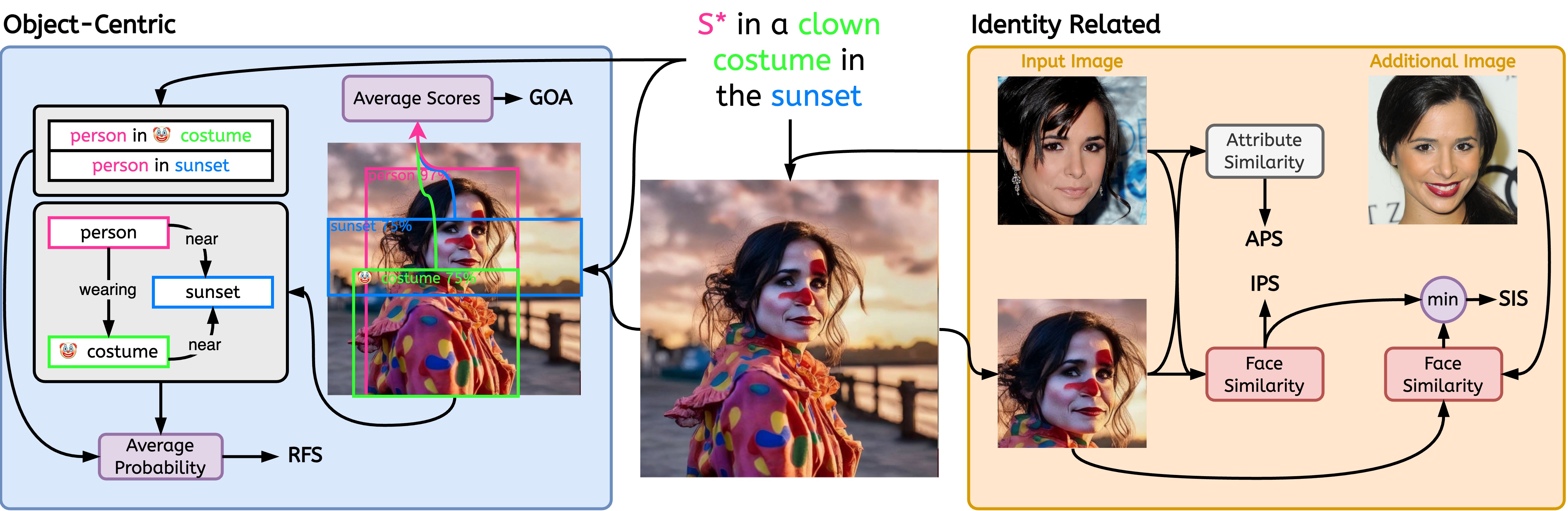

Ce travail est basé sur notre manuscrit technique Stellar : Systematic Evaluation of Human-Centric Personalized Text-to-Image Methods. Nous avons proposé 5 métriques pour évaluer les modèles Text-2-Image de personnalisation centrée sur l'humain. Le référentiel fournit la mise en œuvre de 8 métriques de base supplémentaires pour les méthodes Text-2-Image et Image-2-Image.

Il existe plusieurs mesures fournies par la littérature. Nous désignons par ceux qui sont introduits par notre travail.

Nous fournissons notre propre implémentation des métriques existantes et renvoyons l'utilisateur à son article pour les détails techniques de son travail.

| Nom | Type d'évaluation | Nom de code | Référence |

|---|---|---|---|

| Esth. | Image2Image | aesth | Lien |

| Image2Image | clip | Lien | |

| RêveSim | Image2Image | dreamsim | Lien |

| Texte2Image | clip | Lien | |

| HPSv1 | Texte2Image | hps | Lien |

| HPSv2 | Texte2Image | hps | Lien |

| ImageRécompense | Texte2Image | im_reward | Lien |

| ChoisirScore | Texte2Image | pick | Lien |

| APS | Text2Image personnalisé | aps | Lien |

| GoA | Centré sur les objets | goa | Lien |

| IPS | Text2Image personnalisé | ips | Lien |

| Centré sur la relation | rfs | Lien | |

| SIS | Text2Image personnalisé | sis | Lien |

pip install git+https://github.com/stellar-gen-ai/stellar-metrics.gitNous voulons calculer la métrique pour chaque image individuelle. A ce titre, il peut aider à diagnostiquer les cas d’échec d’une méthode.

$ python -m stellar_metrics --metric code_name --stellar-path ./stellar-dataset --syn-path ./model-output --save-dir ./save-dir Facultatif, vous pouvez spécifier --device , --batch-size et --clip-version pour le backbone

REMARQUE, il doit y avoir une correspondance biunivoque entre la sortie du modèle et l'ensemble de données stellaires. L' stellar-dataset est utilisé pour calculer certaines mesures, telles que la préservation de l'identité lorsque l'image originale est requise. Une mauvaise configuration entre syn-path et stellar-path peut conduire à des résultats incorrects.

Calculer l'IPS

$ python -m stellar_metrics --metric ips --stellar-path ./tests/assets/mock_stellar_dataset --syn-path ./tests/assets/stellar_net --save-dir ./save-dirCalculer CLIP

$ python -m stellar_metrics --metric clip --stellar-path ./tests/assets/mock_stellar_dataset --syn-path ./tests/assets/stellar_net --save-dir ./save-dir$ python -m stellar_metrics.analysis --save-dir ./save-dirÉvaluez la ressemblance faciale entre l'identité d'entrée et les images générées d'une manière plutôt grossière mais spécialisée. Notre métrique utilise un détecteur de visage pour isoler le visage de l'identité dans les images d'entrée et générées. Il utilise ensuite un modèle de détection de visage spécialisé pour extraire les représentations faciales intégrées des régions détectées.

Évaluez dans quelle mesure les images générées conservent des attributs spécifiques et précis de l'identité en question, tels que l'âge, le sexe et d'autres caractéristiques faciales invariantes (par exemple, ~ pommettes saillantes). En tirant parti des annotations des images Stellar, nous pouvons évaluer ces caractéristiques faciales binaires.

Sert de mesure pour déterminer l’étendue de la sensibilité d’un modèle à différentes images du même individu ; promouvoir davantage les modèles dans lesquels l'identité du sujet est systématiquement bien capturée, quelles que soient les variations non pertinentes de l'image d'entrée (par exemple, les conditions d'éclairage, la pose du sujet).

Pour atteindre cet objectif, SIS nécessite d'avoir accès à plusieurs images du sujet humain (une condition remplie par la conception de l'ensemble de données de Stellar) ; et c'est notre seule mesure d'évaluation avec une exigence aussi plus exigeante.

Nous introduisons des métriques spécialisées et interprétables pour évaluer deux aspects clés de l'alignement entre l'image et l'invite : la fidélité de la représentation des objets et la fidélité des relations représentées.

Évaluez le succès de la représentation des interactions-objets rapides souhaitées sur l'image générée. Compte tenu de la difficulté même des modèles spécialisés de génération de graphiques de scène (SGG) à comprendre les relations visuelles, cette métrique introduit un aperçu localisé précieux de la capacité du modèle personnalisé à représenter fidèlement les relations suggérées.