Il s'agit d'un assistant vocal AI basé sur de grands modèles de langage. Un utilisateur peut interagir avec l'assistant vocal en langage naturel, actuellement l'anglais.

La mise en œuvre rassemble différents modèles d’apprentissage profond :

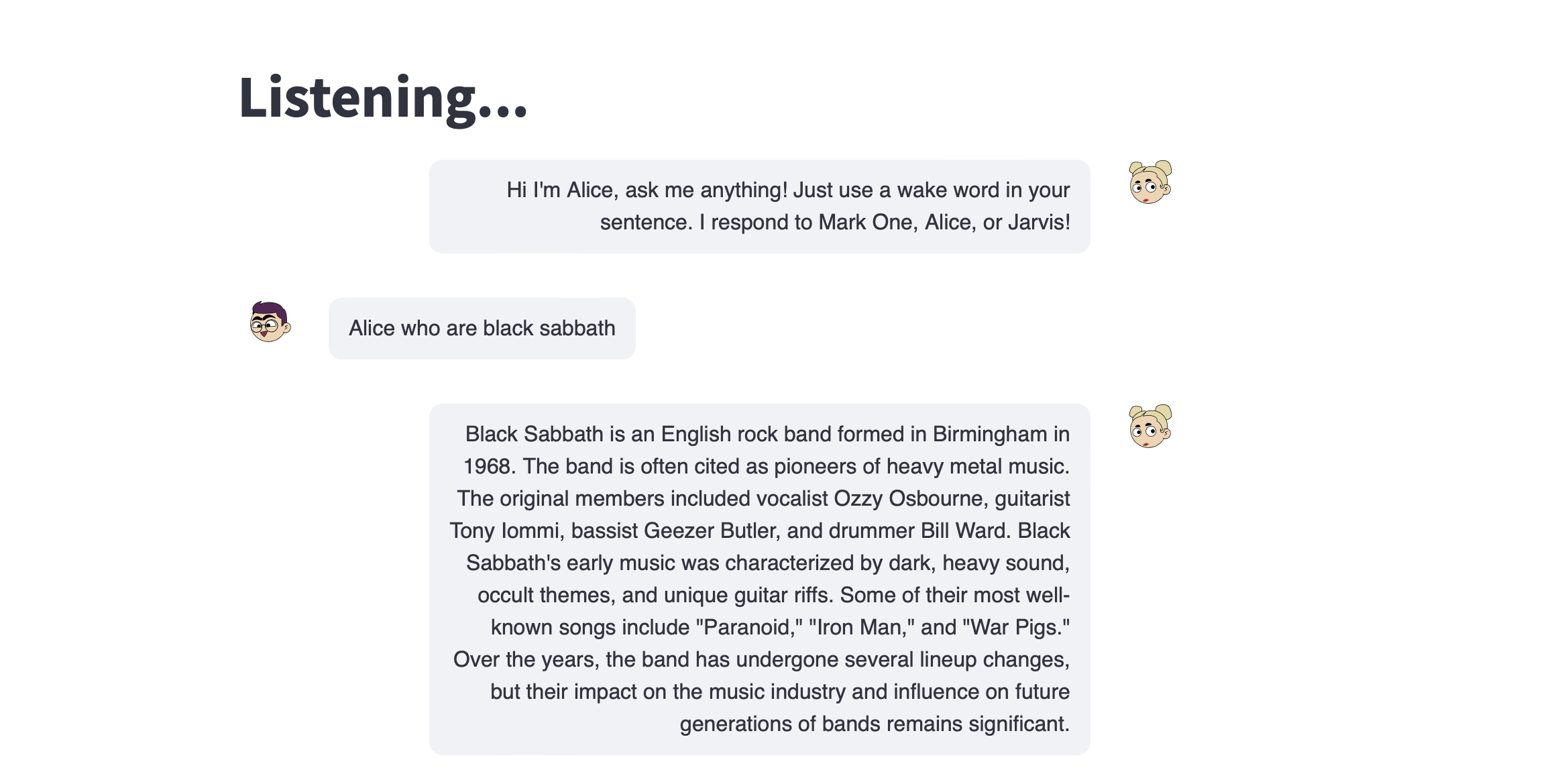

Le module vocal est interfacé avec le microphone local pour créer une transcription en direct via un processus VAD. Une transcription est envoyée au LLM choisi pour un traitement basé sur les mots d'éveil.

Une fois que le LLM génère une réponse, le module vocal enregistre également le fichier audio et génère une sortie vocale à l'aide d'un modèle TTS.

L'interface utilisateur est construite à l'aide de Streamlit et offre une expérience familière de type Chat.

Installer les dépendances du projet

pip install -r requirements

Si vous utilisez des modèles GPT, créez un fichier .env avec des variables d'environnement pour OPENAI_API_KEY et OPENAI_API_BASE .