Ajout d'un autre détecteur de visage alternatif : https://github.com/1adrianb/face-alignment

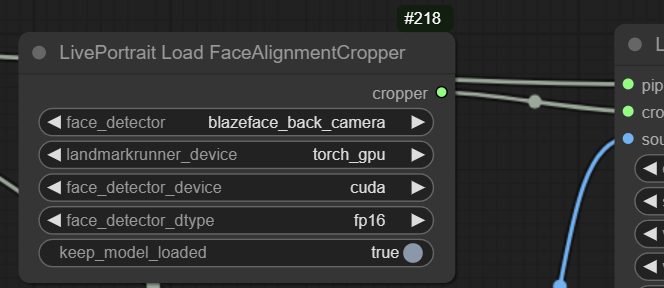

Comme cela peut utiliser le modèle de caméra arrière Blazeface (ou SFD), c'est bien mieux pour les visages plus petits que MediaPipe, qui ne peut utiliser que le modèle court Blazeface. L'échauffement lors de la première utilisation peut prendre beaucoup de temps, mais les analyses suivantes sont rapides.

Exemple de détection à l'aide de blazeface_back_camera :

La refonte de presque tout ce qui était en développement est maintenant fusionnée dans le principal, cela signifie que les anciens flux de travail ne fonctionneront pas, mais tout devrait être plus rapide et il y a beaucoup de nouvelles fonctionnalités. À des fins d'héritage, l'ancienne branche principale est déplacée vers l'ancienne branche

Changements

Ajout de MediaPipe comme alternative à Insightface, tout devrait désormais être couvert sous les licences MIT et Apache-2.0 lors de son utilisation.

Vid2vid approprié, y compris un algorithme de lissage (merci @melMass)

Vitesse et efficacité améliorées, permettant une visualisation en temps quasi réel, même dans Comfy (délai d'environ 80 à 100 ms)

Nœuds restructurés pour plus d'options

Images sautées automatiquement sans détection de visage

Beaucoup d'autres choses que j'ai oubliées à ce stade, ça fait beaucoup

Meilleur support Mac sur MPS (merci @Grant-CP

mise à jour vers cette mise à jour :

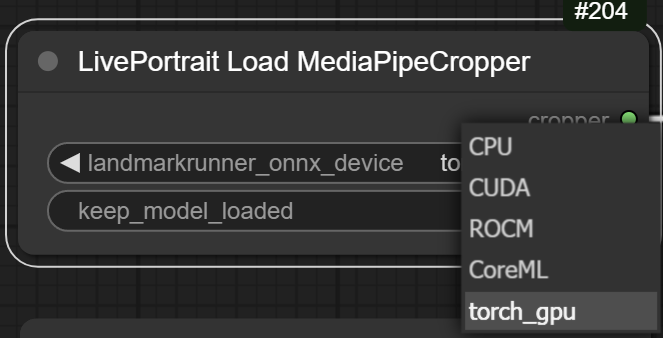

j'ai converti le modèle onnx du coureur historique en modèle torch, ce n'est pas quelque chose que j'ai fait auparavant et je n'ai pas réussi à faire autre chose que d'en faire un fichier .pth, vous n'aurez donc qu'à me faire confiance là-dessus. Cela permet d'exécuter tout cela sans même avoir onnxruntime, il fonctionne sur GPU et est à peu près aussi rapide. Il est disponible en option sur le nœud de recadrage MediaPipe : lorsqu'il est sélectionné, il est automatiquement téléchargé à partir d'ici : https://huggingface.co/Kijai/LivePortrait_safetensors/blob/main/landmark_model.pth

En temps réel avec flux webcam :

Image2vid :

Vid2Vid :

J'ai converti tous les fichiers pickle en safetensors : https://huggingface.co/Kijai/LivePortrait_safetensors/tree/main

Ils vont ici (et sont automatiquement téléchargés si le dossier n'est pas présent) ComfyUI/models/liveportrait

Vous pouvez soit utiliser l'Insightface par défaut d'origine, soit le MediaPipe de Google.

La plus grande différence réside dans la licence : Insightface est strictement destiné à une utilisation NON COMMERCIALE. MediaPipe est un peu moins bon en termes de détection et ne peut pas fonctionner sur GPU sous Windows, bien qu'il soit beaucoup plus rapide sur le CPU par rapport à Insightface

Insightface n'est pas automatiquement installé. Si vous souhaitez l'utiliser, suivez ces instructions : Si vous disposez d'un environnement de compilation fonctionnel, son installation peut être aussi simple que :

pip install insightface

ou pour la version portable, dans le dossier ComfyUI_windows_portable :

python_embeded/python.exe -m pip install insightface

Si cela échoue (et c'est probable), vous pouvez consulter la partie Dépannage du nœud du réacteur pour une alternative :

https://github.com/Gourieff/comfyui-reactor-node

Pour le modèle insightface, extrayez ceci dans ComfyUI/models/insightface/buffalo_l :

https://github.com/deepinsight/insightface/releases/download/v0.7/buffalo_l.zip

Veuillez noter que la licence Insightface est de nature non commerciale.