Cette action surveille les commentaires sur les problèmes et les demandes de traction, et rappeler à l'expéditeur si un langage offensant est trouvé.

Créez le fichier de workflow de travail suivant mind-your-language.yml dans le .github/workflows/ répertoire de votre référentiel:

name : Mind your language

on :

issues :

types :

- opened

- edited

issue_comment :

types :

- created

- edited

pull_request_review_comment :

types :

- created

- edited

jobs :

echo_issue_comment :

runs-on : ubuntu-latest

name : profanity check

steps :

- name : Checkout

uses : actions/checkout@v2

- name : Profanity check step

uses : tailaiw/[email protected]

env :

GITHUB_TOKEN : ${{ secrets.GITHUB_TOKEN }} Chaque fois qu'un commentaire sur un problème ou une demande de traction est créé, le flux de travail effectuera un contrôle de blasphème par rapport au texte du commentaire et prendra la réaction si un langage offensant est trouvé.

J'utilise actuellement Degnany Check, un package Python de détection de blasphèmes basé sur l'apprentissage automatique, pour déterminer si un commentaire est offensant ou non. Il n'est pas super puissant mais est sensible à un langage offensant évident. J'espère que je pourrai utiliser des algorithmes NLP de pointe pour obtenir de meilleures performances. Je vais créer un référentiel séparé pour poursuivre de meilleures alternatives bientôt. Si cela vous intéresse, restez à l'écoute.

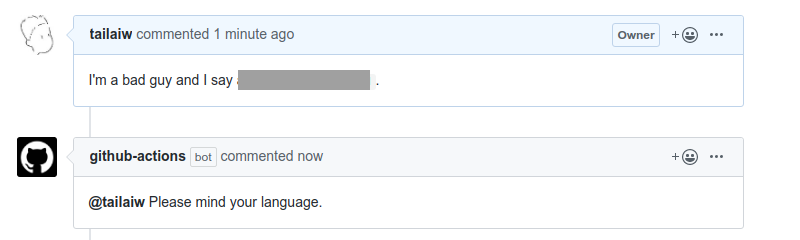

La réaction en ce moment est une réparation automatique par GitHub-Actions Bot qui mentionne l'expéditeur de commentaires offensifs. Voir l'exemple comme suivant.

Je suis un nouveau développeur de GitHub Action, donc la suggestion et l'aide sont plus que bienvenues. Bien sûr, "Attention à votre langue"?