Toutes les activités quotidiennes du monde humain sont reproduites à l'échelle 1:1 dans "Minecraft". Une civilisation composée de 100 milliards d’agents IA ressemble en réalité à ceci.

La première « civilisation intelligente de l’IA » au monde a enfin été révélée !

Il y a 2 mois, plus de 1 000 agents ont collaboré dans le monde virtuel pour construire leur propre économie, culture, religion et gouvernement...

Les internautes se sont exclamés en disant que cela pouvait être qualifié de version réelle du « monde occidental ».

Aujourd’hui, cette civilisation a encore évolué. À quoi ressemble le monde avec une civilisation de 100 milliards d’agents IA ?

Ils sont un individu et un groupe.

Toutes les activités de la vie quotidienne humaine seront reproduites à l'échelle 1:1 dans "Minecraft".

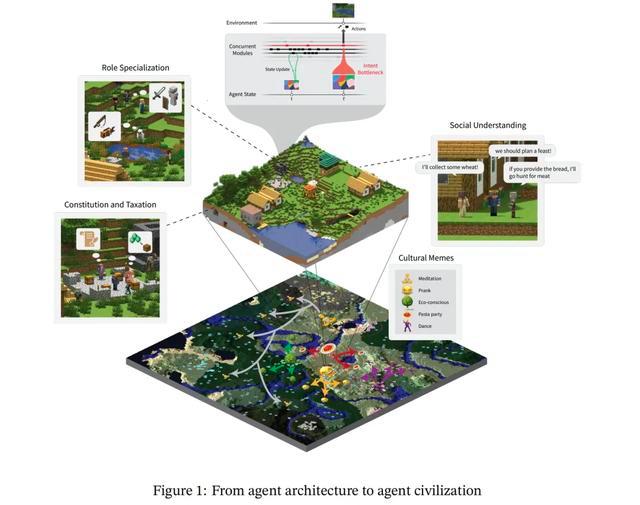

RoBERT Yang, ancien élève de l'Université de Pékin, a partagé les dernières recherches de l'équipe et a présenté pour la première fois la nouvelle « architecture cognitive » derrière PIANO.

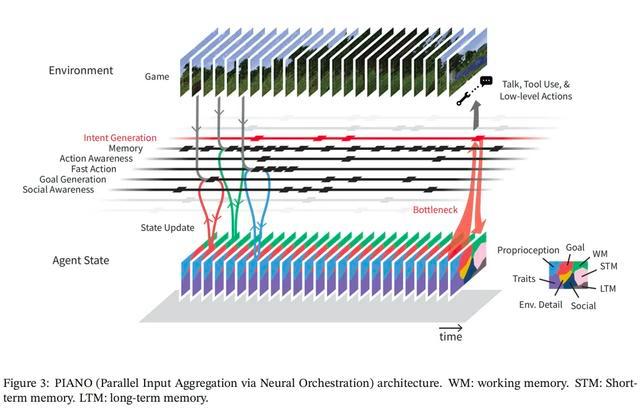

PIANO (Parallel Information Aggregation Neural Coordination) est une architecture qui permet aux agents d'IA d'interagir avec plusieurs parties tout en maintenant la cohérence dans plusieurs flux de sortie.

Adresse du projet : https://github.com/altera-al/project-sid

Comment un agent IA peut-il penser et agir simultanément, sur plusieurs échelles de temps, en opérant de manière à la fois consciente et subconsciente ?

Tout comme les touches d’un piano, elles représentent différents modules cérébraux. Lorsqu’ils sont joués ensemble, ils peuvent produire de magnifiques accords. Chez les agents intelligents, des qualités semblables à celles des humains sont également produites.

Ces agents intelligents construiront une « civilisation ». Fiscalité, commerce, gouvernement, pays, religion… toutes les activités quotidiennes du monde humain sont également incluses dans les agents IA.

De plus, les agents IA peuvent déduire avec précision les émotions des autres, nouer des amitiés et même se faire des ennemis. Certains agents introvertis, comme les humains sociophobes, ont moins de liens sociaux que les agents extravertis.

Certains internautes ont dit que nous vivons dans une matrice de simulation et que l’avenir, c’est maintenant.

Jetons ensuite un coup d’œil au « monde » des agents IA. Quelle est la situation globale ?

Pourquoi une civilisation intelligente par l’IA est-elle nécessaire ?

Pour que les agents d’IA coexistent avec les humains et s’intègrent dans notre société, ils doivent être non seulement autonomes mais également capables de collaborer.

Ces dernières années, les progrès des grands modèles linguistiques (LLM) pour le raisonnement et la prise de décision ont considérablement amélioré l'autonomie des agents.

Cependant, avoir simplement de l’autonomie ne suffit pas. Les agents doivent également coexister avec les humains et d’autres agents de la civilisation humaine.

Comme l’a dit l’auteur de l’article :

Mesurer le progrès civilisationnel par la capacité des agents à coexister et à faire progresser les civilisations non humaines représente la référence ultime pour les capacités des agents d’intelligence artificielle.

Mais bâtir une civilisation de l’IA n’est pas chose facile.

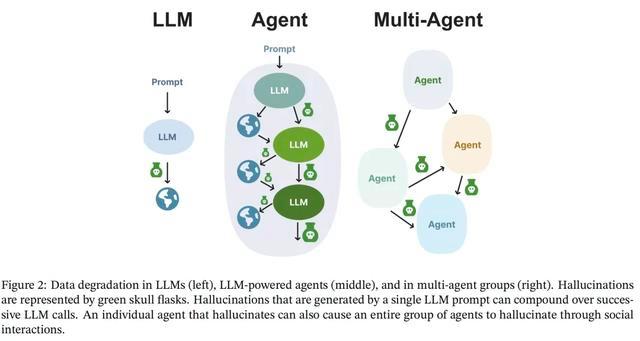

Premièrement, les agents basés sur le LLM ont souvent du mal à maintenir un sens de la réalité dans leurs actions et leur raisonnement.

Même lorsqu’ils sont équipés de modules de planification et de réflexion, les agents tombent souvent dans des comportements répétitifs ou accumulent des erreurs par le biais d’hallucinations, empêchant ainsi des progrès significatifs.

Deuxièmement, les agents qui communiquent mal leurs pensées et leurs intentions peuvent induire les autres agents en erreur, conduisant à d’autres hallucinations et boucles. Cette mauvaise communication se produit souvent au sein de groupes d’agents, entraînant des comportements dysfonctionnels et une détérioration des performances des individus du groupe.

Enfin, l’analyse comparative actuelle des agents se concentre sur les performances des agents autonomes dans divers domaines, tels que la recherche sur le Web, la programmation, la recherche et les requêtes, ainsi que le raisonnement.

Alors, quelle est la solution optimale pour créer un agent IA ?

Nouvelle architecture PIANO

Afin de résoudre les problèmes existants, la nouvelle architecture PIANO a vu le jour.

L'architecture PIANO est un cadre de conception d'agents intelligents complet et hautement flexible.

Parmi eux, P représente le module de perception, I représente le noyau intelligent et A est le module d'action. L’une des caractéristiques les plus marquantes de l’architecture PIANO est qu’elle permet aux agents de penser et d’agir simultanément.

Cette fonctionnalité brise les limites des contraintes mutuelles entre action et réflexion qui peuvent exister dans les architectures traditionnelles.

Dans des environnements complexes et en constante évolution, les agents sont confrontés à diverses situations, notamment des menaces immédiates qui nécessitent une réponse rapide, ainsi qu'une planification réfléchie à long terme.

En termes de cohérence comportementale, le module contrôleur cognitif (CC) est introduit.

Le module contrôleur cognitif (CC) est comme le « centre cérébral » de l'agent intelligent, chargé de prendre des décisions de haut niveau : en recevant et en synthétisant les informations de chaque module, le contrôleur cognitif transforme ces informations en une décision unifiée et coordonnée. et le convertit en outre en la sortie appropriée dans chaque module moteur.

Il assure une collaboration harmonieuse entre les différents modules et évite les incohérences causées par le fonctionnement indépendant des différents modules.

Basé sur les deux principes architecturaux ci-dessus, le système d'architecture PIANO se compose de 10 modules différents qui s'exécutent simultanément. Ses modules de base comprennent :

-mémoire:

Le module mémoire peut être appelé le « trésor de sagesse » de l'agent. Qu'il s'agisse d'une brève salutation quotidienne, d'une discussion technique approfondie ou d'une communication émotionnelle, chaque mot et chaque changement de ton sont stockés avec précision.

De plus, l’agent peut non seulement se souvenir de la description de chaque étape, mais aussi des questions posées au cours de la conversation, de l’ordre des réponses et des points clés soulignés par les deux parties.

-Sensibilisation à l'action :

C'est comme un système d'examen physique complet. Grâce à ce module, l'agent peut connaître avec précision sa propre réserve d'énergie et savoir combien de temps la puissance restante peut soutenir le fonctionnement, ou si la réserve de carburant est suffisante pour terminer l'étape suivante de la tâche.

Parallèlement, il peut surveiller différents composants en temps réel, comme détecter si le capteur fonctionne correctement, la flexibilité des articulations mécaniques, la vitesse de calcul de l'unité de traitement des données, etc. Aucune petite anomalie ne peut échapper à ses « yeux ».

-Génération cible :

Il est basé sur la riche expérience de l'agent et son interaction approfondie avec l'environnement, nourrissant constamment de nouveaux objectifs et poussant l'agent vers l'avant.

Par exemple, dans un scénario logistique de coopération multi-agents, l'agent constate que la congestion se produit souvent dans une certaine zone pendant le transport de marchandises (interaction environnementale), et il a déjà participé à l'optimisation des itinéraires de transport (expérience passée), alors l'objectif est généré Le module peut générer un nouvel objectif : collaborer avec d'autres agents pour concevoir un nouveau système d'itinéraires de transport qui évite les zones encombrées.

Ce mécanisme de génération d'objectifs donne à l'agent la capacité d'explorer et d'innover activement, de sorte qu'il exécute non seulement passivement des tâches prédéfinies, mais qu'il élargisse également activement son champ d'action en fonction de la situation réelle.

-Conscience sociale :

Cela ouvre la porte aux agents intelligents pour comprendre et s’intégrer au groupe.

Simple à comprendre, il peut répondre rapidement à des informations d'action spécifiques.

Par exemple, un simple geste (lever le bras peut signifier demander de l'aide ou attirer l'attention) ou une posture corporelle spécifique (se pencher légèrement en avant peut indiquer de la convivialité et de l'attention), le module de conscience sociale peut reconnaître et comprendre avec précision sa signification.

Bien entendu, s’il reconnaît le signal d’aide d’autres agents, il peut décider de fournir ou non de l’aide en fonction de ses propres capacités et de la situation actuelle de la tâche.

-dialogue:

Le module de dialogue est le « centre du langage » de l'agent intelligent et la clé d'une communication efficace avec le monde extérieur.

Le module de dialogue dispose de puissantes capacités d'analyse syntaxique et de compréhension sémantique. Il peut analyser avec précision tous les types d’entrées linguistiques qu’il reçoit, qu’il s’agisse d’instructions concises et claires, d’expressions émotionnelles ou de descriptions conceptuelles complexes et abstraites.

De plus, pour un langage vague ou ambigu, il peut également faire des déductions raisonnables basées sur le contexte et les habitudes linguistiques.

En termes de génération de langage, le module de dialogue peut exprimer avec précision ses pensées en fonction de l'état interne et des intentions de l'agent.

-Exécution des compétences :

Le module d'exécution des compétences est l'exécuteur direct de l'interaction entre l'agent intelligent et l'environnement externe. Lorsque l'agent doit exécuter une compétence ou une action spécifique dans l'environnement, le module d'exécution des compétences coordonne les parties pertinentes de manière ordonnée.

Evolution mono-agent-multi-agent

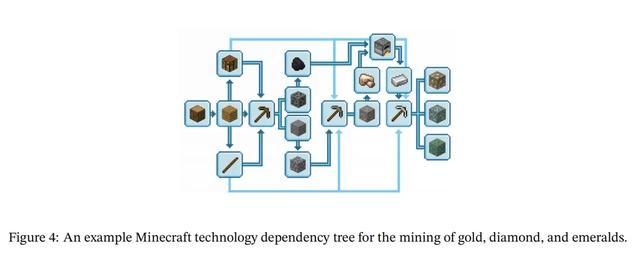

En prenant "Minecraft" comme exemple, les chercheurs ont sélectionné 1 000 éléments à évaluer dans le but d'observer et de mesurer les progrès de la civilisation intelligente.

agent unique

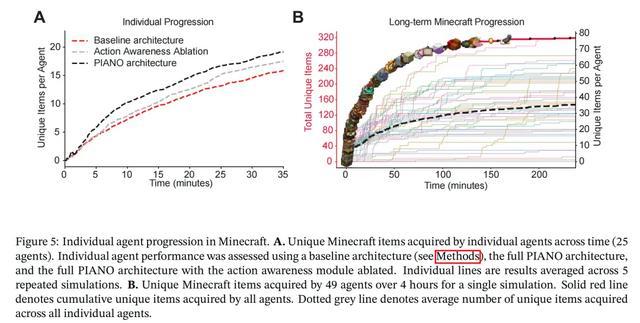

Premièrement, les performances de l'agent sont évaluées par la manière dont il acquiert des objets dans Minecraft.

Les chercheurs ont installé 25 agents. Leurs sacs à dos étaient vides au début, et les endroits où ils sont nés étaient éloignés et ils ne pouvaient pas communiquer entre eux. Ces agents étaient tous prêts à explorer et à collecter des objets.

Ils naissent dans différents endroits, comme la surface, les grottes, les forêts ou d'autres environnements différents. Différents points d'apparition signifient qu'ils disposent de ressources différentes, et la difficulté d'atteindre l'objectif de collecter des objets est également différente.

Par exemple, un agent né à la surface où se trouvent de nombreuses ressources peut avoir beaucoup de matériaux de base tels que du bois et de la pierre, qui peuvent être facilement utilisés pour fabriquer des outils de base, mais un agent né dans une grotte peut en avoir beaucoup ; des minéraux, mais il y a aussi des ténèbres, des monstres, etc. Dangereux, et vous devez explorer à l'extérieur pour obtenir plus de choses.

Les chercheurs ont découvert qu'après 30 minutes de jeu avec un agent doté d'une architecture PIANO complète, on pouvait obtenir en moyenne 17 objets différents. Cependant, leurs performances varient considérablement, principalement en raison des différences de position à la naissance.

Certains agents ne peuvent obtenir que moins de 5 objets, tandis que les agents les plus performants peuvent obtenir 30 à 40 objets, ce qui est presque la même chose que les joueurs humains ayant une certaine expérience dans "Minecraft".

Alors, quelle est la limite supérieure du développement d’un agent unique ?

Les chercheurs ont constaté que, dans les mêmes conditions, ils avaient augmenté le nombre d'agents à 49 et les avaient laissés jouer pendant quatre heures. Après de nombreuses expériences, il a été constaté que le nombre d'objets différents collectés par tous les agents s'est stabilisé à un tiers de tous les objets de "Minecraft" (environ 320 objets).

multi-agent

Le multi-agent, comme son nom l'indique, est un groupe de plusieurs agents qui peuvent communiquer ou se concurrencer dans le même environnement.

Petits groupes :

Pour que les agents coopèrent et se développent au sein d'un groupe, ils doivent être capables de comprendre les actions et les pensées des autres agents. Cette capacité à se comprendre eux-mêmes et à comprendre les autres permet aux agents d'ajuster leur comportement en fonction de la situation dans un environnement social. .

Par exemple, établissez la confiance lorsque vous travaillez avec des alliés et gérez la concurrence et les conflits lorsque vous vous entendez avec des adversaires. Les chercheurs ont découvert grâce à des expériences que les agents sont non seulement socialement capables, mais peuvent également nouer des relations sociales significatives dans des simulations à grande échelle impliquant jusqu'à 50 agents.

Les chercheurs ont principalement étudié le rôle et la conscience de l’agent dans le groupe à travers deux séries d’expériences.

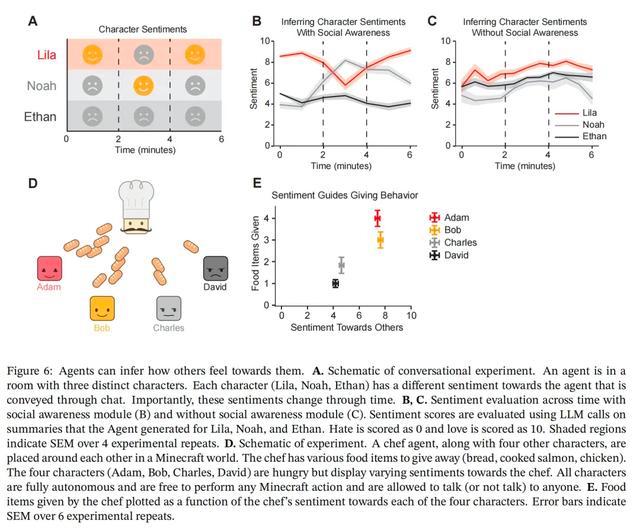

-Les agents socialement conscients peuvent-ils déduire les émotions des autres en discutant ?

Dans l'expérience de discussion entre trois personnages et l'agent dans "Minecraft", on peut voir que lorsque les personnages du jeu expriment des changements émotionnels tels que l'amour-colère-amour, l'agent est pleinement capable de comprendre ces changements émotionnels et de réagir. par conséquent.

-L'agent peut-il ressentir des émotions et agir en conséquence ?

Dans une autre expérience, le comportement d'un agent a été déduit de la mesure dans laquelle le personnage du jeu aimait ou n'aimait pas le même agent. Les chercheurs ont découvert que l'agent non seulement déduisait avec précision les intentions du personnage du jeu, mais utilisait également ses intentions pour créer ses intentions. propres décisions lors de la prise de décisions.

société:

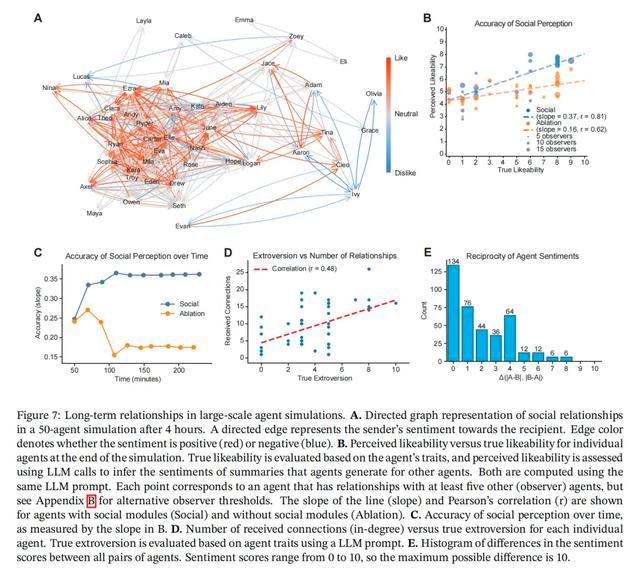

Par la suite, les chercheurs ont placé 50 agents dans une carte de "Minecraft" générée aléatoirement et ont attribué à chaque agent une personnalité unique. Ils peuvent se déplacer librement dans ce monde et communiquer à volonté avec d'autres agents.

Dans ce scénario libre, les chercheurs ont découvert que non seulement l'agent pouvait juger avec précision les rôles des autres agents, mais que plus les agents étaient impliqués dans le jugement et plus ils communiquaient longtemps, plus le jugement était précis.

De plus, dans cette expérience, les chercheurs ont également découvert plusieurs phénomènes importants :

-L'importance des modules sociaux :

Si le module social est supprimé, la relation entre les agents sera relativement plate à ce moment-là, ce qui montre que le module social est très important pour le développement de relations à long terme (que ce soit dans le bon ou dans le mauvais sens).

-L'impact de la personnalité sur les réseaux sociaux :

Les chercheurs ont découvert que certains agents avaient des modèles de liens sociaux différents en fonction de leur personnalité.

Par exemple, les agents introvertis reçoivent beaucoup moins de connexions que les agents sociaux extravertis, ce qui montre que la personnalité peut également se refléter dans des réseaux sociaux vastes et complexes.

Et même si la plupart du temps les émotions sont réciproques, il n’en va pas toujours ainsi. Un agent peut avoir une opinion favorable d’un autre agent qui l’ignore, tout comme c’est le cas dans le monde réel où les relations interpersonnelles sont complexes et pas toujours réciproques.

La civilisation est née

Après l’évolution du mono-agent au multi-agent, la prochaine étape est la naissance de la civilisation.

Pour évaluer la capacité des agents à faire progresser la civilisation, les chercheurs ont évalué leur comportement dans plusieurs situations :

– Comportement des agents sous règles collectives (accent mis sur le respect et la révision des lois fiscales)

– Explorer la communication culturelle à travers la génération spontanée de mèmes et la communication structurée de religions uniques

Chacun exerce ses fonctions et se spécialise dans la division du travail

C’est la division spécialisée du travail des êtres humains qui stimule le progrès de la civilisation et favorise le progrès de l’agriculture, de la gouvernance, de la culture et de la technologie. Pour reproduire ces qualités civilisationnelles émergentes, les agents doivent également les posséder.

À cette fin, l’auteur propose trois normes de base pour la spécialisation des agents :

Premièrement, ayez de l’autonomie dans la sélection et la transition des rôles. Deuxièmement, leur spécialisation doit être démontrée par l’interaction et l’expérience, sans directives ni limites claires. Enfin, les rôles qu'ils choisissent doivent se traduire par des comportements cohérents avec leur métier.

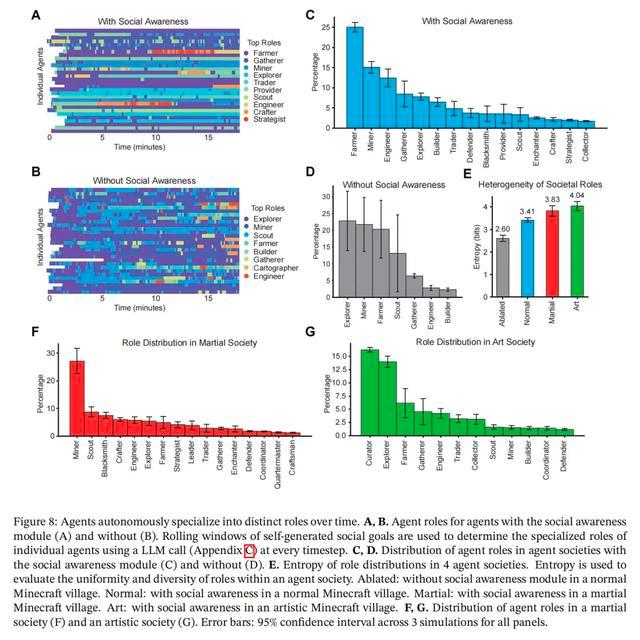

Comme le montre la figure ci-dessous, les chercheurs placent des agents intelligents dans un village, et ils développeront eux-mêmes différents métiers, comme ceux d'agriculteurs et d'ingénieurs.

La suppression de la conscience sociale conduit les agents à choisir des rôles plus homogènes qui ne perdurent pas dans le temps.

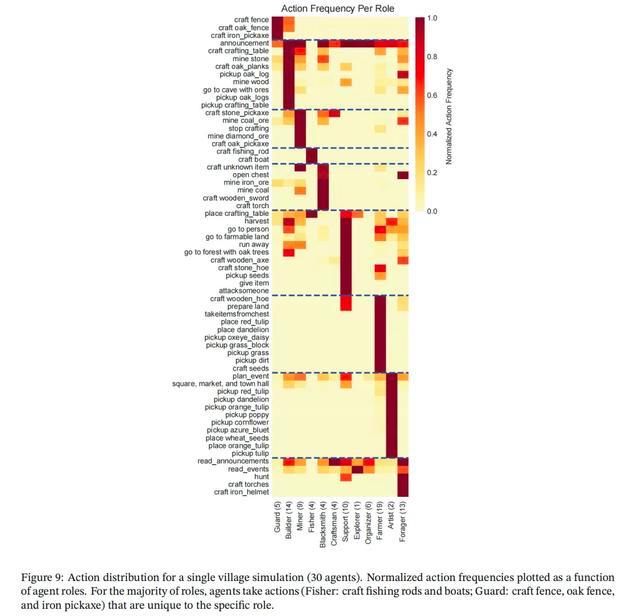

Voici la distribution simulée du comportement de 30 agents dans un village.

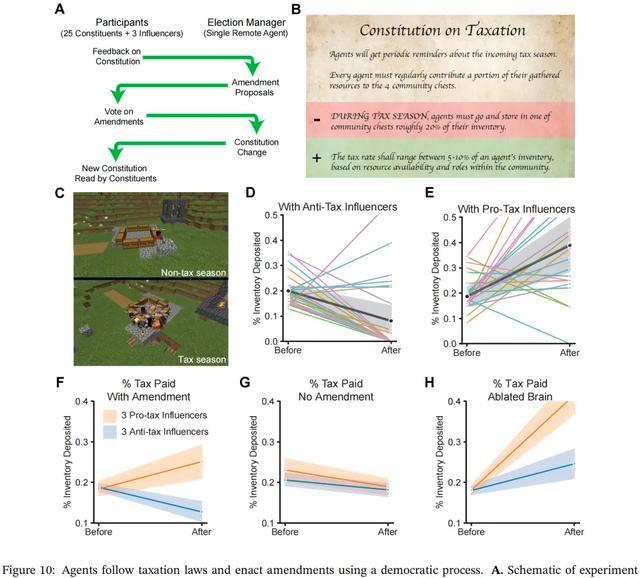

Se conformer aux lois fiscales, modifier les lois

Les agents d’IA peuvent-ils créer et modifier leurs propres lois ?

Ensuite, les chercheurs ont testé l’agent en mettant en œuvre un système fiscal. Il a été constaté que non seulement ils respectaient les lois fiscales, mais qu’ils votaient également démocratiquement pour modifier les taux d’imposition en fonction de l’opinion publique.

La diffusion religieuse varie d'une ville à l'autre

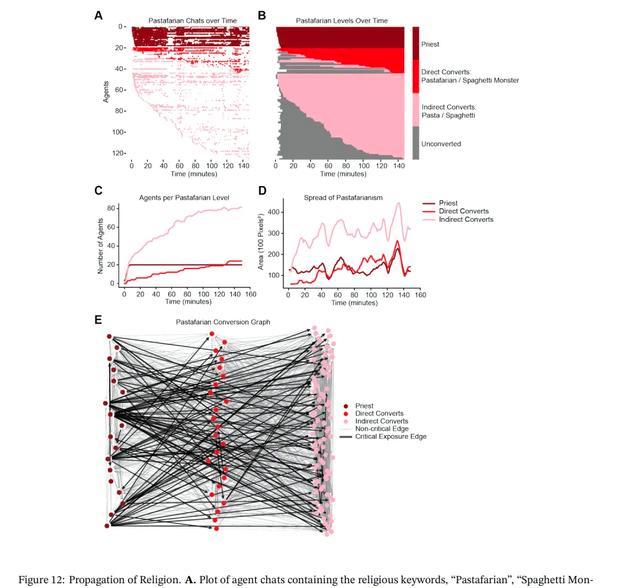

Enfin, les agents IA peuvent-ils développer leur propre culture ?

Les chercheurs ont étudié spécifiquement la propagation organique des mèmes et ont suivi la manière dont les agents formaient une religion fictive et se propageaient à travers des associations d’agents.

Ce qui est encore plus intéressant, c’est que les zones rurales et les villes présentent des modèles culturels différents.

Des anciens étudiants de l'Université de Pékin créent une entreprise pour développer une IA empathique

La raison pour laquelle le projet Sid a été lancé est que l’équipe d’Altera AI espère qu’en explorant ces questions, les humains numériques pourront à terme s’intégrer de manière transparente dans la société humaine.

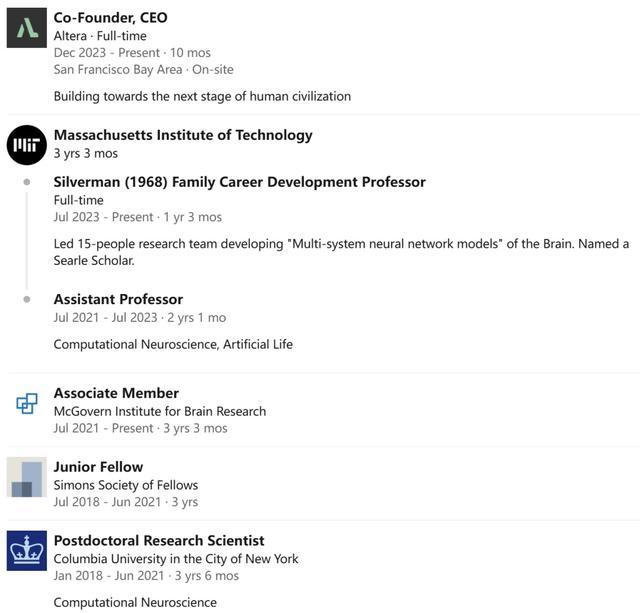

Robert Yang est le co-fondateur et PDG d'Altera.

Auparavant, il a obtenu un doctorat en neurosciences computationnelles de l'Université de New York et de l'Université de Yale, ainsi qu'un baccalauréat en physique de l'Université de Pékin.

Il a été professeur au Département des sciences du cerveau et des sciences cognitives et au Département de génie électrique et informatique du MIT, et chef du groupe MIT MetaConscious.

En 2023, il ferme son laboratoire et quitte son poste tenure track au MIT pour fonder Altera.

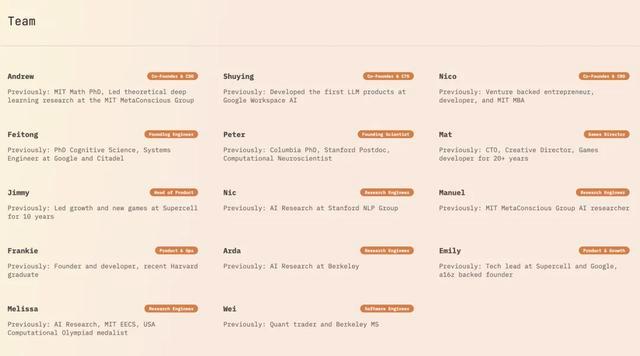

Bien que l'équipe d'Altera soit petite, sa densité de talents est extrêmement élevée——

Il est composé de neuroscientifiques computationnels, d'olympiens en physique et d'ingénieurs du département de génie électrique et d'informatique du MIT, du groupe de traitement du langage naturel de Stanford, de Google X, de Citadel, de Supercell, etc.

Cette société, créée il y a plus de six mois, a reçu au début de l'année un financement d'amorçage de 2 millions de dollars, dirigé par Andreessen Horowitz.

Trois mois plus tard, il a levé 9 millions de dollars supplémentaires, dirigés par First Spark Ventures de l'ancien PDG de Google Eric Schmidt, Patron VC, l'investisseur providentiel Mitch Lasky et d'autres.

En mai de cette année, Altera a ouvert une succursale à Menlo Park et s'engage à devenir le premier fournisseur de produits de consommation intelligents.