Le modèle d'inférence Marco-o1 récemment publié par Alibaba International AI Team se concentre sur la résolution de problèmes ouverts, dépassant les limites des modèles traditionnels limités aux champs de réponse standard et démontrant son potentiel dans la gestion de tâches complexes et difficiles à quantifier. . L'éditeur de Downcodes vous donnera une compréhension approfondie des caractéristiques, des applications et de l'usage de ce modèle, ainsi que de l'innovation qu'il apporte dans le domaine de l'intelligence artificielle.

Alibaba International AI Team a récemment publié un nouveau modèle de raisonnement appelé Marco-o1, qui accorde une attention particulière à la solution de problèmes ouverts et ne se limite pas aux domaines avec des réponses standard, tels que la programmation et les mathématiques. L’équipe de recherche s’engage à explorer si de tels modèles peuvent être généralisés efficacement à des domaines difficiles à quantifier et dépourvus de bénéfices clairs.

Les caractéristiques du modèle Marco-o1 incluent l'utilisation de données CoT ultra longues pour un réglage fin, l'utilisation de MCTS pour étendre l'espace de solution et une expansion fine de l'espace de solution. Le modèle utilise le self-play + MCTS pour construire un lot de données CoT ultra longues avec la capacité de réfléchir et de corriger, et est entraîné avec d'autres données open source. En outre, l'équipe de recherche a également défini une mini-étape pour élargir davantage l'espace de solutions du modèle et guider le modèle pour produire de meilleures réponses.

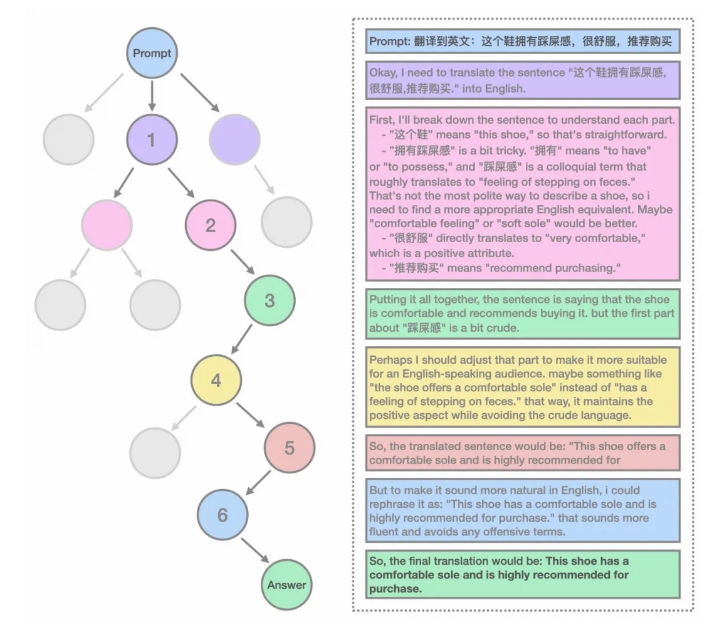

Dans la tâche de traduction, le modèle Marco-o1 a démontré sa capacité à gérer la traduction de phrases longues et difficiles. C'est la première fois que l'extension du temps d'inférence est appliquée aux tâches de traduction automatique. L’équipe de recherche a mis en open source certaines données CoT et les meilleurs modèles actuels, et prévoit d’ouvrir davantage de données et de modèles à l’avenir.

Le modèle réfléchira profondément à la réponse lors du raisonnement. Par exemple, lors de la sortie du nombre de « r » dans le mot « fraise », le modèle démontera progressivement chaque lettre du mot et la comparera, pour finalement afficher le résultat correctement. Dans le domaine de la traduction automatique, le modèle identifie correctement les points difficiles grâce à des liens d'inférence et les traduit mot par mot, améliorant ainsi la précision globale de la traduction.

L'équipe de recherche l'a également essayé dans d'autres domaines, prouvant la capacité du modèle à résoudre d'autres problèmes généraux du monde réel. La structure globale de Marco-o1 utilise le self-play + MCTS pour créer un lot de données CoT ultra longues avec la capacité de les refléter et de les corriger, et de les entraîner avec d'autres données open source. L'équipe de recherche a également incorporé certains ensembles de données de conformité aux instructions de la famille MarcoPolo pour améliorer les capacités de conformité aux instructions du modèle.

En termes d'utilisation, l'équipe de recherche fournit un code d'inférence et un code de réglage fin. Les utilisateurs peuvent facilement charger le modèle et le tokenizer et commencer à discuter ou à affiner le modèle. De plus, le modèle peut également être exécuté directement sur la version GGUF sur ModelScope, offrant ainsi un moyen plus rapide d'en faire l'expérience.

La sortie du modèle Marco-o1 marque une étape importante franchie par l'équipe internationale d'IA d'Alibaba dans le domaine des modèles d'inférence, fournissant de nouvelles idées et de nouveaux outils pour résoudre des problèmes ouverts.

Portée du modèle :

https://modelscope.cn/models/AIDC-AI/Marco-o1

Arxiv :

https://arxiv.org/abs/2411.14405

GitHub :

https://github.com/AIDC-AI/Marco-o1

Visage câlin :

https://huggingface.co/AIDC-AI/Marco-o1

L'open source du modèle Marco-o1 fournit des ressources précieuses aux chercheurs et aux développeurs. On pense que des applications plus innovantes basées sur ce modèle verront le jour à l'avenir, favorisant le développement continu de la technologie de l'intelligence artificielle. Dans l’attente de plus de cas d’application et de résultats de recherche sur Marco-o1 !