L’éditeur de Downcodes a appris que les dernières recherches de DeepMind utilisent le modèle Transformer à très grande échelle pour réaliser des progrès révolutionnaires dans le domaine des échecs. Les chercheurs ont construit un ensemble de données ChessBench contenant des dizaines de millions d'enregistrements de jeux humains et ont formé un modèle Transformer avec jusqu'à 270 millions de paramètres, dans le but d'explorer ses capacités dans des problèmes de planification complexes. Ce résultat de recherche a attiré l’attention de la communauté de l’IA et a fourni une nouvelle orientation et une nouvelle référence pour la recherche sur les capacités de planification de l’IA.

Récemment, un article de DeepMind sur l'application du Transformer à très grande échelle dans le domaine des échecs a déclenché de nombreuses discussions au sein de la communauté de l'IA. Les chercheurs ont utilisé un nouvel ensemble de données appelé ChessBench pour former un modèle Transformer avec jusqu'à 270 millions de paramètres afin d'explorer ses capacités dans des problèmes de planification complexes tels que les échecs.

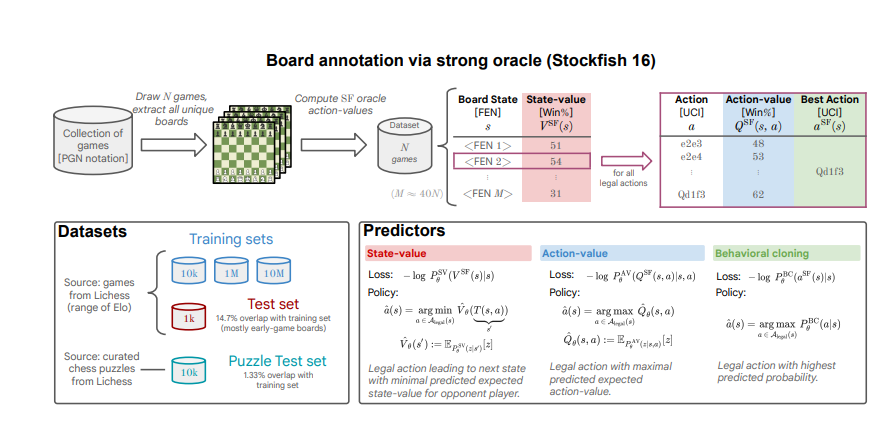

L'ensemble de données ChessBench contient 10 millions d'enregistrements de parties humaines collectées à partir de la plateforme Lichess, et les parties d'échecs sont annotées à l'aide du moteur d'échecs Stockfish16, fournissant jusqu'à 15 milliards de points de données, y compris le taux de victoire et le meilleur coup de chaque état de partie d'échecs. et la valorisation de tous les mouvements légaux.

Les chercheurs ont utilisé des méthodes d’apprentissage supervisé pour entraîner le modèle Transformer afin de prédire la valeur de chaque mouvement légal dans un état de jeu donné. Les résultats expérimentaux montrent que même sans utiliser d'algorithme de recherche explicite, le plus grand modèle peut faire des prédictions assez précises dans de nouveaux états de jeu d'échecs, démontrant ainsi de fortes capacités de généralisation.

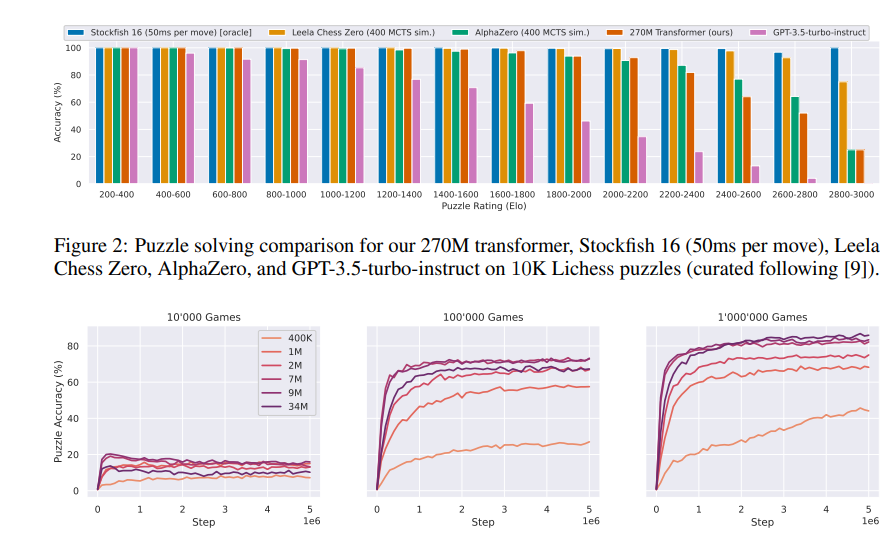

Étonnamment, lorsque le modèle a joué aux échecs rapides contre des joueurs humains sur la plateforme Lichess, il a obtenu une note Elo de 2895, atteignant le niveau de maître d'échecs.

Les chercheurs ont également comparé le modèle avec des moteurs d'échecs entraînés à l'apprentissage par renforcement et au jeu personnel, tels que Leela Chess Zero et AlphaZero. Les résultats montrent que même si une version approximative de l'algorithme de recherche Stockfish peut être affinée dans le modèle Transformer grâce à l'apprentissage supervisé, il reste encore des défis à relever pour parvenir à un raffinement parfait.

Cette recherche montre que le modèle Transformer à très grande échelle a un grand potentiel pour résoudre des problèmes de planification complexes et fournit également de nouvelles idées pour le développement de futurs algorithmes d’IA. La publication de l’ensemble de données ChessBench fournira également une nouvelle plate-forme de référence permettant aux chercheurs d’explorer les capacités de planification de l’IA.

Les résultats des recherches de DeepMind démontrent non seulement la puissance du modèle Transformer dans le domaine des échecs, mais fournissent également une valeur de référence importante pour les futures applications de l'IA dans des domaines plus complexes. Cela marque un autre grand pas en avant pour l’IA dans le domaine des jeux de stratégie complexes et mérite une attention continue.