OpenAI a publié un nouveau modèle accrocheur, gpt-4o-audio-preview, qui a réalisé des avancées significatives dans le domaine de la génération et de l'analyse de la parole, offrant aux utilisateurs une expérience d'interaction vocale plus naturelle et intelligente. L'éditeur de Downcodes vous amènera à avoir une compréhension approfondie des fonctions de base, des scénarios d'application et des stratégies de tarification de ce modèle, et à analyser son impact potentiel sur diverses industries.

OpenAI mène une fois de plus la tendance de la technologie de l'intelligence artificielle et lance un nouveau modèle gpt-4o-audio-preview. Ce modèle démontre non seulement des capacités étonnantes en matière de génération et d’analyse de la parole, mais ouvre également de nouvelles possibilités d’interaction homme-machine. Examinons de plus près les caractéristiques de ce modèle innovant et ses applications potentielles.

Les fonctions principales de gpt-4o-audio-preview comprennent trois aspects principaux : Premièrement, il peut générer des réponses vocales naturelles et fluides basées sur du texte, offrant ainsi une prise en charge solide pour des applications telles que les assistants vocaux et le service client virtuel. Deuxièmement, le modèle a la capacité d’analyser l’émotion, l’intonation et la hauteur de l’entrée audio, ce qui offre de larges perspectives d’application dans les domaines de l’informatique affective et de l’analyse de l’expérience utilisateur. Enfin, il prend en charge l'interaction voix-voix, où l'audio peut être utilisé à la fois comme entrée et comme sortie, jetant ainsi les bases d'une gamme complète de systèmes d'interaction vocale.

Par rapport à l'API Realtime existante d'OpenAI, gpt-4o-audio-preview se concentre davantage sur les détails du traitement de la parole. Il excelle dans la génération de parole, l’analyse des sentiments et l’interaction vocale, avec un accent particulier sur le traitement de caractéristiques subtiles telles que l’intonation et l’émotion. En revanche, l'API Realtime se concentre davantage sur le traitement des données en temps réel et convient aux scénarios nécessitant un retour immédiat, tels que la synthèse vocale en temps réel ou la traduction en temps réel et d'autres applications interactives en continu.

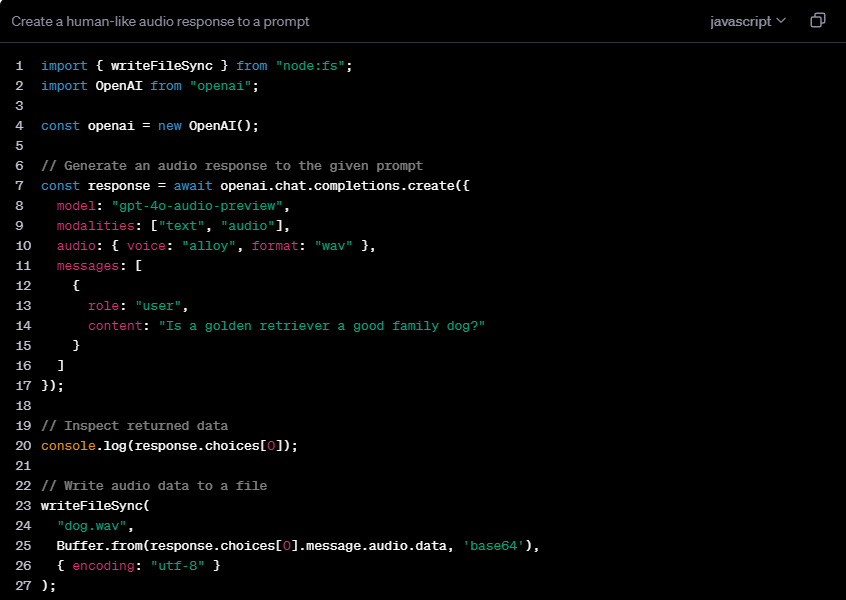

La flexibilité de gpt-4o-audio-preview se reflète dans sa prise en charge de plusieurs combinaisons de modes. Les utilisateurs peuvent sélectionner la saisie de texte pour générer une sortie texte et audio, ou utiliser une entrée audio pour obtenir une sortie texte et vocale. De plus, il prend également en charge la conversion audio-texte et les modes d'entrée mixtes, offrant aux développeurs de riches options.

En termes de tarification, OpenAI adopte un modèle de facturation basé sur des jetons. Le prix de la saisie de texte est relativement bas, autour de 5 dollars par million de jetons. La sortie de texte est légèrement plus élevée, à environ 15 $ par million de jetons. Le coût du traitement audio est relativement élevé, l'entrée coûtant 100 $ par million de jetons (environ 0,06 $ par minute), tandis que la sortie audio atteint 200 $ par million de jetons (environ 0,24 $ par minute). Cette stratégie tarifaire reflète la complexité et les besoins en ressources informatiques du traitement audio.

Le lancement de gpt-4o-audio-preview aura sans aucun doute un impact transformateur sur plusieurs secteurs. Dans le domaine du service client, il peut offrir une expérience d’interaction vocale plus naturelle et émotionnelle. Dans le secteur de l’éducation, cette technologie peut être utilisée pour développer des assistants intelligents d’apprentissage des langues afin d’aider les étudiants à améliorer leur prononciation et leur intonation. Dans l’industrie du divertissement, il devrait permettre une synthèse vocale et une interaction entre personnages virtuels plus réalistes. De plus, en termes de technologie d'assistance, gpt-4o-audio-preview peut fournir des services de synthèse vocale plus précis pour les malentendants, ou fournir des descriptions vocales plus riches pour les malvoyants.

Détails : https://platform.openai.com/docs/guides/audio/quickstart

Dans l’ensemble, l’émergence du modèle gpt-4o-audio-preview marque une nouvelle étape dans la technologie de l’intelligence artificielle vocale. Ses fonctions puissantes et ses vastes perspectives d’application apporteront des changements révolutionnaires aux futures méthodes d’interaction homme-machine. L'éditeur de Downcodes attend avec impatience de voir des applications plus innovantes basées sur ce modèle.