L'éditeur de Downcodes a appris que des progrès significatifs ont été réalisés dans le domaine de la génération vidéo ! Genmo a open source son dernier modèle de génération vidéo Mochi1, qui compte 10 milliards de paramètres et est le plus grand modèle de génération vidéo actuellement rendu public. Mochi1 adopte l'architecture innovante du transformateur de diffusion asymétrique (AsymDiT), simple et facile à modifier, offrant une grande commodité aux développeurs de la communauté open source, et peut générer des vidéos de haute qualité d'une durée allant jusqu'à 5,4 secondes et avec une fréquence d'images allant jusqu'à 30 images/seconde.

Une avancée majeure a eu lieu dans le domaine de la génération vidéo ! Genmo a open source son dernier modèle de génération vidéo, Mochi1, établissant une nouvelle référence dans le domaine de la génération vidéo ! Mochi1 utilise l'architecture innovante du transformateur de diffusion asymétrique (AsymDiT) et possède jusqu'à 10 milliards de paramètres, ce qui en fait le plus grand modèle de génération vidéo rendu public à ce jour.

Plus important encore, il est entièrement formé à partir de zéro et possède une architecture simple et modifiable, ce qui offre une grande commodité aux développeurs de la communauté open source.

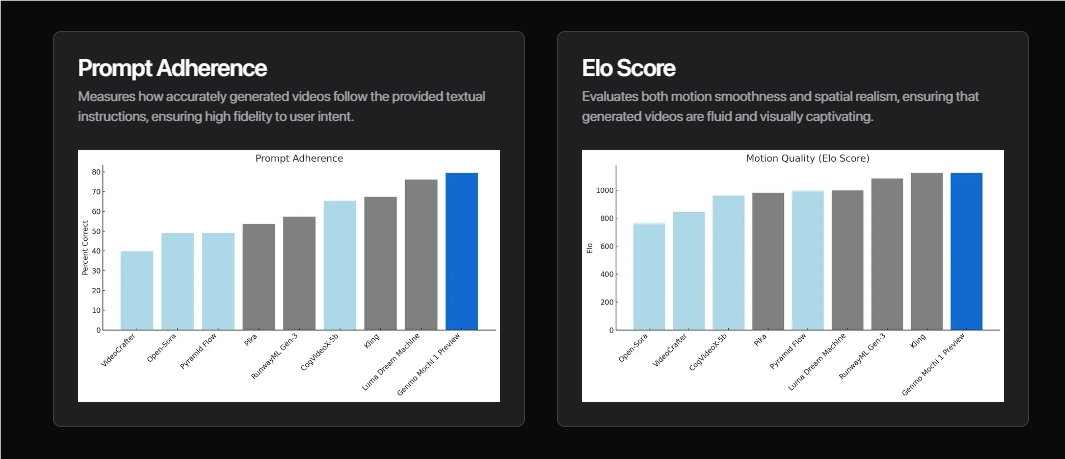

Le plus grand point fort de Mochi1 est son excellente qualité de mouvement et son respect précis des invites textuelles. Il est capable de générer des vidéos fluides d'une durée maximale de 5,4 secondes avec une fréquence d'images allant jusqu'à 30 images/seconde, avec une cohérence temporelle époustouflante et une dynamique de mouvement réaliste.

Mochi1 peut également simuler divers phénomènes physiques, tels que la dynamique des fluides, la simulation de cheveux, etc. Les personnages qu'il génère ont des mouvements naturels et fluides, presque comparables aux performances réelles.

Afin de faciliter l'utilisation par les développeurs, Genmo a également open source son VAE vidéo, qui peut compresser la vidéo à 1/128 de la taille d'origine, réduisant ainsi efficacement la quantité de calcul et les besoins en mémoire du modèle.

L'architecture AsymmDiT gère efficacement les invites utilisateur et les balises vidéo compressées via un mécanisme d'auto-attention multimodal, et apprend des couches MLP distinctes pour chaque modalité, améliorant ainsi l'efficacité et les performances du modèle.

La sortie de Mochi1 marque une étape importante dans le domaine de la génération vidéo open source. La société Genmo a annoncé qu'elle publierait la version complète de Mochi1 avant la fin de l'année, y compris Mochi1HD qui prend en charge la génération vidéo 720p, date à laquelle la fidélité et la fluidité de la vidéo seront encore améliorées.

Afin de permettre à davantage de personnes de découvrir les puissantes fonctions de Mochi1, Genmo a également lancé un terrain de jeu hébergé gratuit, que les utilisateurs peuvent découvrir sur genmo.ai/play. Les poids et l'architecture de Mochi1 ont également été rendus publics sur la plateforme HuggingFace pour que les développeurs puissent les télécharger et les utiliser.

Genmo est composé de membres principaux de projets tels que DDPM, DreamFusion et Emu Video, et son équipe consultative comprend Ion Stoica, président exécutif et co-fondateur de Databricks et Anyscale, co-fondateur de Covariant et premier membre de l'équipe d'OpenAI ; et des leaders de l'industrie des systèmes de modèles de langage tels que Joey Gonzalez, pionnier et co-fondateur de Turi.

La mission de Genmo est de débloquer le cerveau droit de l'intelligence artificielle générale, et Mochi1 est la première étape dans la construction d'un simulateur de monde capable d'imaginer tout, possible ou impossible.

Genmo a récemment finalisé une ronde de financement de série A menée par NEA, d'un montant total de 28,4 millions de dollars américains, qui fournira un soutien financier suffisant pour ses futurs travaux de recherche et de développement.

Même si Mochi1 a obtenu des résultats impressionnants, il présente encore certaines limites. Par exemple, la version initiale ne peut actuellement produire que des vidéos 480p, avec une légère distorsion et une distorsion dans certains cas extrêmes de mouvement extrême. De plus, Mochi1 est actuellement optimisé pour le style photoréaliste et ses performances dans le contenu d'animation doivent être améliorées.

Genmo affirme qu'il continuera à améliorer le Mochi1 et encourage la communauté à affiner le modèle pour l'adapter aux différentes préférences esthétiques. Dans le même temps, ils ont également mis en œuvre de solides protocoles d'audit de sécurité dans leurs terrains de jeux pour garantir que toute génération de vidéos est éthique.

Téléchargement du modèle : https://huggingface.co/genmo/mochi-1-preview

Expérience en ligne : https://www.genmo.ai/play

Introduction officielle : https://www.genmo.ai/blog

L'open source de Mochi1 apporte de nouvelles possibilités dans le domaine de la génération vidéo, et ses fonctions puissantes et son utilisation pratique méritent d'être attendues. Les efforts continus de Genmo et la participation active de la communauté favoriseront davantage l'avancement de la technologie de génération vidéo. Dans l'attente de l'arrivée de Mochi1HD et de l'émergence de réalisations plus innovantes.