La startup française d'IA Les Ministraux a publié deux modèles d'IA légers, Ministral3B et Ministral8B, avec des paramètres de 3 milliards et 8 milliards respectivement, conçus pour les appareils de pointe. Ces deux modèles ont obtenu des résultats remarquables lors des instructions suivant le test de référence, surpassant notamment les modèles du même niveau en termes de connaissances, de bon sens, de raisonnement et d'efficacité. Ils ont même surpassé les modèles avec des paramètres plus larges dans certains aspects, établissant ainsi une nouvelle référence en matière de faible niveau de performance. modèles de paramètres. L'éditeur de Downcodes fournira une explication détaillée des performances, des fonctionnalités et des entreprises derrière ces deux modèles.

La startup française d'IA Les Ministraux a lancé deux nouveaux modèles légers, Ministral3B et Ministral8B, spécialement conçus pour les appareils de pointe, avec des paramètres de 3 milliards et 8 milliards respectivement. Les deux modèles se sont bien comportés dans le benchmark suivant les instructions, Ministral3B surpassant Llama38B et Mistral7B, tandis que Ministral8B a surpassé ces deux modèles dans tous les aspects, à l'exception des capacités de code.

Les résultats des tests montrent que les performances de Minitral3B et Minitral8B sont comparables à celles des modèles open source tels que Gemma2 et Llama3.1. Les deux modèles prennent en charge jusqu'à 128 000 contextes et établissent de nouvelles références pour les modèles de paramètres inférieurs à 10 B en termes de connaissances, de bon sens, de raisonnement, d'appels de fonctions et d'efficacité. Ministral8B est également équipé d'un mécanisme d'attention à fenêtre coulissante pour une inférence en mémoire plus rapide et plus efficace. Ils peuvent être adaptés à une variété de cas d’utilisation, tels que la gestion de flux de travail complexes d’agents IA ou la création d’assistants de tâches spécialisés.

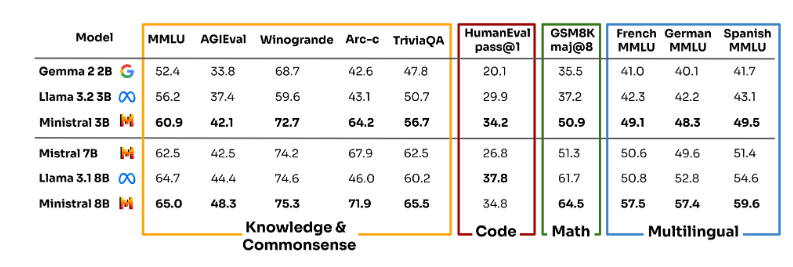

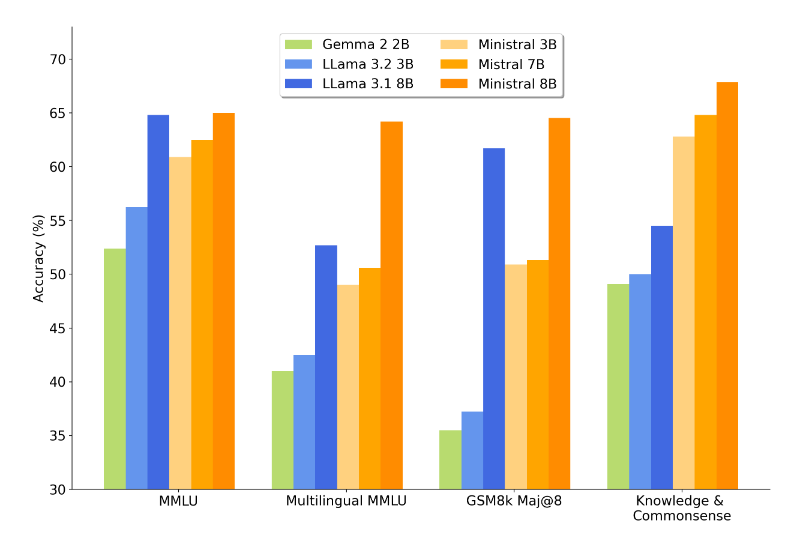

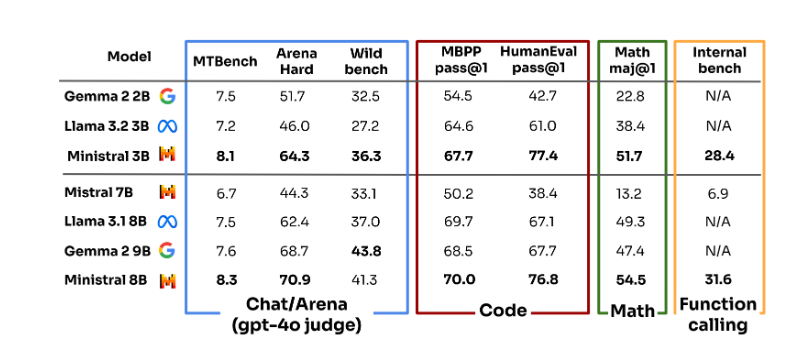

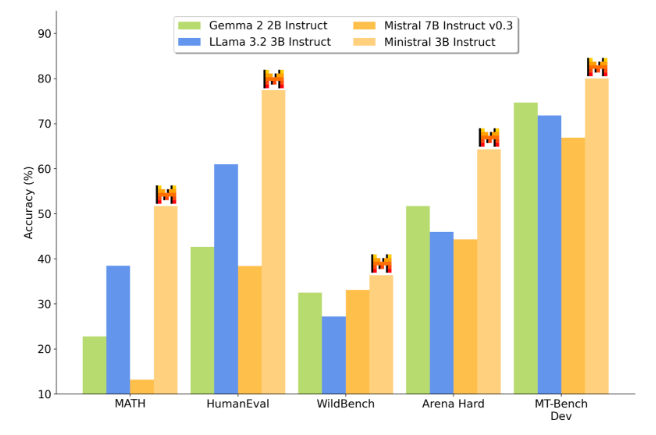

Les chercheurs ont mené plusieurs tests de référence sur le modèle Les Ministraux, couvrant des aspects tels que la connaissance et le bon sens, le codage, les mathématiques et le multilinguisme. Au stade du modèle de pré-formation, Minitral3B a obtenu les meilleurs résultats par rapport à Gema22B et Llama3.23B. En comparaison avec Llama3.18B et Mistral7B, Mistral8B a obtenu les meilleurs résultats dans tous les aspects, à l'exception des capacités de codage. Au stade du modèle d'instruction après réglage fin, Minitral3B a obtenu les meilleurs résultats dans différents tests de référence, et Minitral8B n'était que légèrement inférieur à Gema29B sur le banc Wild.

Le lancement du modèle Les Ministraux offre aux utilisateurs une solution hautement efficace sur le plan informatique et à faible latence qui répond aux besoins d'un nombre croissant d'utilisateurs en matière d'inférence locale pour les applications critiques. Les utilisateurs peuvent appliquer ces modèles à des scénarios tels que la traduction sur appareil, les assistants intelligents ne nécessitant pas de connexion Internet et les robots autonomes. Le prix d'entrée et de sortie de Ministral8B est de 0,1 $ US par million de jetons, et celui de Ministral3B est de 0,04 $ US par million de jetons.

Il convient de noter que Mistral a déjà ouvert plusieurs modèles via des liens magnétiques et a été reconnu par la communauté IA. Cependant, l’entreprise a été mêlée à une controverse cette année car elle n’est plus aussi ouverte qu’elle l’était autrefois. Il y a des nouvelles selon lesquelles Microsoft va acquérir une partie des actions de Mistral et y investir, ce qui signifie que les modèles de Mistral seront hébergés sur Azure AI. Les internautes de Reddit ont découvert que Mistral avait retiré son engagement envers l'open source de son site officiel. Certains modèles de la société ont également commencé à se recharger, notamment les Ministral3B et Ministral8B sortis cette fois-ci.

Détails : https://mistral.ai/news/ministraux/

Dans l’ensemble, l’émergence de Minitral3B et Minitral8B offre un choix judicieux pour les applications d’IA de calcul de pointe, et leurs performances efficaces et leur faible prix leur confèrent des avantages concurrentiels significatifs. Mais le changement de stratégie de Mistral a également déclenché une réflexion de l'industrie sur l'équilibre entre les modèles open source et la commercialisation. À l'avenir, nous continuerons à prêter attention à l'application et au développement du modèle Les Ministraux.