L'éditeur de Downcodes vous fera comprendre les dernières avancées des réseaux de neurones physiques (PNN) ! Cette technologie émergente utilise les caractéristiques des systèmes physiques pour les calculs et devrait dépasser les limites des modèles d’IA existants. Il peut non seulement former des modèles d'IA à plus grande échelle, mais également réaliser une informatique de pointe à faible consommation d'énergie et effectuer des inférences locales sur des appareils tels que les smartphones, ce qui changera complètement les scénarios d'application de l'IA et apportera des possibilités sans précédent.

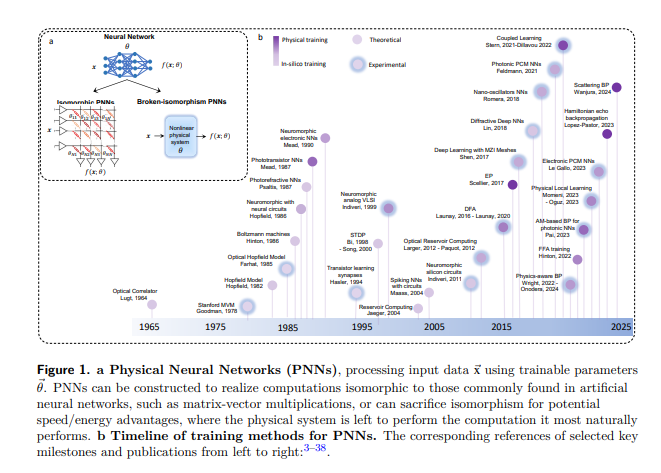

Récemment, des chercheurs de plusieurs institutions ont découvert une nouvelle technologie : les réseaux de neurones physiques (PNN). Il ne s’agit pas des algorithmes numériques que nous connaissons habituellement dans les ordinateurs, mais d’une toute nouvelle méthode informatique intelligente basée sur des systèmes physiques.

Les PNN, comme leur nom l'indique, sont des réseaux de neurones qui exploitent les caractéristiques des systèmes physiques pour effectuer des calculs. Bien qu’il s’agisse actuellement d’un domaine de recherche de niche, ils constituent peut-être l’une des opportunités les plus sous-évaluées de l’IA moderne.

Le potentiel des PNN : grands modèles, faible consommation énergétique, edge computing

Imaginez si nous pouvions former des modèles d'IA 1 000 fois plus grands qu'aujourd'hui, mais également permettre une inférence locale et privée sur des appareils de pointe, tels que des smartphones ou des capteurs ? Cela ressemble à un scénario de science-fiction, mais la recherche montre que ce n'est pas impossible.

Pour parvenir à une formation à grande échelle des PNN, les chercheurs explorent des méthodes, notamment celles basées sur la rétro-propagation et celles sans rétro-propagation. Chacune de ces méthodes présente des avantages et des inconvénients, et aucune n’atteint actuellement la même échelle et les mêmes performances que l’algorithme de rétropropagation largement utilisé dans l’apprentissage profond. Mais la situation évolue rapidement et l’écosystème diversifié des technologies de formation fournit des indices pour l’utilisation des PNN.

La mise en œuvre des PNN implique plusieurs domaines, notamment l’optique, l’électronique et l’informatique inspirée du cerveau. Ils peuvent être structurés de la même manière que les réseaux de neurones numériques pour effectuer des calculs tels que la multiplication matrice-vecteur, ou ils peuvent sacrifier cette similarité structurelle pour des avantages potentiels en termes de vitesse/énergie et laisser le système physique effectuer ses calculs les plus naturels.

L'avenir des PNN : au-delà des performances du matériel numérique

Les applications futures des PNN seront probablement très larges, allant des grands modèles génératifs aux tâches de classification dans les capteurs intelligents. Ils devront être formés, mais les contraintes de formation peuvent varier en fonction de l'application. Une méthode de formation idéale doit être indépendante du modèle, rapide et économe en énergie, et robuste aux variations matérielles, à la dérive et au bruit.

Bien que le développement des PNN soit plein de potentiel, il se heurte également à de nombreux défis. Comment assurer la stabilité des PNN pendant les phases de formation et d'inférence ? Comment intégrer ces systèmes physiques à l'infrastructure matérielle et logicielle numérique existante ?

Adresse papier : https://arxiv.org/pdf/2406.03372

L’émergence des réseaux de neurones physiques (PNN) a apporté de nouveaux espoirs et de nouveaux défis dans le domaine de l’intelligence artificielle. À l’avenir, à mesure que la technologie continue de se développer et que les problèmes sont résolus, les PNN devraient jouer un rôle important dans divers domaines et propulser l’intelligence artificielle vers de nouveaux sommets. L'éditeur de Downcodes continuera de prêter attention aux derniers progrès de la recherche sur les PNN, alors restez à l'écoute !