Alibaba Cloud a lancé la série Qwen2-Math, un nouveau modèle de langage à grande échelle axé sur le domaine des mathématiques, qui a attiré une large attention dans l'industrie. Cette série de modèles surpasse les modèles open source existants dans de multiples tests de référence mathématiques, et surpasse même les modèles fermés bien connus tels que GPT-4o et Claude-3.5-Sonnet à certains égards. L'éditeur de Downcodes vous donnera une explication détaillée des excellentes performances, de la technologie innovante et de l'orientation future du développement des modèles de la série Qwen2-Math, et vous emmènera explorer les dernières avancées dans le domaine des mathématiques de l'IA.

Récemment, Alibaba Cloud a lancé la série Qwen2-Math de modèles de langage à grande échelle. Cette recrue en IA axée sur le domaine des mathématiques a attiré une large attention dans l'industrie dès ses débuts.

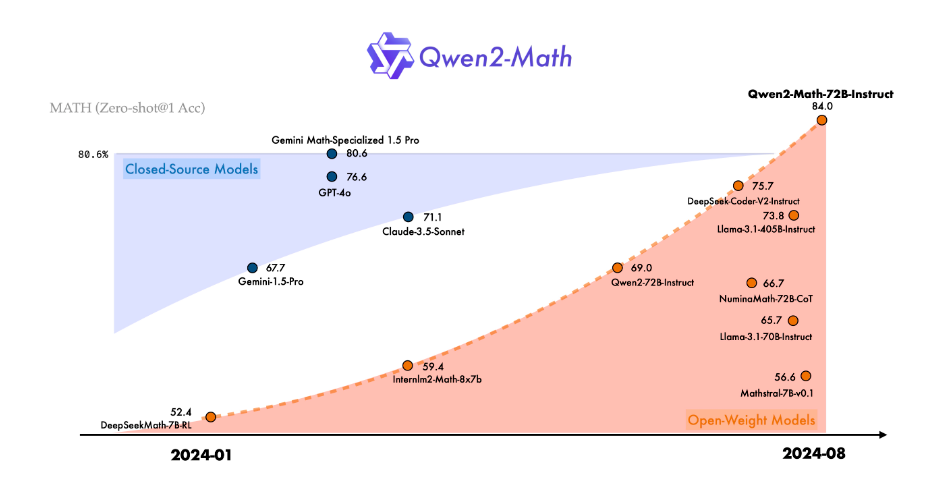

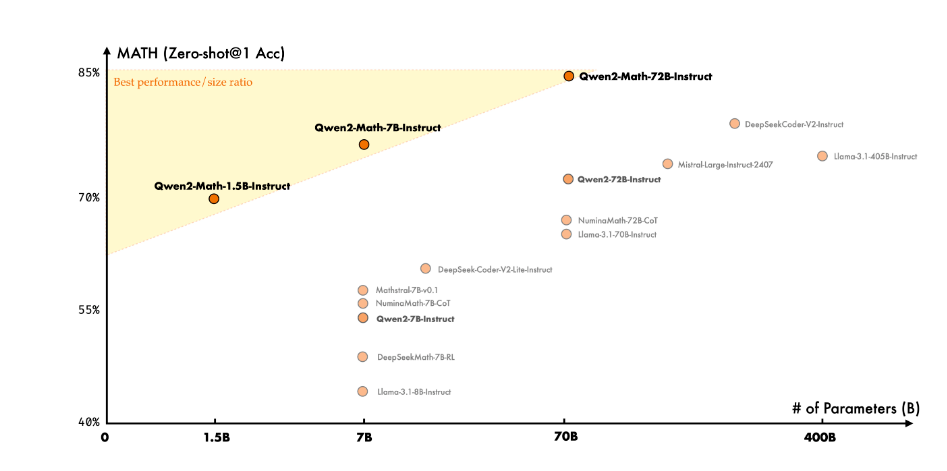

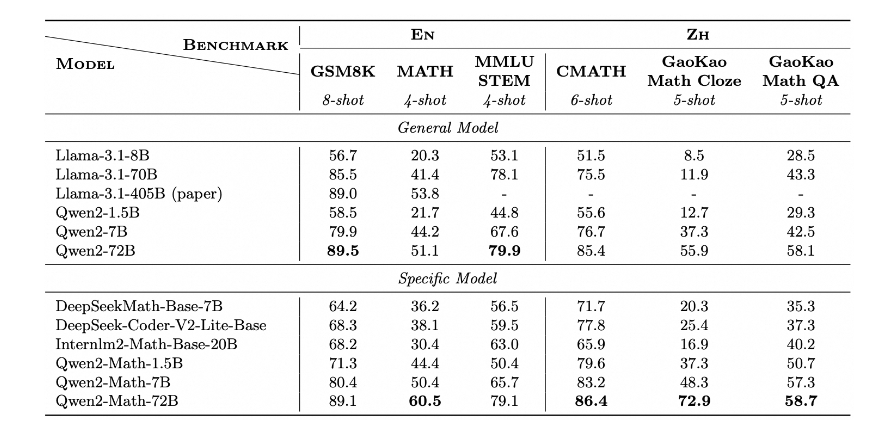

En tant que derniers membres de la série Qwen2, les modèles Qwen2-Math et Qwen2-Math-Instruct-1.5B/7B/72B ont démontré une force impressionnante dans leurs capacités de résolution de problèmes mathématiques. Il est rapporté que cette série de modèles a non seulement surpassé les modèles open source existants dans plusieurs tests de référence mathématiques, mais a également surperformé dans certains aspects, notamment GPT-4o, Claude-3.5-Sonnet, Gemini-1.5-Pro et Llama-Well- Les modèles à source fermée connus, dont 3.1-405B, peuvent être qualifiés de chevaux noirs dans la communauté mathématique de l'IA.

Le succès de Qwen2-Math n’est pas un hasard. L'équipe d'Alibaba Cloud a consacré beaucoup d'efforts au cours de l'année écoulée à l'amélioration des capacités de raisonnement des grands modèles de langage sur des problèmes arithmétiques et mathématiques. La base de cette série de modèles est Qwen2-1.5B/7B/72B. Sur cette base, l'équipe R&D a mené une pré-formation approfondie en utilisant un corpus mathématique professionnel soigneusement conçu. Ce corpus unique couvre des textes mathématiques en ligne à grande échelle et de haute qualité, des livres professionnels, des exemples de code et de nombreuses questions d'examen, et comprend même des données de pré-formation en mathématiques générées indépendamment par Qwen2.

Il convient particulièrement de mentionner le modèle Qwen2-Math-Instruct. Ce modèle de récompense professionnelle en mathématiques basé sur la formation Qwen2-Math-72B adopte une méthode de formation innovante. L'équipe R&D combine habilement le signal de récompense dense avec le signal binaire indiquant si le modèle répond correctement ou non. Ce signal combiné est utilisé comme signal de supervision pour construire des données SFT (Supervised Fine-Tuning) via l'échantillonnage par rejet et dans l'apprentissage par renforcement. après l'application de la technologie d'optimisation de politique relative (GRPO) du groupe SFT. Cette méthode de formation unique améliore considérablement les capacités de résolution de problèmes mathématiques du modèle.

Dans les applications pratiques, Qwen2-Math-Instruct affiche des performances étonnantes. Qu'il s'agisse de l'AIME (American Invitational Mathematics Examination) 2024 ou de l'AMC (American Mathematics Competition) 2023, ce modèle a bien fonctionné dans divers contextes, notamment la recherche gourmande (Greedy), le vote majoritaire, la minimisation des risques et d'autres stratégies.

Ce qui est encore plus excitant, c'est que Qwen2-Math a également fait preuve d'une grande force dans la résolution de certains problèmes du niveau de l'Olympiade mathématique internationale (OMI). Grâce à l'analyse d'une série de cas de test, les chercheurs ont découvert que Qwen2-Math peut non seulement résoudre facilement des problèmes de compétition mathématiques simples, mais également fournir des solutions convaincantes face à des problèmes complexes.

Cependant, l’équipe d’Alibaba Cloud ne s’est pas arrêtée là. Ils ont révélé que la série actuelle Qwen2-Math ne prend en charge que l'anglais, mais qu'ils développent déjà activement des modèles bilingues prenant en charge l'anglais et le chinois, et prévoient de lancer des versions multilingues dans un avenir proche. De plus, l’équipe continue d’optimiser le modèle afin d’améliorer encore sa capacité à résoudre des problèmes mathématiques plus complexes et plus exigeants.

L’émergence de Qwen2-Math a sans aucun doute ouvert de nouvelles possibilités d’application de l’IA dans le domaine des mathématiques. Non seulement il apportera des changements révolutionnaires au secteur de l'éducation et aidera les étudiants à mieux comprendre et maîtriser les connaissances mathématiques, mais il pourrait également jouer un rôle important dans la recherche scientifique, l'ingénierie et d'autres domaines nécessitant des calculs mathématiques complexes.

Page du projet : https://top.aibase.com/tool/qwen2-math

Téléchargement du modèle : https://huggingface.co/Qwen

Dans l’ensemble, l’émergence de la série de modèles Qwen2-Math marque une avancée majeure pour l’IA dans le domaine des mathématiques. Son potentiel de développement futur est énorme et mérite une attention continue. L'éditeur de Downcodes estime qu'avec les progrès continus de la technologie, Qwen2-Math apportera plus de possibilités à l'enseignement des mathématiques et à la recherche scientifique.