Avec le développement rapide de la technologie de l’intelligence artificielle, de plus en plus de contenus générés par l’IA inondent Internet, et la manière d’identifier son authenticité est devenue une question importante. Adam Mosseri, le patron d'Instagram, a récemment publié une déclaration à ce sujet, rappelant aux utilisateurs d'être vigilants et de traiter les images en ligne avec prudence, en particulier les contenus réalistes générés par l'intelligence artificielle. Il a souligné que les plateformes ont la responsabilité d'aider les utilisateurs à identifier de tels contenus, et a appelé les utilisateurs à améliorer leur capacité à identifier, à prêter attention à la source d'information et à éviter d'être induits en erreur.

Adam Mosseri, directeur d'Instagram, a déclaré sur les réseaux sociaux que les utilisateurs devraient se méfier des images qu'ils voient en ligne, en particulier du contenu généré par l'intelligence artificielle qui peut facilement être confondu avec la réalité. Mosseri a souligné que la technologie de l'intelligence artificielle a considérablement amélioré sa capacité à produire un contenu réaliste, les utilisateurs doivent donc être prudents et considérer la source de l'information, et les plateformes sociales ont la responsabilité d'aider à cet égard.

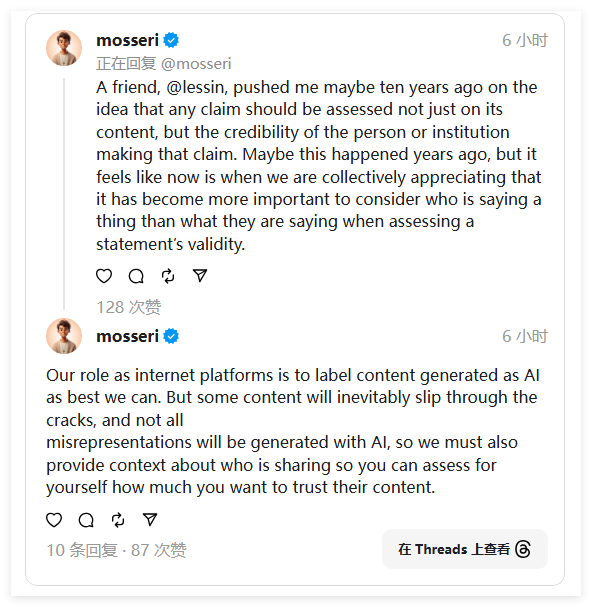

"En tant que plate-forme Internet, il est de notre devoir d'étiqueter autant que possible le contenu généré par l'IA", a-t-il écrit. Cependant, Mosseri a reconnu que ces étiquettes manquent parfois certains contenus en raison des limites de la technologie. Par conséquent, la plate-forme doit également fournir des informations générales sur le partageur pour aider les utilisateurs à évaluer la crédibilité des informations.

Mosseri a en outre souligné que, tout comme il faut être conscient que les chatbots peuvent fournir des informations incorrectes avant d'utiliser des moteurs de recherche à intelligence artificielle, vérifier si l'éditeur d'une image ou d'une déclaration provient d'un compte de confiance est également un moyen important de juger de l'authenticité du message. contenu. Actuellement, la plate-forme Meta n'a pas fourni d'informations générales similaires à celles mentionnées par Mosseri, bien que la société ait récemment laissé entendre que des modifications majeures aux règles de contenu seraient apportées à l'avenir.

Le système qu’il décrit ressemble davantage à un mécanisme de modération dirigé par l’utilisateur, similaire aux notes de la communauté sur Platform X et YouTube ou à la fonction de modération personnalisée de Bluesky. Bien qu'il ne soit pas clair si Meta introduira des fonctions similaires, il convient de noter que Meta a récemment tiré les leçons de l'expérience de Bluesky et pourrait apporter des améliorations correspondantes à l'avenir.

La déclaration de Mosseri nous rappelle qu’à une époque d’explosion de l’information, il est crucial d’améliorer l’éducation aux médias et de renforcer le discernement. Les plateformes sociales doivent également assumer davantage de responsabilités, explorer activement des méthodes efficaces pour aider les utilisateurs à identifier et à répondre aux défis posés par le contenu généré par l'intelligence artificielle, et construire conjointement un environnement en ligne plus sûr et plus fiable.