Le dernier projet Project Astra publié par l'équipe Google DeepMind montre un prototype de lunettes équipé d'une IA multimode en temps réel. Les lunettes fonctionnent sur le nouveau système d'exploitation Android XR de Google pour l'informatique visuelle et ont été testées par un petit nombre d'utilisateurs pour explorer les futures possibilités de combinaison de l'IA et de la RA. Le projet vise à créer des lunettes AR élégantes, confortables et puissantes, capables de fournir aux utilisateurs une traduction en temps réel, une mémoire de localisation, une lecture de texte et d'autres fonctions pratiques, et de s'intégrer de manière transparente aux appareils Android.

Dans sa dernière présentation, Google a dévoilé le projet Astra, l'effort de l'équipe DeepMind visant à créer des agents d'IA multimodaux en temps réel fonctionnant sur un mystérieux prototype de paire de lunettes. Mercredi, Google a annoncé qu'il présenterait les prototypes de lunettes équipés de capacités d'IA et de RA à un petit nombre d'utilisateurs sélectionnés pour des tests dans le monde réel.

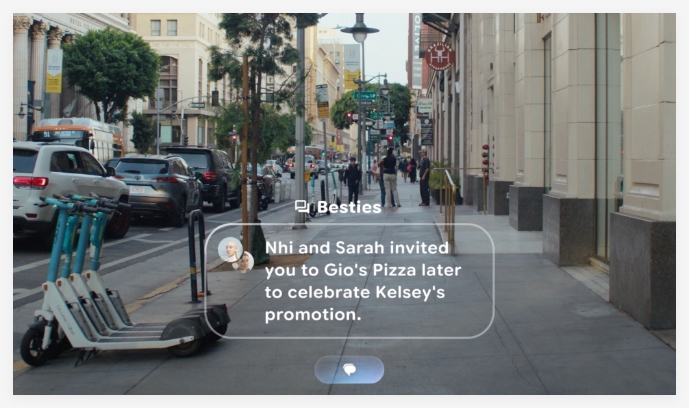

Démonstration de la fonctionnalité de traduction sur le prototype de Google Glass

Ces lunettes sont alimentées par le système d'exploitation Android XR, une nouvelle plate-forme créée par Google pour l'informatique visuelle et conçue pour prendre en charge le développement de lunettes, d'écouteurs et d'autres appareils. Google a révélé que même si les lunettes ont l'air très cool, elles ne sont actuellement qu'une démonstration technologique, et l'heure de sortie spécifique du produit et les détails n'ont pas encore été annoncés.

Les fonctions des nouvelles lunettes incluent la traduction en temps réel, la localisation en mémoire et la possibilité de lire du texte sans téléphone portable, etc., démontrant le fort potentiel de la combinaison de l'IA et de la RA. Google a déclaré que son objectif futur était de créer des lunettes plus élégantes et plus confortables qui fonctionnent de manière transparente avec les appareils Android et fournissent un support d'informations telles que des directions, des traductions et des résumés de messages par simple contact.

Démo du prototype des Google Glass

La vision de Google est à la pointe du domaine des lunettes AR, en particulier sa technologie Project Astra, qui offre des capacités d'IA multimodales plus puissantes que les technologies existantes. Google a également déclaré que le système d'IA des lunettes peut traiter les images environnementales et les entrées vocales en temps réel pour aider les utilisateurs à accomplir leurs tâches. Bien que le projet Astra soit actuellement limité aux applications de téléphonie mobile, son potentiel d’application futur dans les lunettes AR est énorme.

Par rapport aux lunettes AR de Meta et Snap, le projet Astra de Google pourrait avoir un plus grand avantage dans le domaine de l’IA multimodale. Bien qu’elle soit encore en phase de développement, la technologie de Google pourrait apporter de nouvelles avancées dans l’avenir des lunettes AR.

L'émergence du projet Astra annonce l'innovation dans le domaine des lunettes AR, et ses puissantes fonctions d'IA multimodales offriront aux utilisateurs une expérience plus intelligente et plus pratique. Même s’il reste encore du chemin à parcourir avant le lancement officiel, la force technique de Google a indiqué la direction du développement futur des lunettes AR. Attendez-vous à d’autres surprises de Google à l’avenir.