OpenAI a annoncé que le mode vocal avancé de ChatGPT a été visualisé. Les utilisateurs abonnés à Plus, Team ou Pro peuvent interagir avec ChatGPT en temps réel via les caméras de leur téléphone mobile et disposer de fonctionnalités de partage d'écran. Cette fonctionnalité a été retardée à plusieurs reprises auparavant et a finalement été officiellement lancée après une longue période de tests. Cependant, tous les utilisateurs ne peuvent pas l'utiliser immédiatement. Certaines régions et types d'utilisateurs devront attendre jusqu'en janvier de l'année prochaine, voire plus.

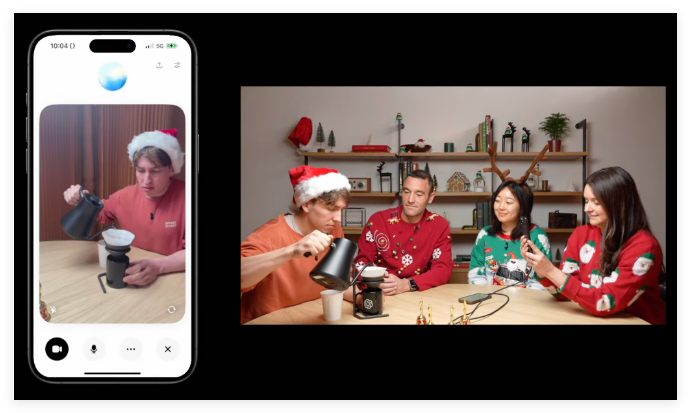

OpenAI a annoncé jeudi que la fonctionnalité de conversation de type humain « Advanced Speech Mode » développée pour ChatGPT avait été visualisée. Les utilisateurs abonnés à ChatGPT Plus, Team ou Pro peuvent désormais pointer la caméra de leur téléphone vers un objet et ChatGPT répondra en temps quasi réel.

Ce mode vocal avancé doté de fonctionnalités de vision propose également des capacités de partage d'écran qui analysent le contenu sur l'écran de l'appareil. Par exemple, il peut expliquer divers menus de paramètres et fournir des conseils sur des problèmes mathématiques.

La méthode d'utilisation est très simple : cliquez sur l'icône vocale à côté de la barre de discussion ChatGPT, puis cliquez sur l'icône vidéo dans le coin inférieur gauche pour démarrer la vidéo. Si vous souhaitez partager votre écran, vous pouvez cliquer sur le menu à trois points et sélectionner « Partager l'écran ».

Concernant le déploiement des fonctionnalités, OpenAI a déclaré que le mode vocal avancé avec vision sera déployé à partir de jeudi et se terminera la semaine prochaine. Il est important de noter que cette fonctionnalité ne sera pas immédiatement disponible pour tous les utilisateurs. Les utilisateurs de ChatGPT Enterprise et Edu devront attendre janvier de l'année prochaine, tandis que les utilisateurs de l'UE, de Suisse, d'Islande, de Norvège et du Liechtenstein n'ont pas encore annoncé de calendrier précis.

Lors d'une récente apparition dans l'émission « 60 Minutes » de CNN, le président d'OpenAI, Greg Brockman, a démontré à Anderson Cooper des capacités avancées d'analyse visuelle des modèles de parole. Lorsque Cooper dessinait des parties du corps humain au tableau, ChatGPT était capable de comprendre et de commenter ses dessins. Par exemple, il indique que le cerveau est positionné avec précision et suggère que la forme du cerveau est plus proche d’une ellipse.

Cependant, lors de la démonstration, ce mode de parole avancé a également révélé certaines imprécisions concernant des problèmes géométriques, montrant le risque potentiel d'« hallucinations ».

Il convient de mentionner que ce mode vocal avancé doté de fonctionnalités visuelles a été retardé à plusieurs reprises. En avril, OpenAI a promis qu'il serait lancé « d'ici quelques semaines », mais a déclaré plus tard qu'il lui faudrait plus de temps. Cette fonctionnalité n'était disponible pour certains utilisateurs de ChatGPT qu'au début de l'automne, et la fonction d'analyse visuelle n'était pas encore disponible à ce moment-là.

Dans un contexte de concurrence croissante dans le domaine de l’intelligence artificielle, des concurrents tels que Google et Meta développent également des capacités similaires. Cette semaine, Google a ouvert son projet d'intelligence artificielle conversationnelle d'analyse vidéo en temps réel, Project Astra, à certains testeurs Android.

En plus des fonctionnalités visuelles, OpenAI a également lancé jeudi un « Mode Père Noël » festif, permettant aux utilisateurs d'activer la voix du Père Noël via l'icône en forme de flocon de neige à côté de la barre de notification dans l'application ChatGPT.

Cette mise à jour visuelle du mode vocal avancé de ChatGPT marque une amélioration de la capacité de l’IA à interagir avec le monde réel, mais elle expose également les défis et les limites du développement technologique. À l’avenir, l’amélioration et la vulgarisation de fonctions similaires méritent d’être attendues. Les progrès de la technologie de l’IA continueront d’affecter notre mode de vie.