La conception architecturale des grands modèles de langage (LLM) subit de profonds changements et la domination de l'architecture Transformer est confrontée à des défis. Pour relever ce défi, Liquid AI, une startup incubée au MIT, a lancé un framework innovant appelé STAR (Synthesis of Tailored Architectures), qui vise à générer et optimiser automatiquement l'architecture des modèles d'IA. Le framework STAR utilise des algorithmes évolutifs et une technologie de codage hiérarchique pour synthétiser et optimiser des architectures de modèles basées sur des performances et des exigences matérielles spécifiques, présentant des avantages significatifs en termes d'efficacité et de performances.

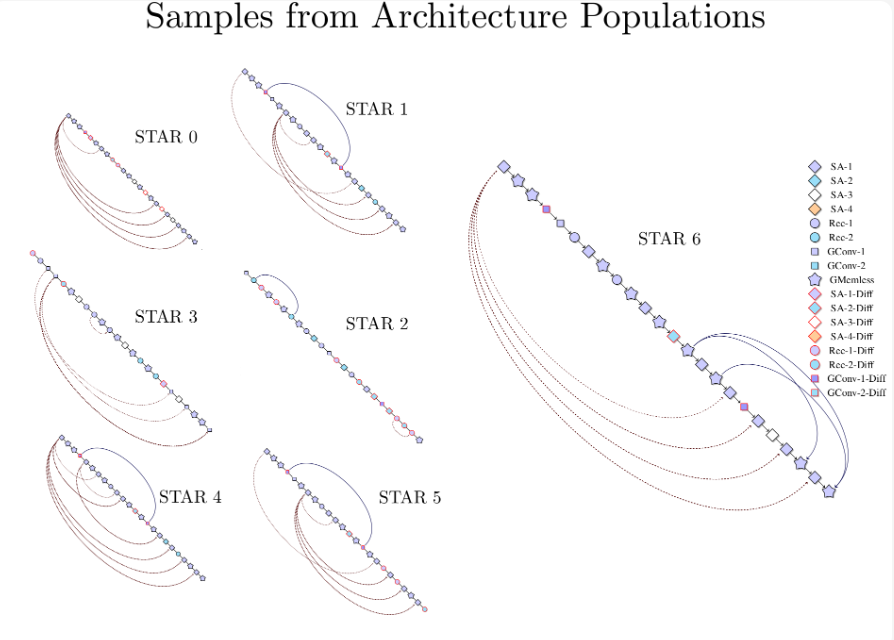

Le framework STAR utilise des algorithmes évolutifs et des systèmes de codage numérique pour automatiser la génération et l'optimisation des architectures de modèles d'intelligence artificielle. L’équipe de recherche de Liquid AI a noté que l’approche de conception de STAR diffère de la conception d’architecture traditionnelle en utilisant une technique de codage hiérarchique appelée « STAR Genome » pour explorer un large espace de conception d’architectures potentielles. Grâce à la combinaison et à la mutation du génome, STAR est capable de synthétiser et d'optimiser des architectures qui répondent à des exigences spécifiques en matière de performances et de matériel.

Dans les tests ciblant la modélisation de langage autorégressive, STAR a montré des performances supérieures aux modèles Transformer++ et hybrides optimisés traditionnels. En termes de qualité d'optimisation et de taille de cache, l'architecture évoluée de STAR réduit la taille du cache jusqu'à 37 % par rapport au modèle hybride et atteint une réduction de 90 % par rapport au Transformer traditionnel. Cette efficacité ne sacrifie pas les performances prédictives du modèle, mais surpasse dans certains cas ses concurrents.

La recherche montre également que l'architecture de STAR est hautement évolutive, avec un modèle évolutif STAR passant de 125 millions de paramètres à 1 milliard de paramètres fonctionnant sur des tests de référence standard aussi bien ou mieux que les modèles Transformer++ et hybrides existants, tout en réduisant considérablement les besoins de raisonnement en matière de mise en cache.

Liquid AI a déclaré que le concept de conception de STAR intègre les principes des systèmes dynamiques, du traitement du signal et de l'algèbre linéaire numérique pour créer un espace de recherche d'unités informatiques flexible. Une caractéristique unique de STAR est sa conception modulaire, qui lui permet d'encoder et d'optimiser des architectures à plusieurs niveaux, offrant ainsi aux chercheurs la possibilité d'avoir un aperçu des combinaisons efficaces de composants architecturaux.

Liquid AI estime que les capacités efficaces de synthèse d'architecture de STAR seront appliquées dans divers domaines, en particulier dans les scénarios où la qualité et l'efficacité informatique doivent être équilibrées. Bien que Liquid AI n’ait pas annoncé de déploiement commercial ni de plans tarifaires spécifiques, les résultats de ses recherches marquent une avancée majeure dans le domaine de la conception d’architecture automatisée. À mesure que le domaine de l’IA continue d’évoluer, des cadres tels que STAR pourraient jouer un rôle important dans l’élaboration de la prochaine génération de systèmes intelligents.

Blog officiel : https://www.liquid.ai/research/automated-architecture-synthesis-via-targeted-evolution

Dans l'ensemble, le framework STAR de Liquid AI fournit une nouvelle méthode automatisée pour la conception d'architecture de modèles d'IA. Ses avancées en termes d'efficacité et de performances sont d'une grande importance et offrent de nouvelles possibilités pour le développement de futurs systèmes d'IA. La conception modulaire et l'évolutivité du framework lui confèrent également de larges perspectives d'application dans différents domaines.