Un dialogue homme-machine fluide est un objectif important dans le domaine de l'intelligence artificielle. Cependant, l'IA a souvent du mal à juger de la « fin du cycle », ce qui se traduit par une mauvaise expérience de conversation. Les utilisateurs sont souvent confrontés à des interruptions de l'IA ou à des retards de réponse, ce qui affecte sérieusement l'efficacité et le naturel de l'interaction homme-machine. Les méthodes traditionnelles de détection d'activité vocale (VAD) sont trop simples, facilement affectées par le bruit ambiant et les pauses de l'utilisateur, et ne peuvent pas déterminer avec précision la fin d'une conversation.

Dans le monde du dialogue homme-machine, la chose la plus gênante est : « Avez-vous fini de parler ? » Cette phrase peut sembler simple, mais elle est devenue un obstacle que d'innombrables assistants vocaux et robots du service client ne peuvent pas surmonter. Rencontrez-vous souvent cette situation : vous avez juste fait une pause pour réfléchir à ce que vous allez dire ensuite, mais l'IA a hâte de répondre ou vous avez clairement fini de parler, mais l'IA attend toujours ; bêtement, jusqu'à ce que vous ne puissiez pas vous empêcher de dire "j'ai fini" et que cela ne réagisse pas. Cette expérience est tout simplement folle.

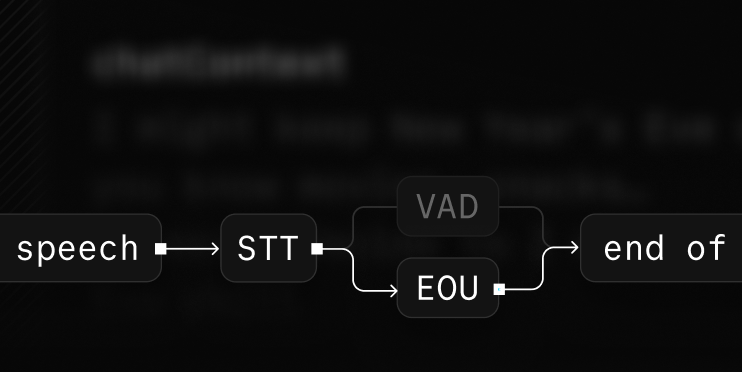

Ce n'est pas parce que l'IA cause délibérément des problèmes, mais parce que lorsqu'elle juge la « fin de tour » (EOT), elle est comme une « personne aveugle » qui ne peut qu'entendre s'il y a un son, mais ne peut pas le comprendre. si vous avez un son ou pas. Pas encore fini. La méthode traditionnelle repose principalement sur la détection d'activité vocale (VAD), qui est comme un « commutateur activé par la voix ». Elle ne fait attention qu'à la présence d'un signal vocal. Tant qu'il n'y a pas de son, il sera jugé que vous êtes là. avez fini de parler. Cela peut-il être gêné par des pauses et des bruits de fond ? C'est tout simplement trop « simple » !

Cependant, récemment, une société appelée Livekit n’en pouvait plus et a décidé d’installer un « cerveau » plus intelligent sur l’IA. Ils ont développé un modèle open source précis de détection de tour de parole. Ce modèle est comme un véritable maître de « lecture dans les pensées » et peut déterminer avec précision si vous avez fini de parler. Il ne s'agit pas d'un simple « interrupteur à commande vocale », mais d'un « assistant intelligent » capable de comprendre l'intention de vos mots !

L'avantage du modèle Livekit est qu'il ne se base pas simplement sur "l'existence ou non du son", mais combine le modèle Transformer avec la détection d'activité vocale (VAD) traditionnelle. C’est comme équiper l’IA d’un « super cerveau » et d’une « oreille ». Le « Shunfeng Ear » est chargé de surveiller s'il y a des sons, tandis que le « Super Brain » est chargé d'analyser la sémantique de ces sons pour comprendre si vos mots sont complets et s'il y a un sens inachevé. La puissante combinaison de ces deux éléments peut véritablement permettre une « détection de fin de cycle » précise.

Que peut faire ce modèle ? Il permet aux partenaires IA tels que les assistants vocaux et les robots du service client de déterminer plus précisément si vous avez fini de parler avant de commencer à vous répondre. Cela améliorera sans aucun doute grandement la fluidité et le naturel du dialogue homme-machine. Lorsque vous discuterez avec l'IA à l'avenir, vous n'aurez plus à vous soucier d'être « volé » ou de « faire semblant d'être stupide » !

Afin de prouver sa force, Livekit a également montré les résultats de ses tests : son nouveau modèle peut réduire de 85 % les « mauvaises interruptions » de l'IA. Cela signifie que l'IA devient plus naturelle et moins sujette aux erreurs de jugement, et les conversations humaines au téléphone sont également devenues ! plus doux et plus agréable. Pensez-y, lorsque vous appellerez le service client à l'avenir, vous ne serez plus contrarié par les réponses mécaniques de l'IA, mais pourrez être aussi à l'aise que de discuter avec une vraie personne. Cette expérience est tout simplement incroyable !

De plus, ce modèle est particulièrement adapté aux scénarios nécessitant un dialogue homme-machine, tels que le service client vocal, les robots intelligents de questions et réponses, etc. Livekit a également montré une vidéo de démonstration. L'agent IA dans la vidéo, après avoir reçu la question de l'utilisateur, attendra patiemment que l'utilisateur ait terminé toutes les informations avant de donner la réponse correspondante. C'est comme une « personne intime » qui comprend vraiment vos besoins. Il n'interviendra pas avant que vous ayez fini de parler, et il ne restera pas non plus « abasourdi » lorsque vous avez fini de parler.

Bien entendu, ce modèle est encore au stade open source et il reste encore beaucoup à améliorer. Mais nous avons des raisons de croire qu’avec le développement continu de la technologie, les futures conversations homme-machine deviendront plus naturelles, fluides et intelligentes. Peut-être qu'un jour, nous oublierons vraiment que nous parlons d'une machine froide, mais d'un « partenaire IA » qui vous comprend vraiment.

Adresse du projet : https://github.com/livekit/agents/tree/main/livekit-plugins/livekit-plugins-turn-detector

Le modèle open source de Livekit fournit de nouvelles idées pour résoudre le problème de la « fin de tour » dans le dialogue homme-machine, marquant ainsi une étape vers une expérience d'interaction homme-machine plus naturelle et plus fluide. Nous attendons avec impatience l'amélioration et l'application futures de ce modèle pour offrir aux utilisateurs une expérience de conversation homme-machine plus pratique et plus intelligente.