Zhipu AI a open source son modèle CogAgent-9B basé sur la formation GLM-4V-9B. Il s'agit d'un modèle de tâche d'agent qui peut comprendre les instructions de l'utilisateur via des captures d'écran et prédire la prochaine opération de l'interface graphique. Ce modèle a une forte universalité et convient à divers scénarios d'interaction GUI tels que les ordinateurs personnels, les téléphones mobiles et les voitures. Par rapport à la version précédente, CogAgent-9B-20241220 a été considérablement amélioré à bien des égards, prend en charge les langues bilingues chinois et anglais et peut produire des processus de réflexion détaillés, des descriptions d'actions et des jugements de sensibilité. Il a obtenu des résultats de premier plan sur plusieurs ensembles de données, démontrant ses avantages en matière de positionnement GUI et d'opérations en une seule et plusieurs étapes. Le CogAgent-9B open source favorise non seulement le développement de la technologie des grands modèles, mais offre également de nouvelles possibilités aux malvoyants.

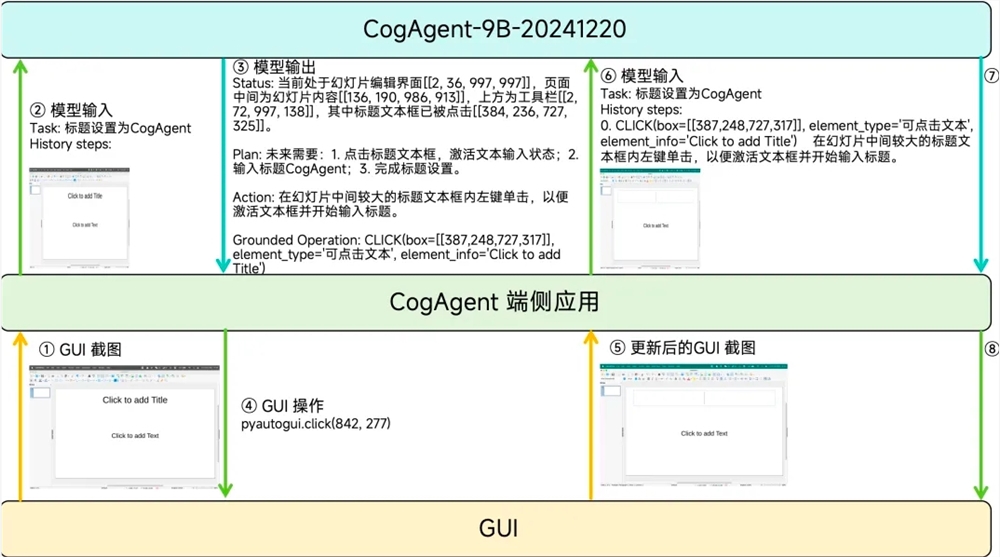

Par rapport à la première version du modèle CogAgent qui était open source en décembre 2023, CogAgent-9B-20241220 s'est considérablement amélioré en termes de perception de l'interface graphique, de précision de prédiction d'inférence, d'exhaustivité de l'espace d'action, d'universalité des tâches et de généralisation et prend en charge les captures d'écran et le langage bilingues. interaction en chinois et en anglais. L'entrée de CogAgent inclut uniquement les instructions en langage naturel de l'utilisateur, les enregistrements d'actions historiques exécutées et les captures d'écran de l'interface graphique, sans aucune représentation textuelle des informations de mise en page ou des informations supplémentaires sur les étiquettes des éléments. Le résultat couvre le processus de réflexion, la description en langage naturel de l'action suivante, la description structurée de l'action suivante et le jugement de sensibilité de l'action suivante.

Lors du test de performances, CogAgent-9B-20241220 a obtenu des résultats de premier plan sur plusieurs ensembles de données, démontrant ses avantages en termes de positionnement de l'interface graphique, d'opérations en une seule étape, de listes par étapes chinoises et d'opérations en plusieurs étapes. Cette initiative de Smart Spectrum Technology favorise non seulement le développement de la technologie des grands modèles, mais offre également de nouveaux outils et possibilités aux informaticiens malvoyants.

Code:

https://github.com/THUDM/CogAgent

Modèle:

Visage câlin : https://huggingface.co/THUDM/cogagent-9b-20241220

Communauté Cogagent : https://modelscope.cn/models/ZhipuAI/cogagent-9b-20241220

L'open source de CogAgent-9B marque une étape importante dans l'écosystème d'agents à grande échelle. Ses capacités d'interaction GUI efficaces et sa large applicabilité ouvrent une nouvelle direction pour le développement futur de la technologie d'interaction intelligente et annoncent également l'arrivée de futurs scénarios d'application plus pratiques et plus intelligents. Nous sommes impatients de voir des applications plus innovantes basées sur CogAgent-9B.