Dans le domaine de l'intelligence artificielle, un raisonnement de modèle efficace est essentiel. Les développeurs explorent constamment des méthodes pour exécuter de grands modèles de langage sur différentes plates-formes matérielles. Récemment, le développeur Andrei David a fait une réalisation remarquable: il a réussi à transplanter le modèle Meta AI Llama 2 à une console de jeu Xbox 360 de près de 20 ans. Cela a surmonté de nombreux défis tels que l'architecture PowerPC, les restrictions de mémoire et la conversion Endian, et offre une expérience précieuse pour gérer de grands modèles de langage dans des environnements de ressources faibles.

Aujourd'hui, avec le développement rapide de la technologie de l'intelligence artificielle, comment réaliser un raisonnement de modèle efficace dans divers matériel est devenu un défi important pour les développeurs. Récemment, le développeur Andrei David s'est inspiré de près de 20 ans de consoles de jeu Xbox360.

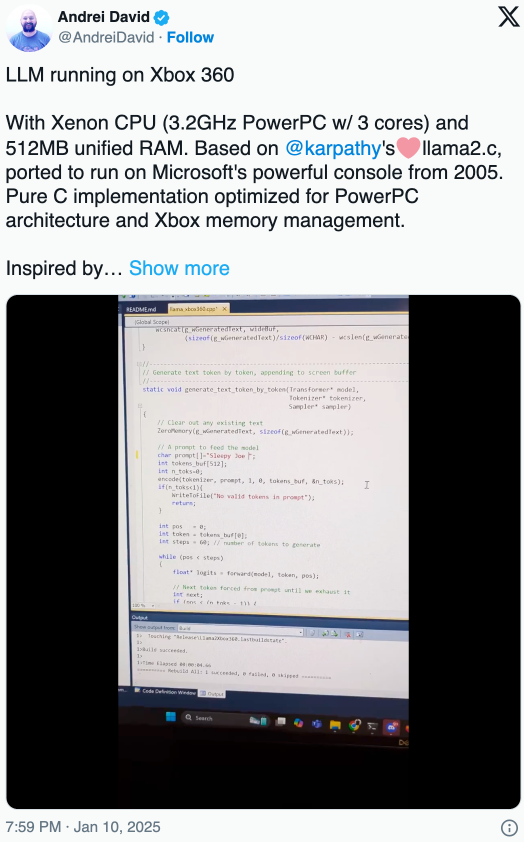

David a partagé ses réalisations sur la plate-forme de médias sociaux X, affirmant que les défis auxquels il était confronté était énorme. Le processeur PowerPC de Xbox360 utilise l'architecture Big-Endan, ce qui signifie que lorsque la configuration et le poids du modèle sont chargés, un grand nombre de conversion endian doit être effectuée. De plus, David doit également être ajusté et optimisé en profondeur du code d'origine afin qu'il puisse fonctionner en douceur sur un tel matériel vieillissant.

La gestion de la mémoire est également un problème majeur qu'il doit résoudre. La taille du modèle LLAMA2 atteint 60 Mo, et l'architecture de mémoire de Xbox360 est une mémoire unifiée, ce qui signifie que le CPU et le GPU doivent partager la même mémoire. Cela rend David très prudent lors de la conception de la mémoire. Il pense que bien que la limite de mémoire de la Xbox360 soit très en avant à l'époque, son architecture était très en avant, indiquant la technologie de gestion de la mémoire standard des consoles de jeux modernes et des APU.

Après le codage et l'optimisation répétés, David a finalement réussi le modèle LLAMA2 sur la Xbox360, juste une simple invite: "Sleeping Joe a déclaré". Il convient de mentionner que le modèle LLAMA2 ne comporte que 700 lignes de code C et aucune dépendance externe, ce qui le fait montrer des performances "surprenantes" sous la personnalisation de champs spécifiques.

Pour d'autres développeurs, le succès de David leur a donné une nouvelle direction. Certains utilisateurs ont suggéré que la mémoire de 512 Mo de la Xbox360 peut également prendre en charge la mise en œuvre d'autres petits LLM, tels que Smollm développé par Hugging Face. David accueille cela.

Les cas réussis de David fournissent de nouvelles idées et inspirations aux développeurs, ce qui prouve que même sur l'appareil avec des ressources limitées, ils peuvent également exécuter de grands modèles de langage grâce à une optimisation intelligente et à un ajustement du code. Cela promeut non seulement le développement ultérieur de la technologie de l'intelligence artificielle dans le domaine de l'informatique Edge, mais offre également des possibilités illimitées pour des applications plus innovantes à l'avenir. À l'avenir, nous sommes impatients de voir des percées plus similaires et d'amener une technologie d'intelligence artificielle dans un plus large éventail de scénarios d'application.