L'équipe Hugging Face a publié deux modèles AI légers: SMOLVLM-256M et SMOLVLM-500M, avec des paramètres de 256 millions et 500 millions respectivement. Ces deux modèles conviennent particulièrement aux appareils avec moins de 1 Go de mémoire, fournissant aux développeurs des solutions de traitement de données à faible coût et à haute efficacité. Ses performances efficaces dépassent de nombreux modèles à plus grande échelle dans diverses références, en particulier pour traiter les tableaux des sciences des écoles primaires, démontrant son énorme potentiel dans l'éducation et la recherche.

Récemment, l'équipe de Hugging Face, une plate-forme de développement de l'intelligence artificielle, a publié deux nouveaux modèles d'IA, SMOLVLM-256M et SMOLVLM-500M. Ils affirment avec confiance que les deux modèles sont de loin les plus petits modèles d'IA capables de traiter simultanément des images, des vidéos courtes et des données texte, en particulier adaptées aux appareils avec moins de 1 Go de mémoire, comme les ordinateurs portables. Cette innovation permet aux développeurs d'atteindre une efficacité plus élevée à un coût plus faible lors du traitement de grandes quantités de données.

Les paramètres de ces deux modèles sont respectivement de 256 millions et 500 millions, ce qui signifie que leur capacité à résoudre les problèmes s'est également améliorée en conséquence. Les tâches que la série SmolVLM peuvent effectuer comprennent la description d'images ou de clips vidéo et de répondre aux questions sur les documents PDF et leur contenu, tels que la numérisation du texte et des graphiques. Cela leur fait avoir un large éventail de perspectives d'application dans de nombreux domaines tels que l'éducation et la recherche.

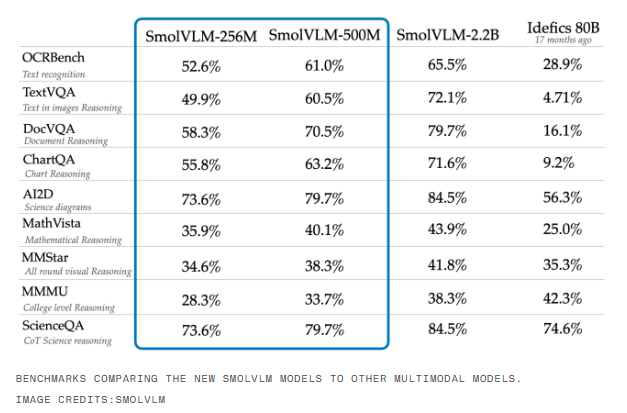

Au cours de la formation du modèle, l'équipe d'étreinte FACE HUGGING a exploité 50 ensembles de données d'image et de texte de haute qualité appelés "The Cauldron", ainsi que des analyses de fichiers et des ensembles de données d'appariement détaillés appelés Docmatix. Les deux ensembles de données ont été développés par l'équipe M4 de Huging Face et se sont concentrés sur le développement de la technologie d'IA multimodale. Il convient de noter que les SmolVLM-256M et SMOLVLM-500M surpassent de nombreux modèles plus grands dans divers tests de référence, tels que les IDEFICS80B, et en particulier dans les tests AI2D, ils effectuent de façon surprenante la capacité à analyser les charts scientifiques pour les étudiants des écoles primaires.

Cependant, bien qu'abordable et polyvalent, les petits modèles peuvent ne pas fonctionner ainsi que de grands modèles sur des tâches d'inférence complexes. Une étude de Google Deepmind, du Microsoft Research Institute et du Mila Institute de Québec a montré que de nombreux petits modèles se sont effectués de manière décevante sur ces tâches complexes. Les chercheurs spéculent que cela peut être dû à la tendance des petits modèles à identifier les caractéristiques de surface des données, et ils semblent sans scrupules lors de l'application de ces connaissances dans de nouvelles situations.

La famille de modèles Smolvlm de Hugging Face est non seulement de petits outils d'IA, mais présentent également des capacités impressionnantes lorsqu'ils traitent de diverses tâches. C'est sans aucun doute un bon choix pour les développeurs qui souhaitent obtenir un traitement efficace des données à faible coût.

L'émergence de la série de modèles Smolvlm a apporté de nouvelles possibilités pour les applications d'IA légères. Bien qu'il y ait encore place à l'amélioration des tâches complexes, son faible seuil et son efficacité élevée en font un choix que de nombreux développeurs méritent l'attention. À l'avenir, nous sommes impatients de voir l'application et une optimisation plus approfondie des modèles de la série Smolvlm dans plus de champs.