Hugging Face a publié le superbe modèle de langage visuel léger Smolvlm, qui est de petite taille et peut fonctionner sur de petits appareils tels que les téléphones mobiles, mais ses performances dépassent le modèle IDEFICS80B plus grand 300 fois. Cette progression révolutionnaire marque l'avancement des applications d'IA vers une ère de déploiement plus large et à moindre coût, ce qui permet d'économiser les entreprises de nombreux coûts informatiques et d'améliorer l'efficacité du traitement. L'émergence de Smolvlm offre une opportunité sans précédent pour les petites entreprises et les startups de développer rapidement des applications de vision informatique complexes à moindre coût.

Hugging Face a lancé un modèle d'IA remarquable - Smolvlm. Ce modèle de langage visuel est suffisamment petit pour fonctionner sur de petits appareils tels que les téléphones mobiles et surpasse les prédécesseurs qui nécessitent le support des grands centres de données.

L'exigence de mémoire GPU du modèle SMOLVLM-256M est inférieure à 1 Go, mais ses performances dépassent son modèle prédécesseur IDEFICS80B, qui est 300 fois plus grand que sa taille, marquant une avance significative dans le déploiement pratique de l'IA.

Selon Andres Malafiotti, ingénieur de recherche sur l'apprentissage automatique chez Hugging Face, le modèle Smolvlm apporte également des réductions de coûts informatiques importantes aux entreprises pendant qu'il est introduit sur le marché. "L'IDEFICS80B que nous avons précédemment publié était le premier modèle de langue vidéo open source en août 2023, tandis que le lancement de Smolvlm a réalisé une réduction de 300 fois en taille et en amélioration des performances."

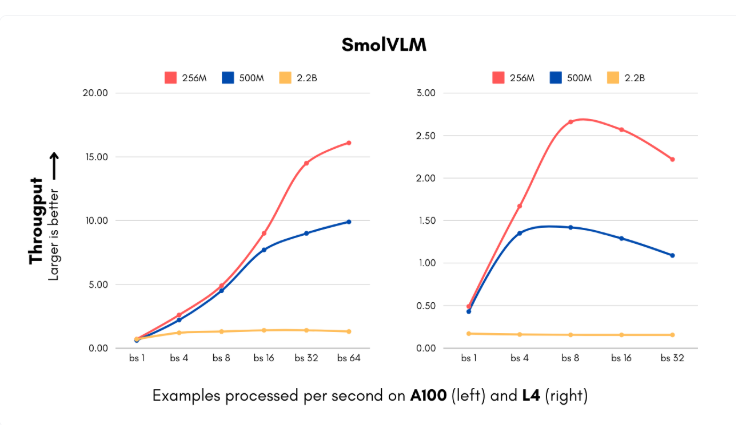

Le lancement du modèle SMOLVLM coïncide avec un moment critique lorsque les entreprises sont confrontées à des coûts informatiques élevés dans la mise en œuvre des systèmes d'IA. Le nouveau modèle comprend deux échelles de paramètres, 256 m et 500 m, permettant de traiter des images et un contenu visuel à des vitesses auparavant impensables. La version minimale peut traiter jusqu'à 16 instances par seconde et ne nécessite que 15 Go de mémoire, ce qui le rend particulièrement adapté aux entreprises qui doivent traiter de grandes quantités de données visuelles. Pour les entreprises de taille moyenne qui traitent 1 million de photos par mois, cela signifie des économies de coûts informatiques annuelles considérables.

De plus, IBM a également atteint un partenariat avec Hugging Face pour intégrer le modèle 256m dans son logiciel de traitement de document Doculing. Bien que IBM ait des ressources informatiques abondantes, l'utilisation de modèles plus petits le rend efficace pour traiter des millions de fichiers à moindre coût.

L'équipe Hugging Face a réussi à réduire la taille du modèle sans perdre des performances grâce à des innovations technologiques dans le traitement visuel et les composants du langage. Ils ont remplacé le codeur visuel de paramètre 400m d'origine par une version de paramètre de 93 m et ont implémenté une technologie de compression de jetons plus agressive. Ces innovations permettent aux petites entreprises et aux startups de lancer des produits de vision informatique complexes en peu de temps, et les coûts d'infrastructure sont considérablement réduits.

L'ensemble de données de formation de Smolvlm contient 170 millions d'exemples de formation, dont près de la moitié sont utilisés pour le traitement des documents et l'annotation de l'image. Ces développements réduisent non seulement les coûts, mais apportent également de nouvelles possibilités d'application aux entreprises, augmentant leurs capacités de recherche visuelle à un niveau sans précédent.

Cette avancée en étreignant les étreintes défie les perceptions traditionnelles de la relation entre la taille du modèle et la capacité. SMOLVLM prouve que des architectures petites et efficaces peuvent également obtenir d'excellentes performances.

Modèle: https://huggingface.co/blog/smolevlm

Points:

Le modèle Smolvlm lancé en étreignant la face peut fonctionner sur des téléphones mobiles et a une performance de plus de 300 fois plus grande que le modèle IDEFICS80B.

Le modèle SMOLVLM aide les entreprises à réduire considérablement les coûts informatiques, avec des vitesses de traitement de 16 instances par seconde.

Les innovations technologiques de ce modèle permettent aux petites entreprises et aux startups de lancer des produits de vision informatique complexes en peu de temps.

L'émergence de Smolvlm indique que les applications d'IA deviendront plus populaires, et les petites entreprises et les développeurs individuels peuvent facilement utiliser une technologie d'IA puissante pour promouvoir l'innovation et le développement de l'intelligence artificielle dans plus de domaines. Ses caractéristiques légères et hautes performances modifieront sans aucun doute notre compréhension des modèles d'intelligence artificielle et indiqueront une nouvelle voie pour la direction de développement futur de la technologie de l'IA.