Meta Fair Lab a récemment publié une technologie de perception tactile multimodale révolutionnaire appelée "SPARSH", qui devrait révolutionner complètement le domaine de la manipulation du robot. Le modèle SPARSH utilise l'apprentissage auto-supervisé pour pré-entraîner plus de 460 000 images tactiles et apprendre des représentations tactiles générales sans étiquetage manuel des données, réalisant la capacité de perception tactile du robot similaire aux humains. Il est compatible avec une variété de capteurs haptiques visuels et fonctionne bien dans plusieurs tâches telles que l'estimation de la force et la détection de glissement, en particulier lorsque les données sont limitées, ses performances dépassent de loin celles des modèles traditionnels.

Le modèle SPARSH adopte l'apprentissage auto-supervisé, en utilisant plus de 460 000 images tactiles pour la pré-formation et apprend des représentations tactiles générales sans étiquetage manuel des données.

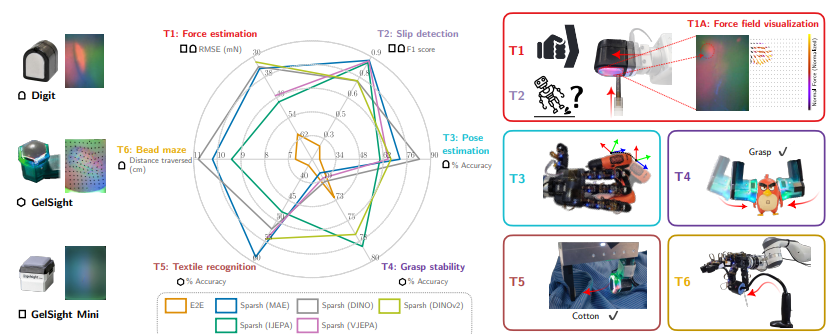

Le modèle est capable de prendre en charge une variété de types de capteurs haptiques visuels, notamment Digit, Gelsight2017 et Gelsight Mini, et améliore considérablement les performances des robots sur les tâches de perception tactile telles que l'estimation de la force, la détection de glissement, l'estimation de la pose, la prédiction de stabilité et l'identification du tissu, etc. Les chercheurs ont également construit une plate-forme d'analyse comparative standardisée appelée Tacbench pour évaluer les performances de différents capteurs haptiques et modèles sur diverses tâches.

Les résultats des tests montrent que le modèle SPARSH fonctionne bien dans les six tâches de Tacbench, en particulier lorsque le volume de données est limité, et ses performances sont bien au-delà des modèles traditionnels spécifiques à la tâche et spécifiques au capteur. Par exemple, dans l'estimation en force et les tâches de détection de glissement, le modèle SPARSH peut obtenir des résultats satisfaisants même si seulement 1% des données d'annotation sont utilisées. Cela signifie que SPARSH peut aider les robots à mieux comprendre les propriétés physiques des objets et à effectuer une manipulation plus raffinée.

La libération du modèle SPARSH marque une percée majeure dans le domaine de la perception haptique de l'IA. À l'avenir, avec l'accumulation de plus de données et l'optimisation plus approfondie des modèles, SPARSH devrait changer complètement la façon dont les robots interagissent avec le monde physique et favorisent l'application de la robotique dans une gamme plus large de domaines.

Adresse papier:

https://scontent-sjc3-1.xx.fbcdn.net/v/t39.2365-6/464969941_1107633400780143_7479102347328147009_n.pdf?_nc_cat=103&ccb=1-7&k nc_ohc = y8ui1hew3bqq7knvgfe-epu & _nc_zt = 14 & _nc_ht = scontent-sjc3-1. xx & _nc_gid = aeafSuzzasvwpfmqseozqu & oh = 00_ayamqxgq0atcysdxzwb0zt8bgskogymj13c9f3ytvtkmsg & oe = 672deee4

L'émergence de la technologie SPARSH indique que la technologie robotique de perception haptique a atteint une nouvelle étape. Son potentiel dans la manipulation raffinée et l'interaction humaine-ordinateur est énorme, et ses futures perspectives d'application valent la peine d'être attendues.