L'équipe de Doubao Big Model de ByTedance a récemment fait une percée majeure et a développé avec succès une nouvelle architecture de modèle clairsemé Ultramem. Cette architecture résout de manière innovante le problème de l'accès à la mémoire de grande valeur dans l'inférence du modèle MOE, améliorant considérablement la vitesse et l'efficacité d'inférence et réduisant le coût d'inférence. Tout en garantissant l'effet du modèle, Ultramem a augmenté la vitesse d'inférence de 2 à 6 fois par rapport au MOE, et le coût d'inférence peut être réduit jusqu'à 83%, fournissant une nouvelle solution pour une inférence efficace de grands modèles et jetant les bases de la construction de la construction Modèles à plus grande échelle.

L'équipe ByTedance Doubao Big Model a annoncé aujourd'hui qu'elle a développé avec succès une nouvelle architecture de modèle clairsemé ultramem. que cela dans le MOE. Cette progression révolutionnaire ouvre de nouveaux chemins pour une inférence efficace des grands modèles.

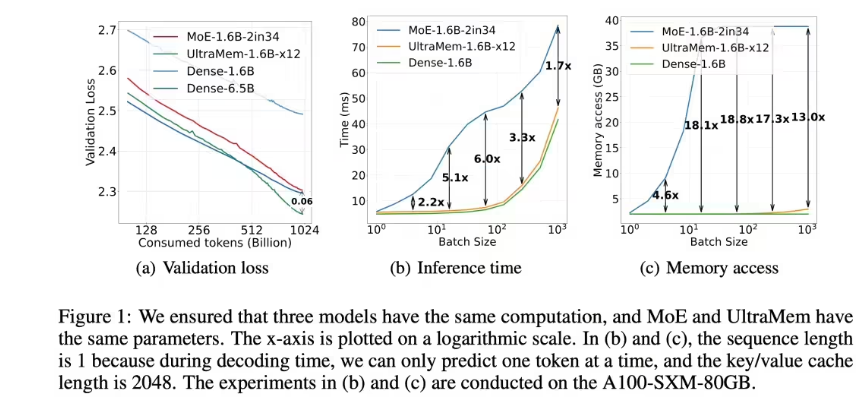

Sur le point de garantir l'effet du modèle, l'architecture UltrAmem a résolu avec succès le goulot d'étranglement d'accès à la mémoire dans l'inférence de l'architecture MOE. Les résultats expérimentaux montrent que dans les mêmes paramètres et conditions d'activation, Ultramem a non seulement l'effet du modèle meilleur que le MOE, mais augmente également la vitesse d'inférence de 2 à 6 fois. De plus, sous l'échelle de taille du lot commune, le coût d'accès à la mémoire d'Ultramem est presque équivalent à celui du modèle dense avec le même volume de calcul, réduisant considérablement le coût d'inférence.

L'équipe de recherche a formé le modèle Ultramem avec une échelle de 20 millions de personnes. Ce résultat vérifie les excellentes caractéristiques de mise à l'échelle de l'architecture Ultramem et jette les bases techniques pour construire des milliards de modèles de valeur ou d'experts.

Alors que l'ampleur des grands modèles continue de se développer, le coût et la vitesse d'inférence sont devenus les facteurs clés qui restreignent leur application. Bien que l'architecture MOE ait mis en œuvre le découplage informatique des paramètres, sa demande de mémoire élevée récupère pendant l'inférence entraîne une augmentation de la latence. La proposition d'architecture ultramem résout efficacement ce problème et fournit de nouveaux choix techniques pour l'application à grande échelle de grands modèles.

Le développement réussi de l'architecture UltrAMEM marque un progrès significatif dans la technologie d'inférence des grands modèles, fournit un solide support technique pour l'application généralisée de grands modèles à l'avenir, et indique également que l'ère des grands modèles est sur le point d'arriver. Ses excellentes performances et sa rentabilité conduiront l'application et le développement de grands modèles dans plus de domaines.