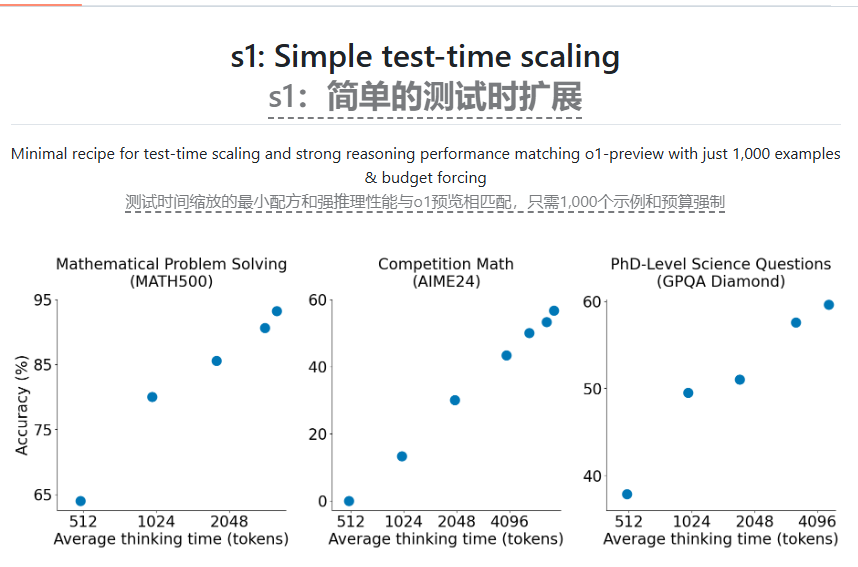

Récemment, des chercheurs de l'Université de Stanford et de l'Université de Washington ont réussi à former un modèle d'inférence de l'IA appelé S1, qui ne coûte que 50 $. Les performances du modèle dans les tests de capacité mathématique et de programmation sont comparables au modèle O1 d'OpenAI et au modèle R1 de Deepseek. Ce résultat a suscité de nouvelles réflexions sur la commercialisation des modèles d'IA et a également causé des préoccupations parmi les grands laboratoires d'IA.

L'équipe de recherche a extrait les capacités d'inférence requises du modèle de base prêt à l'emploi via la technologie de distillation et formé à l'aide du modèle expérimental de pensée flash GEMINI2.0 de Google. Ce processus est non seulement bon marché, mais aussi une formation rapide.

Néanmoins, les grands laboratoires AI ne sont pas satisfaits du phénomène des modèles de réplication à faible coût. Meta, Google et Microsoft prévoient d'investir des centaines de milliards de dollars au cours des deux prochaines années pour former des modèles d'IA de nouvelle génération pour consolider leur position sur le marché.

Les résultats de la recherche de S1 montrent la possibilité d'obtenir de fortes performances d'inférence grâce à des ensembles de données relativement petits et à des méthodes de réglage fin supervisées, qui fournit également de nouvelles directions pour la recherche future d'IA.

Papier: https://arxiv.org/pdf/2501.19393

CODE: https://github.com/simplescal/s1

Points clés:

Le coût de formation du modèle S1 est inférieur à 50 $ US, et ses performances sont comparables à celles des modèles d'inférence supérieurs.

Grâce à la technologie de distillation, l'équipe de recherche extrait les capacités de raisonnement à partir de modèles prêts à l'emploi, et le processus de formation est rapide et efficace.

Les grands laboratoires d'IA ont exprimé des inquiétudes quant à la situation des modèles de réplication à faible coût, et les investissements se concentreront sur les infrastructures d'IA à l'avenir.