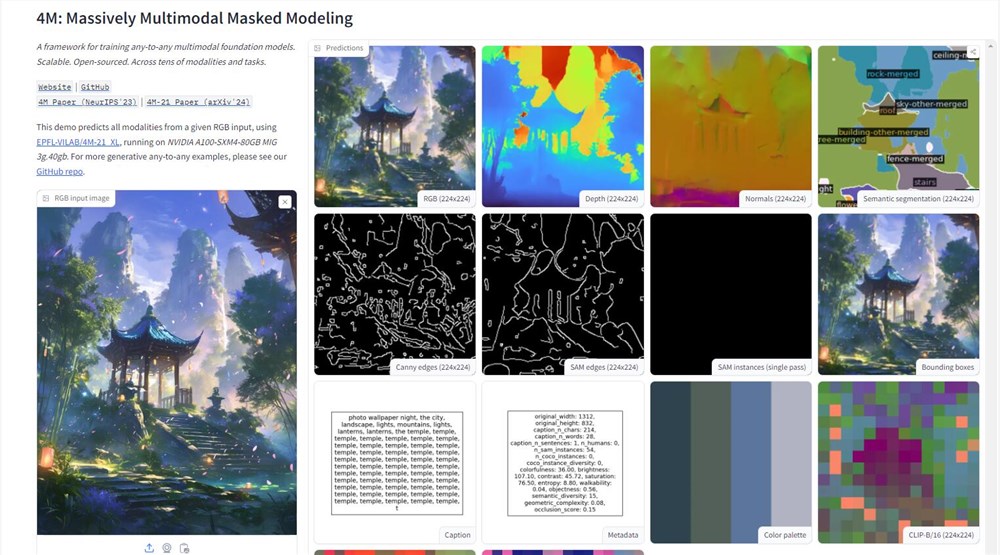

Apple a franchi une étape importante dans le domaine de l'intelligence artificielle, et ils ont révélé une démonstration du modèle 4M sur la plate-forme de visage étreint. Ce modèle d'IA multimodal peut traiter une variété de types de données tels que le texte, les images et les scènes 3D, démontrant de puissantes capacités de traitement de l'information. En téléchargeant une image, les utilisateurs peuvent facilement obtenir des informations détaillées telles que les cartes de profondeur, les dessins de ligne, etc. de l'image, qui marque une percée majeure dans l'application de technologie AI d'Apple.

Le noyau technique du modèle 4M réside dans sa méthode de formation de «modélisation de blindage multimodale à grande échelle». Cette méthode permet au modèle de traiter simultanément plusieurs modalités visuelles, convertissant les informations d'image, sémantique et géométrique en jetons unifiés, réalisant ainsi un connexion transparente entre différentes modalités. Cette conception améliore non seulement la polyvalence du modèle, mais ouvre également de nouvelles possibilités pour les futures applications d'IA multimodales.

La décision d'Apple a brisé sa tradition cohérente de confidentialité dans le domaine de la R&D et a activement démontré sa force technologique sur la plate-forme d'IA open source. En ouvrant le modèle 4M, Apple démontre non seulement la nature avancée de sa technologie d'IA, mais a également étendu une branche d'olivier à la communauté des développeurs, dans l'espoir de construire un écosystème prospère autour de 4 m. Cela annonce la possibilité d'applications plus intelligentes dans l'écosystème Apple, comme le Siri plus intelligent et le plus efficace Final Cut Pro.

Cependant, le lancement du modèle 4M a également apporté des défis dans la pratique des données et l'éthique de l'IA. En tant que modèle d'IA à forte intensité de données, la façon de protéger la confidentialité des utilisateurs tout en favorisant les progrès technologiques sera un problème qu'Apple doit considérer sérieusement. Apple s'est toujours considéré comme un protecteur de confidentialité des utilisateurs.

En termes de méthodes de formation, 4M adopte une méthode de marquage sélectionnée au hasard innovante: la participation au marquage en entrée et l'autre en tant que cible, atteignant ainsi l'évolutivité de l'objectif de formation. Cette conception permet à 4 m de traiter les images et le texte comme des marqueurs numériques, améliorant considérablement la flexibilité et l'adaptabilité du modèle.

Les données de formation du modèle 4M proviennent de CC12M, l'un des plus grands ensembles de données open source au monde. Bien que cet ensemble de données soit riche en données, les informations d'étiquetage ne sont pas parfaites. Pour résoudre ce problème, les chercheurs ont adopté une méthode de pseudo-étiquette faiblement supervisée, utilisé Clip, MaskRCNN et d'autres technologies pour faire des prédictions complètes de l'ensemble de données, puis converti les résultats de prédiction en jetons, jetant une base solide pour la compatibilité multimodale de 4M.

Après une expérimentation et des tests approfondis, 4M s'est avéré être en mesure d'effectuer des tâches multimodales directement sans avoir besoin d'un grand nombre de tâches pré-entraînement ou fins de tâches spécifiques. C'est comme donner à l'IA un couteau à armée suisse multimodal qui lui permet de relever de manière flexible divers défis. Le lancement de 4M démontre non seulement la force technique d'Apple dans le domaine de l'IA, mais souligne également la direction du développement futur des applications d'IA.

Adresse de démonstration: https://huggingface.co/spaces/epfl-vilab/4m