Dapatkan bantuan - FAQ Diskusi situs web Dokumentasi Discord

Peta Jalan Model Mulai Cepat? Demo? Penjelajah? Contoh

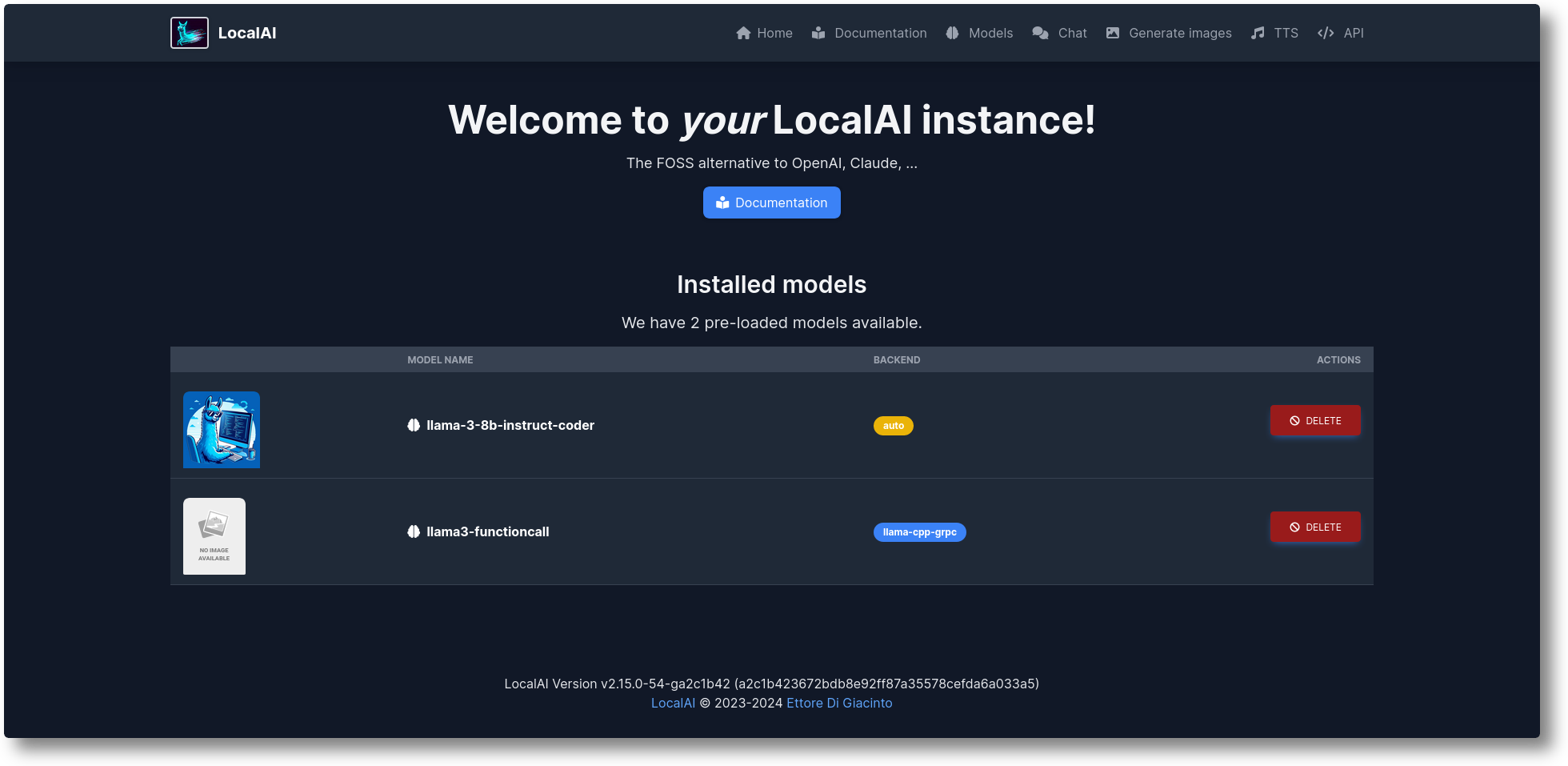

LocalAI adalah alternatif OpenAI Open Source gratis. LocalAI bertindak sebagai REST API pengganti drop-in yang kompatibel dengan spesifikasi API OpenAI (Elevenlabs, Anthropic... ) untuk inferensi AI lokal. Ini memungkinkan Anda menjalankan LLM, menghasilkan gambar, audio (dan tidak hanya) secara lokal atau lokal dengan perangkat keras kelas konsumen, mendukung beberapa kelompok model. Tidak memerlukan GPU. Itu dibuat dan dikelola oleh Ettore Di Giacinto.

Jalankan skrip penginstal:

keriting https://localai.io/install.sh | sh

Atau jalankan dengan buruh pelabuhan:

docker run -ti --name local-ai -p 8080:8080 localai/localai:latest-aio-cpu# Gambar alternatif:# - jika Anda memiliki GPU Nvidia:# docker run -ti --name local-ai -p 8080:8080 --gpus all localai/localai:latest-aio-gpu-nvidia-cuda-12# - tanpa model yang telah dikonfigurasi sebelumnya# docker run -ti --name local-ai -p 8080:8080 localai/localai:latest# - tanpa model yang telah dikonfigurasi sebelumnya untuk GPU Nvidia# docker run -ti --name local-ai -p 8080:8080 --gpus all localai/localai:latest- gpu-nvidia-cuda-12

Untuk memuat model:

# Dari galeri model (lihat model yang tersedia dengan `daftar model ai lokal`, di WebUI dari tab model, atau kunjungi https://models.localai.io)local-ai jalankan llama-3.2-1b-instruct: q4_k_m# Mulai LocalAI dengan model phi-2 langsung dari Huggingfacelocal-ai jalankan Huggingface://TheBloke/phi-2-GGUF/phi-2.Q8_0.gguf# Instal dan jalankan model dari registri OCI Ollamalocal-ai jalankan ollama://gemma:2b# Jalankan model dari file konfigurasilocal-ai jalankan https://Gist.githubusercontent.com/.../phi-2.yaml# Instal dan jalankan model dari registri OCI standar (misalnya, Docker Hub)local-ai run oci://localai/phi-2:latest

Memulai

Okt 2024: contoh dipindahkan ke contoh LocalAI

Agustus 2024: ? FLUX-1, Penjelajah P2P

Juli 2024: ? Dasbor P2P, mode Federasi LocalAI, dan Kawanan AI: #2723

Juni 2024: ? Sekarang Anda dapat menelusuri galeri model tanpa LocalAI! Lihat https://models.localai.io

Juni 2024: Dukungan untuk model dari registri OCI: #2628

Mei 2024: P2P llama.cpp terdesentralisasi: #2343 (peer2peer llama.cpp!) Dokumen https://localai.io/features/distribute/

Mei 2024: Suara Terbuka: #2334

Mei 2024: ? Panggilan fungsi tanpa tata bahasa dan mode campuran: #2328

Mei 2024: Inferensi terdistribusi: #2324

Mei 2024: Obrolan, TTS, dan Pembuatan Gambar di WebUI: #2222

April 2024: API Pemeringkatan Ulang: #2121

Item peta jalan: Daftar masalah

Multimodal dengan pemahaman vLLM dan Video: #3729

API Waktu Nyata #3714

Kumpulan komunitas P2P Global yang terdistribusi: #3113

Peningkatan WebUI: #2156

Backend v2: #1126

Meningkatkan UX v2: #1373

Asisten API: #1273

Titik akhir moderasi: #999

Vulkan: #1647

API Antropik: #1808

Jika Anda ingin membantu dan berkontribusi, masalah dapat diperebutkan: https://github.com/mudler/LocalAI/issues?q=is%3Aissue+is%3Aopen+label%3A%22up+for+grabs%22

Pembuatan teks dengan GPT ( llama.cpp , gpt4all.cpp , ... dan banyak lagi)

Teks ke Audio

Audio ke Teks (Transkripsi audio dengan whisper.cpp )

Pembuatan gambar dengan difusi stabil

API alat mirip OpenAI

Pembuatan embeddings untuk database vektor

Tata bahasa yang dibatasi

Unduh Model langsung dari Huggingface

API Visi

API Pemeringkatan Ulang

Inferensi P2P

WebUI Terintegrasi!

Lihat bagian Memulai di dokumentasi kami.

Bangun dan terapkan kontainer khusus:

https://github.com/sozercan/aikit

UI Web:

https://github.com/Jirubizu/localai-admin

https://github.com/go-skynet/LocalAI-frontend

QA-Pilot (Proyek obrolan interaktif yang memanfaatkan LLM LocalAI untuk pemahaman cepat dan navigasi repositori kode GitHub) https://github.com/reid41/QA-Pilot

Galeri model

https://github.com/go-skynet/model-gallery

Lainnya:

Bagan helm https://github.com/go-skynet/helm-charts

Ekstensi VSCode https://github.com/badgooooor/localai-vscode-plugin

Utilitas terminal https://github.com/djcopley/ShellOracle

Asisten Cerdas Lokal https://github.com/mudler/LocalAGI

Asisten Rumah https://github.com/sammcj/homeassistant-localai / https://github.com/drndos/hass-openai-custom-conversation / https://github.com/valentinfrlch/ha-gpt4vision

Bot perselisihan https://github.com/mudler/LocalAGI/tree/main/examples/discord

Bot kendur https://github.com/mudler/LocalAGI/tree/main/examples/slack

Shell-Pilot (Berinteraksi dengan LLM menggunakan model LocalAI melalui skrip shell murni di sistem Linux atau MacOS Anda) https://github.com/reid41/shell-pilot

Bot Telegram https://github.com/mudler/LocalAI/tree/master/examples/telegram-bot

Tindakan Github: https://github.com/marketplace/actions/start-localai

Contoh: https://github.com/mudler/LocalAI/tree/master/examples/

Panduan penyempurnaan LLM

Bagaimana membangun secara lokal

Cara menginstal di Kubernetes

Proyek yang mengintegrasikan LocalAI

Bagian cara (dikurasi oleh komunitas kami)

Jalankan kode Visual studio dengan LocalAI (SUSE)

Jalankan LocalAI di Jetson Nano Devkit

Jalankan LocalAI di AWS EKS dengan Pulumi

Jalankan LocalAI di AWS

Buat slackbot untuk tim dan proyek OSS yang menjawab dokumentasi

LocalAI bertemu dengan k8sgpt

Menjawab Pertanyaan pada Dokumen secara lokal dengan LangChain, LocalAI, Chroma, dan GPT4All

Tutorial menggunakan k8sgpt dengan LocalAI

Jika Anda menggunakan repositori ini, data dalam proyek hilir, harap pertimbangkan untuk mengutipnya dengan:

@misc{localai,

author = {Ettore Di Giacinto},

title = {LocalAI: The free, Open source OpenAI alternative},

year = {2023},

publisher = {GitHub},

journal = {GitHub repository},

howpublished = {url{https://github.com/go-skynet/LocalAI}},Apakah menurut Anda LocalAI berguna?

Dukung proyek dengan menjadi pendukung atau sponsor. Logo Anda akan muncul di sini dengan tautan ke situs web Anda.

Terima kasih yang sebesar-besarnya kepada sponsor kami yang murah hati yang mendukung proyek ini dengan menanggung biaya CI, dan daftar Sponsor kami:

LocalAI adalah proyek berbasis komunitas yang dibuat oleh Ettore Di Giacinto.

MIT - Penulis Ettore Di Giacinto [email protected]

LocalAI tidak dapat dibangun tanpa bantuan perangkat lunak hebat yang sudah tersedia dari komunitas. Terima kasih!

llama.cpp

https://github.com/tatsu-lab/stanford_alpaca

https://github.com/cornelk/llama-go untuk ide awal

https://github.com/antimatter15/alpaca.cpp

https://github.com/EdVince/Stable-Diffusion-NCNN

https://github.com/ggerganov/whisper.cpp

https://github.com/saharNooby/rwkv.cpp

https://github.com/rhasspy/piper

Ini adalah proyek komunitas, terima kasih khusus kepada kontributor kami! ?