Cina |. Inggris

Pelajaran video Instalasi dan penerapan Pengalaman daring

⚡Fitur:

conda create - n llm python = 3.11

conda activate llm

python - m pip install - r requirements . txt # 转为HF格式

python - m transformers . models . llama . convert_llama_weights_to_hf

- - input_dir path_to_llama_weights - - model_size 7 B - - output_dir path_to_llama_model Jika Anda menggunakan himpunan data khusus, pastikan untuk memberikan definisi himpunan data Anda di file dataset_info.json dalam format berikut.

"数据集名称" : {

"hf_hub_url" : " HuggingFace上的项目地址(若指定,则忽略下列三个参数) " ,

"script_url" : "包含数据加载脚本的本地文件夹名称(若指定,则忽略下列两个参数) " ,

"file_name" : "该目录下数据集文件的名称(若上述参数未指定,则此项必需) " ,

"file_sha1" : "数据集文件的SHA-1哈希值(可选) " ,

"columns" : {

"prompt" : "数据集代表提示词的表头名称(默认:instruction) " ,

"query" : "数据集代表请求的表头名称(默认:input) " ,

"response" : "数据集代表回答的表头名称(默认:output) " ,

"history" : "数据集代表历史对话的表头名称(默认:None) "

}

} Kolom prompt dan response harus berupa string yang tidak kosong. Isi kolom query akan digabungkan dengan kolom prompt sebagai input model. Kolom history harus berupa daftar, di mana setiap elemen adalah tupel string yang masing-masing mewakili permintaan pengguna dan model balasan.

Format .txt , satu data tanpa pengawasan per baris.

Machine learning (ML) is a field devoted to understanding and building methods that let machines "learn" – that is, methods that leverage data to improve computer performance on some set of tasks.

Machine learning algorithms build a model based on sample data, known as training data, in order to make predictions or decisions without being explicitly programmed to do so. Machine learning algorithms are used in a wide variety of applications, such as in medicine, email filtering, speech recognition, agriculture, and computer vision, where it is difficult or unfeasible to develop conventional algorithms to perform the needed tasks.[

{

"instruction" : "听起来很不错。人工智能可能在哪些方面面临挑战呢? " ,

"input" : " " ,

"output" : "人工智能面临的挑战包括数据隐私、安全和道德方面的问题,以及影响就业机会的自动化等问题。 " ,

"history" : [

[ "你好,你能帮我解答一个问题吗? " , "当然,请问有什么问题? " ],

[ "我想了解人工智能的未来发展方向,你有什么想法吗? " , "人工智能在未来的发展方向可能包括更强大的机器学习算法,更先进的自然语言处理技术,以及更加智能的机器人。 " ]

]

}

][

{

"instruction" : "听起来很不错。人工智能可能在哪些方面面临挑战呢? " ,

"input" : " " ,

"output" : "人工智能面临的挑战包括数据隐私、安全和道德方面的问题,以及影响就业机会的自动化等问题。 " ,

"history" : []

}

][

{

"instruction" : "生成三个与“道歉”意思相同的动词" ,

"input" : " " ,

"output" : [

"承认,表示遗憾,弥补。 " ,

"道歉"

]

}

] Periksa apakah kartu grafis Anda terhubung dengan NVLINK. Hanya dengan koneksi NVLINK Anda dapat menggunakan accelerate secara efektif untuk pelatihan akselerasi paralel.

nvidia-smi topo -m

accelerate config # configure the environment

accelerate launch src / train_bash . py # arguments (same as above) # LLaMA-2

accelerate launch src / train_bash . py

- - stage sft

- - model_name_or_path . / Llama - 2 - 7 b - chat - hf

- - do_train

- - dataset mm

- - finetuning_type lora

- - quantization_bit 4

- - overwrite_cache

- - output_dir output

- - per_device_train_batch_size 8

- - gradient_accumulation_steps 4

- - lr_scheduler_type cosine

- - logging_steps 10

- - save_steps 1000

- - learning_rate 5e-5

- - num_train_epochs 2.0

- - plot_loss

- - fp16

- - template llama2

- - lora_target q_proj , v_proj

# LLaMA

accelerate launch src / train_bash . py

- - stage sft

- - model_name_or_path . / Llama - 7 b - hf

- - do_train

- - dataset mm , hm

- - finetuning_type lora

- - overwrite_cache

- - output_dir output - 1

- - per_device_train_batch_size 4

- - gradient_accumulation_steps 4

- - lr_scheduler_type cosine

- - logging_steps 10

- - save_steps 2000

- - learning_rate 5e-5

- - num_train_epochs 2.0

- - plot_loss

- - fp16

- - template default

- - lora_target q_proj , v_proj # LLaMA-2, DPO

accelerate launch src / train_bash . py

- - stage dpo

- - model_name_or_path . / Llama - 2 - 7 b - chat - hf

- - do_train

- - dataset rlhf

- - template llama2

- - finetuning_type lora

- - quantization_bit 4

- - lora_target q_proj , v_proj

- - resume_lora_training False

- - checkpoint_dir . / output - 2

- - output_dir output - dpo

- - per_device_train_batch_size 2

- - gradient_accumulation_steps 4

- - lr_scheduler_type cosine

- - logging_steps 10

- - save_steps 1000

- - learning_rate 1e-5

- - num_train_epochs 1.0

- - plot_loss

- - fp16 # LLaMA-2

python src / web_demo . py

- - model_name_or_path . / Llama - 2 - 7 b - chat - hf

- - checkpoint_dir output

- - finetuning_type lora

- - template llama2

# LLaMA

python src / web_demo . py

- - model_name_or_path . / Llama - 7 b - hf

- - checkpoint_dir output - 1

- - finetuning_type lora

- - template default

# DPO

python src / web_demo . py

- - model_name_or_path . / Llama - 2 - 7 b - chat - hf

- - checkpoint_dir output - dpo

- - finetuning_type lora

- - template llama2 # LLaMA-2

python src / api_demo . py

- - model_name_or_path . / Llama - 2 - 7 b - chat - hf

- - checkpoint_dir output

- - finetuning_type lora

- - template llama2

# LLaMA

python src / api_demo . py

- - model_name_or_path . / Llama - 7 b - hf

- - checkpoint_dir output - 1

- - finetuning_type lora

- - template default

# DPO

python src / api_demo . py

- - model_name_or_path . / Llama - 2 - 7 b - chat - hf

- - checkpoint_dir output - dpo

- - finetuning_type lora

- - template llama2Uji API:

curl - X 'POST'

'http://127.0.0.1:8888/v1/chat/completions'

- H 'accept: application/json'

- H 'Content-Type: application/json'

- d ' {

"model" : "string",

"messages": [

{

"role" : "user",

"content": "你好"

}

],

" temperature ": 0 ,

"top_p" : 0 ,

"max_new_tokens" : 0 ,

"stream" : false

}' # LLaMA-2

python src / cli_demo . py

- - model_name_or_path . / Llama - 2 - 7 b - chat - hf

- - checkpoint_dir output

- - finetuning_type lora

- - template llama2

# LLaMA

python src / cli_demo . py

- - model_name_or_path . / Llama - 7 b - hf

- - checkpoint_dir output - 1

- - finetuning_type lora

- - template default

# DPO

python src / cli_demo . py

- - model_name_or_path . / Llama - 2 - 7 b - chat - hf

- - checkpoint_dir output - dpo

- - finetuning_type lora

- - template llama2 # LLaMA-2

CUDA_VISIBLE_DEVICES = 0 python src / train_bash . py

- - stage sft

- - model_name_or_path . / Llama - 2 - 7 b - chat - hf

- - do_predict

- - dataset mm

- - template llama2

- - finetuning_type lora

- - checkpoint_dir output

- - output_dir predict_output

- - per_device_eval_batch_size 8

- - max_samples 100

- - predict_with_generate

# LLaMA

CUDA_VISIBLE_DEVICES = 0 python src / train_bash . py

- - stage sft

- - model_name_or_path . / Llama - 7 b - hf

- - do_predict

- - dataset mm

- - template default

- - finetuning_type lora

- - checkpoint_dir output - 1

- - output_dir predict_output

- - per_device_eval_batch_size 8

- - max_samples 100

- - predict_with_generate # LLaMA-2

CUDA_VISIBLE_DEVICES = 0 python src / train_bash . py

- - stage sft

- - model_name_or_path . / Llama - 2 - 7 b - chat - hf

- - do_eval

- - dataset mm

- - template llama2

- - finetuning_type lora

- - checkpoint_dir output

- - output_dir eval_output

- - per_device_eval_batch_size 8

- - max_samples 100

- - predict_with_generate

# LLaMA

CUDA_VISIBLE_DEVICES = 0 python src / train_bash . py

- - stage sft

- - model_name_or_path . / Llama - 7 b - hf

- - do_eval

- - dataset mm

- - template default

- - finetuning_type lora

- - checkpoint_dir output - 1

- - output_dir eval_output

- - per_device_eval_batch_size 8

- - max_samples 100

- - predict_with_generate Untuk evaluasi 4/8-bit, disarankan untuk menggunakan --per_device_eval_batch_size=1 dan --max_target_length 128

# LLaMA-2

python src / export_model . py

- - model_name_or_path . / Llama - 2 - 7 b - chat - hf

- - template llama2

- - finetuning_type lora

- - checkpoint_dir output - 1

- - output_dir output_export

# LLaMA

python src / export_model . py

- - model_name_or_path . / Llama - 7 b - hf

- - template default

- - finetuning_type lora

- - checkpoint_dir output

- - output_dir output_export % cd Gradio

python app . py

# LLaMA-2

python src / api_demo . py

- - model_name_or_path . / Llama - 2 - 7 b - chat - hf

- - checkpoint_dir output

- - finetuning_type lora

- - template llama2

# LLaMA

python src / api_demo . py

- - model_name_or_path . / Llama - 7 b - hf

- - checkpoint_dir output - 1

- - finetuning_type lora

- - template default设置, ubah接口地址menjadi: http://127.0.0.1:8000/ (yaitu, alamat antarmuka API Anda), dan kemudian Anda dapat menggunakannya.

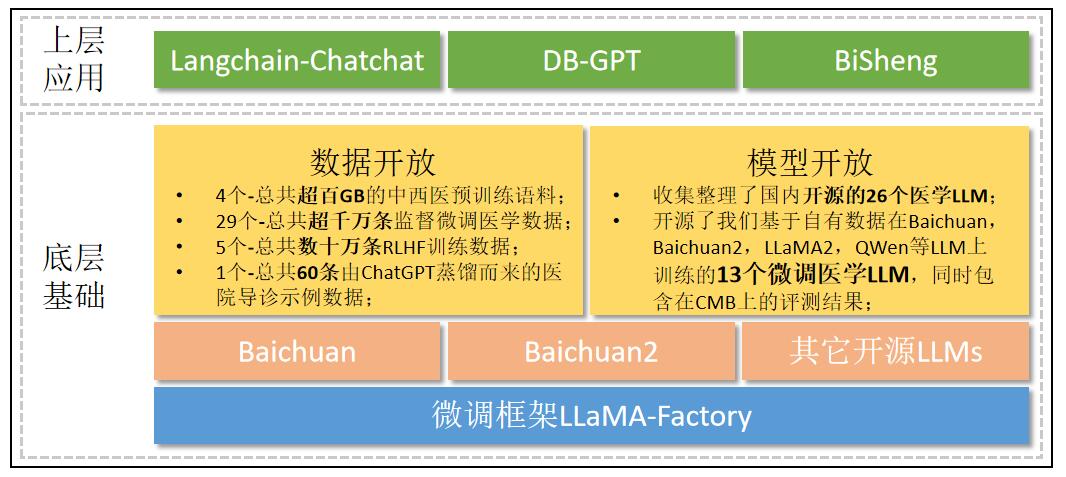

PubMed Central dan PubMed Abstracts . Teks-teks berharga ini telah sangat memperkaya sistem pengetahuan medis model BLOOMZ, sehingga banyak proyek sumber terbuka akan memprioritaskan BLOOMZ sebagai model dasar untuk penyempurnaan medis;质量> 数量data adalah kebenarannya, seperti: Lebih Sedikit Lebih Banyak! Diserahkan ke Qingyuan&& Caspian | MiniGPT-4! , data SFT berskala ultra besar akan melemahkan tugas LLM hilir atau kehilangan ICL, CoT, dan kemampuan lainnya;大规模预训练+小规模监督微调=超强的LLM模型;英文10B以下选择Mistral-7B中文, 10B以下选择Yi-6B 10B, dan 10B以上选择Qwen-14B和Yi-34B ; Penting

Setiap orang dipersilakan untuk menambahkan pengalaman baru ke ISSUE!

11~13 Metodologi berasal dari 13 miliar model bahasa besar. Mengubah satu bobot saja akan menghilangkan kemampuan bahasa sepenuhnya! Penelitian terbaru dari Laboratorium Natural Language Processing Universitas Fudan.

14Metodologi dari Bagaimana Kemampuan dalam Model Bahasa Besar Dipengaruhi oleh Penyempurnaan Komposisi Data yang Diawasi

Metodologi 17~25 berasal dari LLM Optimization: Layer-wise Optimal Rank Adaptation (LORA) interpretasi versi Cina

| panggung | Pengantar bobot | Alamat unduhan | Fitur | model dasar | metode penyesuaian | Kumpulan data |

|---|---|---|---|---|---|---|

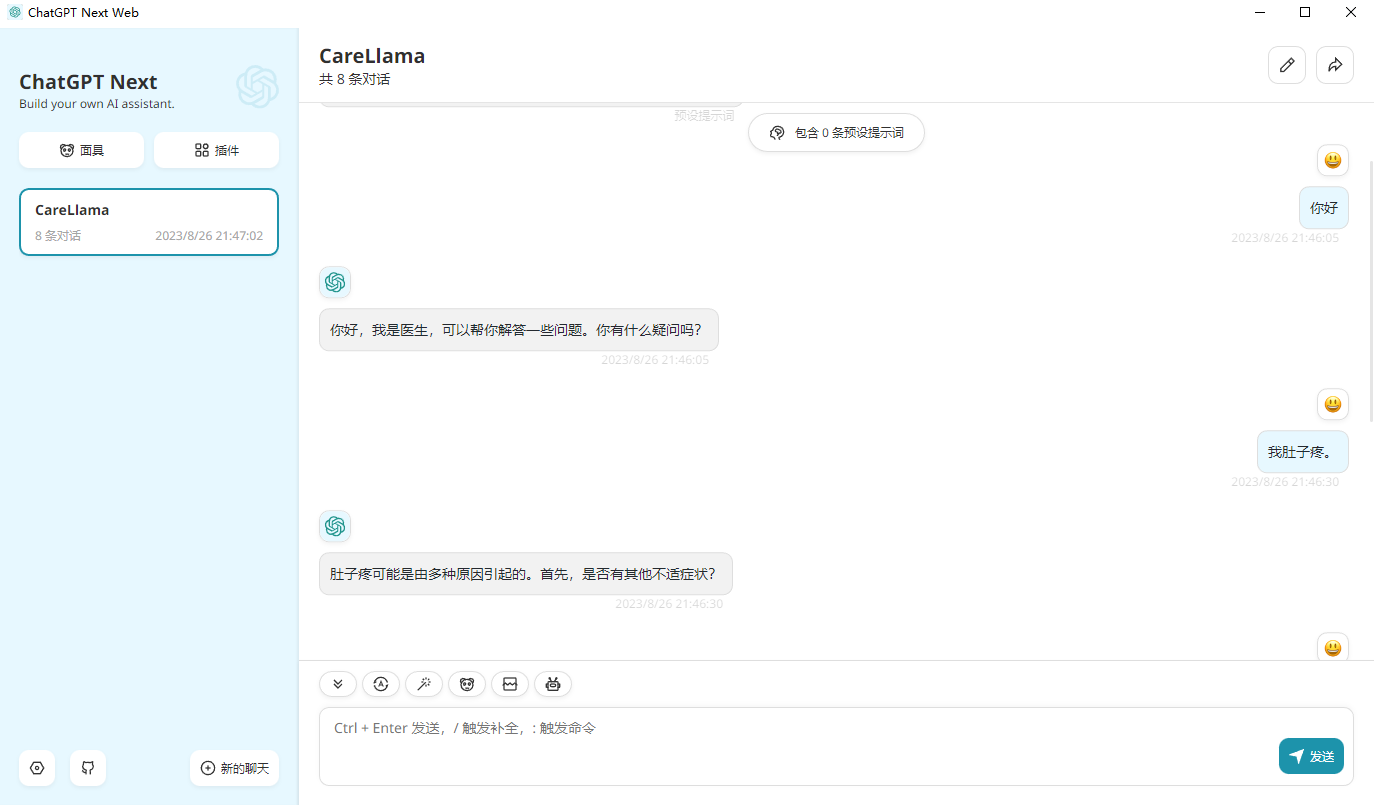

| ?Pengawasan dan penyempurnaan | Data dialog multi-putaran dilatih berdasarkan LLaMA2-7b-Chat | CareLlama2-7b-chat-sft-multi、?CareLlama2-7b-multi | Keterampilan percakapan multi-putaran yang luar biasa | LLaMA2-7b-Obrolan | QLoRA | mm |

| Awasi penyempurnaan | Data dialog dokter-pasien yang kaya dan efisien dilatih berdasarkan LLaMA2-7b-Chat | CareLlama2-7b-chat-sft-med | Kemampuan diagnosis penyakit pasien yang sangat baik | LLaMA2-7b-Obrolan | QLoRA | hm |

| mengawasi |