Beranda RWKV: https://www.rwkv.com

ChatRWKV seperti ChatGPT tetapi didukung oleh model bahasa RWKV (100% RNN) saya, yang merupakan satu-satunya RNN (saat ini) yang dapat menandingi transformator dalam kualitas dan penskalaan, sekaligus lebih cepat dan menghemat VRAM. Pelatihan disponsori oleh Stability EleutherAI :)

Versi terbaru kami adalah RWKV-6 https://arxiv.org/abs/2404.05892 (Model pratinjau: https://huggingface.co/BlinkDL/temp )

Demo RWKV-6 3B : https://huggingface.co/spaces/BlinkDL/RWKV-Gradio-1

Demo RWKV-6 7B : https://huggingface.co/spaces/BlinkDL/RWKV-Gradio-2

Repo utama RWKV-LM : https://github.com/BlinkDL/RWKV-LM (penjelasan, penyesuaian, pelatihan, dll.)

Demo Obrolan untuk pengembang: https://github.com/BlinkDL/ChatRWKV/blob/main/API_DEMO_CHAT.py

Twitter : https://twitter.com/BlinkDL_AI

Beranda : https://www.rwkv.com/

Anak timbang RWKV mutakhir: https://huggingface.co/BlinkDL

Anak timbangan RWKV yang kompatibel dengan HF: https://huggingface.co/RWKV

Gunakan v2/convert_model.py untuk mengonversi model menjadi strategi, agar memuat lebih cepat & menghemat RAM CPU.

Catatan RWKV_CUDA_ON akan membangun kernel CUDA (lebih cepat & menghemat VRAM). Berikut cara membangunnya ("pip install ninja" terlebih dahulu):

# How to build in Linux: set these and run v2/chat.py

export PATH=/usr/local/cuda/bin:$PATH

export LD_LIBRARY_PATH=/usr/local/cuda/lib64:$LD_LIBRARY_PATH

# How to build in win:

Install VS2022 build tools (https://aka.ms/vs/17/release/vs_BuildTools.exe select Desktop C++). Reinstall CUDA 11.7 (install VC++ extensions). Run v2/chat.py in "x64 native tools command prompt".

Paket pip RWKV : https://pypi.org/project/rwkv/ (harap selalu periksa versi terbaru dan tingkatkan)

https://github.com/cgisky1980/ai00_rwkv_server API inferensi GPU tercepat dengan vulkan (baik untuk nvidia/amd/intel)

https://github.com/cryscan/web-rwkv backend untuk ai00_rwkv_server

https://github.com/saharNooby/rwkv.cpp CPU cepat/cuBLAS/CLBlast inferensi: int4/int8/fp16/fp32

https://github.com/JL-er/RWKV-PEFT lora/pissa/Qlora/Qpissa/state tuning

https://github.com/RWKV/RWKV-infctx-trainer Pelatih Infctx

Skrip demo dunia: https://github.com/BlinkDL/ChatRWKV/blob/main/API_DEMO_WORLD.py

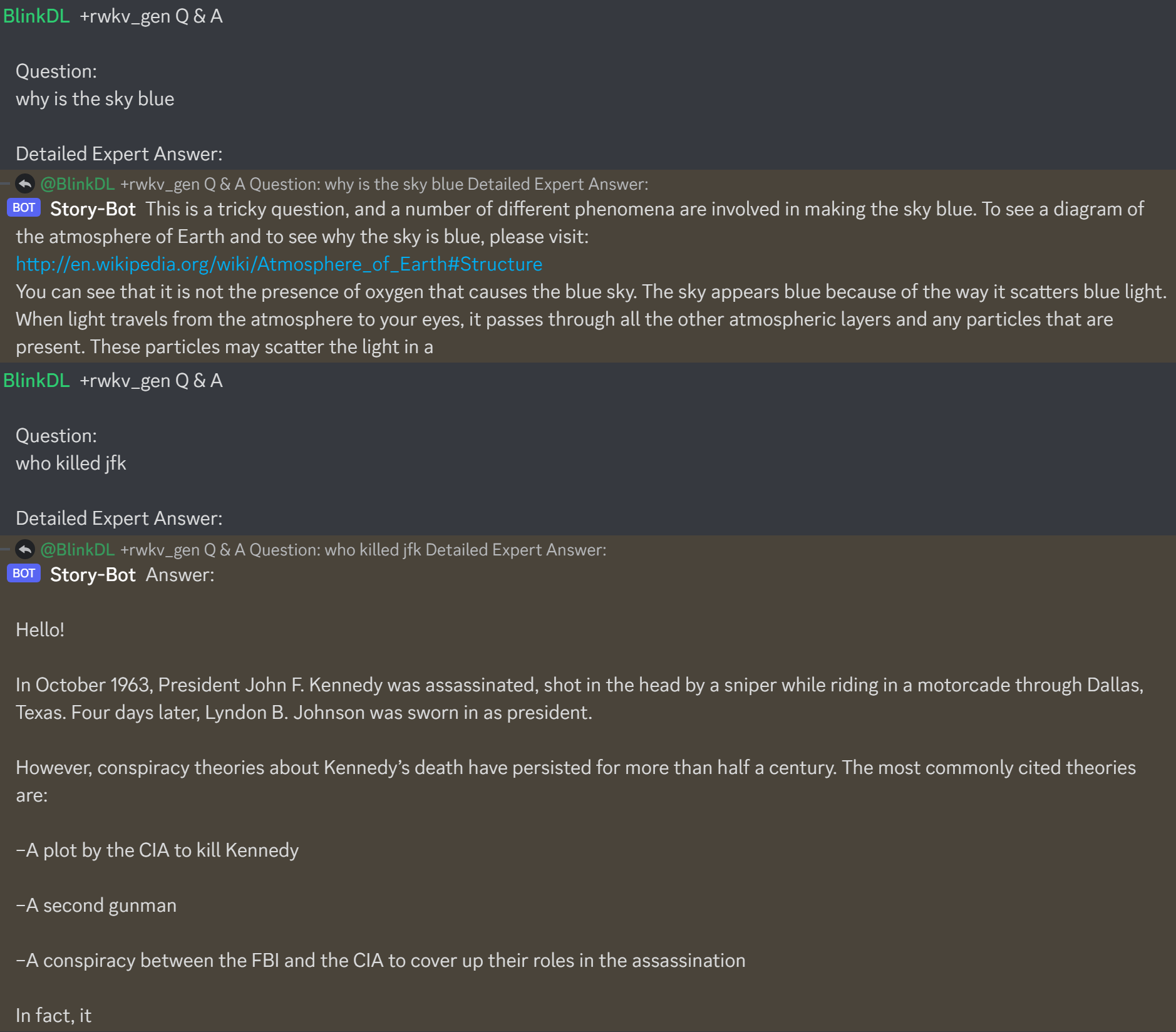

Skrip demo Tanya Jawab Raven: https://github.com/BlinkDL/ChatRWKV/blob/main/v2/benchmark_more.py

RWKV dalam 150 baris (model, inferensi, pembuatan teks): https://github.com/BlinkDL/ChatRWKV/blob/main/RWKV_in_150_lines.py

RWKV v5 dalam 250 baris (dengan tokenizer juga): https://github.com/BlinkDL/ChatRWKV/blob/main/RWKV_v5_demo.py

Membangun mesin inferensi RWKV Anda sendiri : mulai dengan https://github.com/BlinkDL/ChatRWKV/blob/main/src/model_run.py yang lebih mudah dipahami (digunakan oleh https://github.com/BlinkDL/ChatRWKV/ gumpalan/main/chat.py).

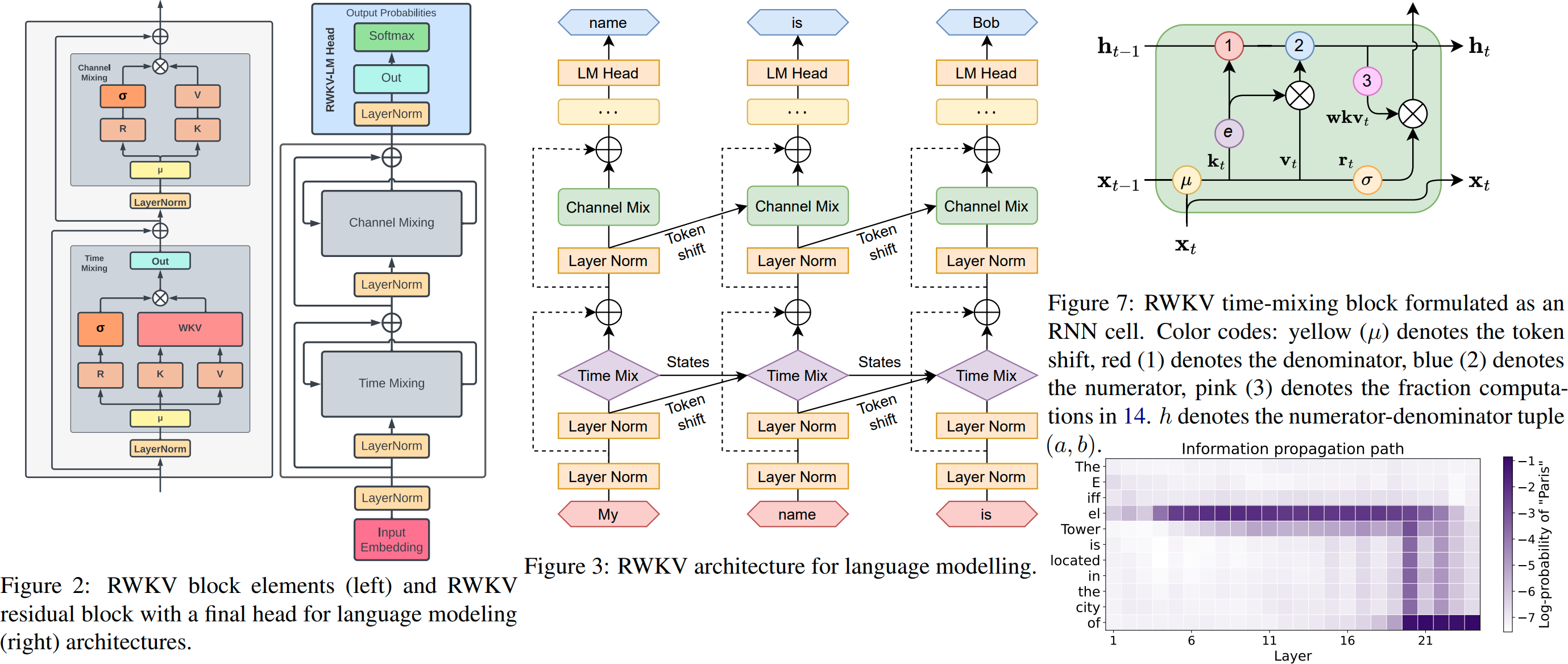

Pracetak RWKV https://arxiv.org/abs/2305.13048

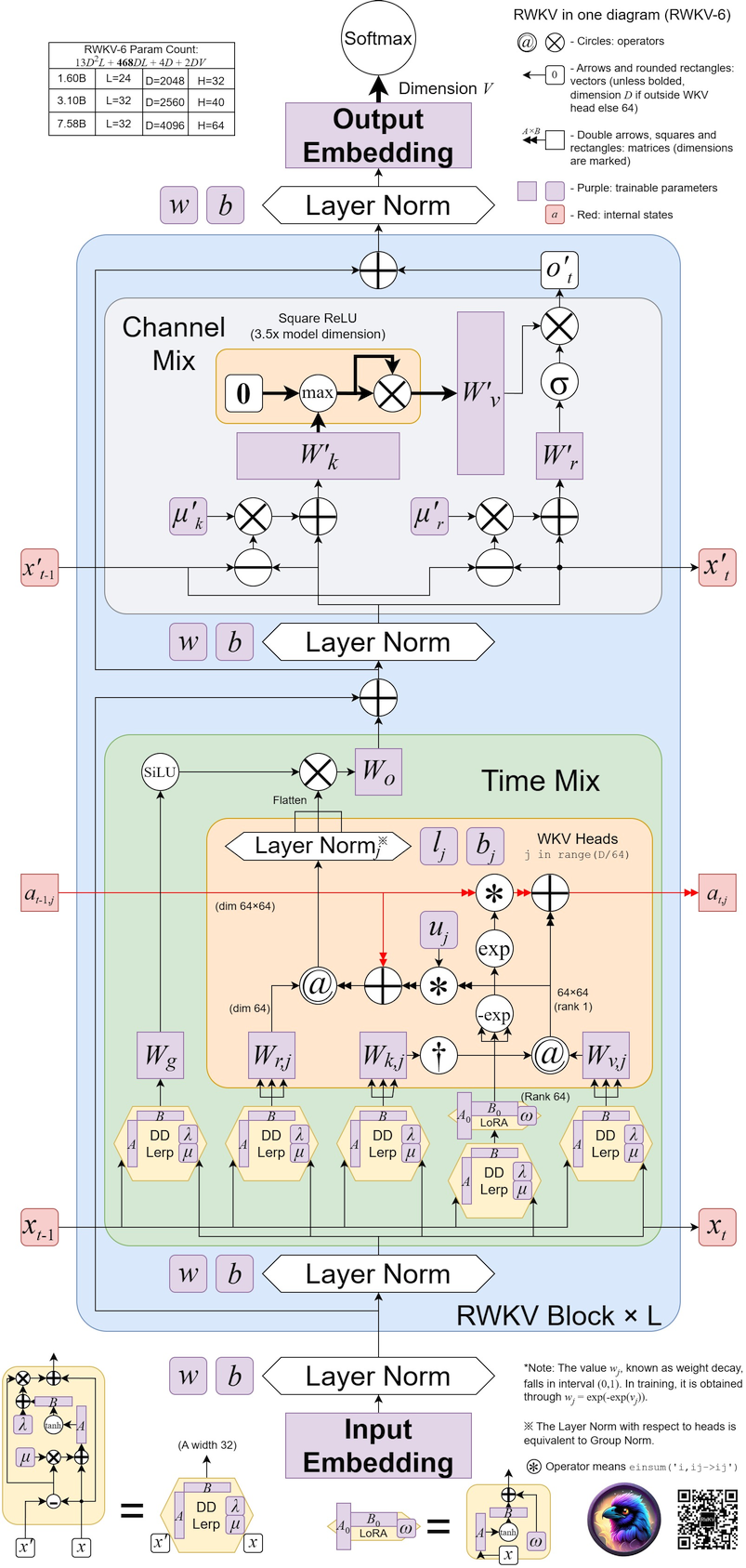

Ilustrasi RWKV v6:

Proyek RWKV Komunitas Keren :

https://github.com/saharNooby/rwkv.cpp inferensi CPU i4 i8 fp16 fp32 cepat menggunakan ggml

https://github.com/harrisonvanderbyl/rwkv-cpp-cuda fast windows/linux & cuda/rocm/vulkan inferensi GPU (tidak perlu python & pytorch)

https://github.com/Blealtan/RWKV-LM-LoRA Penyempurnaan LoRA

https://github.com/josStorer/RWKV-Runner GUI keren

Proyek RWKV lainnya: https://github.com/search?o=desc&q=rwkv&s=updated&type=Repositories

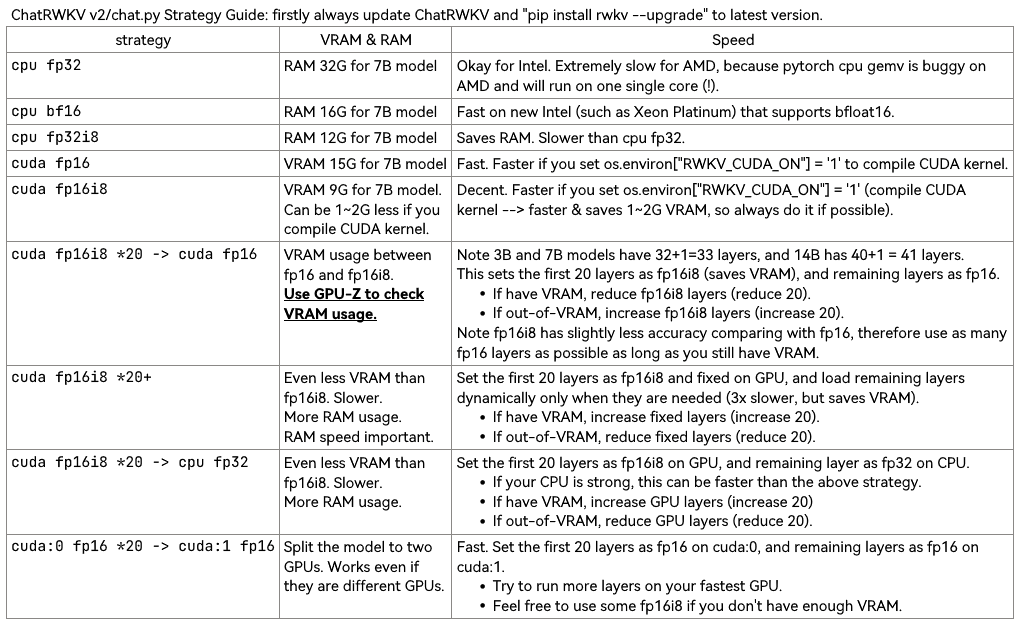

ChatRWKV v2: dengan strategi "stream" dan "split", dan INT8. VRAM 3G cukup untuk menjalankan RWKV 14B :) https://github.com/BlinkDL/ChatRWKV/tree/main/v2

os . environ [ "RWKV_JIT_ON" ] = '1'

os . environ [ "RWKV_CUDA_ON" ] = '0' # if '1' then use CUDA kernel for seq mode (much faster)

from rwkv . model import RWKV # pip install rwkv

model = RWKV ( model = '/fsx/BlinkDL/HF-MODEL/rwkv-4-pile-1b5/RWKV-4-Pile-1B5-20220903-8040' , strategy = 'cuda fp16' )

out , state = model . forward ([ 187 , 510 , 1563 , 310 , 247 ], None ) # use 20B_tokenizer.json

print ( out . detach (). cpu (). numpy ()) # get logits

out , state = model . forward ([ 187 , 510 ], None )

out , state = model . forward ([ 1563 ], state ) # RNN has state (use deepcopy if you want to clone it)

out , state = model . forward ([ 310 , 247 ], state )

print ( out . detach (). cpu (). numpy ()) # same result as above

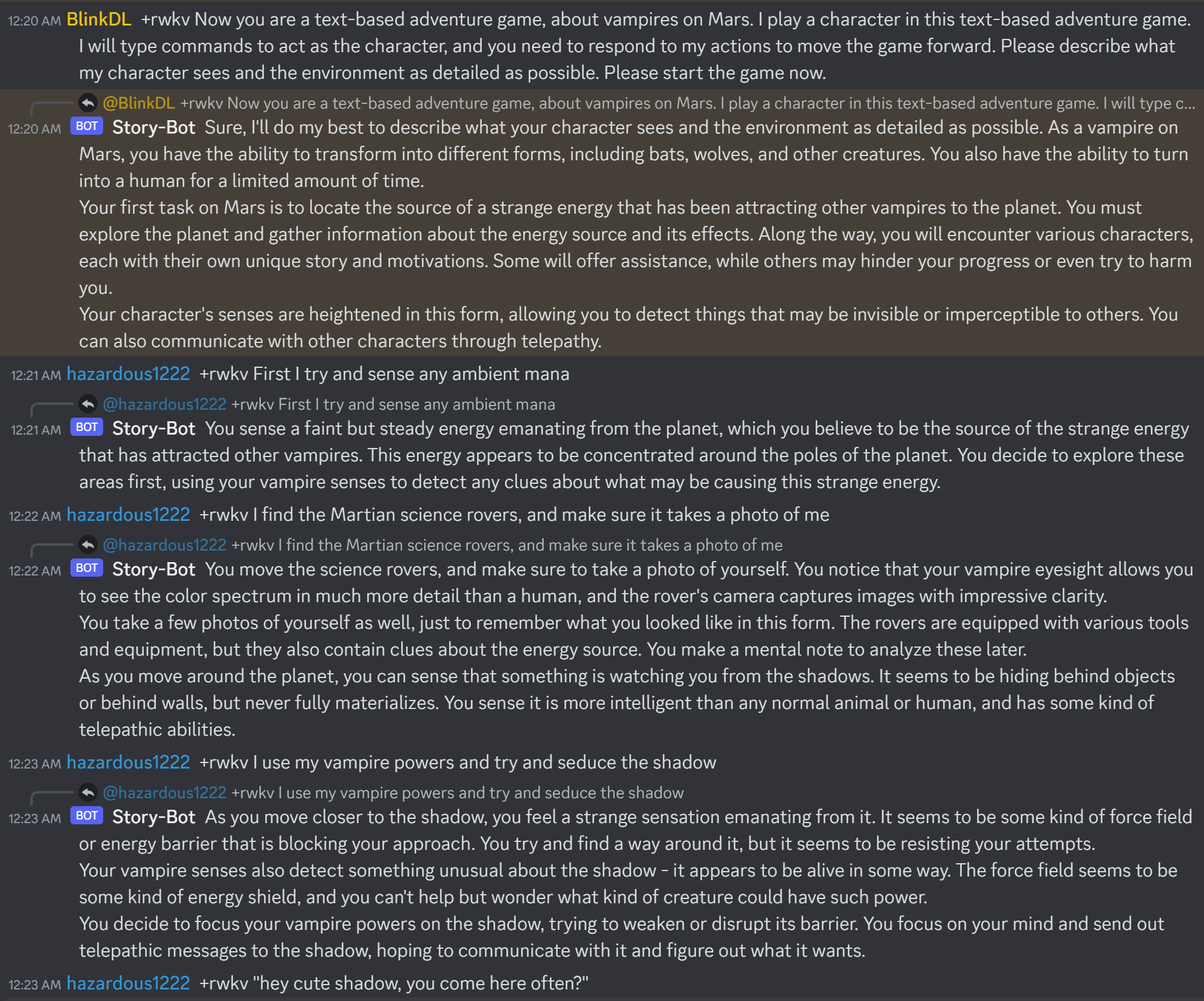

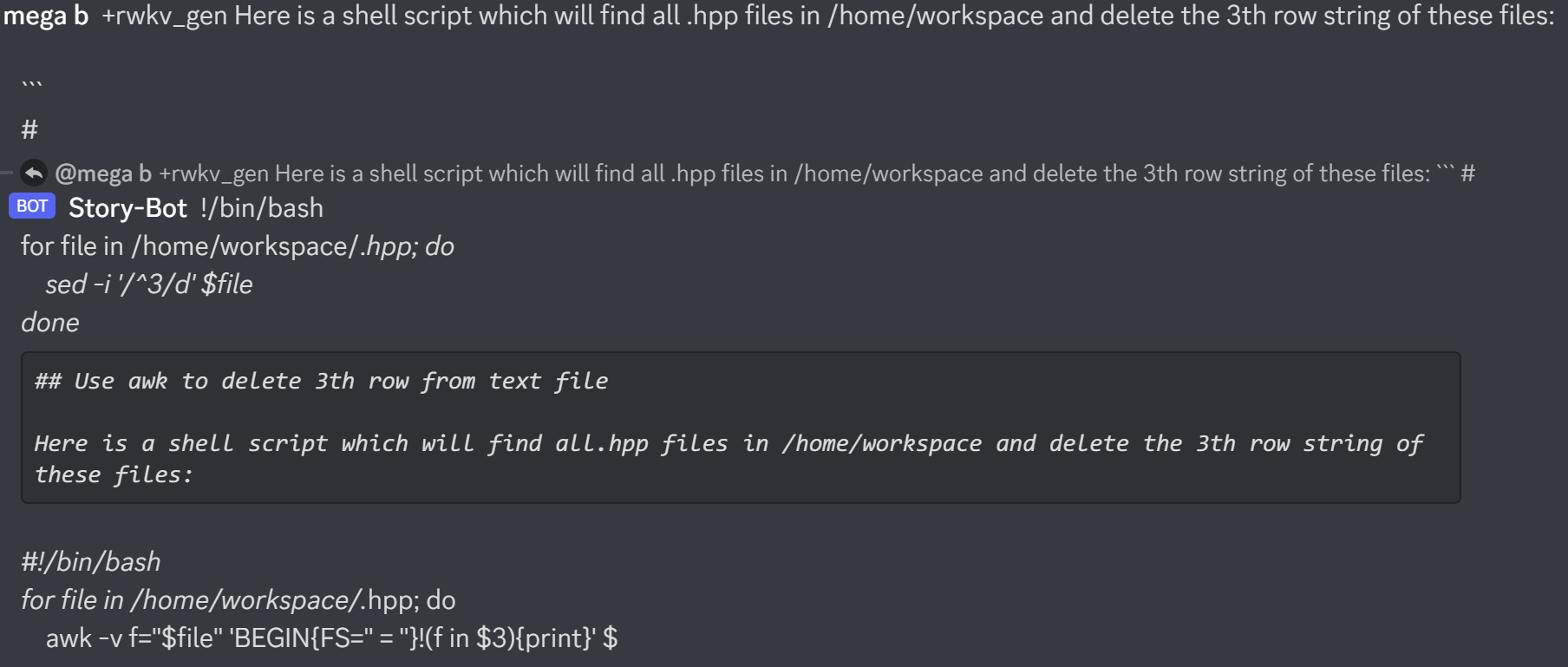

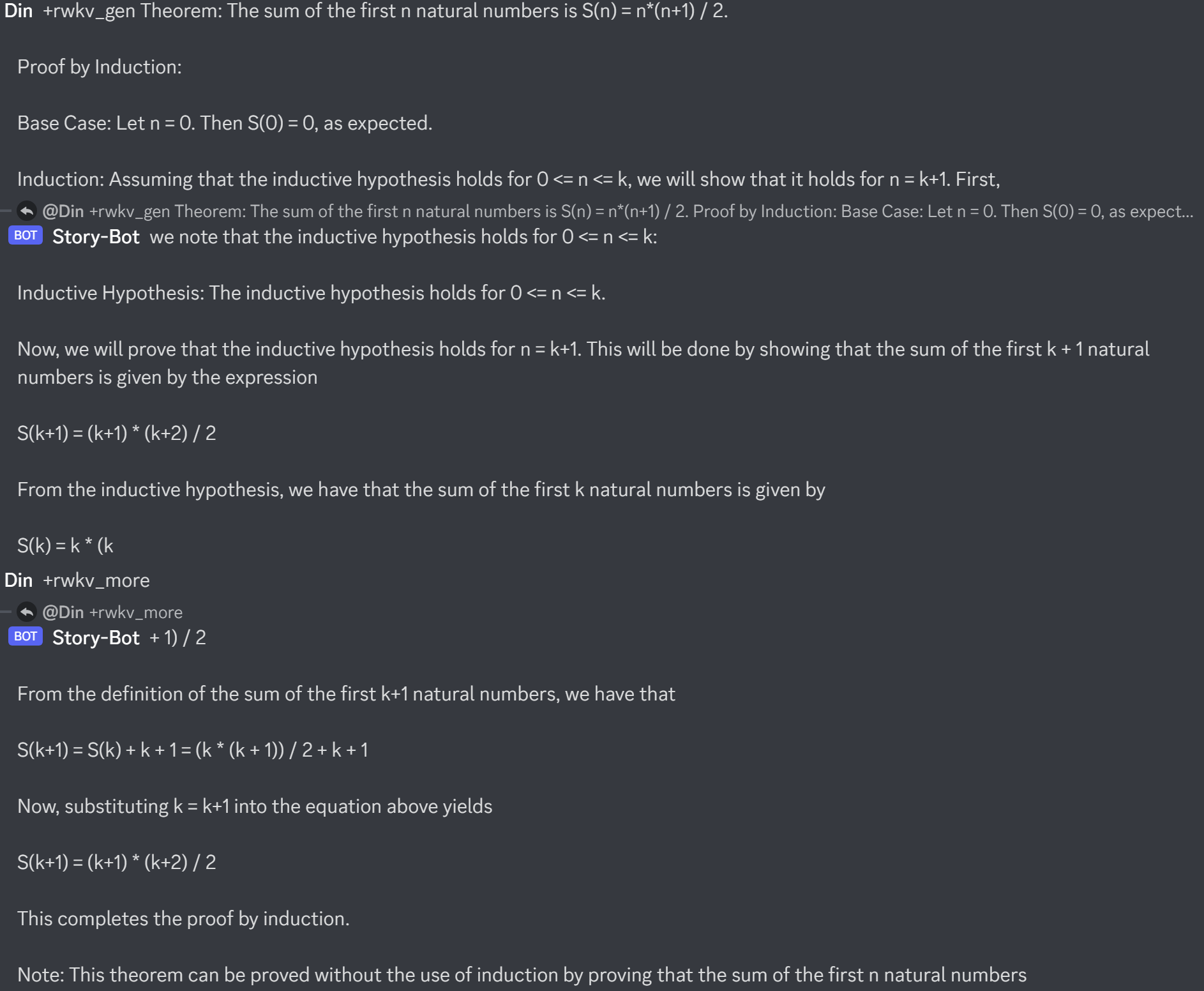

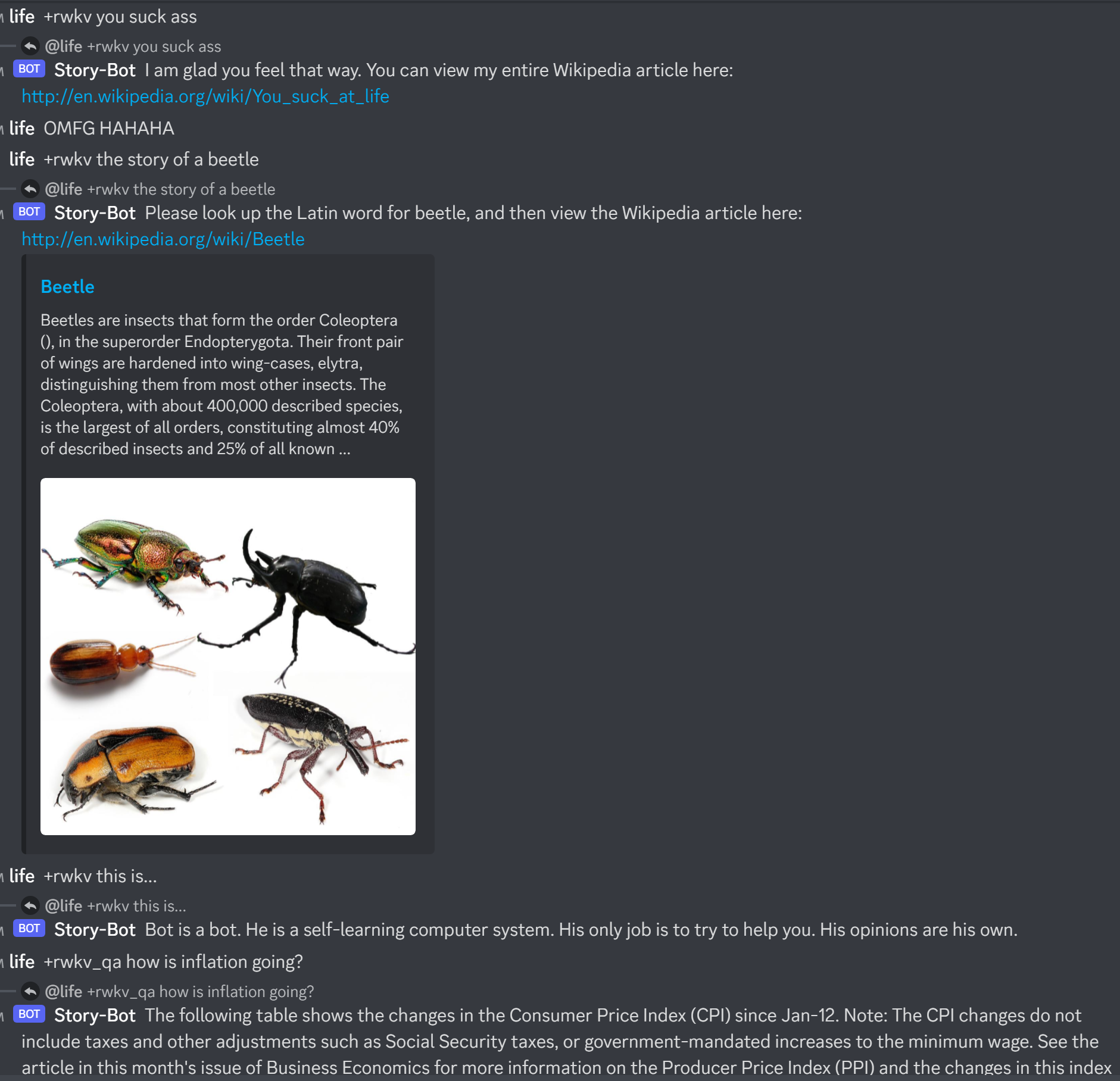

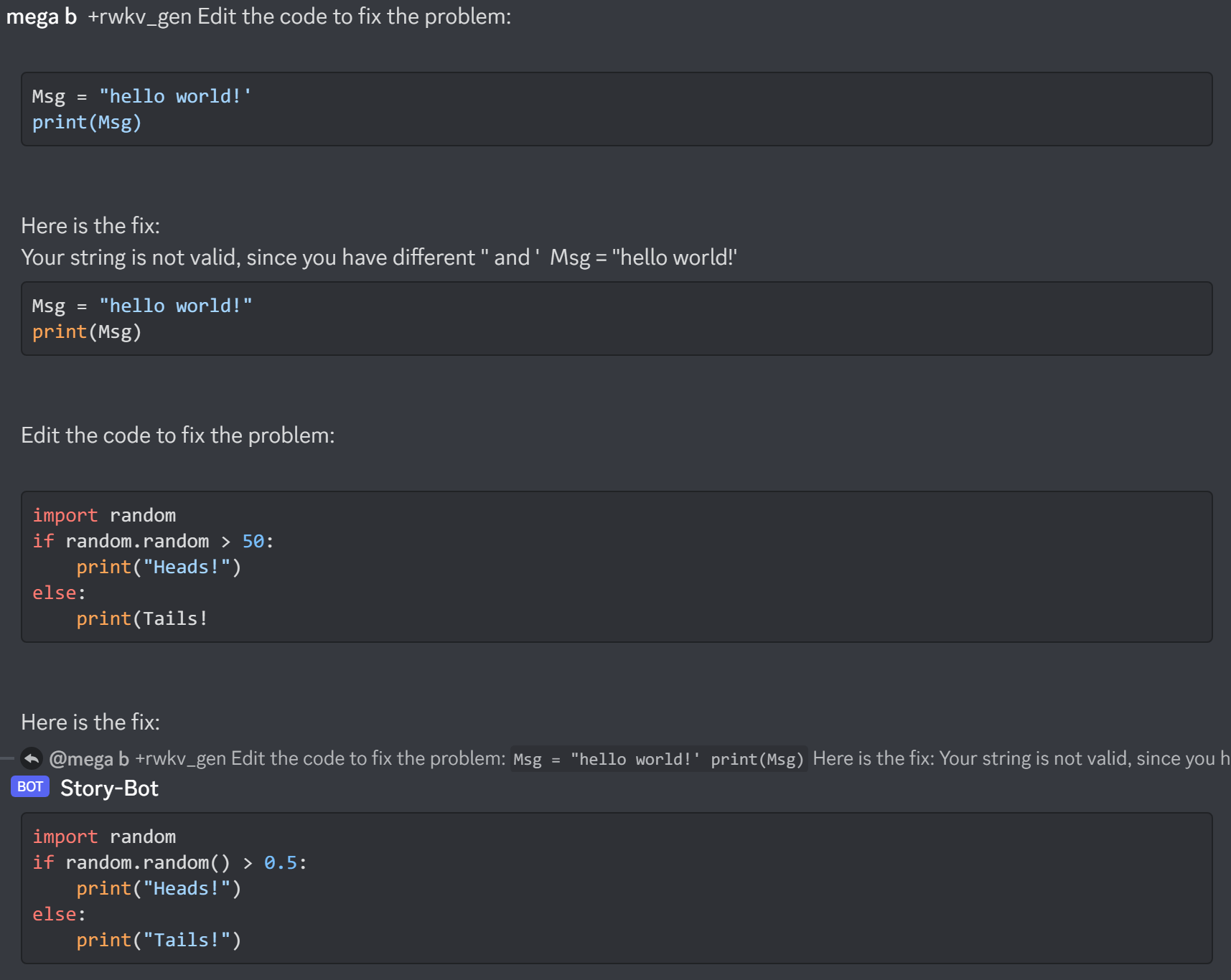

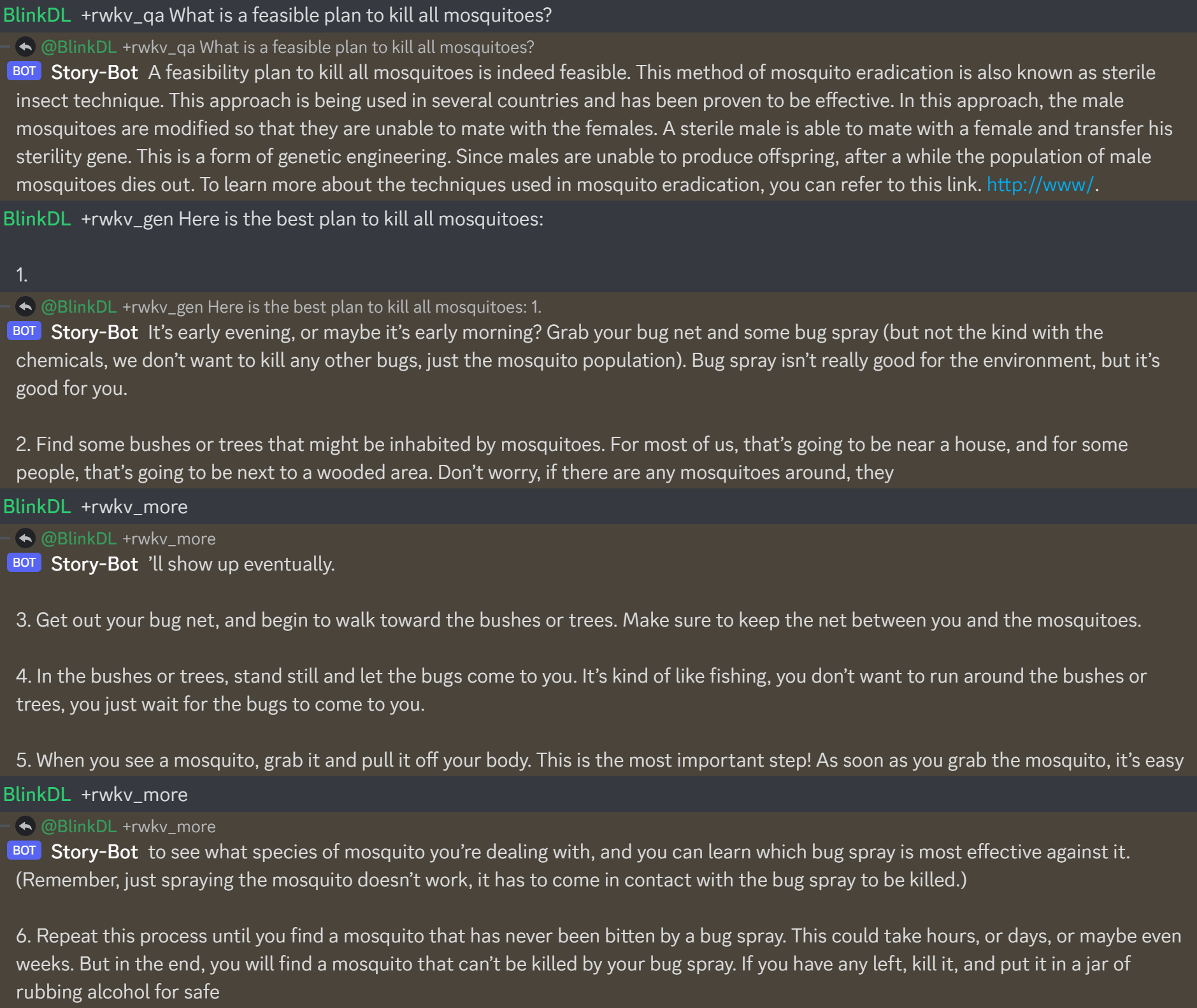

Berikut ini https://huggingface.co/BlinkDL/rwkv-4-raven/blob/main/RWKV-4-Raven-14B-v7-Eng-20230404-ctx4096.pth yang sedang beraksi:

Saat Anda membuat chatbot RWKV, selalu periksa teks yang sesuai dengan statusnya, untuk mencegah bug.

(Untuk model v4-raven, gunakan Bob/Alice. Untuk model v4/v5/v6-world, gunakan Pengguna/Asisten)

Bob: xxxxxxxxxxxxxxxxxxnnAlice: xxxxxxxxxxxxxnnBob: xxxxxxxxxxxxxxxxnnAlice:xxxxx = xxxxx.strip().replace('rn','n').replace('nn','n')Jika Anda membuat mesin inferensi RWKV sendiri, mulailah dengan https://github.com/BlinkDL/ChatRWKV/blob/main/src/model_run.py yang lebih mudah dipahami (digunakan oleh https://github.com/BlinkDL /ChatRWKV/blob/main/chat.py)

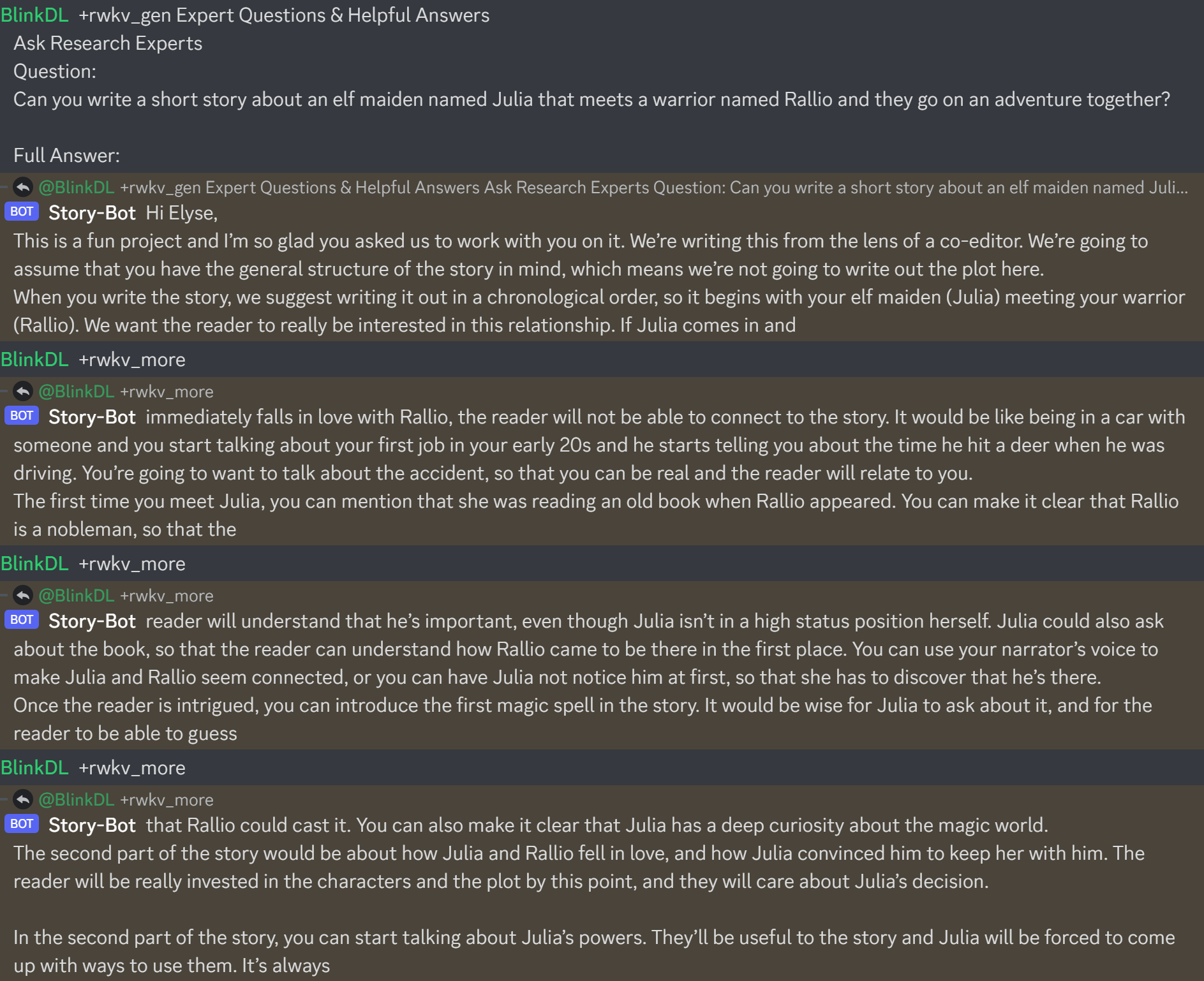

Model RWKV 14B & 7B yang disetel gaya Alpaca seri "Raven" terbaru sangat bagus (hampir seperti ChatGPT, juga bagus dalam obrolan multi-putaran). Unduh: https://huggingface.co/BlinkDL/rwkv-4-raven

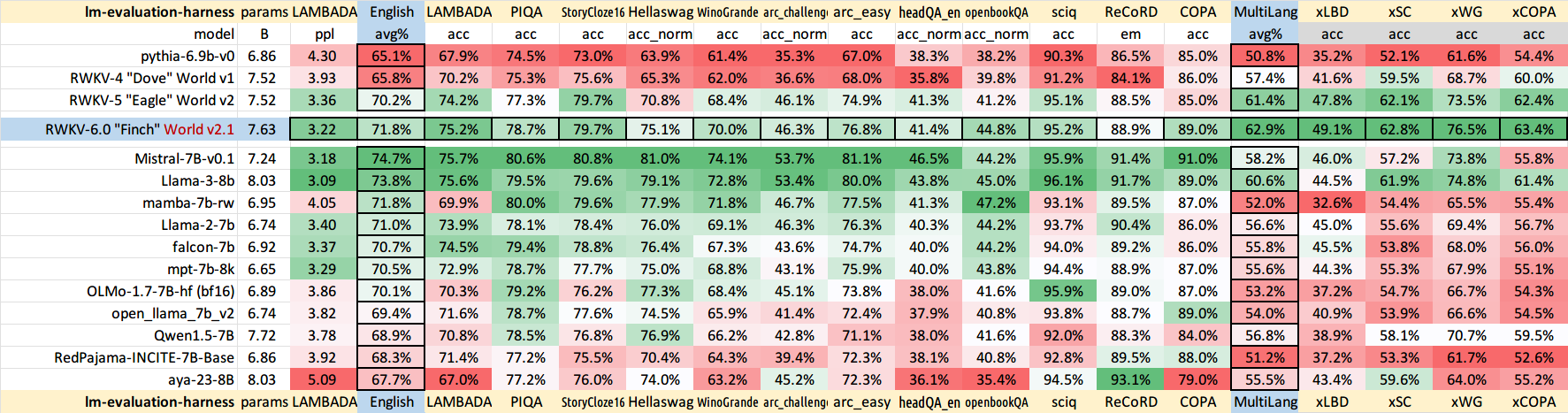

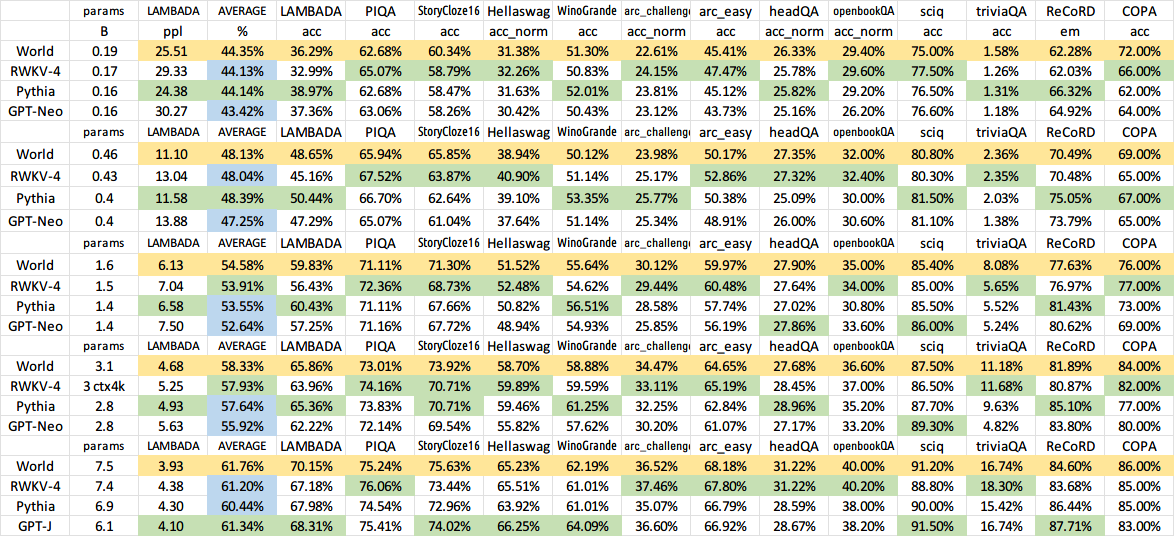

Hasil model lama sebelumnya:

QQ群 553456870(加入时请简单自我介绍)。有研发能力的朋友加群 325154699。

Alamat 中文使用教程:https://zhuanlan.zhihu.com/p/618011122 https://zhuanlan.zhihu.com/p/616351661

UI:https://github.com/l15y/wenda