Algoritma Audit yang Luar Biasa

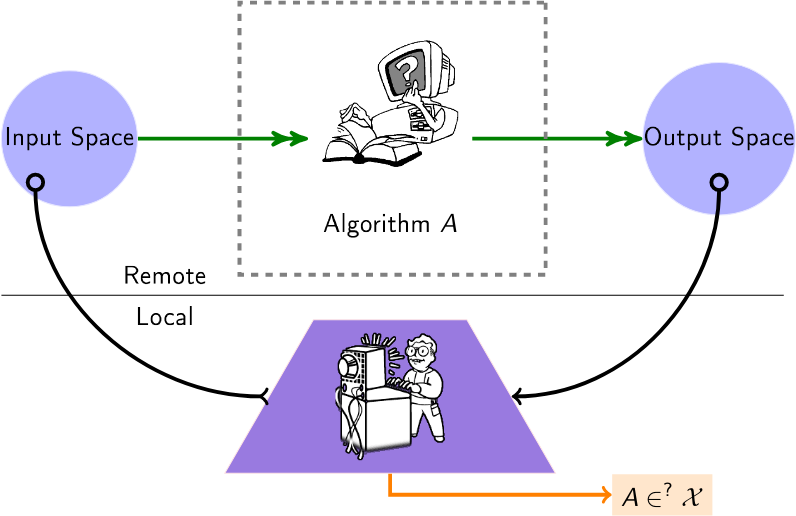

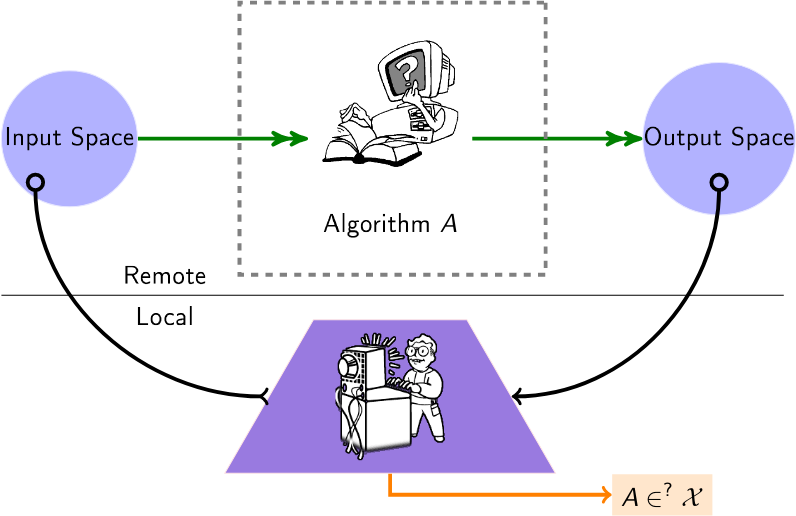

Daftar algoritme yang dikuratori untuk mengaudit algoritme kotak hitam. Saat ini, banyak algoritme (rekomendasi, penilaian, klasifikasi) dioperasikan pada penyedia pihak ketiga, tanpa pengguna atau institusi memiliki wawasan apa pun tentang cara mereka mengoperasikan datanya. Algoritme audit dalam daftar ini berlaku untuk pengaturan ini, yang disebut dengan pengaturan "kotak hitam", di mana seorang auditor ingin mendapatkan wawasan tentang algoritma jarak jauh ini.

Pengguna menanyakan algoritma jarak jauh (misalnya, melalui API yang tersedia), untuk menyimpulkan informasi tentang algoritma tersebut.

Isi

- Dokumen

- Acara Terkait (konferensi/lokakarya)

Dokumen

2024

- Mengaudit Penjelasan Lokal Itu Sulit - (NeurIPS) Memberikan kompleksitas kueri (yang melarang) untuk mengaudit penjelasan.

- LLM juga berhalusinasi grafik: perspektif struktural - (jaringan kompleks) Kueri LLM untuk grafik yang diketahui dan mempelajari halusinasi topologi. Mengusulkan peringkat halusinasi struktural.

- Audit Kewajaran dengan Kolaborasi Multi-Agen - (ECAI) Mempertimbangkan beberapa agen yang bekerja bersama, masing-masing mengaudit platform yang sama untuk tugas yang berbeda.

- Memetakan Bidang Audit Algoritma: Tinjauan Literatur Sistematis Mengidentifikasi Tren Penelitian, Disparitas Linguistik dan Geografis - (Arxiv) Tinjauan sistematis studi audit algoritma dan identifikasi tren dalam pendekatan metodologisnya.

- FairProof: Kewajaran yang Rahasia dan Dapat Disertifikasi untuk Jaringan Neural - (Arxiv) Mengusulkan paradigma alternatif terhadap audit tradisional menggunakan alat kriptografi seperti Zero-Knowledge Proofs; memberikan sistem yang disebut FairProof untuk memverifikasi keadilan jaringan saraf kecil.

- Jika ada manipulasi, apakah beberapa model AI lebih sulit diaudit? - (SATML) Menghubungkan kesulitan audit kotak hitam dengan kapasitas model yang ditargetkan, menggunakan kompleksitas Rademacher.

- Peningkatan Serangan Inferensi Keanggotaan Terhadap Model Klasifikasi Bahasa - (ICLR) Menyajikan kerangka kerja untuk menjalankan serangan inferensi keanggotaan terhadap pengklasifikasi, dalam mode audit.

- Mengaudit Kewajaran dengan Taruhan - (Neurips) [Kode] Metode berurutan yang memungkinkan pemantauan berkelanjutan terhadap data masuk dari pengklasifikasi atau regressor kotak hitam.

2023

- Audit Privasi dengan Satu (1) Proses Pelatihan - (NeurIPS - makalah terbaik) Skema untuk mengaudit sistem pembelajaran mesin privat yang berbeda dengan satu kali pelatihan.

- Mengaudit kewajaran dalam ketidaksadaran melalui penalaran kontrafaktual - (Pengolahan & Pengelolaan Informasi) Menunjukkan cara mengungkap apakah model kotak hitam yang sesuai dengan peraturan masih bias atau tidak.

- XAudit : Pandangan Teoritis tentang Audit dengan Penjelasan - (Arxiv) Meresmikan peran penjelasan dalam audit dan menyelidiki apakah dan bagaimana penjelasan model dapat membantu audit.

- Mengikuti Model Bahasa: Interaksi Kekokohan-Bias dalam Data dan Model NLI - (Arxiv) Mengusulkan cara untuk memperpanjang masa simpan kumpulan data audit dengan menggunakan model bahasa itu sendiri; juga menemukan masalah dengan metrik audit bias saat ini dan mengusulkan alternatif -- alternatif ini menyoroti bahwa kerapuhan model secara dangkal meningkatkan skor bias sebelumnya.

- Audit Kewajaran Online melalui Penyempurnaan Berulang - (KDD) Menyediakan proses adaptif yang mengotomatiskan inferensi jaminan probabilistik yang terkait dengan estimasi metrik keadilan.

- Mencuri Algoritma Decoding Model Bahasa - (CCS) Curi tipe dan hyperparameter algoritma decoding LLM.

- Memodelkan lubang kelinci di YouTube - (SNAM) Memodelkan dinamika penjebakan pengguna di lubang kelinci di YouTube, dan menyediakan ukuran lingkup ini.

- Mengaudit Algoritma Rekomendasi YouTube untuk Gelembung Filter Misinformasi - (Transaksi pada Sistem Rekomendasi) Apa yang diperlukan untuk “meledakkan gelembung”, yaitu mengembalikan batasan gelembung dari rekomendasi.

- Mengaudit Peringkat Bisnis Yelp dan Rekomendasi Tinjauan Melalui Lensa Kewajaran - (Arxiv) Mengaudit kewajaran sistem rekomendasi peringkat dan ulasan bisnis Yelp, dengan paritas demografis, paparan, dan uji statistik seperti regresi linier kuantil dan logistik.

- Confidential-PROFITT: BUKTI Rahasia Pelatihan Pohon yang Adil - (ICLR) Mengusulkan algoritma pembelajaran pohon keputusan yang adil bersama dengan protokol bukti tanpa pengetahuan untuk mendapatkan bukti keadilan pada server yang diaudit.

- SCALE-UP: Deteksi Pintu Belakang Tingkat Input Kotak Hitam yang Efisien melalui Analisis Konsistensi Prediksi Berskala - (ICLR) Mempertimbangkan deteksi pintu belakang dalam pengaturan kotak hitam dalam aplikasi pembelajaran mesin sebagai layanan (MLaaS).

2022

- Two-Face: Adversarial Audit of Commercial Face Recognition Systems - (ICWSM) Melakukan audit adversarial pada beberapa API sistem dan kumpulan data, membuat sejumlah observasi yang mengkhawatirkan.

- Meningkatkan audit mesin pencari: Wawasan praktis untuk audit algoritma - (Journal of Information Science) (Kode) Mengaudit beberapa mesin pencari menggunakan simulasi perilaku penjelajahan dengan agen virtual.

- Semangat: menuju jarak model yang tidak bergantung pada arsitektur - (ICLR) Mengukur jarak antara dua model jarak jauh menggunakan LIME.

- Audit Kewajaran Aktif - (ICML) Studi algoritma audit berbasis kueri yang dapat memperkirakan paritas demografis model ML dengan cara yang efisien dalam kueri.

- Lihatlah Variansnya! Penjelasan Kotak Hitam yang Efisien dengan Analisis Sensitivitas Berbasis Sobol - (NeurIPS) Indeks Sobol memberikan cara yang efisien untuk menangkap interaksi tingkat tinggi antara wilayah gambar dan kontribusinya terhadap prediksi jaringan saraf (kotak hitam) melalui lensa varians.

- Gema Anda Didengar: Pelacakan, Pembuatan Profil, dan Penargetan Iklan di Ekosistem Amazon Smart Speaker - (arxiv) Menyimpulkan hubungan antara sistem Amazon Echo dan algoritme penargetan iklan.

2021

- Ketika Wasit juga Menjadi Pemain: Bias dalam Rekomendasi Produk Private Label di Pasar E-commerce - (FAccT) Apakah produk private label Amazon mendapatkan rekomendasi yang tidak adil dan oleh karena itu diuntungkan dibandingkan dengan produk pihak ketiga?

- Audit Algoritma Sehari-hari: Memahami Kekuatan Pengguna Sehari-hari dalam Menampilkan Perilaku Algoritma yang Berbahaya - (CHI) Mendukung "audit algoritmik sehari-hari" oleh pengguna.

- Mengaudit Model Prediksi Kotak Hitam untuk Kepatuhan Minimalkan Data - (NeurIPS) Mengukur tingkat minimalisasi data yang dipenuhi oleh model prediksi menggunakan sejumlah kueri terbatas.

- Menetapkan Catatan Lebih Lurus pada Shadow Banning - (INFOCOM) (Kode) Mempertimbangkan kemungkinan shadow banning di Twitter (yaitu algoritma moderasi black-box), dan mengukur kemungkinan beberapa hipotesis.

- Mengekstrak Data Pelatihan dari Model Bahasa Besar - (Keamanan USENIX) Ekstrak urutan teks kata demi kata dari data pelatihan model GPT-2.

- FairLens: Mengaudit sistem pendukung keputusan klinis kotak hitam - (Pemrosesan & Manajemen Informasi) Menyajikan saluran untuk mendeteksi dan menjelaskan potensi masalah keadilan dalam DSS Klinis, dengan membandingkan ukuran disparitas klasifikasi multi-label yang berbeda.

- Mengaudit Bias Algoritma di Twitter - (WebSci).

- Eksekusi Algoritma Bayesian: Memperkirakan Properti Komputasi Fungsi Black-box Menggunakan Informasi Bersama - (ICML) Prosedur optimasi Bayesian yang dibatasi anggaran untuk mengekstraksi properti dari algoritma black-box.

2020

- Black-Box Ripper: Menyalin model kotak hitam menggunakan algoritma evolusioner generatif - (NeurIPS) Mereplikasi fungsi model saraf kotak hitam, namun tanpa batasan jumlah kueri (melalui skema guru/siswa dan penelusuran evolusioner) .

- Mengaudit jalur radikalisasi di - (FAT*) Mempelajari keterjangkauan saluran-saluran radikal satu sama lain, dengan menggunakan penelusuran acak pada rekomendasi saluran statis.

- Ekstraksi Model Adversarial pada Jaringan Neural Grafik - (Lokakarya AAAI tentang Pembelajaran Mendalam tentang Grafik: Metodologi dan Aplikasi) Memperkenalkan ekstraksi model GNN dan menyajikan pendekatan awal untuk ini.

- Penjelasan Jarak Jauh menghadapi masalah penjaga pintu - (Nature Machine Intelligence volume 2, halaman529–539) (Kode) Menunjukkan ketidakmungkinan (dengan satu permintaan) atau kesulitan menemukan kebohongan pada penjelasan keputusan AI jarak jauh.

- GeoDA: kerangka geometris untuk serangan permusuhan kotak hitam - (CVPR) (Kode) Membuat contoh permusuhan untuk mengelabui model, dalam pengaturan kotak hitam murni (tanpa gradien, hanya kelas yang disimpulkan).

- Permainan Imitasi: Pemilihan Algoritma dengan Memanfaatkan Rekomendasi Black-Box - (Netys) (Kode) Parametrikan algoritma rekomendasi lokal dengan meniru keputusan dari algoritma jarak jauh dan lebih terlatih.

- Mengaudit Sistem Kurasi Berita: Studi Kasus yang Menelaah Logika Algoritma dan Editorial di Apple News - (ICWSM) Studi audit Apple News sebagai sistem kurasi berita sosioteknik (bagian berita yang sedang tren).

- Algoritma Audit: Tentang Pembelajaran dan Risiko Minimisasi Data - (AIES) Audit praktis untuk aplikasi rekomendasi kesejahteraan yang dikembangkan oleh Telefónica (kebanyakan berdasarkan bias).

- Mengekstrak Data Pelatihan dari Model Bahasa Besar - (arxiv) Melakukan serangan ekstraksi data pelatihan untuk memulihkan contoh pelatihan individual dengan menanyakan model bahasa.

2019

- Adversarial Frontier Stitching untuk Watermarking Jaringan Neural Jarak Jauh - (Komputasi dan Aplikasi Neural) (Implementasi alternatif) Periksa apakah model pembelajaran mesin jarak jauh adalah model yang "bocor": melalui permintaan API standar ke model jarak jauh, ekstrak (atau tidak) zero- bit watermark, yang disisipkan ke model berharga watermark (misalnya, jaringan saraf dalam yang besar).

- Knockoff Nets: Mencuri Fungsi Model Kotak Hitam - (CVPR) Tanyakan sejauh mana musuh dapat mencuri fungsi model "korban" tersebut hanya berdasarkan interaksi kotak hitam: gambar masuk, prediksi keluar.

- Membuka Kotak Hitam: Mengaudit Algoritma Berita Utama Google - (Flairs-32) Audit panel Berita utama Google yang memberikan wawasan tentang pilihan algoritmiknya untuk memilih dan memberi peringkat penerbit berita

- Menjadikan serangan penghindaran kotak hitam yang ditargetkan menjadi efektif dan efisien - (arXiv) Menyelidiki bagaimana musuh dapat menggunakan anggaran kuerinya secara optimal untuk serangan penghindaran yang ditargetkan terhadap jaringan saraf dalam.

- Pembelajaran Online untuk Mengukur Kompatibilitas Insentif dalam Lelang Iklan - (WWW) Mengukur mekanisme yang kompatibel dengan insentif (IC) (penyesalan) pada platform lelang kotak hitam.

- TamperNN: Deteksi Gangguan yang Efisien pada Jaringan Neural yang Dikerahkan - (ISSRE) Algoritma untuk membuat masukan yang dapat mendeteksi gangguan dengan model pengklasifikasi yang dijalankan dari jarak jauh.

- Serangan Ekstraksi Model Jaringan Neural di Perangkat Edge dengan Mendengar Petunjuk Arsitektur - (arxiv) Melalui perolehan peristiwa akses memori dari pengintaian bus, identifikasi urutan lapisan dengan model LSTM-CTC, koneksi topologi lapisan sesuai dengan pola akses memori, dan estimasi dimensi lapisan di bawah kendala volume data, hal ini menunjukkan bahwa seseorang dapat memulihkan arsitektur jaringan yang sama secara akurat sebagai titik awal serangan

- Mencuri Pengetahuan dari Jaringan Neural Dalam yang Dilindungi Menggunakan Data Tak Berlabel Komposit - (ICNN) Metode komposit yang dapat digunakan untuk menyerang dan mengekstrak pengetahuan model kotak hitam bahkan jika model tersebut sepenuhnya menyembunyikan output softmax-nya.

- Inversi Jaringan Neural dalam Setting Adversarial melalui Penyelarasan Pengetahuan Latar Belakang - (CCS) Pendekatan inversi model dalam setting adversary berdasarkan pada pelatihan model inversi yang bertindak sebagai kebalikan dari model aslinya. Tanpa pengetahuan penuh tentang data pelatihan asli, inversi yang akurat masih dapat dilakukan dengan melatih model inversi pada sampel tambahan yang diambil dari distribusi data yang lebih umum.

2018

- Penjelasan Kontrafaktual tanpa Membuka Kotak Hitam: Keputusan Otomatis dan GDPR - (Harvard Journal of Law & Technology) Untuk menjelaskan keputusan pada x, temukan kontrafaktual: titik terdekat ke x yang mengubah keputusan.

- Saring-dan-Bandingkan: Mengaudit Model Kotak Hitam Menggunakan Distilasi Model Transparan - (AIES) Memperlakukan model kotak hitam sebagai guru, melatih model siswa transparan untuk meniru skor risiko yang diberikan oleh model kotak hitam.

- Menuju Rekayasa Terbalik Jaringan Neural Black-Box - (ICLR) (Kode) Menyimpulkan hyperparameter bagian dalam (misalnya jumlah lapisan, jenis aktivasi non-linier) dari model jaringan saraf jarak jauh dengan menganalisis pola responsnya terhadap masukan tertentu.

- Serangan eksplorasi berbasis data pada pengklasifikasi kotak hitam di domain permusuhan - (Neurocomputing) Merekayasa balik model pengklasifikasi jarak jauh (misalnya, untuk menghindari pengujian CAPTCHA).

- xGEMs: Menghasilkan Contoh untuk Menjelaskan Model Kotak Hitam - (arXiv) Mencari bias dalam model kotak hitam dengan melatih model generatif implisit tanpa pengawasan. Kemudian merangkum perilaku model kotak hitam secara kuantitatif dengan mengganggu sampel data di sepanjang manifold data.

- Jaringan Pembelajaran dari Kemiripan Node Berbasis Jalan Acak - (NIPS) Membalikkan grafik dengan mengamati beberapa waktu perjalanan jalan kaki secara acak.

- Mengidentifikasi Kelompok Machine Learning dari Model Black-Box - (CAEPIA) Menentukan jenis model machine learning mana yang berada di balik prediksi yang dihasilkan.

- Mencuri Jaringan Neural melalui Saluran Sisi Waktu - (arXiv) Mencuri/mendekati model melalui serangan waktu menggunakan kueri.

- Peniru CNN: Mencuri Pengetahuan dengan Membujuk Pengakuan dengan Data Acak Tanpa Label - (IJCNN) (Kode) Mencuri pengetahuan model kotak hitam (CNN) dengan menanyakannya menggunakan gambar alami acak (ImageNet dan Microsoft-COCO).

- Mengaudit Personalisasi dan Komposisi Laman Hasil Mesin Telusur Terkait Politik - (WWW) Ekstensi Chrome untuk mensurvei peserta dan mengumpulkan Laman Hasil Mesin Telusur (SERP) dan saran pelengkapan otomatis, untuk mempelajari personalisasi dan komposisi.

2017

- Mengungkap Buku Masak Pengaruh: Rekayasa Balik Dampak Topologi dalam Layanan Pemeringkatan Sejawat - (CSCW) Bertujuan untuk mengidentifikasi metrik sentralitas mana yang digunakan dalam layanan pemeringkatan sejawat.

- Tampilan topologi rekomendasi: model dan aplikasi untuk deteksi bias - (Jaringan Kompleks) Mengusulkan kerangka deteksi bias untuk item yang direkomendasikan kepada pengguna.

- Serangan Inferensi Keanggotaan Terhadap Model Pembelajaran Mesin - (Simposium Keamanan dan Privasi) Dengan adanya model pembelajaran mesin dan catatannya, tentukan apakah catatan ini digunakan sebagai bagian dari kumpulan data pelatihan model atau tidak.

- Serangan Black-Box Praktis terhadap Pembelajaran Mesin - (Asia CCS) Memahami betapa rentannya layanan jarak jauh terhadap serangan klasifikasi permusuhan.

2016

- Transparansi Algoritmik melalui Pengaruh Input Kuantitatif: Teori dan Eksperimen dengan Sistem Pembelajaran - (IEEE S&P) Mengevaluasi pengaruh fitur individu, gabungan, dan marginal pada model menggunakan nilai shapley.

- Mengaudit Model Kotak Hitam untuk Pengaruh Tidak Langsung - (ICDM) Mengevaluasi pengaruh suatu variabel pada model kotak hitam dengan "secara cerdik" menghapusnya dari kumpulan data dan melihat kesenjangan akurasi

- Proyeksi Fitur Ortogonal Iteratif untuk Mendiagnosis Bias pada Model Kotak Hitam - (Lokakarya FATML) Melakukan pemeringkatan fitur untuk menganalisis model kotak hitam

- Bias di Pasar Freelance Online: Bukti dari TaskRabbit - (lokakarya itu) Mengukur peringkat algoritma pencarian TaskRabbit.

- Mencuri Model Pembelajaran Mesin melalui API Prediksi - (Keamanan Usenix) (Kode) Bertujuan untuk mengekstraksi model pembelajaran mesin yang digunakan oleh layanan jarak jauh.

- “Mengapa Saya Harus Mempercayai Anda?”Menjelaskan Prediksi Pengklasifikasi Apa Pun - (arXiv) (Kode) Menjelaskan model pengklasifikasi blackbox dengan mengambil sampel di sekitar contoh data.

- Back in Black: Menuju Formal, Analisis Black Box pada Sanitizer dan Filter - (Keamanan dan Privasi) Analisis black-box pada sanitizer dan filter.

- Transparansi Algoritmik melalui Pengaruh Masukan Kuantitatif: Teori dan Eksperimen dengan Sistem Pembelajaran - (Keamanan dan Privasi) Memperkenalkan langkah-langkah yang menangkap tingkat pengaruh masukan terhadap keluaran sistem yang diamati.

- Analisis Empiris Penetapan Harga Algoritmik di Amazon Marketplace - (WWW) (Kode) Mengembangkan metodologi untuk mendeteksi penetapan harga algoritmik, dan menggunakannya secara empiris untuk menganalisis prevalensi dan perilakunya di Amazon Marketplace.

2015

- Sertifikasi dan Penghapusan Dampak yang Berbeda - (SIGKDD) Mengusulkan metode berbasis SVM untuk menyatakan tidak adanya bias dan metode untuk menghilangkan bias dari kumpulan data.

- Mengintip Di Balik Terpal Uber - (IMC) Menyimpulkan detail implementasi algoritma lonjakan harga Uber.

2014

- Sekilas tentang kotak hitam: menjelajahi pengklasifikasi dengan pengacakan - (jurnal Data Mining dan Knowledge Discovery) (kode) Menemukan kelompok fitur yang dapat diubah tanpa mengubah label keluaran sampel yang diprediksi

- XRay: Meningkatkan Transparansi Web dengan Korelasi Diferensial - (Keamanan USENIX) Mengaudit data profil pengguna yang digunakan untuk menargetkan iklan, rekomendasi, atau harga tertentu.

2013

- Mengukur Personalisasi Pencarian Web - (WWW) Mengembangkan metodologi untuk mengukur personalisasi dalam hasil pencarian Web.

- Audit: Pembelajaran Aktif dengan Biaya Kueri yang Bergantung pada Hasil - (NIPS) Belajar dari pengklasifikasi biner yang hanya membayar label negatif.

2012

- Strategi Kueri untuk Menghindari Pengklasifikasi Penginduksi Cembung - (JMLR) Metode penghindaran untuk pengklasifikasi cembung. Mempertimbangkan kompleksitas penghindaran.

2008

- Privacy Oracle: Sistem untuk Menemukan Kebocoran Aplikasi dengan Pengujian Diferensial Black Box - (CCS) Privacy Oracle: sistem yang mengungkap kebocoran informasi pribadi aplikasi dalam transmisi ke server jarak jauh.

2005

- Pembelajaran Adversarial - (KDD) Rekayasa balik pengklasifikasi linier jarak jauh, menggunakan kueri keanggotaan.

Acara Terkait

2024

- Konferensi Internasional Pertama tentang Audit dan Kecerdasan Buatan

- Lokakarya ML yang Dapat Diatur (RegML'24)

2023

- Mendukung Keterlibatan Pengguna dalam Pengujian, Audit, dan Kompetisi AI (Audit AI Pengguna CSCW)

- Workshop Audit Algoritma Algoritma (WAAA)

- Lokakarya ML yang Dapat Diatur (RegML'23)