Kami merancang kerangka kerja rekonstruksi berbasis DL baru untuk mengatasi masalah pemulihan gambar berkualitas tinggi dan cepat dalam pencitraan piksel tunggal

Selamat menonton ? repositori ini untuk pembaruan terkini.

✅ [2023.12.18] : Kami telah merilis kode kami!

✅ [2021.07.21] : Kami telah merilis makalah kami, SPI-GAN di arXiv.

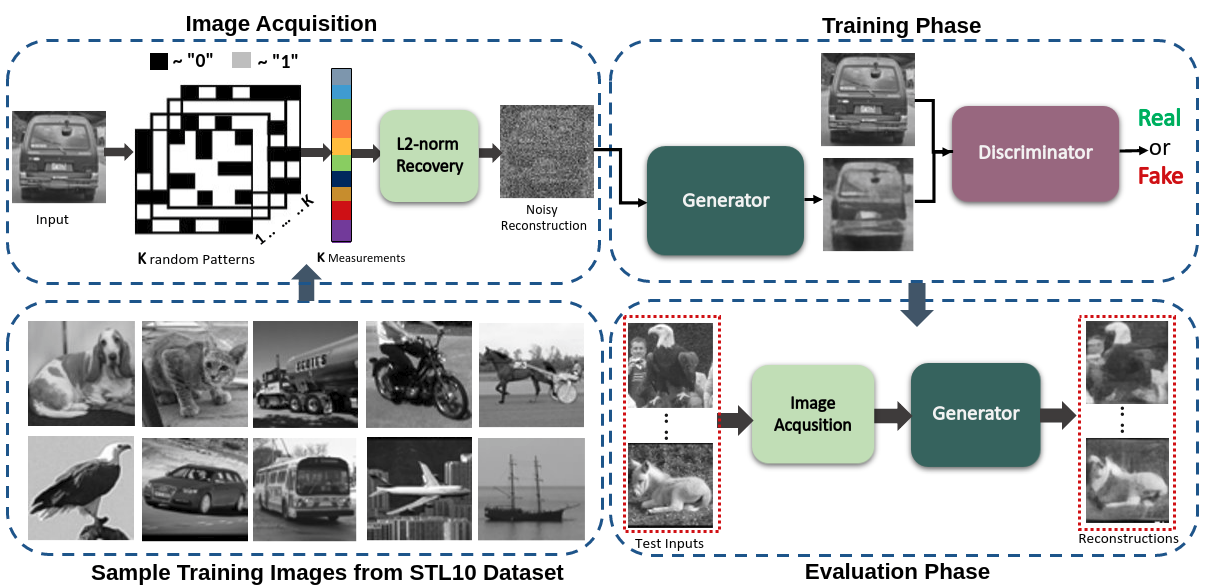

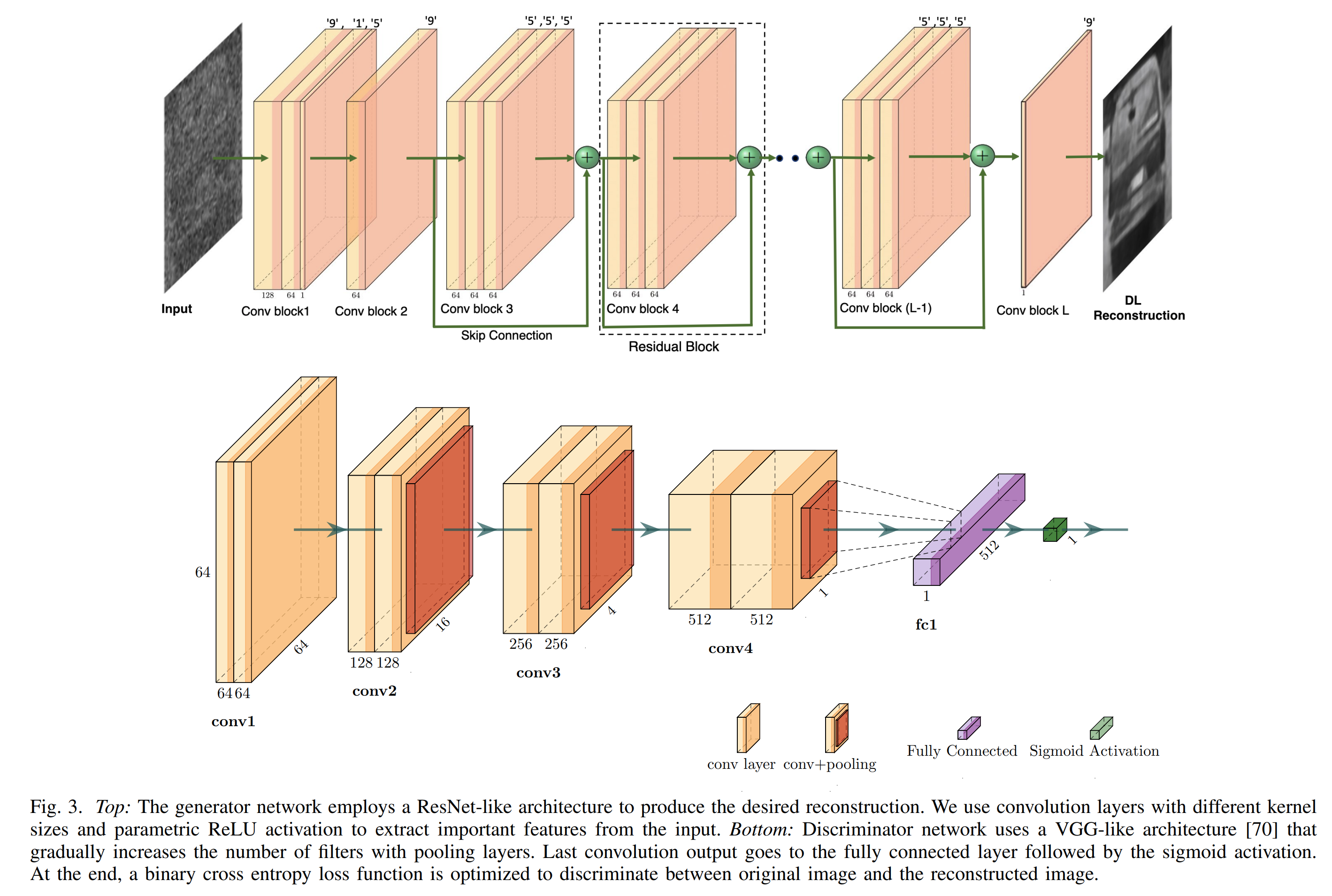

Kerangka kerja SPI-GAN yang kami usulkan terutama terdiri dari generator yang mengambil solusi norma-l2 yang berisik (xˆ_noisy) dan menghasilkan rekonstruksi yang jelas (xˆ) yang sebanding dengan x. Di sisi lain, seorang diskriminator belajar membedakan antara x dan xˆ agar tidak tertipu oleh generator.

Kerangka kerja SPI-GAN yang kami usulkan terutama terdiri dari generator yang mengambil solusi norma-l2 yang berisik (xˆ_noisy) dan menghasilkan rekonstruksi yang jelas (xˆ) yang sebanding dengan x. Di sisi lain, seorang diskriminator belajar membedakan antara x dan xˆ agar tidak tertipu oleh generator.

Instal Anaconda dan ciptakan lingkungan

conda create -n spi_gan python=3.10

conda activate spi_ganSetelah membuat lingkungan virtual, jalankan

pip install -r requirements.txtPertama unduh dataset STL10 dan UCF101. Anda dapat menemukan kedua dataset ini dengan sangat mudah.

Jika Anda Ingin Membuat gambar yang akan dimasukkan ke GAN, Jalankan kode Matlab "L2Norm_Solution.m" untuk menghasilkan solusi l2-norm. Buat Folder yang Diperlukan sebelum dijalankan. Saya juga akan mengunggah versi python ini di masa mendatang.

Jalankan ini untuk membuat file .npy dengan pengaturan berbeda

python save_numpy.pyUntuk Pelatihan-

python Main_Reconstruction.pyUnduh video dan pembagian latihan/tes di sini.

Konversi dari file avi ke jpg menggunakan util_scripts/generate_video_jpgs.py

python -m util_scripts.generate_video_jpgs avi_video_dir_path jpg_video_dir_path ucf101 Hasilkan file anotasi dalam format json mirip dengan ActivityNet menggunakan util_scripts/ucf101_json.py

annotation_dir_path mencakup classInd.txt, trainlist0{1, 2, 3}.txt, testlist0{1, 2, 3}.txt

python -m util_scripts.ucf101_json annotation_dir_path jpg_video_dir_path dst_json_path

Jika Anda merasa makalah dan kode kami berguna dalam penelitian Anda, mohon pertimbangkan untuk memberikan bintang dan kutipan.

@misc { karim2021spigan ,

title = { SPI-GAN: Towards Single-Pixel Imaging through Generative Adversarial Network } ,

author = { Nazmul Karim and Nazanin Rahnavard } ,

year = { 2021 } ,

eprint = { 2107.01330 } ,

archivePrefix = { arXiv } ,

primaryClass = { cs.CV }

}