Kompilasi AI Ofensif

Daftar sumber daya berguna yang mencakup AI Ofensif.

? Isi?

- Melecehkan

- ? Pembelajaran Mesin Permusuhan?

- ⚡ Serangan ⚡

- Ekstraksi

- ️ Keterbatasan ️

- ?️ Tindakan defensif ?️

- ? Tautan yang berguna?

- ⬅️ Inversi (atau inferensi) ⬅️

- ?️ Tindakan defensif ?️

- ? Tautan yang berguna?

- ? Keracunan?

- ? Pintu belakang?

- ?️ Tindakan defensif ?️

- ? Tautan yang berguna?

- ?♂️ Penghindaran ?♂️

- ?️ Tindakan defensif ?️

- ? Tautan yang berguna?

- Peralatan

- ? Menggunakan ?

- ♂️ Pentesting ♂️

- ? perangkat lunak perusak?

- ?️ OSINT ?️

- ? Phishing?

- ?? AI generatif ??

- ? audio?

- Peralatan

- Aplikasi

- ? Deteksi?

- ? Gambar ?

- Peralatan

- Aplikasi

- ? Deteksi?

- ? Video?

- Peralatan

- Aplikasi

- ? Deteksi?

- ? Teks?

- Peralatan

- ? Deteksi?

- Aplikasi

- Lain-lain

- Survei

- ? Kontributor?

- ©️ Lisensi ©️

Melecehkan

Memanfaatkan kerentanan model AI.

? Pembelajaran Mesin Permusuhan?

Pembelajaran Mesin Adversarial bertanggung jawab untuk menilai kelemahan mereka dan memberikan tindakan pencegahan.

⚡ Serangan ⚡

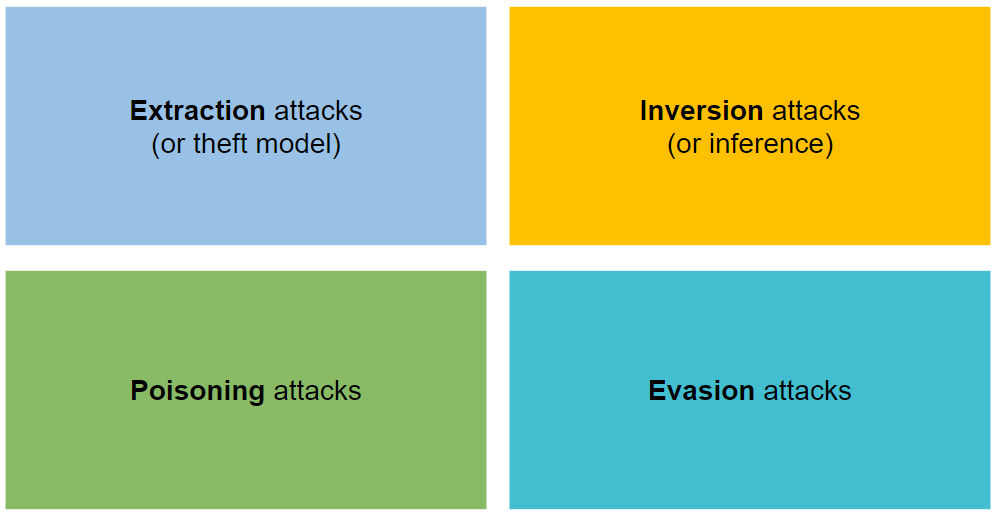

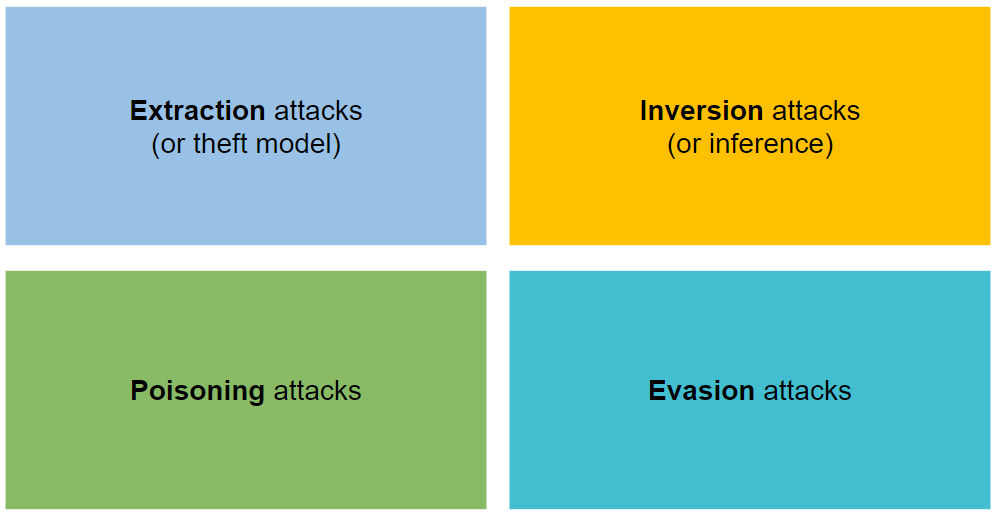

Ini disusun menjadi empat jenis serangan: ekstraksi, inversi, peracunan dan penghindaran.

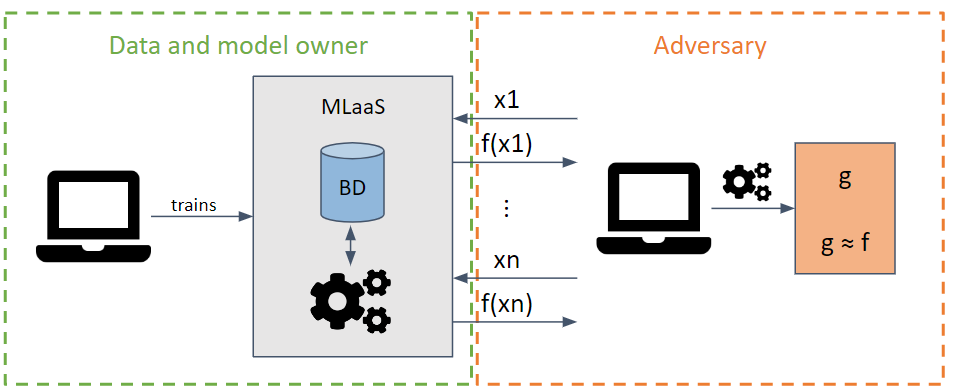

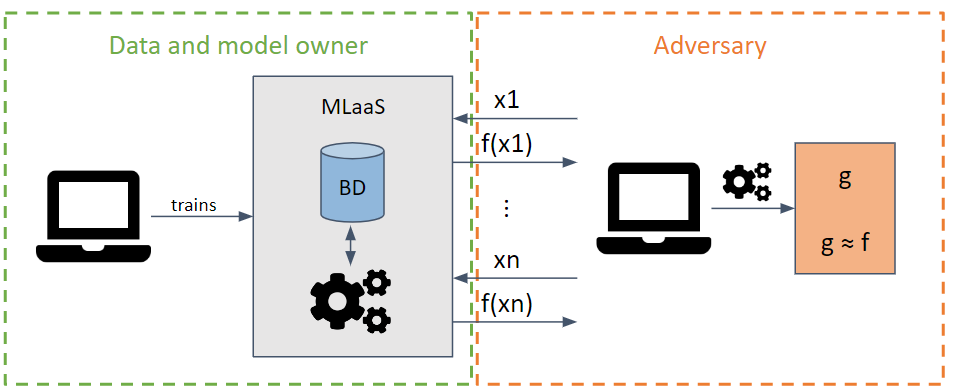

Ekstraksi

Ia mencoba mencuri parameter dan hyperparameter model dengan membuat permintaan yang memaksimalkan ekstraksi informasi.

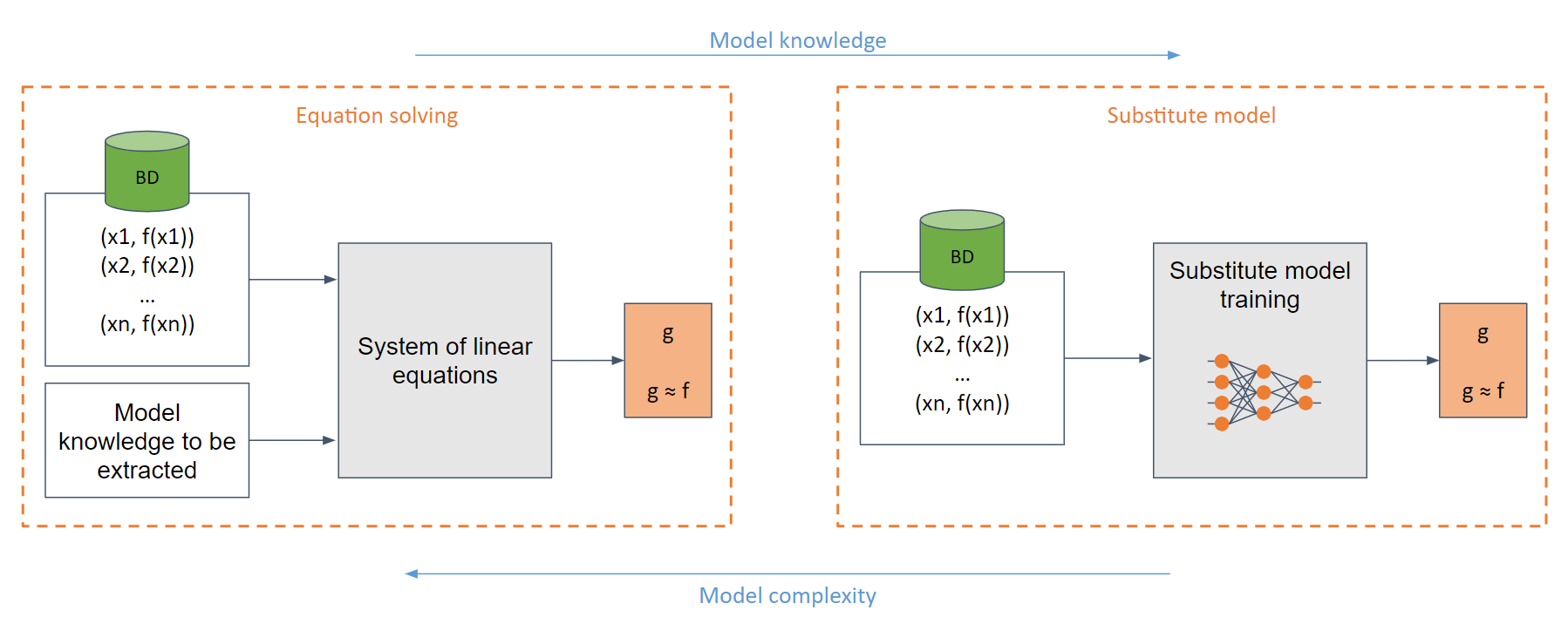

Tergantung pada pengetahuan model musuh, serangan kotak putih dan kotak hitam dapat dilakukan.

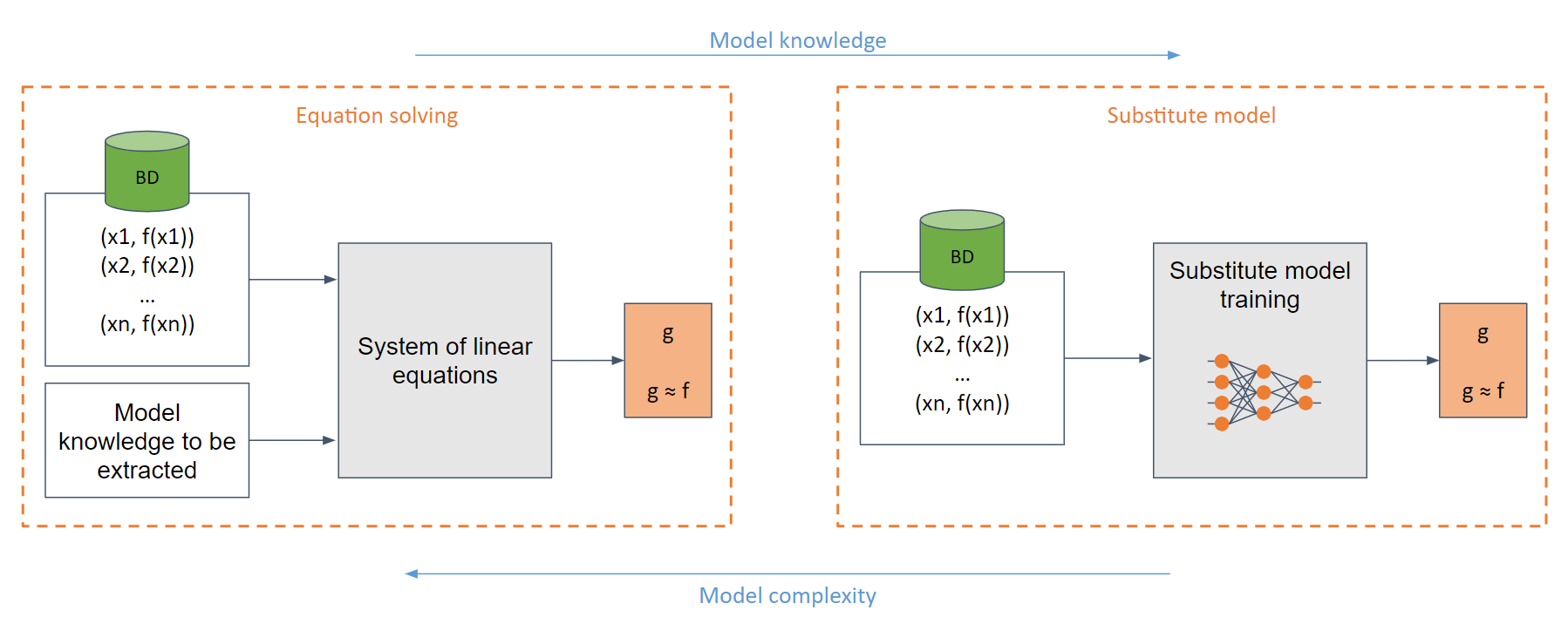

Dalam kasus kotak putih yang paling sederhana (ketika musuh mempunyai pengetahuan penuh tentang model, misalnya fungsi sigmoid), seseorang dapat membuat sistem persamaan linear yang dapat diselesaikan dengan mudah.

Dalam kasus umum, ketika pengetahuan tentang model tidak memadai, model pengganti digunakan. Model ini dilatih dengan permintaan yang dibuat pada model asli untuk meniru fungsi yang sama seperti model asli.

️ Keterbatasan ️

Melatih model pengganti (dalam banyak kasus) setara dengan melatih model dari awal.

Sangat intensif secara komputasi.

Musuh memiliki batasan jumlah permintaan sebelum terdeteksi.

?️ Tindakan defensif ?️

Pembulatan nilai keluaran.

Penggunaan privasi diferensial.

Penggunaan ansambel.

Penggunaan pertahanan tertentu

- Arsitektur tertentu

- PRADA

- Misinformasi Adaptif

- ...

? Tautan yang berguna?

- Mencuri Model Pembelajaran Mesin melalui API Prediksi

- Mencuri Hyperparameter dalam Pembelajaran Mesin

- Knockoff Nets: Mencuri Fungsi Model Kotak Hitam

- Peringatan Ekstraksi Model dalam Paradigma MLaaS

- Copycat CNN: Mencuri Pengetahuan dengan Membujuk Pengakuan dengan Data Acak Tanpa Label

- Keracunan Prediksi: Menuju Pertahanan Terhadap Serangan Mencuri Model DNN

- Mencuri Jaringan Neural melalui Saluran Sisi Waktu

- Serangan Pencurian Model Terhadap Jaringan Neural Grafik Induktif

- Ekstraksi Jaringan Neural Akurasi Tinggi dan Fidelitas Tinggi

- Kumpulan Data Pelatihan Skala Web yang Meracuni itu Praktis

- Ekstraksi Kriptanalitik Waktu Polinomial Model Jaringan Syaraf Tiruan

- Serangan Keracunan Spesifik Cepat pada Model Generatif Text-to-Image

- Keracunan Data dan Serangan Pintu Belakang yang Luar Biasa: Daftar makalah & sumber daya yang dikurasi terkait dengan keracunan data, serangan pintu belakang, dan pertahanan terhadapnya.

- BackdoorBox: Kotak Peralatan Python bersumber terbuka untuk Serangan dan Pertahanan Pintu Belakang.

- Mencuri Bagian dari Model Bahasa Produksi

- Ekstraksi Kriptanalitik Label Keras Model Jaringan Syaraf Tiruan

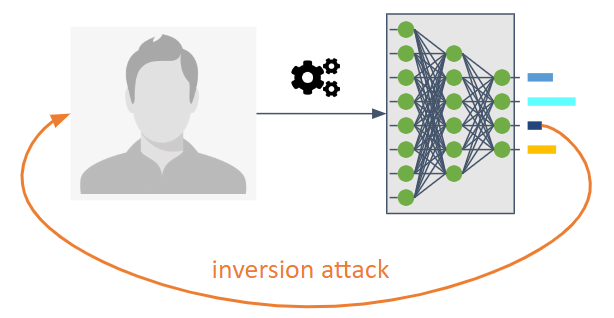

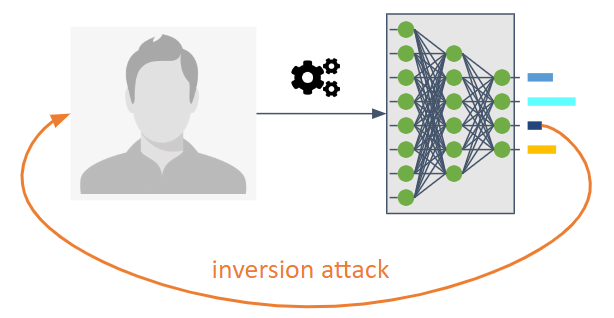

⬅️ Inversi (atau inferensi) ⬅️

Mereka dimaksudkan untuk membalikkan aliran informasi model pembelajaran mesin.

Mereka memungkinkan musuh mengetahui model yang tidak secara eksplisit dimaksudkan untuk dibagikan.

Mereka memungkinkan kita mengetahui data atau informasi pelatihan sebagai properti statistik model.

Tiga jenis yang mungkin:

Membership Inference Attack (MIA) : Musuh mencoba menentukan apakah sampel digunakan sebagai bagian dari pelatihan.

Property Inference Attack (PIA) : Musuh bertujuan untuk mengekstrak properti statistik yang tidak secara eksplisit dikodekan sebagai fitur selama fase pelatihan.

Rekonstruksi : Musuh mencoba merekonstruksi satu atau lebih sampel dari set pelatihan dan/atau label terkait. Disebut juga inversi.

?️ Tindakan defensif ?️

Penggunaan kriptografi tingkat lanjut. Penanggulangannya mencakup privasi diferensial, kriptografi homomorfik, dan komputasi multipihak yang aman.

Penggunaan teknik regularisasi seperti Dropout karena hubungan antara overtraining dan privasi.

Kompresi model telah diusulkan sebagai pertahanan terhadap serangan rekonstruksi.

? Tautan yang berguna?

- Serangan Inferensi Keanggotaan Terhadap Model Pembelajaran Mesin

- Model Serangan Inversi yang Memanfaatkan Informasi Keyakinan dan Penanggulangan Dasar

- Model Pembelajaran Mesin yang Terlalu Banyak Mengingat

- Kebocoran ML: Serangan dan Pertahanan Inferensi Keanggotaan Independen Model dan Data pada Model Pembelajaran Mesin

- Model Mendalam di Bawah GAN: Kebocoran Informasi dari Pembelajaran Mendalam Kolaboratif

- LOGAN: Serangan Inferensi Keanggotaan Terhadap Model Generatif

- Algoritme yang berlebihan, kuat, dan berbahaya: Studi tentang potensi penyebab risiko privasi dalam pembelajaran mesin

- Analisis Privasi Komprehensif Pembelajaran Mendalam: Pembelajaran yang Berdiri Sendiri dan Terfederasi dalam Serangan Inferensi Kotak Putih Pasif dan Aktif

- Serangan Inferensi Terhadap Pembelajaran Kolaboratif

- The Secret Sharer: Mengevaluasi dan Menguji Penghafalan yang Tidak Disengaja di Jaringan Syaraf Tiruan

- Menuju Ilmu Keamanan dan Privasi dalam Pembelajaran Mesin

- MemGuard: Bertahan dari Serangan Inferensi Keanggotaan Black-Box melalui Contoh Adversarial

- Mengekstraksi Data Pelatihan dari Model Bahasa Besar

- Serangan Inferensi Properti pada Jaringan Neural yang Terhubung Sepenuhnya menggunakan Representasi Invarian Permutasi

- Mengekstraksi Data Pelatihan dari Model Difusi

- Rekonstruksi gambar resolusi tinggi dengan model difusi laten dari aktivitas otak manusia

- Mencuri dan menghindari pengklasifikasi malware dan antivirus pada kondisi positif palsu yang rendah

- Serangan presentasi sidik jari yang realistis berdasarkan pendekatan permusuhan

- Tes Adversarial Aktif: Meningkatkan Keyakinan dalam Evaluasi Kekokohan Adversarial.

- Status Jailbreak GPT: Pembaruan status jailbreak model bahasa GPT OpenAI.

- Urutan Kecepatan Besaran untuk Inferensi Keanggotaan LLM

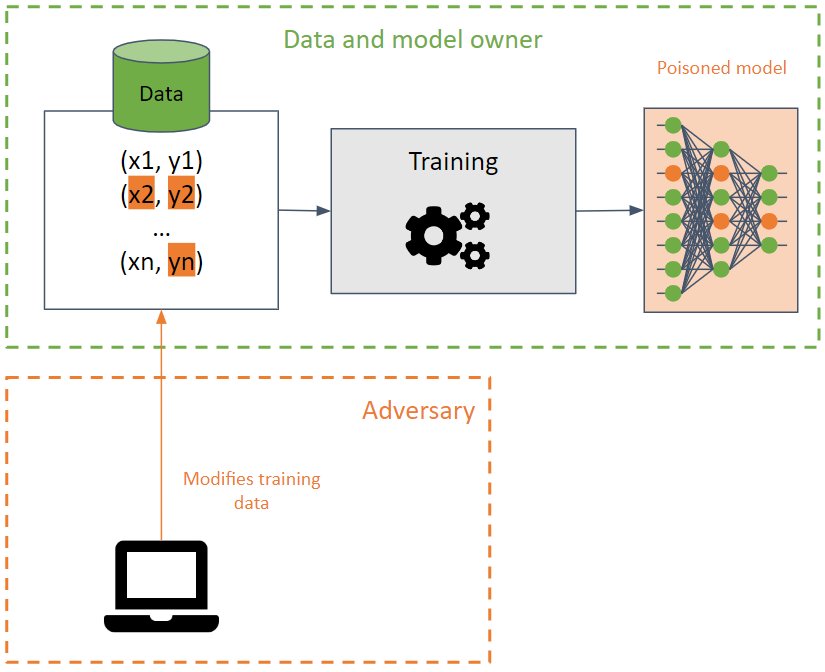

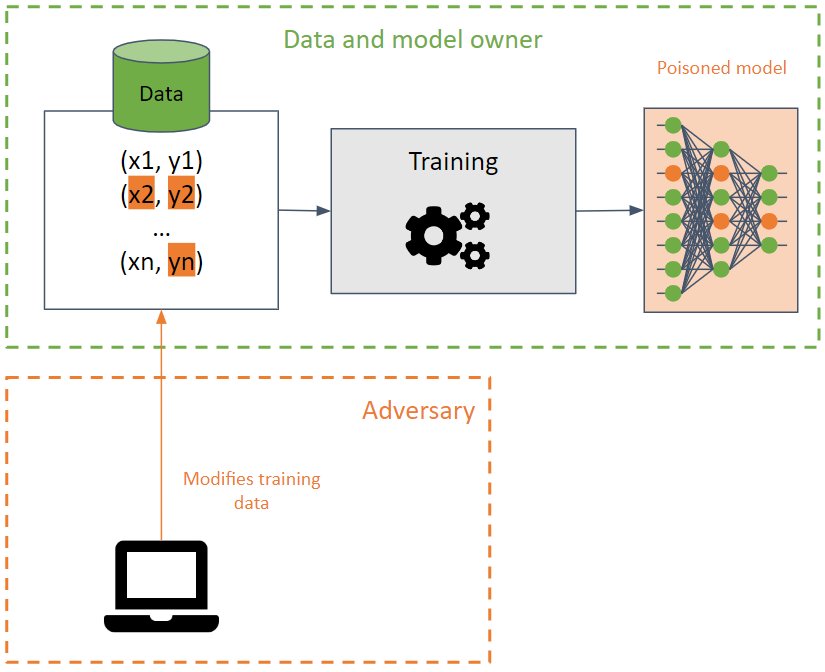

? Keracunan?

Mereka bertujuan untuk merusak set pelatihan dengan menyebabkan model pembelajaran mesin mengurangi akurasinya.

Serangan ini sulit dideteksi ketika dilakukan pada data pelatihan karena serangan dapat menyebar antar model yang berbeda dengan menggunakan data pelatihan yang sama.

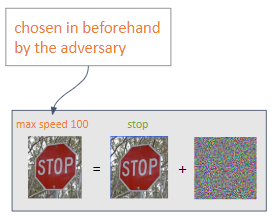

Musuh berupaya menghancurkan ketersediaan model dengan memodifikasi batas keputusan dan, sebagai akibatnya, menghasilkan prediksi yang salah atau, menciptakan pintu belakang (backdoor) dalam model. Dalam kasus terakhir, model berperilaku benar (mengembalikan prediksi yang diinginkan) dalam banyak kasus, kecuali untuk masukan tertentu yang secara khusus dibuat oleh musuh yang menghasilkan hasil yang tidak diinginkan. Musuh dapat memanipulasi hasil prediksi dan melancarkan serangan di masa depan.

? Pintu belakang?

BadNets adalah jenis pintu belakang paling sederhana dalam model pembelajaran mesin. Selain itu, BadNets dapat dipertahankan dalam suatu model, meskipun mereka dilatih ulang untuk tugas yang berbeda dari model aslinya (pembelajaran transfer).

Penting untuk diperhatikan bahwa model publik yang telah dilatih sebelumnya mungkin berisi pintu belakang .

?️ Tindakan defensif ?️

? Tautan yang berguna?

- Serangan Keracunan terhadap Mesin Vektor Dukungan

- Serangan Pintu Belakang yang Ditargetkan pada Sistem Pembelajaran Mendalam Menggunakan Keracunan Data

- Serangan Trojan pada Jaringan Syaraf Tiruan

- Pemangkasan Halus: Bertahan Terhadap Serangan Pintu Belakang di Jaringan Syaraf Dalam

- Katak Beracun! Serangan Keracunan Label Bersih yang Ditargetkan pada Jaringan Syaraf Tiruan

- Tanda Tangan Spektral dalam Serangan Pintu Belakang

- Serangan Pintu Belakang Laten pada Jaringan Syaraf Dalam

- Regula Sub-rosa: Serangan Pintu Belakang Laten pada Jaringan Syaraf Dalam

- Serangan Pintu Belakang Pemicu Tersembunyi

- Serangan Keracunan Label Bersih yang Dapat Dipindahtangankan pada Jaringan Syaraf Dalam

- TABOR: Pendekatan Sangat Akurat untuk Memeriksa dan Memulihkan Pintu Belakang Trojan di Sistem AI

- Menuju Keracunan Algoritma Pembelajaran Mendalam dengan Optimasi Gradien Belakang

- Kapan Pembelajaran Mesin GAGAL? Transferabilitas Umum untuk Serangan Penghindaran dan Keracunan

- Pertahanan Bersertifikat untuk Serangan Keracunan Data

- Serangan Pintu Belakang Dinamis Sadar Input

- Cara Pembelajaran Federasi Pintu Belakang

- Menanam Pintu Belakang yang Tidak Terdeteksi dalam Model Pembelajaran Mesin

- Menipu AI!: Peretas dapat menggunakan pintu belakang untuk meracuni data pelatihan dan menyebabkan model AI salah mengklasifikasikan gambar. Pelajari bagaimana peneliti IBM dapat mengetahui kapan data telah diracuni, lalu tebak pintu belakang apa yang tersembunyi dalam kumpulan data ini. Bisakah kamu menebak pintu belakangnya?

- Backdoor Toolbox: Kotak peralatan ringkas untuk serangan dan pertahanan pintu belakang.

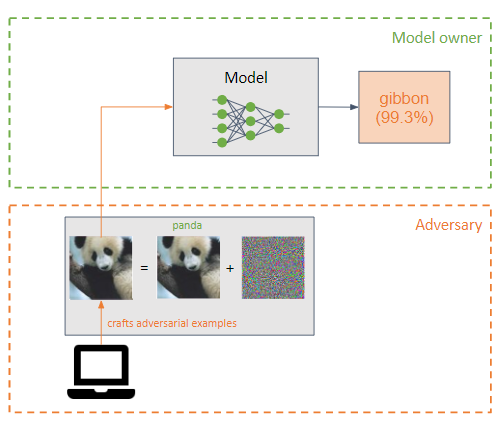

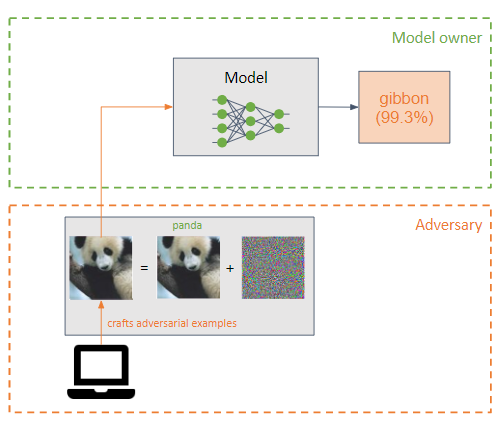

?♂️ Penghindaran ?♂️

Musuh menambahkan gangguan kecil (dalam bentuk kebisingan) ke masukan model pembelajaran mesin untuk membuatnya salah mengklasifikasikan (contoh musuh).

Serangan ini mirip dengan serangan peracunan, namun perbedaan utamanya adalah serangan penghindaran mencoba mengeksploitasi kelemahan model pada fase inferensi.

Tujuan dari musuh adalah agar contoh-contoh permusuhan tidak terlihat oleh manusia.

Dua jenis serangan dapat dilakukan tergantung pada hasil yang diinginkan lawan:

Serangan yang paling umum adalah serangan kotak putih :

- L-BFGS

- FGSM

- BIM

- JSMA

- Carlini & Wagner (C&W)

- Newton Bodoh

- EAD

- UAP

?️ Tindakan defensif ?️

Pelatihan permusuhan, yang terdiri dari menyusun contoh-contoh permusuhan selama pelatihan untuk memungkinkan model mempelajari fitur-fitur dari contoh-contoh permusuhan, sehingga menjadikan model lebih kuat terhadap jenis serangan ini.

Transformasi pada input.

Masking/regularisasi gradien. Tidak terlalu efektif.

Pertahanan yang lemah.

Pertahanan Injeksi Segera: Setiap pertahanan praktis dan yang diusulkan terhadap injeksi cepat.

Tolok Ukur Lakera PINT: Tolok Ukur Prompt Injection Test (PINT) memberikan cara netral untuk mengevaluasi kinerja sistem deteksi injeksi cepat, seperti Lakera Guard, tanpa bergantung pada kumpulan data publik yang diketahui yang dapat digunakan alat ini untuk mengoptimalkan kinerja evaluasi.

Inferensi Setan: Sebuah metode untuk menilai model Instruktur Phi-3 secara bermusuhan dengan mengamati distribusi perhatian di seluruh kepalanya ketika dihadapkan pada masukan tertentu. Pendekatan ini mendorong model untuk mengadopsi 'pola pikir setan', sehingga memungkinkan model tersebut menghasilkan keluaran yang bersifat kekerasan.

? Tautan yang berguna?

- Serangan Kotak Hitam Praktis terhadap Pembelajaran Mesin

- Keterbatasan Pembelajaran Mendalam dalam Situasi Adversarial

- Menuju Mengevaluasi Kekokohan Jaringan Syaraf Tiruan

- Distilasi sebagai Pertahanan terhadap Gangguan Permusuhan Terhadap Jaringan Syaraf Dalam

- Contoh permusuhan di dunia fisik

- Pelatihan Adversarial Ensemble: Serangan dan Pertahanan

- Menuju Model Pembelajaran Mendalam yang Tahan terhadap Serangan Adversarial

- Sifat menarik dari jaringan saraf

- Menjelaskan dan Memanfaatkan Contoh Permusuhan

- Menggali Contoh Permusuhan yang Dapat Dipindahtangankan dan Serangan Kotak Hitam

- Pembelajaran mesin permusuhan dalam skala besar

- Serangan Adversarial Kotak Hitam dengan Pertanyaan dan Informasi Terbatas

- Pemerasan Fitur: Mendeteksi Contoh Permusuhan di Jaringan Syaraf Dalam

- Serangan Adversarial Berbasis Keputusan: Serangan yang Andal Terhadap Model Pembelajaran Mesin Black-Box

- Meningkatkan Serangan Adversarial dengan Momentum

- Ruang Contoh Permusuhan yang Dapat Dipindahtangankan

- Melawan Gambar Adversarial menggunakan Transformasi Input

- Defense-GAN: Melindungi Pengklasifikasi Terhadap Serangan Adversarial Menggunakan Model Generatif

- Mensintesis Contoh Permusuhan yang Kuat

- Mengurangi efek permusuhan melalui pengacakan

- Tentang Mendeteksi Gangguan Permusuhan

- Patch Permusuhan

- PixelDefend: Memanfaatkan Model Generatif untuk Memahami dan Mempertahankan Contoh Permusuhan

- Serangan Satu Piksel untuk Membodohi Jaringan Syaraf Dalam

- Pertahanan Efisien Terhadap Serangan Musuh

- Serangan Dunia Fisik yang Kuat pada Klasifikasi Visual Pembelajaran Mendalam

- Gangguan Permusuhan Terhadap Jaringan Neural Dalam untuk Klasifikasi Malware

- Serangan Musuh 3D Melampaui Point Cloud

- Detektor Deepfake yang Menipu Gangguan Permusuhan

- Adversarial Deepfakes: Mengevaluasi Kerentanan Detektor Deepfake terhadap Contoh Adversarial

- Gambaran Umum Kerentanan Sistem Kontrol Suara

- FastWordBug: Metode Cepat Untuk Menghasilkan Teks Adversarial Terhadap Aplikasi NLP

- Phantom of the ADAS: Mengamankan Sistem Bantuan Pengemudi Tingkat Lanjut dari Serangan Phantom Sepersekian Detik

- serangan-llm: Serangan Universal dan Dapat Dipindahtangankan pada Model Bahasa yang Selaras.

- Serangan terhadap Model AI: Injeksi Cepat vs keracunan rantai pasokan

- Serangan Injeksi Cepat terhadap Aplikasi yang terintegrasi LLM

- garak: pemindai kerentanan LLM.

- Transformasi Adversarial Sederhana di PyTorch

- Plugin ChatGPT: Eksfiltrasi Data melalui Gambar & Pemalsuan Permintaan Lintas Plugin

- Pembajakan Gambar: Gambar Adversarial dapat Mengontrol Model Generatif saat Runtime

- Multi-serangan: Banyak gambar + serangan musuh yang sama → banyak label target

- AKTIF: Menuju Kamuflase Fisik 3D yang Sangat Dapat Dipindahtangankan untuk Penghindaran Kendaraan yang Universal dan Kuat

- LLM Red Teaming GPTS: Kebocoran Cepat, Kebocoran API, Kebocoran Dokumen

- Contoh Permusuhan yang Diproduksi Manusia

- Tantangan Jailbreak Multibahasa dalam Model Bahasa Besar

- Penyalahgunaan Alat dalam Model Bahasa Besar Dengan Contoh Visual Adversarial

- AutoDAN: Serangan Adversarial Berbasis Gradien yang Dapat Ditafsirkan pada Model Bahasa Besar

- Injeksi Multimodal: (Ab) menggunakan Gambar dan Suara untuk Injeksi Instruksi Tidak Langsung di LLM Multi-Modal.

- JailbreakingLLMs: Jailbreaking Model Bahasa Besar Kotak Hitam dalam Dua Puluh Kueri.

- Pohon Serangan: Melakukan Jailbreak LLM Kotak Hitam Secara Otomatis

- GPT: Petunjuk GPT yang bocor.

- Eksploitasi AI: Kumpulan eksploitasi AI/ML dunia nyata untuk mengungkapkan kerentanan secara bertanggung jawab.

- Agen LLM dapat Meretas Situs Web Secara Mandiri

- Cloudflare mengumumkan Firewall untuk AI

- PromptInject: Kerangka kerja yang menyusun perintah secara modular untuk memberikan analisis kuantitatif tentang ketahanan LLM terhadap serangan cepat yang merugikan.

- Tim Merah LLM: Pendekatan Adversarial, Pemrograman, dan Linguistik VS ChatGPT, Claude, Mistral, Grok, LLAMA, dan Gemini

- Hirarki Instruksi: Pelatihan LLM untuk Memprioritaskan Instruksi Istimewa

- Injeksi Segera / Pembobolan Jail Agen LLM Perbankan (GPT-4, Langchain)

- Obrolan Kopilot GitHub: Dari Injeksi Cepat hingga Eksfiltrasi Data

- Contoh Permusuhan Tidak Sejajar dalam Manifold Model Difusi

- Jailbreak Logika Gambar-ke-Teks: Imajinasi Anda Dapat Membantu Anda Melakukan Apa Pun

- Mitigating Skeleton Key, teknik jailbreak AI generatif jenis baru

- Tolok Ukur Kebingungan Gambar: Repositori ini berisi kode untuk mengevaluasi model pada tolok ukur kebingungan gambar, yang pertama kali disajikan dalam Ketahanan Tolok Ukur terhadap Kebingungan Gambar yang Memusuhi.

- Melakukan jailbreak pada Model Bahasa Besar dengan Matematika Simbolik

Peralatan

| Nama | Jenis | Algoritma yang didukung | Jenis serangan yang didukung | Serangan/Pertahanan | Kerangka kerja yang didukung | Kepopuleran |

|---|

| orang pintar | Gambar | Pembelajaran Mendalam | Penghindaran | Menyerang | Tensorflow, Keras, JAX | |

| kotak bodoh | Gambar | Pembelajaran Mendalam | Penghindaran | Menyerang | Tensorflow, PyTorch, JAX | |

| SENI | Jenis apa pun (gambar, data tabular, audio,...) | Pembelajaran Mendalam, SVM, LR, dll. | Apa saja (ekstraksi, inferensi, peracunan, penghindaran) | Keduanya | Tensorflow, Keras, Pytorch, Scikit Belajar | |

| Serangan Teks | Teks | Pembelajaran Mendalam | Penghindaran | Menyerang | Keras, Memeluk Wajah | |

| obor iklan | Gambar | Pembelajaran Mendalam | Penghindaran | Keduanya | --- | |

| Kotak Adv | Gambar | Pembelajaran Mendalam | Penghindaran | Keduanya | PyTorch, Tensorflow, MxNet | |

| Sangat Kuat | Gambar, grafik | Pembelajaran Mendalam | Penghindaran | Keduanya | PyTorch | |

| Kontras | Setiap | Setiap | Penghindaran | Menyerang | --- | |

| Contoh Audio Permusuhan | Audio | Pidato Dalam | Penghindaran | Menyerang | --- | |

SENI

Adversarial Robustness Toolbox, disingkat ART, adalah pustaka Adversarial Machine Learning bersumber terbuka untuk menguji ketahanan model pembelajaran mesin.

Ini dikembangkan dengan Python dan mengimplementasikan serangan dan pertahanan ekstraksi, inversi, peracunan dan penghindaran.

ART mendukung kerangka kerja paling populer: Tensorflow, Keras, PyTorch, MxNet, dan ScikitLearn, dan banyak lainnya.

Tidak terbatas pada penggunaan model yang menggunakan gambar sebagai masukan tetapi juga mendukung jenis data lain, seperti audio, video, data tabular, dll.

Workshop mempelajari Adversarial Machine Learning dengan ART ??

orang pintar

Cleverhans adalah perpustakaan untuk melakukan serangan penghindaran dan menguji ketahanan model pembelajaran mendalam pada model gambar.

Ini dikembangkan dengan Python dan terintegrasi dengan kerangka kerja Tensorflow, Torch, dan JAX.

Ini mengimplementasikan berbagai serangan seperti L-BFGS, FGSM, JSMA, C&W, dan lain-lain.

? Menggunakan ?

AI digunakan untuk menyelesaikan tugas berbahaya dan meningkatkan serangan klasik.

♂️ Pentesting ♂️

- GyoiThon: Alat uji penetrasi generasi berikutnya, alat pengumpulan intelijen untuk server web.

- Eksploitasi Mendalam: Alat uji penetrasi yang sepenuhnya otomatis menggunakan Deep Reinforcement Learning.

- AutoPentest-DRL: Pengujian penetrasi otomatis menggunakan pembelajaran penguatan mendalam.

- DeepGenerator: Menghasilkan kode injeksi secara otomatis untuk penilaian aplikasi web menggunakan Algoritma Genetika dan Jaringan Adversarial Generatif.

- Eyeballer: Eyeballer dimaksudkan untuk pengujian penetrasi jaringan berskala besar di mana Anda perlu menemukan target "menarik" dari sejumlah besar host berbasis web.

- Nebula: Asisten Peretasan Etis yang Didukung AI.

- Tim Agen LLM dapat Memanfaatkan Kerentanan Zero-Day

- Wawasan dan Kesenjangan Saat Ini dalam Pemindai Kerentanan LLM Sumber Terbuka: Analisis Komparatif

? perangkat lunak perusak?

- DeepLocker: Menyembunyikan serangan yang ditargetkan dengan tukang kunci AI, oleh IBM Labs di BH.

- Ikhtisar Kecerdasan Buatan yang Digunakan dalam Malware: Daftar sumber daya AI Malware yang dikurasi.

- DeepObfusCode: Kebingungan kode sumber melalui jaringan urutan-ke-urutan.

- AutoCAT: Pembelajaran penguatan untuk eksplorasi otomatis serangan pengaturan waktu cache.

- BOTNET BERBASIS AI: Pendekatan teori permainan untuk pertahanan serangan botnet berbasis AI.

- SECML_Malware: Pustaka Python untuk membuat serangan permusuhan terhadap pendeteksi Malware Windows.

- Rilis transenden: Menggunakan evaluasi konformal untuk mendeteksi penyimpangan konsep yang memengaruhi deteksi malware.

?️ OSINT ?️

- SNAP_R: Menghasilkan postingan spear-phishing secara otomatis di media sosial.

- SpyScrap: SpyScrap menggabungkan metode pengenalan wajah untuk memfilter hasil dan menggunakan pemrosesan bahasa alami untuk mendapatkan entitas penting dari situs web tempat pengguna muncul.

? Phishing?

- DeepDGA: Implementasi DeepDGA: Pembuatan dan Deteksi Domain yang Disetel Secara Musuh.

? Intelijen Ancaman?

- Dari Pasir ke Rumah Mewah: Mengaktifkan Konstruksi Serangan Siber Siklus Hidup Penuh Otomatis dengan LLM

? Saluran samping?

- SCAAML: Serangan Saluran Samping Dibantu dengan Pembelajaran Mesin.

?? AI generatif ??

? audio?

Peralatan

- konversi suara dalam: Jaringan saraf dalam untuk konversi suara (transfer gaya suara) di Tensorflow.

- tacotron: Implementasi TensorFlow dari sintesis ucapan Tacotron Google dengan model terlatih (tidak resmi).

- Kloning Suara Waktu Nyata: Mengkloning suara dalam 5 detik untuk menghasilkan ucapan sewenang-wenang secara real-time.

- mimik2: Mesin Text to Speech berdasarkan arsitektur Tacotron, pertama kali diterapkan oleh Keith Ito.

- Kloning Suara Neural-dengan-Beberapa Sampel: Implementasi Kloning Suara Neural dengan Beberapa Sampel Makalah Penelitian oleh Baidu.

- Vall-E: Implementasi PyTorch tidak resmi dari audio LM VALL-E.

- pengubah suara: Pengubah Suara Waktu Nyata.

- WebUI-Konversi-Suara Berbasis Pengambilan: Kerangka kerja Konversi Suara yang mudah digunakan berdasarkan VITS.

- Audiocraft: Audiocraft adalah perpustakaan untuk pemrosesan dan pembuatan audio dengan pembelajaran mendalam. Ini dilengkapi kompresor/tokenizer audio EnCodec yang canggih, bersama dengan MusicGen, LM generasi musik yang sederhana dan dapat dikontrol dengan pengondisian tekstual dan melodi.

- VALL-EX: Implementasi sumber terbuka dari model TTS zero-shot Microsoft VALL-E X.

- OpenVoice: Kloning suara instan oleh MyShell.

- MeloTTS: Pustaka text-to-speech multibahasa berkualitas tinggi dari MyShell.ai. Mendukung bahasa Inggris, Spanyol, Prancis, Cina, Jepang, dan Korea.

- VoiceCraft: Pengeditan Ucapan Zero-Shot dan Text-to-Speech di Alam Liar.

- Parler-TTS: Perpustakaan inferensi dan pelatihan untuk model TTS berkualitas tinggi.

- ChatTTS: Model pidato generatif untuk dialog sehari-hari.

Aplikasi

- Lip2Wav: Menghasilkan ucapan berkualitas tinggi hanya dari gerakan bibir.

- AudioLDM: Pembuatan Teks-ke-Audio dengan Model Difusi Laten

- deepvoice3_pytorch: Implementasi PyTorch pada model sintesis text-to-speech berbasis jaringan saraf konvolusional.

- ? Riffusion: Difusi stabil untuk pembuatan musik real-time.

- berbisik.cpp: Port model Whisper OpenAI di C/C++.

- TTS : ? - perangkat pembelajaran mendalam untuk Text-to-Speech, yang telah teruji dalam penelitian dan produksi.

- YourTTS: Menuju TTS Multi-Speaker Zero-Shot dan Konversi Suara Zero-Shot untuk semua orang.

- TorToiSe: Sistem TTS multi-suara yang dilatih dengan penekanan pada kualitas.

- DiffSinger: Menyanyikan Sintesis Suara melalui Mekanisme Difusi Dangkal (SVS & TTS).

- Vocoder WaveNet: Implementasi vocoder WaveNet, yang dapat menghasilkan sampel ucapan mentah berkualitas tinggi yang dikondisikan pada fitur linguistik atau akustik.

- Deepvoice3_pytorch: Implementasi PyTorch pada model sintesis text-to-speech berbasis jaringan saraf konvolusional.

- eSpeak NG Text-to-Speech: eSpeak NG adalah penyintesis ucapan sumber terbuka yang mendukung lebih dari seratus bahasa dan aksen.

- RealChar: Buat, Sesuaikan, dan Bicaralah dengan Karakter/Pendamping AI Anda secara Realtime (Semua dalam Satu Basis Kode!). Lakukan percakapan alami dan lancar dengan AI di mana pun (seluler, web, dan terminal) menggunakan LLM OpenAI GPT3.5/4, Anthropic Claude2, Chroma Vector DB, Whisper Speech2Text, ElevenLabs Text2Speech.

- Kloning Suara Neural dengan Beberapa Sampel

- NAUTILUS: Sistem Kloning Suara Serbaguna

- Belajar Berbicara Lancar dalam Bahasa Asing: Sintesis Ucapan Multibahasa dan Kloning Suara Lintas Bahasa

- Ketika Kebaikan Menjadi Jahat: Inferensi Keystroke dengan Smartwatch

- KeyListener: Menyimpulkan Penekanan Tombol pada Keyboard QWERTY Layar Sentuh melalui Sinyal Akustik

- Suara Ini Tidak Ada: Tentang Sintesis Suara, Audio Deepfake, dan Deteksinya

- AudioSep: Pisahkan Apa Pun yang Anda Gambarkan.

- stable-audio-tools : Model generatif untuk pembuatan audio bersyarat.

- GPT-SoVITS-WebUI: Data suara 1 menit juga dapat digunakan untuk melatih model TTS yang bagus! (beberapa tembakan kloning suara).

- Hybrid-Net: Pemisahan sumber audio secara real-time, menghasilkan lirik, akord, irama.

- CosyVoice: Model pembangkitan suara besar multi-bahasa, menyediakan inferensi, pelatihan, dan penerapan kemampuan full-stack.

- EasyVolcap: Mempercepat Riset Video Volumetrik Neural.

? Deteksi?

- deteksi suara palsu: Menggunakan konvolusi temporal untuk mendeteksi Audio Deepfakes.

- Sistem deteksi spoofing suara yang tangguh menggunakan fitur baru CLS-LBP dan LSTM

- Detektor spoofing suara: Kerangka kerja anti-spoofing terpadu

- Mengamankan Antarmuka Berbasis Suara dari Serangan Audio Palsu (Kloning).

- DeepSonar: Menuju Deteksi Suara Palsu Sintesis AI yang Efektif dan Kuat

- Melawan AI dengan AI: Deteksi Ucapan Palsu Menggunakan Pembelajaran Mendalam

- Tinjauan Metode Deteksi Audio Deepfake Modern: Tantangan dan Arah Masa Depan

? Gambar ?

Peralatan

- StyleGAN: StyleGAN - Implementasi TensorFlow Resmi.

- StyleGAN2: StyleGAN2 - Implementasi TensorFlow Resmi.

- stylegan2-ada-pytorch: StyleGAN2-ADA - Implementasi resmi PyTorch.

- StyleGAN-nada: Adaptasi Domain yang Dipandu CLIP dari Generator Gambar.

- StyleGAN3: Implementasi PyTorch resmi dari StyleGAN3.

- Imaginaire: Imaginaire adalah perpustakaan pytorch yang berisi implementasi optimal dari beberapa metode sintesis gambar dan video yang dikembangkan di NVIDIA.

- kumpulan data ffhq: Kumpulan Data Flickr-Faces-HQ (FFHQ).

- DALLE2-pytorch: Implementasi DALL-E 2, jaringan saraf sintesis teks-ke-gambar OpenAI yang diperbarui, di Pytorch.

- ImaginAIry: AI membayangkan gambar. Generasi Pythonic dari gambar difusi stabil.

- Lama Cleaner: Alat pengecatan gambar yang didukung oleh SOTA AI Model. Hapus objek, cacat, atau orang yang tidak diinginkan dari gambar Anda atau hapus dan ganti (didukung oleh difusi stabil) apa pun pada gambar Anda.

- Penskalaan Gambar yang Dapat Dibalik: Ini adalah implementasi makalah PyTorch: Penskalaan Gambar yang Dapat Dibalik.

- DifFace: Pemulihan Wajah Buta dengan Kontraksi Kesalahan Tersebar (PyTorch).

- CodeFormer: Menuju Restorasi Wajah Buta yang Kuat dengan Codebook Lookup Transformer.

- Difusi Kustom: Kustomisasi Multi-Konsep Difusi Teks-ke-Gambar.

- Diffuser: ? Diffusers: Model difusi canggih untuk pembuatan gambar dan audio di PyTorch.

- Difusi Stabil: Sintesis Gambar Resolusi Tinggi dengan Model Difusi Laten.

- InvokeAI: InvokeAI adalah mesin kreatif terkemuka untuk model Difusi Stabil, memberdayakan para profesional, seniman, dan penggemar untuk menghasilkan dan membuat media visual menggunakan teknologi terbaru yang digerakkan oleh AI. Solusi ini menawarkan WebUI terdepan di industri, mendukung penggunaan terminal melalui CLI, dan berfungsi sebagai landasan untuk berbagai produk komersial.

- UI web Difusi Stabil: UI web Difusi Stabil.

- Stable Diffusion Infinity: Lukisan dengan Difusi Stabil pada kanvas tanpa batas.

- Difusi Stabil Cepat: difusi cepat-stabil + DreamBooth.

- GET3D: Model Generatif Bentuk Bertekstur 3D Berkualitas Tinggi yang Dipelajari dari Gambar.

- Sintesis Gambar Seni AI yang Luar Biasa: Daftar alat, ide, alat teknik cepat, kolaborasi, model, dan bantuan luar biasa untuk desainer cepat yang bermain dengan aiArt dan sintesis gambar. Meliputi Dalle2, MidJourney, StableDiffusion, dan alat sumber terbuka.

- Difusi Stabil: Model difusi teks-ke-gambar yang laten.

- Difusi Cuaca: Kode untuk "Memulihkan Penglihatan dalam Kondisi Cuaca Buruk dengan Model Difusi Denoising Berbasis Patch".

- DF-GAN: Dasar Sederhana dan Efektif untuk Sintesis Teks-ke-Gambar.

- Dall-E Playground: Taman bermain untuk menghasilkan gambar dari prompt teks apa pun menggunakan Difusi Stabil (sebelumnya: menggunakan DALL-E Mini).

- MM-CelebA-HQ-Dataset: Kumpulan data gambar wajah berskala besar yang memungkinkan pembuatan teks-ke-gambar, manipulasi gambar dengan panduan teks, pembuatan sketsa-ke-gambar, GAN untuk pembuatan dan pengeditan wajah, keterangan gambar, dan VQA.

- Deep Daze: Alat baris perintah sederhana untuk pembuatan teks-ke-gambar menggunakan CLIP dan Siren OpenAI (jaringan representasi saraf implisit).

- StyleMapGAN: Memanfaatkan Dimensi Spasial Laten di GAN untuk Pengeditan Gambar Real-time.

- Kandinsky-2: Model difusi laten teks2gambar multibahasa.

- DragGAN: Manipulasi Berbasis Titik Interaktif pada Manifold Gambar Generatif.

- Segment Anything: Repositori menyediakan kode untuk menjalankan inferensi dengan SegmentAnything Model (SAM), tautan untuk mengunduh titik pemeriksaan model yang dilatih, dan contoh buku catatan yang memperlihatkan cara menggunakan model tersebut.

- Segment Anything 2: Repositori menyediakan kode untuk menjalankan inferensi dengan Meta Segment Anything Model 2 (SAM 2), tautan untuk mengunduh pos pemeriksaan model yang dilatih, dan contoh buku catatan yang memperlihatkan cara menggunakan model tersebut.

- MobileSAM: Ini adalah kode resmi untuk proyek MobileSAM yang menjadikan SAM ringan untuk aplikasi seluler dan seterusnya!

- FastSAM: Segmen Cepat Apa Pun

- Infinigen: Dunia Fotorealistik Tanpa Batas menggunakan Generasi Prosedural.

- DALL·E 3

- StreamDiffusion: Solusi Tingkat Saluran untuk Pembuatan Interaktif Waktu Nyata.

- AnyDoor: Kustomisasi Gambar Tingkat Objek Zero-shot.

- DiT: Model Difusi yang Dapat Diskalakan dengan Transformer.

- BrushNet: Model Pengecatan Gambar Plug-and-Play dengan Difusi Cabang Ganda yang Terurai.

- OOTDiffusion: Difusi Laten berbasis Perlengkapan untuk Uji Coba Virtual Terkendali.

- VAR: Implan resmi. dari "Pemodelan Autoregresif Visual: Pembuatan Gambar yang Dapat Diskalakan melalui Prediksi Skala Berikutnya".

- Bayangkan Flash: Mempercepat Model Difusi Emu dengan Distilasi Mundur

Aplikasi

- ArtLine: Proyek berbasis Pembelajaran Mendalam untuk membuat potret seni garis.

- Depix: Memulihkan kata sandi dari tangkapan layar berpiksel.

- Menghidupkan Kembali Foto Lama: Restorasi Foto Lama (Implementasi Resmi PyTorch).

- Penulisan Ulang: Alat interaktif untuk mengedit langsung aturan GAN untuk mensintesis adegan dengan objek yang ditambahkan, dihapus, atau diubah. Ubah StyleGANv2 untuk membuat alis yang mewah, atau kuda yang memakai topi.

- Fawkes: Alat menjaga privasi terhadap sistem pengenalan wajah.

- Pulse: Pengambilan Sampel Foto yang Diawasi Sendiri melalui Eksplorasi Ruang Laten Model Generatif.

- HiDT: Gudang resmi untuk makalah "Terjemahan Siang Hari Resolusi Tinggi Tanpa Label Domain".

- Inpainting Foto 3D: Fotografi 3D menggunakan Inpainting Kedalaman Berlapis yang Sadar Konteks.

- SteganoGAN: SteganoGAN adalah alat untuk membuat gambar steganografi menggunakan pelatihan adversarial.

- Stylegan-T: Membuka Kekuatan GAN untuk Sintesis Teks-ke-Gambar Berskala Besar yang Cepat.

- MegaPortraits: Avatar Kepala Neural Megapiksel Sekali Jepret.

- eg3d: Jaringan Adversarial Generatif 3D yang Sadar Geometri dan Efisien.

- TediGAN: Implementasi Pytorch untuk TediGAN: Pembuatan dan Manipulasi Gambar Wajah Beragam yang Dipandu Teks.

- DALLE-pytorch: Implementasi / replikasi DALL-E, Text to Image Transformer OpenAI, di Pytorch.

- StyleNeRF: Ini adalah implementasi sumber terbuka dari makalah ICLR2022 "StyleNeRF: Generator Sadar 3D Berbasis Gaya untuk Sintesis Gambar Resolusi Tinggi".

- DeepSVG: Kode resmi untuk makalah "DeepSVG: Jaringan Generatif Hierarki untuk Animasi Grafik Vektor". Termasuk perpustakaan PyTorch untuk pembelajaran mendalam dengan data SVG.

- NUWA: Pipa Transformator 3D terpadu untuk sintesis visual.

- Image-Super-Resolution-via-Iterative-Refinement: Implementasi tidak resmi dari Image Super-Resolution melalui Iterative Refinement oleh Pytorch.

- Lama: ? Inpainting Gambar LaMa, Inpainting Topeng Besar beresolusi tinggi dengan Konvolusi Fourier.

- Person_reID_baseline_pytorch: Pytorch ReID: Implementasi pytorch yang kecil, ramah, dan kuat untuk garis dasar identifikasi ulang objek.

- instruct-pix2pix: Implementasi PyTorch dari InstructPix2Pix, model pengeditan gambar berbasis instruksi.

- GFPGAN: GFPGAN bertujuan mengembangkan Algoritma Praktis untuk Restorasi Wajah di Dunia Nyata.

- DeepVecFont: Mensintesis Font Vektor Berkualitas Tinggi melalui Pembelajaran Modalitas Ganda.

- Stargan v2 Tensorflow: Implementasi Tensorflow Resmi.

- Distilasi StyleGAN2: Terjemahan gambar-ke-gambar berpasangan, dilatih pada data sintetis yang dihasilkan oleh StyleGAN2 mengungguli pendekatan yang ada dalam manipulasi gambar.

- Mengekstraksi Data Pelatihan dari Model Difusi

- Mann-E - Mann-E (Persia: مانی) adalah model generator seni berdasarkan bobot Difusi Stabil 1.5 dan data yang dikumpulkan dari materi artistik yang tersedia di Pinterest

- Jaringan Encode-Decoder CNN Terlatih ujung ke ujung untuk Steganografi Gambar

- Grounded-Segment-Anything: Mengawinkan DINO Grounding dengan Segmen Anything & Difusi Stabil & Tag2Teks & BLIP & Whisper & ChatBot - Secara Otomatis Mendeteksi, Menyegmentasikan, dan Menghasilkan Apa Pun dengan Input Gambar, Teks, dan Audio.

- AnimateDiff: Menganimasikan Model Difusi Teks-ke-Gambar Personalisasi Anda tanpa Penyetelan Khusus.

- BasicSR: Kotak Alat Pemulihan Gambar dan Video Sumber Terbuka untuk Resolusi Super, Denoise, Deblurring, dll. Saat ini, ini mencakup EDSR, RCAN, SRResNet, SRGAN, ESRGAN, EDVR, BasicVSR, SwinIR, ECBSR, dll. Juga mendukung StyleGAN2 dan DFDNet. [](https://github.com/XPixelGroup/ BasicSR)

- Real-ESRGAN: Real-ESRGAN bertujuan mengembangkan Algoritma Praktis untuk Restorasi Gambar/Video Umum.

- ESRGAN: SRGAN yang Ditingkatkan. Juara Tantangan PIRM dalam Resolusi Super Perseptual.

- MIXNMATCH: Disentanglement dan pengkodean multifaktor untuk pembuatan gambar bersyarat.

- Clarity-upscaler: Peningkatan gambar yang ditata ulang untuk semua orang.

- Difusi satu langkah dengan distilasi pencocokan distribusi

- Jahitan Invisible: Menghasilkan adegan 3D halus dengan inpaining kedalaman.

- SSR: Rekonstruksi adegan 3D single-view dengan bentuk dan tekstur kesetiaan tinggi.

- INVSR: Gambar-langkah-resolusi super-resolusi melalui inversi difusi.

? Deteksi?

- StyleGan3-Detektor: Deteksi gambar sintetis StyleGan3.

- StyleGan2-Project-Images: memproyeksikan gambar ke ruang laten dengan styleGan2.

- Faldetector: Mendeteksi wajah photoshopped dengan skrip Photoshop.

? Video?

Peralatan

- DeepFacelab: DeepFacelab adalah perangkat lunak terkemuka untuk menciptakan DeepFake.

- FacesWap: Perangkat lunak Deepfakes untuk semua.

- DOT: Toolkit ofensif Deepfake.

- SimSwap: Kerangka kerja yang bertukar wajah sewenang-wenang pada gambar dan video dengan satu model terlatih!

- Faceswap-Gan: A Denoising Autoencoder + Kehilangan Perselisihan dan Mekanisme Perhatian untuk Pertukaran Wajah.

- Celeb DeepFakeForensics: Dataset menantang skala besar untuk forensik Deepfake.

- VGEN: Ekosistem pembuatan video holistik untuk pembuatan video yang dibangun pada model difusi.

- Musev: Generasi video manusia virtual yang sangat panjang dan tinggi dengan denoising paralel yang dikondisikan secara visual.

- Glee: Model Yayasan Objek Umum untuk gambar dan video pada skala.

- T-Rex: Menuju Deteksi Objek Generik melalui Sinergi Prompt Teks-Visual.

- DynamicRafter: Menganalisis gambar domain terbuka dengan prior difusi video.

- Mora: Lebih seperti Sora untuk generasi video generalis.

Aplikasi

- Face2face-Demo: Demo Pix2pix yang belajar dari landmark wajah dan menerjemahkan ini menjadi wajah.

- Faceswap-Deepfake-Pytorch: Faceswap dengan Pytorch atau Deepfake dengan Pytorch.

- Point-E: Difusi awan titik untuk sintesis model 3D.

- EGVSR: Resolusi Super Video Efisien & Generik.

- STIT: Jahitan dalam waktu: Pengeditan wajah nyata berbasis GAN.

- BackgroundMattingv2: Matting latar belakang resolusi tinggi waktu-nyata.

- MODNET: Solusi anyaman potret bebas trimap secara real time.

- Latar Belakang-Matting: Latar Belakang Anyaman: Dunia adalah layar hijau Anda.

- Model Pesanan Pertama: Repositori ini berisi kode sumber untuk Maper First Order Motion Model untuk Animasi Gambar.

- Animasi Artikulasi: Repositori ini berisi kode sumber untuk representasi gerak kertas CVPR'2021 untuk animasi yang diartikulasikan.

- Penghapusan orang waktu nyata: Menghapus orang dari latar belakang yang kompleks secara real time menggunakan TensorFlow.js di browser web.

- Adain-style: Transfer gaya sewenang-wenang secara real-time dengan normalisasi instance adaptif.

- Interpolasi bingkai: interpolasi bingkai untuk gerakan besar.

- Awesome-Image-Colorisasi: Koleksi pewarnaan gambar berbasis pembelajaran mendalam dan makalah pewarnaan video.

- Sadtalker: Belajar koefisien gerak 3D realistis untuk animasi wajah tunggal yang digerakkan oleh audio-driven.

- Roop: Deepfake satu klik (swap wajah).

- Stablevideo: Pengeditan video difusi konsistensi yang digerakkan oleh teks.

- MAGICEDIT: Pengeditan video yang sangat koheren sementara.

- Rerender_a_video: terjemahan video-ke-video yang dipandu teks.

- Dreameditor: Pengeditan adegan 3D yang digerakkan oleh teks dengan bidang saraf.

- Dreameditor: Sintesis tampilan 4D real-time pada resolusi 4K.

- Animate tersebut: Sintesis gambar-ke-video yang konsisten dan dapat dikendalikan untuk animasi karakter.

- Moore-animateanyone: Repositori ini mereproduksi animateanyone.

- Audio2Photoreal: Dari audio ke perwujudan fotoreal: mensintesis manusia dalam percakapan.

- MagicVideo-V2: Generasi video multi-tahap tinggi

- LWM: Model autoregresif multimodal konteks-umum besar. Ini dilatih pada dataset besar video dan buku panjang yang beragam menggunakan Ringattention dan dapat melakukan bahasa, gambar, dan pemahaman dan generasi video.

- Aniportrait: Sintesis yang digerakkan oleh audio dari animasi potret fotorealistik.

- Champ: Animasi gambar manusia yang dapat dikendalikan dan konsisten dengan panduan parametrik 3D.

- Streamv2V: Streaming terjemahan video-ke-video dengan bank fitur.

- Deep-live-Cam: Pertukaran wajah waktu nyata dan video satu klik Deepfake dengan hanya satu gambar.

- Sapiens: Foundation for Human Vision Models.

? Deteksi?

- Faceforensics ++: Dataset Faceforensics.

- Deepfake-deteksi: Menuju deteksi Deepfake yang benar-benar berhasil.

- Fakevideoforensics: Mendeteksi video palsu.

- Deepfake-Detection: Implementasi Pytorch deteksi Deepfake berdasarkan Faceforensics ++.

- SEQDEEPFAKE: Kode Pytorch untuk SEQDEEPFAKE: Mendeteksi dan Memulihkan Manipulasi Deepfake Sequential.

- PCL-I2G: Implementasi Tidak Resmi: Belajar Konsistensi Diri untuk Deteksi Deepfake.

- DFDC Deepfake Challenge: Solusi pemenang hadiah untuk DFDC Challenge.

- POI-Forensics: Deteksi deepfake personel audio-visual.

- Standardisasi Deteksi Deepfake: Mengapa para ahli mengatakan itu penting

- Ingin melihat Deepfake? Cari bintang -bintang di mata mereka

? SMS?

Peralatan

- GLM-130B: Model pra-terlatih bilingual terbuka.

- Sumber LongtermCatexternals: GPT-3 Chatbot dengan memori jangka panjang dan sumber eksternal.

- Sketsa: Asisten penulisan kode AI yang memahami konten data.

- Langchain: ⚡ Membangun aplikasi dengan LLM melalui komposabilitas ⚡.

- CHATGPT Wrapper: API untuk berinteraksi dengan chatgpt menggunakan python dan dari shell.

- Openai-Python: Perpustakaan Openai Python menyediakan akses yang nyaman ke API OpenAI dari aplikasi yang ditulis dalam bahasa Python.

- Beto: Versi Spanyol dari Model Bert.

- GPT-Code-Clippy: GPT-Code-Clippy (GPT-CC) adalah versi open source dari GitHub Copilot, model bahasa-berdasarkan GPT-3, yang disebut GPT-Codex.

- GPT NEO: Implementasi model paralel GPT-2 dan GPT-3-gaya menggunakan pustaka mesh-tensorflow.

- CTRL: Model bahasa transformator bersyarat untuk generasi yang dapat dikendalikan.

- Llama: Kode Inferensi untuk Model Llama.

- Llama2

- Llama Guard 3

- UL2 20B: Pembelajar Bahasa Terpadu Sumber Terbuka

- Burgpt: Perpanjangan Burp Suite yang mengintegrasikan GPT Openai untuk melakukan pemindaian pasif tambahan untuk menemukan kerentanan yang sangat dipesan lebih dahulu, dan memungkinkan menjalankan analisis berbasis lalu lintas jenis apa pun.

- Ollama: Bangun dan jalankan dengan Llama 2 dan model bahasa besar lainnya secara lokal.

- SneakyPrompt: Model generatif teks-ke-gambar jailbreaking.

- Copilot-for-Security: Solusi keamanan bertenaga AI generatif yang membantu meningkatkan efisiensi dan kemampuan para pembela untuk meningkatkan hasil keamanan pada kecepatan dan skala mesin, sambil tetap patuh dengan prinsip-prinsip AI yang bertanggung jawab.

- LM Studio: Temukan, Unduh, dan Jalankan LLM Lokal

- Bypass GPT: Konversi teks AI menjadi konten seperti manusia

- MGM: Kerangka kerja mendukung serangkaian model bahasa besar dan moe (LLM) dari 2B hingga 34B dengan pemahaman gambar, penalaran, dan generasi secara bersamaan.

- Secret Llama: LLM Chatbot yang sepenuhnya pribadi yang berjalan sepenuhnya dengan browser tanpa diperlukan server. Mendukung Mistral dan Llama 3.

- Llama3: Situs Meta Llama 3 GitHub resmi.

? Deteksi?

- Mendeteksi Teks Palsu: Ruang Uji Model Bahasa Raksasa.

- Grover: Kode untuk bertahan melawan berita palsu saraf.

- Penanggulangan.ai: Detektor injeksi cepat.

- Klasifikasi AI baru untuk menunjukkan teks yang ditulis AI

- Temukan 4 metode magis untuk mendeteksi teks yang dihasilkan AI (termasuk chatgpt)

- Gptzero

- Detektor Konten AI (beta)

- Tanda air untuk model bahasa besar

- Bisakah teks yang dihasilkan AI terdeteksi dengan andal?

- Detektor GPT bias terhadap penulis bahasa Inggris non-pribumi

- Untuk chatgpt, atau tidak ke chatgpt: itulah pertanyaannya!

- Bisakah ahli bahasa membedakan antara chatgpt/ai dan penulisan manusia?: Studi etika penelitian dan penerbitan akademik

- Chatgpt adalah omong kosong

Aplikasi

- Tulisan tangan: Tulisan tangan menghasilkan font khusus berdasarkan sampel tulisan tangan Anda.

- GPT Sandbox: Tujuan dari proyek ini adalah untuk memungkinkan pengguna untuk membuat demo web keren menggunakan API OpenAI GPT-3 yang baru dirilis dengan hanya beberapa baris Python.

- Passgan: Pendekatan pembelajaran yang mendalam untuk menebak kata sandi.

- Indeks GPT: Indeks GPT adalah proyek yang terdiri dari serangkaian struktur data yang dirancang untuk membuatnya lebih mudah menggunakan basis pengetahuan eksternal yang besar dengan LLM.

- Nanogpt: Repositori paling sederhana dan tercepat untuk pelatihan/finetuning GPT berukuran sedang.

- whatsapp-gpt

- Chatgpt Chrome Extension: Ekstensi Chrome Chatgpt. Mengintegrasikan chatgpt ke dalam setiap kotak teks di internet.

- UNILM: Pra-pelatihan swadaya skala besar di seluruh tugas, bahasa, dan modalitas.

- MingPT: Pelatihan ulang Pytorch minimal dari pelatihan OpenAI GPT (transformator pretrained generatif).

- Codegeex: Model pembuatan kode multibahasa terbuka.

- Openai Cookbook: Contoh dan panduan untuk menggunakan API OpenAI.

- ? CHATGPT yang luar biasa Prompts: Repo ini termasuk kurasi prompt chatgpt untuk menggunakan chatgpt lebih baik.

- Alice: Memberikan akses chatgpt ke terminal nyata.

- Ulasan kode keamanan dengan chatgpt

- Apakah pengguna menulis lebih banyak kode tidak aman dengan asisten AI?

- Melewati filter spam Gmail dengan chatgpt

- Cracker Kata Sandi Gans Berulang untuk Peningkatan Keamanan Kata Sandi IoT

- Pentestgpt: Alat Pengujian Penetrasi Bermerayakan GPT.

- Peneliti GPT: Agen otonom berbasis GPT yang melakukan penelitian komprehensif online tentang topik tertentu.

- GPT Engineer: Tentukan apa yang Anda inginkan untuk dibangun, AI meminta klarifikasi, dan kemudian membangunnya.

- LocalPilot: Gunakan GitHub Copilot secara lokal di MacBook Anda dengan satu klik!

- [Wormgpt]) (https://thehackernews.com/2023/07/wormgpt-new-ai-tool-allows.html): alat AI baru memungkinkan penjahat cyber untuk meluncurkan serangan cyber canggih

- Poisongpt: Bagaimana kami menyembunyikan llm lobotomisasi pada wajah memeluk untuk menyebarkan berita palsu

- PassGPT: Pemodelan Kata Sandi dan generasi (dipandu) dengan model bahasa besar

- Deeppass - Menemukan kata sandi dengan pembelajaran yang mendalam

- GPTFUZZ: Model Bahasa Besar Peaming Merah dengan petunjuk jailbreak yang dihasilkan secara otomatis.

- Open Interpreter: Interpreter Kode Openai di terminal Anda, berjalan secara lokal.

- Eureka: Desain hadiah tingkat manusia melalui pengkodean model bahasa besar.

- Metaclip: Demystifying Clip Data.

- LLM OSINT: Metode pembuktian konsep menggunakan LLM untuk mengumpulkan informasi dari Internet dan kemudian melakukan tugas dengan informasi ini.

- HackingBuddygpt: llms x pentesting.

- Chatgpt-Jailbreaks: Jailbreak resmi untuk chatgpt (GPT-3.5). Kirim pesan panjang di awal percakapan dengan ChatGPT untuk mendapatkan jawaban yang menyinggung, tidak etis, agresif, seperti manusia dalam bahasa Inggris dan Italia.

- Magika: Mendeteksi jenis konten file dengan pembelajaran mendalam.

- Jan: Alternatif open source untuk chatgpt yang berjalan 100% offline di komputer Anda.

- Librechat: Klon Chatgpt yang Ditingkatkan: Fitur OpenAi, Asisten API, Azure, Groq, GPT-4 Vision, Mistral, Bing, Anthropic, OpenRouter, Vertex AI, Gemini, Peralihan Model AI, Pencarian Pesan, Langchain, Dall-E-3, Chatgpt Plugin, fungsi OpenAI, sistem multi-pengguna yang aman, preset, sumber terbuka yang benar-benar terbuka untuk hosting sendiri.

- Lumina-T2X: Kerangka kerja terpadu untuk teks untuk setiap generasi modalitas.

Lain-lain

- Keamanan GPT + yang luar biasa: Daftar alat keamanan yang luar biasa, kasus eksperimental atau hal -hal menarik lainnya dengan LLM atau GPT.

- Pembelajaran Penguatan yang Luar Biasa untuk Keamanan Cyber: Daftar sumber daya yang dikuratori yang didedikasikan untuk pembelajaran penguatan yang diterapkan pada keamanan dunia maya.

- Pembelajaran Mesin Luar Biasa untuk Keamanan Cyber: Daftar alat dan sumber daya yang luar biasa luar biasa terkait dengan penggunaan pembelajaran mesin untuk keamanan cyber.

- Model Difusi Wajah Memeluk Kursus: Bahan untuk Kursus Model Difusi Wajah Memeluk.

- Awesome-ai-Security: Daftar sumber daya keamanan AI yang dikuratori.

- ML untuk peretas: Kode yang menyertai buku "Machine Learning for Hackers".

- AI AWFUL: AWFUL AI adalah daftar yang dikuratori untuk melacak penggunaan AI yang menakutkan saat ini - berharap dapat meningkatkan kesadaran.

- Playbook Kerangka Manajemen Risiko NIST AI

- Sok: Pembelajaran mesin yang dapat dijelaskan untuk aplikasi keamanan komputer

- Siapa yang mengevaluasi evaluator? Pada metrik otomatis untuk menilai generator kode ofensif berbasis AI

- Prioritas Kerentanan: Pendekatan Keamanan Ofensif

- MITER ATLAS ™ (lanskap ancaman permusuhan untuk sistem buatan-intelijen)

- Survei tentang Penguatan Keamanan Belajar dengan Aplikasi untuk Mengemudi Otonomi

- Cara menghindari jebakan pembelajaran mesin: panduan untuk peneliti akademik

- Daftar Acara Keamanan & Privasi AI yang dikuratori

- NIST AI 100-2 E2023: Pembelajaran Mesin Perselisihan. Taksonomi dan terminologi serangan dan mitigasi.

- ?? RootedCon 2023 - Inteligencia Ofensiva Buatan - ¿Cómo Podemos Estar Preparados?

- Keamanan AI -Systems: Fundamentals - Pembelajaran mendalam yang bermusuhan

- Beyond the Safeguards: Menjelajahi Risiko Keamanan Chatgpt

- Peta Permukaan Serangan AI v1.0

- Tentang keamanan yang mustahil dari model AI besar

- Peraturan AI Perbatasan: Mengelola risiko yang muncul untuk keselamatan publik

- Kerangka kerja multilayer untuk praktik keamanan siber yang baik untuk AI

- Memperkenalkan kerangka kerja AI yang aman Google

- Owasp Top 10 untuk LLM

- Keamanan LLM yang luar biasa: Kurasi alat, dokumen, dan proyek yang luar biasa tentang keamanan LLM.

- Kerangka kerja untuk menggunakan LLMS dengan aman di perusahaan. Bagian 1: Tinjauan Risiko. Bagian 2: Mengelola Risiko. Bagian 3: Mengamankan chatgpt dan github copilot.

- Sebuah studi tentang ketahanan dan keandalan pembuatan kode model bahasa besar

- Mengidentifikasi gambar yang dihasilkan AI dengan synthid

- Mengaudit model bahasa besar: pendekatan tiga lapis

- Menyelesaikan pertempuran risiko AI jangka pendek

- Fraudgpt: Avatar Penjahat Chatgpt

- AI Risiko - Schneier on Security

- Penggunaan LLM untuk tujuan ilegal: ancaman, langkah -langkah pencegahan, dan kerentanan

- AI Teaming Merah bukanlah solusi satu atap untuk bahaya AI: Rekomendasi untuk menggunakan tim merah untuk akuntabilitas AI

- Taksonomi Kepercayaan untuk Kecerdasan Buatan

- Mengelola risiko AI di era kemajuan cepat

- Google - bertindak berdasarkan komitmen kami untuk AI yang aman dan aman

- Playbook ML Ofensif

- Demystifying generatif AI? Catatan Peneliti Keamanan

- Genai-Security-Adventures: Inisiatif Sumber Terbuka untuk berbagi catatan, presentasi, dan berbagai kumpulan eksperimen yang disajikan dalam buku catatan Jupyter, semuanya bertujuan membantu Anda memahami konsep-konsep penting di balik model bahasa besar dan mengeksplorasi persimpangan yang menarik dari keamanan dan alam yang menarik pemrosesan bahasa.

- AI Safety Camp menghubungkan Anda dengan penelitian mengarah untuk berkolaborasi pada suatu proyek - untuk melihat di mana pekerjaan Anda dapat membantu memastikan AI di masa depan aman.

- Pedoman untuk pengembangan sistem AI yang aman

- Pendekatan kecerdasan buatan dan keamanan siber. Laporan Praktik Terbaik

- Stanford aman, aman, dan dapat dipercaya Ai EO 14110 Tracker

- Keamanan ML Awesome: Daftar Kurator Referensi Keamanan Pembelajaran Mesin yang Luar Biasa, Bimbingan, Alat, dan banyak lagi.

- Jalur AI yang Dapat Diprediksi: 7 Hal yang Diharapkan Dari AI Pada 2024+

- Kecerdasan Buatan dan Keamanan Cybers (dalam bahasa Spanyol ??)

- Vigil: Mendeteksi injeksi cepat, jailbreak, dan input model bahasa besar (LLM) yang berpotensi berisiko.

- Model AI Generatif - Peluang dan Risiko untuk Industri dan Otoritas

- Menyebarkan sistem AI dengan aman. Praktik Terbaik Untuk Menyebarkan Sistem AI yang Aman dan Tangguh

- NIST AI 600-1: Kerangka Manajemen Risiko Kecerdasan Buatan: Profil Kecerdasan Buatan Generatif

- ?? ANSSI: Rekomendasi de sécurité pour un système d'ia générative (rekomendasi keamanan untuk sistem AI generatif)

- Pyrit: Alat identifikasi risiko Python untuk AI generatif (Pyrit) adalah kerangka otomasi akses terbuka untuk memberdayakan para profesional keamanan dan insinyur pembelajaran mesin untuk secara proaktif menemukan risiko dalam sistem AI generatif mereka.

- OWASP-Agentik-AI: Bekerja untuk membuat Top 10 OWASP untuk AI Agen AI (Keamanan Agen AI).

- Menuju AI yang aman dijamin: Kerangka kerja untuk memastikan sistem AI yang kuat dan andal

- Mendefinisikan risiko AI nyata

- Pendekatan aman untuk AI generatif

- Model Bahasa Besar di Cybersecurity

- Hei, itu model saya! Memperkenalkan Chain & Hash, teknik sidik jari LLM

- Penyalahgunaan AI Generatif: Taksonomi Taktik dan Wawasan dari Data Dunia Nyata

- Repositori Risiko AI

- Meninjau kembali tim merah AI

- Rekomendasi Jerman-Prancis untuk Penggunaan Asisten Pemrograman AI

- Watermarking yang dapat diskalakan untuk mengidentifikasi output model bahasa besar

Survei

- Ancaman AI ofensif terhadap organisasi

- Kecerdasan Buatan dalam Domain Cyber: Pelanggaran dan Pertahanan

- Survei tentang serangan dan pertahanan permusuhan

- Pembelajaran Deep Prisesarial: Survei tentang Serangan Perselisihan dan Mekanisme Pertahanan pada Klasifikasi Gambar

- Survei Serangan Privasi dalam Pembelajaran Mesin

- Menuju ancaman keamanan sistem pembelajaran yang mendalam: survei

- Survei tentang ancaman keamanan dan teknik defensif pembelajaran mesin: tampilan berbasis data

- Sok: Keamanan dan Privasi dalam Pembelajaran Mesin

- Pembelajaran Mesin Presperarial: Kenaikan kejahatan yang mendukung AI dan perannya dalam penghindaran filter spam

- Ancaman, Kerentanan, dan Kontrol Sistem Berbasis Pembelajaran Mesin: Survei dan Taksonomi

- Serangan dan Pertahanan Perselisihan: Survei

- Masalah Keamanan: Survei tentang Pembelajaran Mesin permusuhan

- Survei tentang serangan permusuhan untuk analisis malware

- Pembelajaran Mesin Perpisahan dalam Klasifikasi Gambar: Survei Menuju Perspektif Pembela

- Survei pelatihan permusuhan yang kuat dalam pengakuan pola: fundamental, teori, dan metodologi

- Privasi dalam Model Bahasa Besar: Serangan, Pertahanan, dan Arah Masa Depan

? Pemelihara?

Miguel Hernández |

José Ignacio Escribano |

© ️ Lisensi © ️

- Creative Commons Attribution-Share sama 4.0 International