Editor Downcodes mengetahui bahwa tim Tongyi Qianwen baru-baru ini melakukan open source seri lengkap model Qwen2.5-Coder terbarunya, yang menandai tonggak sejarah lain di bidang model besar open source. Model seri Qwen2.5-Coder telah menarik banyak perhatian karena kemampuan pengkodeannya yang kuat, fungsi yang beragam, dan kepraktisan yang mudah digunakan. Model tersebut telah menunjukkan kinerja luar biasa dalam pembuatan kode, perbaikan, dan penalaran, memberikan pengembang Alat canggih yang mendorong pengembangan lebih lanjut dari Kode Terbuka LLM. Rangkaian model open source ini akan sangat mendorong penerapan dan inovasi teknologi kecerdasan buatan di bidang pemrograman.

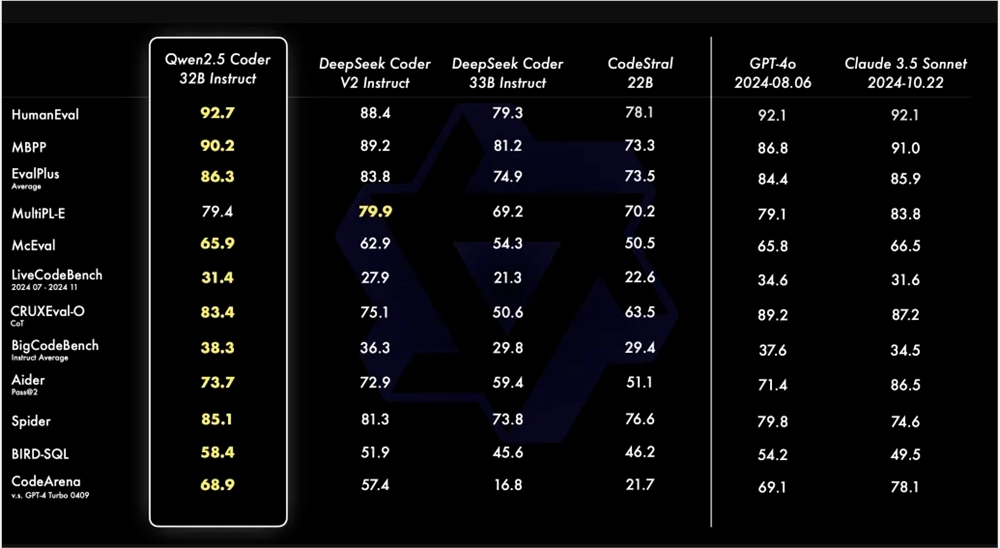

Tim Tongyi Qianwen baru-baru ini mengumumkan bahwa mereka akan menjadi open source seri Qwen2.5-Coder terbaru. Langkah ini bertujuan untuk mempromosikan pengembangan Open Code LLM. Qwen2.5-Coder telah menarik perhatian karena kekuatan, keragaman, dan kepraktisannya. Model Qwen2.5-Coder-32B-Instruct telah mencapai tingkat SOTA dalam hal kemampuan kode, yang setara dengan GPT-4o, menunjukkan kemampuan komprehensif, termasuk pembuatan kode, perbaikan kode, dan penalaran kode. Ini mencapai kinerja terbaik pada beberapa tolok ukur pembuatan kode dan mencapai skor 73,7 pada tolok ukur Aider, yang sebanding dengan GPT-4o.

Qwen2.5-Coder mendukung lebih dari 40 bahasa pemrograman dan mencetak 65,9 poin di McEval, dengan bahasa seperti Haskell dan Racket berkinerja sangat baik. Hal ini disebabkan oleh pembersihan dan pencocokan data yang unik pada tahap pra-pelatihan. Selain itu, Qwen2.5-Coder-32B-Instruct juga berkinerja baik dalam kemampuan perbaikan kode dalam berbagai bahasa pemrograman, dengan skor 75,2 pada benchmark MdEval, menempati peringkat pertama.

Untuk menguji kinerja penyelarasan Qwen2.5-Coder-32B-Instruct pada preferensi manusia, tolok ukur evaluasi preferensi kode yang dianotasi secara internal, Code Arena, dibuat. Hasilnya menunjukkan bahwa Qwen2.5-Coder-32B-Instruct memiliki keunggulan dalam penyelarasan pilihan.

Seri Qwen2.5-Coder kali ini memiliki model sumber terbuka dalam empat ukuran, termasuk 0,5B/3B/14B/32B, yang mencakup enam ukuran model utama untuk memenuhi kebutuhan pengembang yang berbeda. Pejabat tersebut menyediakan dua model: Base dan Instruct. Model pertama berfungsi sebagai dasar bagi pengembang untuk menyempurnakan model, dan model kedua berfungsi sebagai model obrolan yang diselaraskan secara resmi. Ada korelasi positif antara ukuran model dan kinerja, dan Qwen2.5-Coder mencapai kinerja SOTA di semua ukuran.

Model Qwen2.5-Coder 0.5B/1.5B/7B/14B/32B mengadopsi lisensi Apache2.0, sedangkan model 3B berlisensi Research Only. Tim memverifikasi efektivitas Scaling on Code LLMs dengan mengevaluasi kinerja Qwen2.5-Coder dengan ukuran berbeda di semua kumpulan data.

Sumber terbuka Qwen2.5-Coder memberi pengembang pilihan model pemrograman yang kuat, beragam, dan praktis, membantu mempromosikan pengembangan dan penerapan model bahasa pemrograman.

Tautan model pembuat kode Qwen2.5:

https://modelscope.cn/collections/Qwen25-Coder-9d375446e8f5814a

Singkatnya, Qwen2.5-Coder open source menghadirkan alat yang ampuh bagi pengembang, dan kinerjanya yang luar biasa serta penerapannya yang luas akan sangat mendorong pengembangan bidang pembuatan kode dan pemrograman. Kami berharap Qwen2.5-Coder dapat berperan dalam lebih banyak skenario aplikasi di masa depan.