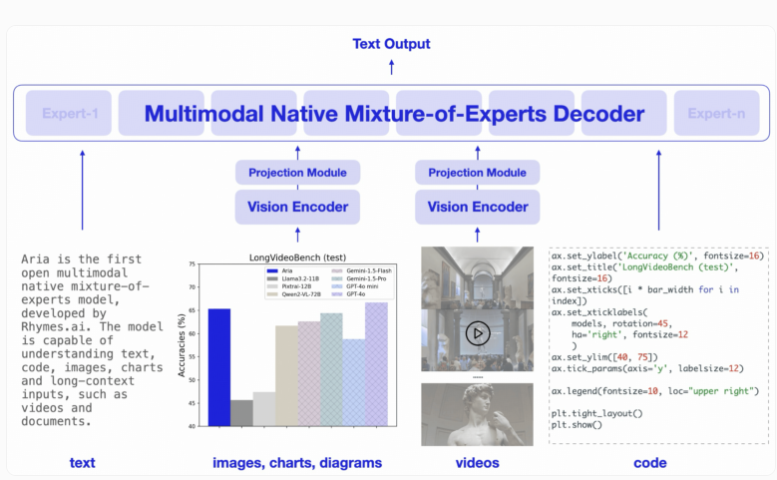

Startup yang berbasis di Tokyo, Rhymes AI, telah merilis model kecerdasan buatan pertamanya, Aria, model ahli hibrida multi-modal (MoE) sumber terbuka. Editor Downcodes mengetahui bahwa Aria berkinerja baik dalam memproses berbagai masukan seperti teks, kode, gambar, dan video, dan kemampuannya bahkan melampaui beberapa model bisnis terkenal. Aria menggunakan arsitektur MoE yang unik untuk meningkatkan efisiensi komputasi melalui beberapa pakar khusus, dan memiliki jendela konteks multi-modal hingga 24,9 miliar parameter dan 64,000 token, memungkinkannya menangani data masukan yang lebih panjang. Rhymes AI juga bekerja sama dengan AMD untuk mengoptimalkan kinerja model dan meluncurkan aplikasi pencarian BeaGo berbasis perangkat keras AMD.

Aria dirancang untuk memberikan pemahaman dan kemampuan pemrosesan yang unggul di berbagai format input, termasuk teks, kode, gambar, dan video. Berbeda dari model Transformer tradisional, model MoE menggantikan lapisan feed-forward dengan beberapa ahli profesional. Saat memproses setiap token masukan, modul perutean memilih subset pakar untuk diaktifkan, sehingga meningkatkan efisiensi komputasi dan mengurangi jumlah parameter aktivasi per token.

Decoder Aria dapat mengaktifkan 3,5 miliar parameter per token teks, dan keseluruhan model memiliki 24,9 miliar parameter. Untuk menangani masukan visual, Aria juga merancang encoder visual ringan dengan 438 juta parameter yang dapat mengubah masukan visual dengan berbagai panjang, ukuran, dan rasio aspek menjadi token visual. Selain itu, jendela konteks multimodal Aria mencapai 64,000 token, yang berarti dapat menangani input data yang lebih lama.

Dalam hal pelatihan, Rhymes AI dibagi menjadi empat tahap. Tahap pertama menggunakan data teks untuk pra-pelatihan, kemudian memperkenalkan data multi-modal, diikuti dengan pelatihan urutan panjang, dan terakhir penyesuaian.

Dalam proses ini, Aria menggunakan total 6,4 triliun token teks dan 400 miliar token multi-modal untuk pra-pelatihan. Data tersebut berasal dari kumpulan data terkenal seperti Common Crawl dan LAION, dan beberapa peningkatan sintetis telah dilakukan.

Menurut pengujian benchmark yang relevan, Aria mengungguli model seperti Pixtral-12B dan Llama-3.2-11B dalam berbagai tugas multimodal, bahasa, dan pemrograman, serta memiliki biaya inferensi yang lebih rendah karena parameter aktivasi yang lebih sedikit.

Selain itu, Aria berkinerja baik saat memproses video dengan subtitle atau dokumen multi-halaman, dan kemampuannya untuk memahami video dan dokumen panjang melebihi model open source lainnya seperti GPT-4o mini dan Gemini1.5Flash .

Untuk kemudahan penggunaan, Rhymes AI merilis kode sumber Aria di GitHub di bawah lisensi Apache2.0, mendukung penggunaan akademis dan komersial. Pada saat yang sama, mereka juga menyediakan kerangka pelatihan yang dapat menyempurnakan Aria untuk berbagai sumber dan format data pada satu GPU. Perlu disebutkan bahwa Rhymes AI telah menjalin kerja sama dengan AMD untuk mengoptimalkan kinerja model dan mendemonstrasikan aplikasi pencarian bernama BeaGo, yang dapat berjalan pada perangkat keras AMD untuk memberikan hasil pencarian AI teks dan gambar yang lebih komprehensif kepada pengguna.

Menyorot:

Aria adalah model AI ahli hibrida multimodal sumber terbuka pertama di dunia.

Aria mengungguli banyak model sejenis saat memproses berbagai masukan seperti teks, gambar, dan video.

? Rhymes AI bekerja sama dengan AMD untuk mengoptimalkan kinerja model dan meluncurkan aplikasi pencarian BeaGo yang mendukung berbagai fungsi.

Secara keseluruhan, model Aria yang open source dan berkinerja tinggi telah membawa terobosan baru di bidang kecerdasan buatan dan menyediakan alat yang ampuh bagi pengembang dan peneliti. Kemampuan multi-modal dan efisiensi komputasi yang tinggi memberikan potensi besar dalam aplikasi masa depan. Editor Downcodes menantikan penerapan dan pengembangan Aria di lebih banyak bidang.