Laporan editor Downcode: Tim kreatif Alimama telah meluncurkan model pembuatan gambar baru FLUX.1-Turbo-Alpha, yang merupakan model Lora sulingan 8 langkah berdasarkan pelatihan model FLUX.1-dev. Model ini menggunakan diskriminator multi-head, yang secara signifikan meningkatkan kualitas pembuatan gambar. Model ini mendukung berbagai fungsi seperti pembuatan teks-ke-gambar, jaringan kontrol perbaikan, dll., dan kompatibel dengan kerangka kerja Diffusers dan ComfyUI, sehingga membuatnya kompatibel dengan kerangka kerja Diffusers dan ComfyUI. mudah bagi pengguna untuk memulai dengan cepat. Model ini dilatih secara bermusuhan pada jutaan data gambar berkualitas tinggi. Skor estetika melebihi 6,3 dan resolusi lebih tinggi dari 800, sehingga memastikan keluaran gambar berkualitas tinggi. Yang lebih menarik lagi adalah versi dengan langkah yang lebih rendah akan diluncurkan di masa mendatang.

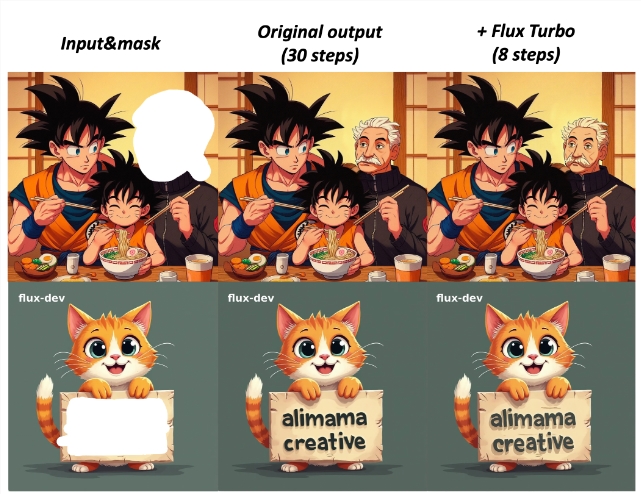

Baru-baru ini, tim kreatif Alimama merilis FLUX.1-Turbo-Alpha, model Lora distilasi 8 langkah yang dilatih berdasarkan model FLUX.1-dev.

Model ini menggunakan diskriminator multi-head, yang secara signifikan meningkatkan kualitas distilasi dan mendukung berbagai aplikasi terkait FLUX seperti pembuatan teks-ke-gambar dan perbaikan jaringan kontrol. Tim merekomendasikan untuk menyetel skala panduan ke 3,5 dan skala Lora ke 1 saat menggunakannya. Versi dengan jumlah langkah yang lebih sedikit akan diluncurkan di masa mendatang.

FLUX.1-Turbo-Alpha dapat digunakan langsung dengan kerangka Diffusers. Pengguna dapat memuat model dan menghasilkan gambar yang diperlukan hanya dengan beberapa baris kode. Misalnya, Anda dapat membuat adegan menyenangkan berupa seorang pemalas yang tersenyum mengenakan jaket kulit, topi koboi, rok kotak-kotak, dan pita, berdiri di depan van Volkswagen ramping yang dilukis dengan pemandangan kota. Hanya dengan menyesuaikan parameternya, Anda dapat menghasilkan gambar berkualitas tinggi dengan resolusi 1024x1024.

Selain itu, model ini juga kompatibel dengan ComfyUI dan dapat digunakan untuk alur kerja teks-ke-gambar yang cepat atau untuk mencapai efek pembangkitan yang lebih efisien dalam jaringan kontrol perbaikan. Melalui teknologi ini, gambar yang dihasilkan dapat sangat mirip dengan keluaran aslinya, sehingga meningkatkan pengalaman kreatif pengguna.

Proses pelatihan FLUX.1-Turbo-Alpha juga sama mengesankannya. Model ini dilatih pada lebih dari 1 juta gambar dari sumber terbuka dan sumber internal, dengan skor estetika lebih dari 6,3, semuanya pada resolusi di atas 800. Tim mengadopsi metode pelatihan adversarial selama proses pelatihan untuk meningkatkan kualitas gambar dan menambahkan desain multi-head untuk setiap lapisan transformator. Skala bootstrap selama pelatihan ditetapkan pada 3,5, offset waktu ditetapkan ke 3, presisi campuran bf16 digunakan, kecepatan pembelajaran ditetapkan ke 2e-5, ukuran batch 64, dan ukuran gambar 1024x1024.

Peluncuran FLUX.1-Turbo-Alpha menandai terobosan lain bagi Alimama di bidang pembuatan gambar, mempromosikan pemasyarakatan dan penerapan teknologi kecerdasan buatan.

Pintu masuk proyek: https://huggingface.co/alimama-creative/FLUX.1-Turbo-Alpha

Menyorot:

Model ini didasarkan pada FLUX.1-dev dan menggunakan distilasi 8 langkah dan diskriminator multi-head untuk meningkatkan kualitas pembuatan gambar.

Mendukung pembuatan teks-ke-gambar dan perbaikan jaringan kontrol, pengguna dapat dengan mudah membuat berbagai adegan menarik.

? Proses pelatihan menggunakan pelatihan adversarial, dan data pelatihan melebihi 1 juta gambar untuk memastikan keluaran model berkualitas tinggi.

Secara keseluruhan, FLUX.1-Turbo-Alpha menghadirkan kemungkinan-kemungkinan baru di bidang pembuatan gambar dengan efisiensi tinggi, kemampuan pembuatan gambar berkualitas tinggi, serta fitur-fitur yang nyaman dan mudah digunakan. Pengguna yang tertarik dapat mengunjungi halaman Memeluk Wajah untuk merasakan model canggih ini. Editor Downcodes akan terus memperhatikan kemajuan terbaru Alibaba di bidang kecerdasan buatan dan memberikan Anda laporan yang lebih menarik.