Model bahasa besar (LLM) semakin banyak digunakan, namun sejumlah besar parameternya memerlukan sumber daya komputasi yang besar. Untuk mengatasi masalah ini dan meningkatkan efisiensi dan akurasi model di lingkungan sumber daya yang berbeda, peneliti terus mengeksplorasi metode baru. Artikel ini akan memperkenalkan kerangka kerja Flextron yang dikembangkan bersama oleh para peneliti dari NVIDIA dan Universitas Texas di Austin. Kerangka kerja ini dirancang untuk mencapai penerapan model AI yang fleksibel tanpa penyesuaian tambahan dan secara efektif memecahkan masalah inefisiensi metode tradisional. Editor Downcodes akan menjelaskan secara rinci inovasi kerangka Flextron dan keunggulannya dalam lingkungan dengan sumber daya terbatas.

Di bidang kecerdasan buatan, model bahasa besar (LLM) seperti GPT-3 dan Llama-2 telah mencapai kemajuan yang signifikan dan dapat memahami serta menghasilkan bahasa manusia secara akurat. Namun, banyaknya parameter model ini membuatnya memerlukan sumber daya komputasi dalam jumlah besar selama pelatihan dan penerapan, sehingga menimbulkan tantangan dalam lingkungan dengan sumber daya terbatas.

Pintu masuk kertas: https://arxiv.org/html/2406.10260v1

Secara tradisional, untuk mencapai keseimbangan efisiensi dan akurasi dalam batasan sumber daya komputasi yang berbeda, peneliti perlu melatih beberapa versi model yang berbeda. Misalnya, keluarga model Llama-2 mencakup varian berbeda dengan 7 miliar, 1,3 miliar, dan 700 juta parameter. Namun, metode ini memerlukan data dan sumber daya komputasi dalam jumlah besar dan tidak terlalu efisien.

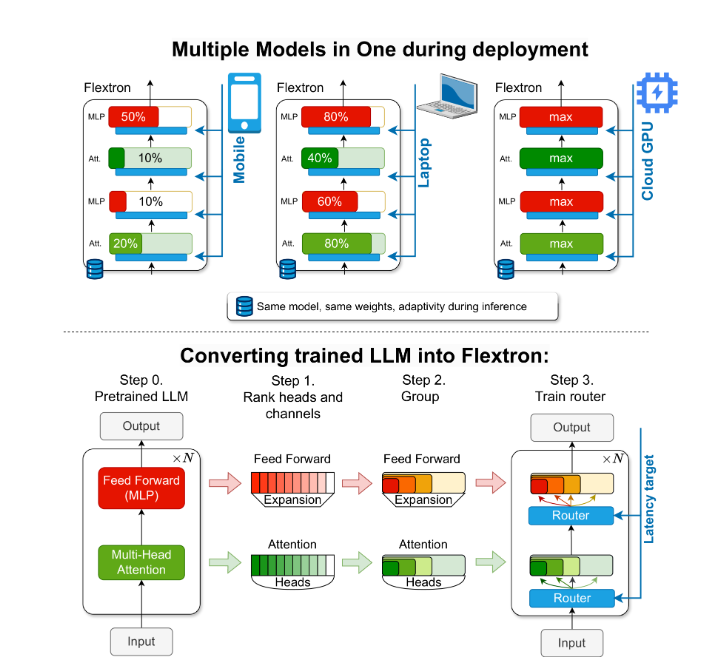

Untuk mengatasi masalah ini, peneliti dari NVIDIA dan University of Texas di Austin memperkenalkan kerangka Flextron. Flextron adalah arsitektur model fleksibel baru dan kerangka optimasi pasca-pelatihan yang mendukung penerapan model adaptif tanpa memerlukan penyesuaian tambahan, sehingga memecahkan masalah inefisiensi metode tradisional.

Flextron mengubah LLM yang telah dilatih sebelumnya menjadi model elastis melalui metode pelatihan yang efisien sampel dan algoritma perutean tingkat lanjut. Struktur ini menampilkan desain elastis bersarang yang memungkinkan penyesuaian dinamis selama inferensi untuk memenuhi sasaran latensi dan akurasi tertentu. Kemampuan beradaptasi ini memungkinkan penggunaan satu model terlatih dalam berbagai skenario penerapan, sehingga secara signifikan mengurangi kebutuhan akan beberapa varian model.

Evaluasi kinerja Flextron menunjukkan bahwa Flextron memiliki kinerja yang lebih baik dalam hal efisiensi dan akurasi dibandingkan dengan beberapa model terlatih end-to-end dan jaringan elastis canggih lainnya. Misalnya, Flextron berkinerja baik pada berbagai tolok ukur seperti ARC-easy, LAMBADA, PIQA, WinoGrande, MMLU, dan HellaSwag, hanya menggunakan 7,63% penanda pelatihan dalam pra-pelatihan awal, sehingga menghemat banyak sumber daya dan waktu komputasi. .

Kerangka kerja Flextron juga mencakup lapisan elastic multi-layer perceptron (MLP) dan elastic multi-head awareness (MHA), yang semakin meningkatkan kemampuan adaptasinya. Lapisan MHA elastis secara efektif memanfaatkan memori dan daya pemrosesan yang tersedia dengan memilih subset kepala perhatian berdasarkan data masukan, dan sangat cocok untuk skenario dengan sumber daya komputasi terbatas.

Menyorot:

? Kerangka kerja Flextron mendukung penerapan model AI yang fleksibel tanpa penyesuaian tambahan.

Melalui pelatihan sampel yang efisien dan algoritme perutean tingkat lanjut, efisiensi dan akurasi model ditingkatkan.

Lapisan perhatian multi-head yang elastis mengoptimalkan pemanfaatan sumber daya dan sangat cocok untuk lingkungan dengan sumber daya komputasi terbatas.

Laporan ini berharap dapat memperkenalkan pentingnya dan inovasi kerangka Flextron kepada siswa sekolah menengah dengan cara yang mudah dipahami.

Secara keseluruhan, kerangka kerja Flextron memberikan solusi yang efisien dan inovatif terhadap masalah penerapan model bahasa besar di lingkungan dengan sumber daya terbatas. Arsitekturnya yang fleksibel dan metode pelatihan yang efisien dalam sampel memberikan keuntungan signifikan dalam aplikasi praktis dan memberikan arah baru untuk pengembangan lebih lanjut teknologi kecerdasan buatan. Editor Downcodes berharap artikel ini dapat membantu semua orang lebih memahami ide inti dan kontribusi teknis kerangka Flextron.