Llama 3.1, model bahasa sumber terbuka raksasa dengan 405 miliar parameter, menyebabkan guncangan besar di bidang AI karena kebocoran tanpa rilis resmi. Performanya sangat bertenaga bahkan melampaui GPT-4o dalam beberapa pengujian benchmark, sehingga menetapkan tolok ukur baru untuk model open source. Diskusi hangat di Reddit semakin membuktikan dampaknya terhadap komunitas AI. Artikel ini akan mempelajari kinerja, sorotan, dan langkah-langkah keamanan Llama 3.1 dan mengungkap model misterius ini.

Llama3.1 telah bocor! Anda tidak salah dengar, model open source dengan 405 miliar parameter ini telah menyebabkan keributan di Reddit. Ini mungkin model open source yang paling mendekati GPT-4o hingga saat ini, dan bahkan melampauinya dalam beberapa aspek.

Llama3.1 adalah model bahasa besar yang dikembangkan oleh Meta (sebelumnya Facebook). Meski belum dirilis secara resmi, namun versi bocorannya sudah membuat heboh masyarakat. Model ini tidak hanya mencakup model dasar, tetapi juga hasil benchmark 8B, 70B, dan parameter maksimum 405B.

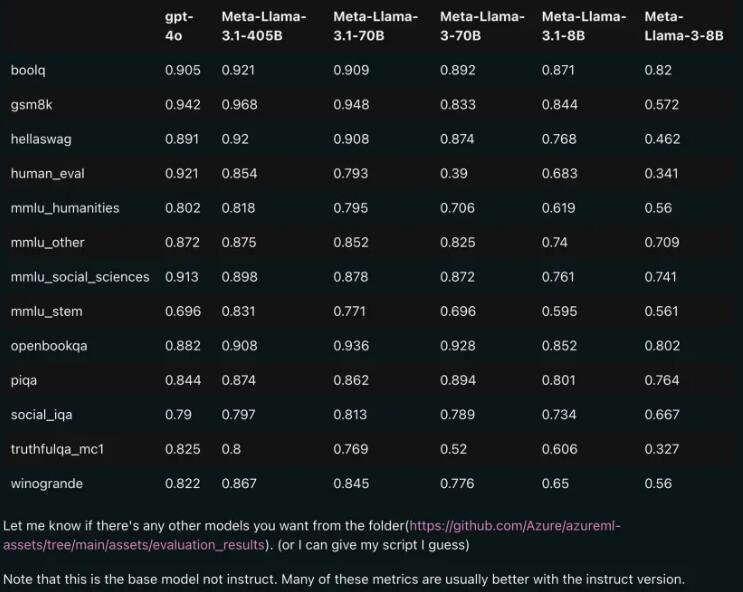

Perbandingan kinerja: Llama3.1 vs GPT-4o

Dilihat dari bocoran hasil perbandingan, bahkan Llama3.1 versi 70B mengungguli GPT-4o dalam beberapa pengujian benchmark. Ini adalah pertama kalinya model open source mencapai tingkat SOTA (State of the Art, teknologi paling canggih) pada berbagai tolok ukur.

Sorotan model: dukungan multi-bahasa, data pelatihan yang lebih kaya

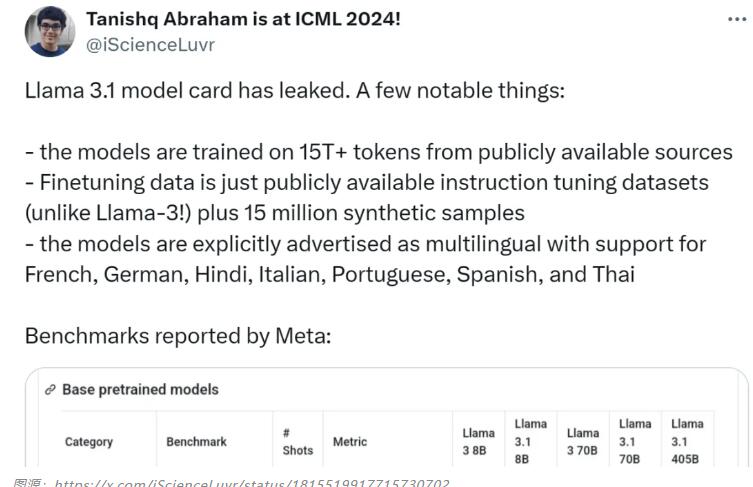

Model Llama3.1 menggunakan 15T+ token dari sumber publik untuk pelatihan, dan batas waktu data pra-pelatihan adalah Desember 2023. Ini mendukung tidak hanya bahasa Inggris tetapi juga Perancis, Jerman, Hindi, Italia, Portugis, Spanyol dan Thailand. Hal ini menjadikannya bagus dalam kasus penggunaan percakapan multibahasa.

Tim peneliti Llama3.1 sangat mementingkan keamanan model. Mereka menggunakan pendekatan pengumpulan data multifaset yang menggabungkan data buatan manusia dan data sintetis untuk memitigasi potensi risiko keamanan. Selain itu, model ini juga memperkenalkan petunjuk batas dan petunjuk permusuhan untuk meningkatkan pengendalian kualitas data.

Sumber kartu model: https://pastebin.com/9jGkYbXY#google_vignette

Kebocoran Llama 3.1 tentunya akan berdampak besar di bidang AI. Hal ini tidak hanya menunjukkan potensi besar dari model open source, namun juga memicu pemikiran lebih jauh mengenai keamanan model dan masalah etika. Kedepannya, kami akan terus memperhatikan Llama 3.1 dan perkembangan selanjutnya, dan berharap Llama 3.1 dapat menghadirkan lebih banyak kejutan bagi kemajuan teknologi AI.