OpenAI mengumumkan bahwa mode suara canggih ChatGPT telah divisualisasikan. Pengguna yang berlangganan Plus, Team, atau Pro dapat berinteraksi dengan ChatGPT secara real time melalui kamera ponsel mereka dan memiliki kemampuan berbagi layar. Fitur ini telah mengalami penundaan berkali-kali sebelumnya dan akhirnya diluncurkan secara resmi setelah sekian lama pengujian. Namun, tidak semua pengguna dapat langsung menggunakannya. Beberapa wilayah dan tipe pengguna harus menunggu hingga Januari tahun depan atau bahkan lebih lama lagi.

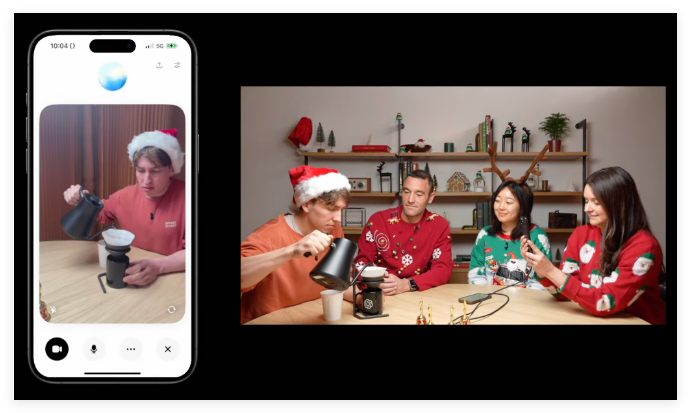

OpenAI mengumumkan pada hari Kamis bahwa fitur percakapan mirip manusia "Mode Ucapan Lanjutan" yang dikembangkannya untuk ChatGPT telah divisualisasikan. Pengguna yang berlangganan ChatGPT Plus, Team, atau Pro kini dapat mengarahkan kamera ponselnya ke suatu objek dan ChatGPT akan merespons hampir secara real-time.

Mode suara canggih dengan fitur penglihatan ini juga dilengkapi kemampuan berbagi layar yang menganalisis konten di layar perangkat. Misalnya saja dapat menjelaskan berbagai menu pengaturan dan memberikan saran soal matematika.

Cara penggunaannya sangat sederhana: klik ikon suara di sebelah chat bar ChatGPT, lalu klik ikon video di pojok kiri bawah untuk memulai video. Jika Anda ingin membagikan layar Anda, Anda dapat mengklik menu tiga titik dan memilih "Bagikan Layar".

Mengenai peluncuran fitur, OpenAI mengatakan bahwa mode bicara lanjutan dengan visi akan diluncurkan mulai Kamis ini dan berakhir minggu depan. Penting untuk diperhatikan bahwa ini tidak akan langsung tersedia untuk semua pengguna. Pengguna ChatGPT Enterprise dan Edu harus menunggu hingga Januari tahun depan, sementara pengguna di UE, Swiss, Islandia, Norwegia, dan Liechtenstein belum mengumumkan jadwal spesifiknya.

Dalam penampilan baru-baru ini di "60 Minutes" CNN, Presiden OpenAI Greg Brockman mendemonstrasikan kemampuan analisis visual tingkat lanjut untuk pola bicara kepada Anderson Cooper. Saat Cooper menggambar bagian tubuh manusia di papan tulis, ChatGPT dapat memahami dan mengomentari gambarnya. Misalnya, dinyatakan bahwa posisi otak akurat dan menunjukkan bahwa bentuk otak lebih mendekati elips.

Namun, selama demonstrasi, mode bicara tingkat lanjut ini juga mengungkapkan beberapa ketidakakuratan mengenai masalah geometris, yang menunjukkan potensi risiko "halusinasi".

Perlu disebutkan bahwa mode suara canggih dengan fitur visual ini telah ditunda beberapa kali. Pada bulan April, OpenAI berjanji akan diluncurkan "dalam beberapa minggu", namun kemudian mengatakan bahwa hal itu akan membutuhkan lebih banyak waktu. Fitur ini tidak tersedia untuk beberapa pengguna ChatGPT hingga awal musim gugur ini, dan fungsi analisis visual belum tersedia pada saat itu.

Di tengah meningkatnya persaingan dalam kecerdasan buatan, pesaing seperti Google dan Meta juga mengembangkan kemampuan serupa. Minggu ini, Google telah membuka proyek kecerdasan buatan percakapan analisis video real-time Project Astra untuk beberapa penguji Android.

Selain fitur visual, OpenAI juga meluncurkan "Mode Santa" yang meriah pada hari Kamis, memungkinkan pengguna mengaktifkan suara Sinterklas melalui ikon kepingan salju di sebelah bilah notifikasi di aplikasi ChatGPT.

Pembaruan visual pada mode suara canggih ChatGPT ini menandai peningkatan kemampuan AI untuk berinteraksi dengan dunia nyata, namun juga mengungkap tantangan dan keterbatasan dalam pengembangan teknologi. Di masa depan, peningkatan dan pemasyarakatan fungsi serupa patut dinantikan. Kemajuan teknologi AI akan terus mempengaruhi gaya hidup kita.