Epoch AI baru-baru ini merilis simulator daya komputasi pelatihan model bahasa berskala besar. Simulator ini memberikan referensi berharga bagi para peneliti dengan mensimulasikan biaya dan efisiensi pelatihan GPT-4 dalam kondisi perangkat keras yang berbeda. Hasil simulasi menunjukkan bahwa meskipun menggunakan kartu grafis lama GTX580 dari tahun 2012 dapat melatih GPT-4, namun biayanya akan sepuluh kali lipat dari biaya perangkat keras modern, yang menyoroti pentingnya peningkatan kinerja perangkat keras untuk pelatihan model AI. Simulator ini juga mendukung simulasi pelatihan multi-pusat data, memungkinkan pengguna untuk menyesuaikan parameter dan menganalisis perbedaan kinerja berbagai perangkat keras dan strategi pelatihan, sehingga memberikan dasar pengambilan keputusan penting untuk pelatihan model AI skala besar di masa depan.

Baru-baru ini, perusahaan riset kecerdasan buatan Epoch AI merilis simulator interaktif yang dirancang khusus untuk mensimulasikan daya komputasi yang diperlukan untuk melatih model bahasa besar. Dengan menggunakan simulator ini, para peneliti menemukan bahwa meskipun pelatihan GPT-4 dapat dilakukan menggunakan kartu grafis lama dari tahun 2012, seperti GTX580, biayanya akan sepuluh kali lipat dibandingkan perangkat keras modern saat ini.

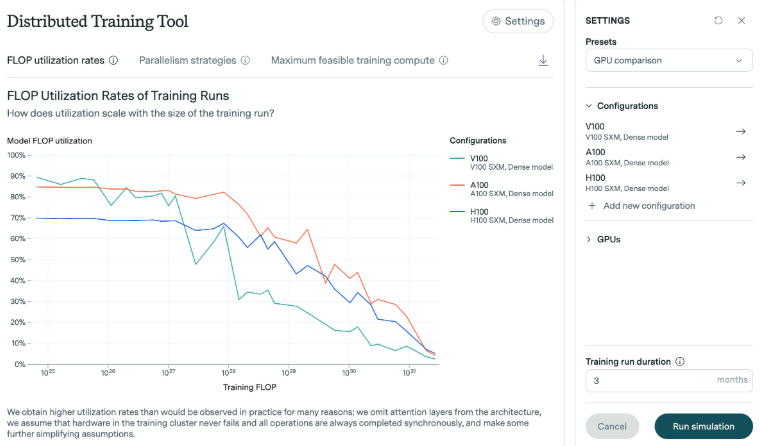

Penelitian dari Epoch AI menunjukkan bahwa jumlah operasi floating-point (FLOP) yang diperlukan untuk melatih GPT-4 adalah antara 1e25 dan 1e26. Untuk penelitian ini, simulator menganalisis efisiensi berbagai kartu grafis, terutama seiring dengan peningkatan skala model. Hasilnya menunjukkan bahwa seiring dengan pertumbuhan model, efisiensi umumnya menurun. Ambil contoh kartu grafis H100 yang diluncurkan beberapa tahun terakhir. Kartu ini dapat mempertahankan efisiensi tinggi untuk waktu yang lama, sementara efisiensi kartu grafis V100 turun lebih jelas saat menghadapi skala pelatihan yang lebih besar.

Pada percobaan Epoch AI, memori kartu grafis GTX580 hanya sebesar 3GB. Kartu grafis ini menjadi pilihan utama saat melatih model AlexNet pada tahun 2012. Meskipun teknologi telah maju, para peneliti percaya bahwa pelatihan dalam skala besar dapat dilakukan dengan menggunakan perangkat keras yang lebih tua, namun sumber daya dan biaya yang diperlukan akan menjadi penghalang.

Selain itu, simulator ini mendukung simulasi pelatihan kompleks di beberapa pusat data. Pengguna dapat menyesuaikan parameter seperti ukuran pusat data, latensi, dan bandwidth koneksi untuk mensimulasikan pelatihan yang dijalankan di beberapa lokasi. Alat ini juga memungkinkan menganalisis perbedaan kinerja antara kartu grafis modern (seperti H100 dan A100), mempelajari efek dari ukuran batch yang berbeda dan pelatihan multi-GPU, dan menghasilkan file log terperinci yang mendokumentasikan keluaran model.

Epoch AI mengatakan pihaknya mengembangkan simulator tersebut untuk memperdalam pemahamannya tentang peningkatan efisiensi perangkat keras dan menilai dampak pengendalian ekspor chip. Dengan perkiraan peningkatan misi pelatihan skala besar pada abad ini, sangatlah penting untuk memahami persyaratan perangkat keras yang diperlukan di masa depan.

Secara keseluruhan, penelitian dan simulator Epoch AI ini memberikan nilai referensi penting untuk pelatihan model bahasa besar, membantu peneliti lebih memahami efisiensi perangkat keras, mengoptimalkan strategi pelatihan, dan memberikan pelatihan yang lebih andal untuk model AI di masa depan.