Answer.AI dan LightOn bersama-sama merilis model bahasa sumber terbuka ModernBERT, yang merupakan peningkatan besar dibandingkan Google BERT dan telah meningkatkan kecepatan, efisiensi, dan kualitas secara signifikan. ModernBERT memproses empat kali lebih cepat dibandingkan BERT, menggunakan lebih sedikit memori, dan dapat menangani teks hingga 8192 token, yang 16 kali lebih cepat dibandingkan model yang ada. Ini juga membuat kemajuan terobosan dalam pengkodean kode pemrograman untuk pertama kalinya, dengan skor lebih dari 80 pada kumpulan data Q&A StackOverflow, yang menetapkan rekor baru. Yang lebih penting lagi, ModernBERT secara signifikan mengurangi biaya pemrosesan teks skala besar dan dapat berjalan pada perangkat keras tingkat konsumen biasa, sehingga lebih hemat biaya dibandingkan model seperti GPT-4.

Desain ModernBERT memungkinkannya memproses teks hingga panjang 8192 token, yang merupakan peningkatan 16x dibandingkan batas 512 token pada model pengkodean yang ada. Selain itu, ModernBERT adalah model pengkodean kode pemrograman pertama yang dilatih secara ekstensif, mencapai skor lebih dari 80 pada kumpulan data Tanya Jawab StackOverflow, yang menetapkan rekor baru untuk model pengkodean.

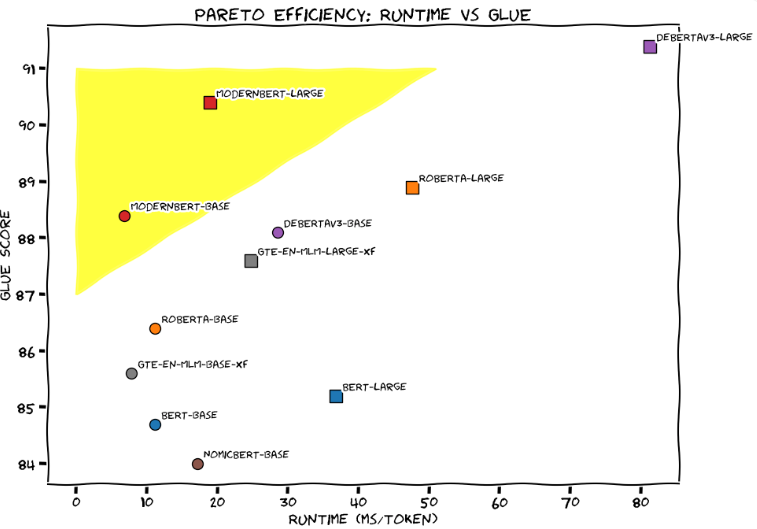

Dalam Evaluasi Pemahaman Bahasa Umum (GLUE), ModernBERT-Large mencapai keseimbangan terbaik antara kecepatan dan akurasi pemrosesan, dengan waktu pemrosesan sekitar 20 milidetik per token dan skor 90. Tim pengembangan dengan jelas membandingkan ModernBERT dengan Honda Civic yang telah disetel, menekankan bahwa ModernBERT dapat diandalkan dan efisien dalam aplikasi sehari-hari.

Dibandingkan dengan model bahasa skala besar yang ada seperti GPT-4, ModernBERT secara signifikan mengurangi biaya pemrosesan teks skala besar. GPT-4 berharga beberapa sen per kueri, sedangkan ModernBERT berjalan secara lokal, lebih cepat dan lebih murah. Misalnya, ketika proyek FineWeb Edu memfilter 15 miliar tag, biaya penggunaan model BERT adalah US$60.000, dan bahkan menggunakan dekoder Gemini Flash Google, biayanya lebih dari US$1 juta.

Tim pengembangan mengatakan ModernBERT sangat cocok untuk berbagai aplikasi praktis, termasuk sistem pengambilan-augmented generation (RAG), pencarian kode, dan tinjauan konten. Berbeda dengan GPT-4, yang memerlukan perangkat keras khusus, ModernBERT dapat berjalan secara efektif pada GPU gaming konsumen biasa.

Saat ini, ModernBERT tersedia dalam dua versi: model dasar berisi 139 juta parameter, dan versi besar berisi 395 juta parameter. Kedua versi tersebut kini dirilis di Hugging Face, dan pengguna dapat langsung mengganti model BERT yang ada dengan model BERT yang ada. Tim pengembangan berencana meluncurkan versi yang lebih besar tahun depan, namun belum ada rencana untuk kemampuan multimodal. Untuk mempromosikan pengembangan aplikasi baru, mereka juga meluncurkan kontes yang akan memberikan hadiah $100 dan langganan pro Hugging Face selama enam bulan kepada lima presenter terbaik.

Sejak Google meluncurkan BERT pada tahun 2018, model ini telah menjadi salah satu model bahasa paling populer, dengan lebih dari 68 juta unduhan bulanan di HuggingFace.

Pintu masuk proyek: https://huggingface.co/blog/modernbert

Highlight:

ModernBERT empat kali lebih cepat dari BERT dan dapat menangani teks hingga 8192 token.

Dibandingkan dengan GPT-4, biaya ModernBERT dalam pemrosesan teks skala besar berkurang secara signifikan dan pengoperasiannya lebih efisien.

Model ini sangat baik dalam memproses kode pemrograman, mencetak lebih dari 80 pada kumpulan data Tanya Jawab StackOverflow, dan mencetak rekor baru.

Singkatnya, rilis open source ModernBERT memberi pengembang pilihan model bahasa yang efisien, ekonomis, dan kuat. Ini memiliki keunggulan signifikan dalam kecepatan, efisiensi, dan kemampuan memproses teks panjang, dan diharapkan dapat mendorong pengembangan inovatif lebih banyak aplikasi AI. . Menantikan pembaruan di masa depan dan aplikasi yang lebih luas.