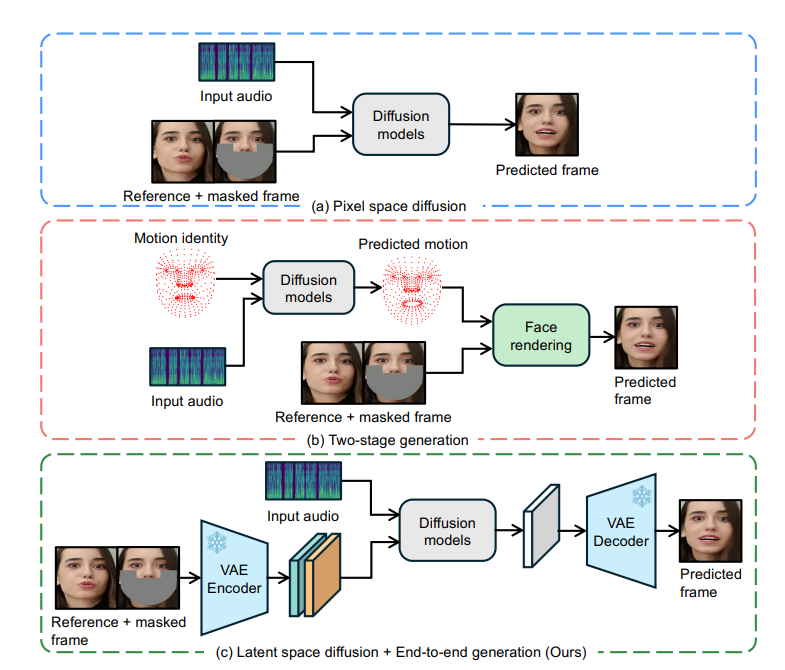

ByteDance memiliki teknologi sinkronisasi bibir inovatif bersumber terbuka yang disebut LatentSync, yang didasarkan pada model difusi laten kondisi audio dan mencapai sinkronisasi yang tepat antara gerakan bibir karakter dalam video dengan audio. Ini secara langsung memanfaatkan kekuatan Difusi Stabil tanpa memerlukan representasi gerakan perantara, secara efektif memodelkan asosiasi audio-visual yang kompleks, dan meningkatkan konsistensi temporal melalui teknologi Temporal Representation Alignment (TREPA). LatentSync juga mengoptimalkan masalah konvergensi SyncNet dan secara signifikan meningkatkan akurasi sinkronisasi bibir. Teknologi ini memiliki keunggulan signifikan dalam kerangka end-to-end, generasi berkualitas tinggi, konsistensi temporal dan optimalisasi SyncNet, memberikan solusi baru untuk animasi potret berbasis audio.

Ditemukan bahwa metode sinkronisasi bibir berbasis difusi berkinerja buruk dalam hal konsistensi temporal karena ketidakkonsistenan dalam proses difusi antara bingkai yang berbeda. Untuk mengatasi masalah ini, LatentSync memperkenalkan teknologi Time Representation Alignment (TREPA). TREPA memanfaatkan representasi temporal yang diekstraksi dari model video besar yang diawasi sendiri untuk menyelaraskan frame yang dihasilkan dengan frame nyata, sehingga meningkatkan konsistensi temporal sambil menjaga akurasi sinkronisasi bibir.

Selain itu, tim peneliti juga melakukan studi mendalam tentang masalah konvergensi SyncNet, dan melalui sejumlah besar studi empiris, mengidentifikasi faktor-faktor utama yang mempengaruhi konvergensi SyncNet, termasuk arsitektur model, pelatihan hyperparameter, dan metode pra-pemrosesan data. Dengan mengoptimalkan faktor-faktor ini, akurasi SyncNet pada set pengujian HDTF meningkat secara signifikan dari 91% menjadi 94%. Karena keseluruhan kerangka pelatihan SyncNet tidak diubah, pengalaman ini juga dapat diterapkan pada metode sinkronisasi bibir dan animasi potret berbasis audio lainnya yang menggunakan SyncNet.

Keuntungan Sinkronisasi Latent

Kerangka ujung ke ujung: Menghasilkan gerakan bibir yang tersinkronisasi langsung dari audio tanpa representasi gerakan perantara.

Generasi berkualitas tinggi: Gunakan kemampuan Difusi Stabil yang kuat untuk menghasilkan video berbicara yang dinamis dan realistis.

Konsistensi temporal: Tingkatkan konsistensi temporal antar frame video melalui teknologi TREPA.

Pengoptimalan SyncNet: Memecahkan masalah konvergensi SyncNet dan secara signifikan meningkatkan akurasi sinkronisasi bibir.

Prinsip kerja

Inti dari LatentSync didasarkan pada teknologi perbaikan gambar-ke-gambar, yang memerlukan masukan gambar bertopeng sebagai referensi. Untuk mengintegrasikan fitur visual wajah dari video asli, model juga memasukkan gambar referensi. Setelah penyambungan saluran, informasi masukan ini dimasukkan ke dalam jaringan U-Net untuk diproses.

Model ini menggunakan ekstraktor fitur audio terlatih Whisper untuk mengekstrak embeddings audio. Pergerakan bibir mungkin dipengaruhi oleh audio frame di sekitarnya, sehingga model menggabungkan audio dari beberapa frame di sekitarnya sebagai masukan untuk memberikan lebih banyak informasi temporal. Penyematan audio diintegrasikan ke dalam U-Net melalui lapisan perhatian silang.

Untuk mengatasi masalah yang memerlukan input ruang gambar oleh SyncNet, pertama-tama model memprediksi ruang bising dan kemudian memperoleh perkiraan ruang laten bersih melalui metode satu langkah. Studi tersebut menemukan bahwa pelatihan SyncNet di ruang piksel lebih baik daripada pelatihan di ruang laten, yang mungkin karena informasi daerah bibir hilang selama pengkodean VAE.

Proses pelatihan dibagi menjadi dua tahap: pada tahap pertama, U-Net mempelajari fitur visual tanpa decoding ruang piksel dan menambahkan kerugian SyncNet. Tahap kedua menambahkan kerugian SyncNet menggunakan metode pengawasan ruang piksel yang didekodekan dan menggunakan kerugian LPIPS untuk meningkatkan kualitas visual gambar. Untuk memastikan bahwa model mempelajari informasi temporal dengan benar, derau masukan juga harus konsisten secara temporal, dan model tersebut menggunakan model derau campuran. Selain itu, pada tahap preprocessing data, transformasi affine juga digunakan untuk mencapai frontalisasi wajah.

teknologi TREPA

TREPA meningkatkan konsistensi temporal dengan menyelaraskan representasi temporal dari urutan gambar yang dihasilkan dan gambar nyata. Metode ini menggunakan model video pengawasan mandiri berskala besar VideoMAE-v2 untuk mengekstrak representasi temporal. Berbeda dengan metode yang hanya menggunakan hilangnya jarak antar gambar, representasi temporal dapat menangkap korelasi temporal dalam rangkaian gambar, sehingga meningkatkan konsistensi temporal secara keseluruhan. Penelitian menemukan bahwa TREPA tidak hanya tidak merusak keakuratan sinkronisasi bibir, namun sebenarnya dapat meningkatkannya.

Masalah konvergensi SyncNet

Penelitian telah menemukan bahwa kerugian pelatihan SyncNet cenderung tetap mendekati 0,69 dan tidak dapat dikurangi lebih lanjut. Melalui analisis eksperimental yang ekstensif, tim peneliti menemukan bahwa ukuran batch, jumlah frame input, dan metode pra-pemrosesan data memiliki dampak signifikan terhadap konvergensi SyncNet. Arsitektur model juga mempengaruhi konvergensi, namun pada tingkat yang lebih rendah.

Hasil eksperimen menunjukkan bahwa LatentSync mengungguli metode sinkronisasi bibir canggih lainnya pada beberapa metrik. Terutama dalam hal akurasi sinkronisasi bibir, berkat SyncNet yang dioptimalkan dan lapisan perhatian silang audio, yang dapat menangkap hubungan antara audio dan gerakan bibir dengan lebih baik. Selain itu, konsistensi waktu LatentSync telah ditingkatkan secara signifikan berkat teknologi TREPA.

Alamat proyek: https://github.com/bytedance/LatentSync

LatentSync yang bersifat open source telah membawa terobosan baru dalam pengembangan teknologi sinkronisasi bibir. Performanya yang efisien, akurat, dan metode pelatihan yang dioptimalkan layak untuk diteliti dan diterapkan. Kedepannya, teknologi ini diharapkan dapat berperan lebih besar dalam produksi video, virtual reality dan bidang lainnya.